Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxG-Sync sur portable... sans module G-Sync ?

Focus: GTX 970: 3.5 Go et 224-bit au lieu de 4 Go et 256-bit ?

Pilotes GeForce 347.25 WHQL

Dossier: Nvidia GeForce GTX 960 et GM206 : l'Asus Strix, l'Inno3D iChill Ultra et la MSI Gaming en test

GM200, le gros Maxwell, en images ?

Coil Whine et SAV, qu'en disent les fabricants ?

Le coil whine, vous en avez probablement déjà entendu parler, voire l'avez entendu tout court, peut dans certains cas être désagréable. Créé par des micro-vibrations au niveau des bobines qui se chargent de filtrer le courant au sein des circuits d'alimentations de nos machines, ce sifflement qui vire parfois au grésillement se fait de plus en plus entendre à mesure que nos PC gagnent en discrétion.

Tous les composants peuvent être impactés à divers degrés, de nombreux utilisateurs se sont par exemple plaints de ce phénomène avec des alimentations fanless ou avec un ventilateur à l'arrêt à faible charge. Les moniteurs peuvent également être touchés, et nous l'avons même rencontré sur des composants pour le moins inattendus tels que des SSD !

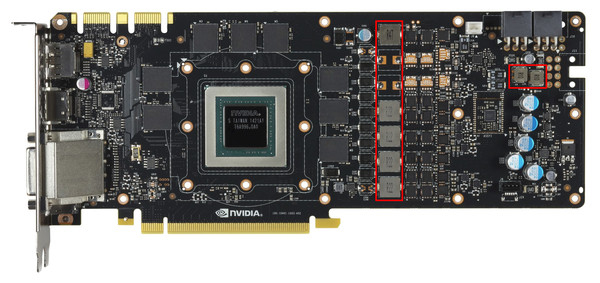

En rouge, les bobines des circuits d'alimentation GPU et GDDR5

Mais c'est surtout sur les cartes graphiques que le coil whine fait parler de lui. En soit il n'est pas nouveau, il se faisait déjà entendre sur certaines GeForce GTX 600 et Radeon HD 7900 par exemple, et même parfois avant, mais ces derniers temps il semble prendre de l'ampleur notamment du côté des GTX 900. De notre côté nous en avions particulièrement fait mention lors du test de la Radeon HD 7990, et en avons rencontré à des degrés divers dans notre test de 3 GeForce GTX 960. Bien sûr, le fait que les cartes graphiques soient de plus en plus discrètes en charge fait que la ventilation couvre moins le coil whine produit par les bobines, néanmoins on ne peut pas exclure que de mauvais choix de design ou de composant des étages d'alimentations l'amplifie. Le coil whine étant par nature aléatoire d'une carte à l'autre, il est difficile d'avoir une idée précise du phénomène.

Toujours est-il qu'il peut devenir gênant à l'usage, puisque audible même PC fermé. Plus les variations de charge sont rapides au niveau du GPU, plus le coil whine sera fort, c'est pourquoi de nombreux utilisateurs le remarquent particulièrement avec la synchronisation verticale désactivée dans certains menus de jeux qui entraînent des cadences de centaines ou milliers d'images par seconde. La synchronisation verticale ou le limiteur de fps (comme celui intégré dans Afterburner ) sont souvent appelés à la rescousse et réduisent le sifflement du fait d'une réduction des variations dans ces cas extrêmes ainsi que de la charge sur l'étage d'alimentation dans les jeux. Il ne s'agit pas pour autant d'une solution ultime, puisqu'au-delà d'un framerate élevé les variations de charge pour le calcul d'une même image ont un impact et qu'elles ont tendance à augmenter avec la complexification des moteurs 3D.

Que faire pour éviter de subir un coil whine gênant boitier fermé même avec une charge "classique" ? Le premier réflexe à avoir, c'est bien entendu de passer au crible cet aspect lors de la réception de la carte. On peut par exemple le faire sous Unigine Valley Benchmark , un benchmark gratuit qui offre une charge réaliste mais lourde avec un moteur 3D moderne. Attention nous parlons bien ici du coil whine durant la partie 3D, et pas dans l'écran de crédit quand on quitte l'application qui tourne à plusieurs milliers de fps : rares sont les cartes à être épargnées dans ce cas de figure, il semble plus opportun d'utiliser un limiteur de fps si vous ne souhaitez pas jouer avec la V-Sync pour ce cas. Mais si le coil whine est gênant en 3D, on peut alors utiliser son délai de rétractation dans le cadre d'une vente par correspondance. Si on n'est pas ou plus dans ce cadre, il faut alors faire face au service après-vente du magasin ou du constructeur qui ne sont pas forcément toujours réceptif à ce problème.

Nous avons questionné les quatre fabricants écoulant le plus de cartes graphiques en France afin de leur demander si ils acceptaient les SAV pour coil whine, et si oui dans quelles étaient les conditions requises. Voici leurs réponses :

ASUS est le premier à nous avoir répondu. Le coil whine est pris en charge pour peu qu'il soit "prononcé".Ces réponses pour le moins disparates montrent bien le problème que pose le coil whine aux constructeurs et aux services après vente. Reste qu'au-delà de ces positions il ne faut pas oublier que quelle que soit la politique de garantie du constructeur, votre vendeur doit vous garantir contre les défauts de conformité du produit. Vous êtes à ce titre couvert pour les cas important de coil whine, une carte graphique annoncée comme silencieuse comme c'est de plus en plus le cas ne l'étant plus si elle souffre d'un coil whine marqué en jeu. Bien entendu, et nous nous répétons, le plus simple reste encore de vérifier ce point durant le délai de rétractation en cas de vente par correspondance et de se rétracter si nécessaire.

MSI nous a ensuite indiqué ne pas prendre en charge ce cas de figure, tout en précisant faire le maximum pour réduire ce phénomène qui impacterai tous les constructeurs.

Pour sa part, Sapphire nous a répondu ne pas avoir de position officielle sur le coil whine. Il nous a été précisé qu'une majorité de ses revendeurs et grossistes ont pris l'option du rachat de garantie, c'est-à-dire qu'ils obtiennent une remise forfaitaire pour gérer directement le SAV sans repasser par Sapphire. Quand ce n'est pas le cas nous n'avons pas pu obtenir plus de précisions.

Enfin Gigabyte n'a toujours pas répondu après 13 jours et une relance. Mais c'est pour bientôt, parait-il.

Aussi complexe soit-il, le coil whine est un problème réel sur lequel tous les constructeurs de cartes et bien entendu de GPU se doivent de travailler, d'autant plus qu'ils essaient de nous vendre des produits silencieux. Le bruit ne vient pas que des ventilateurs ! Ce n'est qu'en leur mettant la pression, directement ou indirectement par les revendeurs, que ce qui semble être une tendance vers plus de coil whine sera inversée. De notre côté nous continuerons bien entendu à pointer du doigt les cartes passant entre nos mains qui en souffriront, mais malheureusement le côté aléatoire d'une carte à l'autre fait qu'on ne peut pas exclure un tri du constructeur en cas d'échantillonnage par celui-ci.

Nvidia désactive l'overclocking sur GTX 900M

En installant les pilotes GeForce de la branche 347.xx, des utilisateurs de portables haut de gamme, équipés en GeForce GTX 980M, 970M ou 965M, ont eu la mauvaise surprise de constater que les fonctionnalités d'overclocking avaient été purement et simplement bloquées par Nvidia. Un confrère espagnol, Hispazone , nous a averti du problème en début de journée et nous a confirmé avoir vérifié qu'il n'est effectivement plus possible de pousser les fréquences de ces cartes graphiques mobiles de la génération Maxwell.

En guise de communication officielle, un représentant de Nvidia a posté hier ce message sur le forum de la marque :

Unfortunately GeForce notebooks were not designed to support overclocking. Overclocking is by no means a trivial feature, and depends on thoughtful design of thermal, electrical, and other considerations. By overclocking a notebook, a user risks serious damage to the system that could result in non-functional systems, reduced notebook life, or many other effects.

There was a bug introduced into our drivers which enabled some systems to overclock. This was fixed in a recent update. Our intent was not to remove features from GeForce notebooks, but rather to safeguard systems from operating outside design limits.

Une surdose de langue de bois d'un chargé de communication qui se contente probablement de transmettre un message sans savoir de quoi il parle, ce qui n'a bien entendu pas plu aux amateurs d'overclocking qui rencontrent le problème depuis fin janvier et attendaient une réponse du fabricant. L'overclocking a toujours été possible sur GeForce mobile et les derniers pilotes ne désactivent cette fonctionnalité que pour les dernières GTX 900M, équipées d'un GPU GM204.

Par ailleurs, autre ineptie de cette communication, les risques de surconsommation et de surchauffe ne sont pas censés exister puisque la technologie GPU Boost est là pour se charger de faire respecter des limites de consommation et de températures.

L'overclocking des GPU GeForce a tout son sens dans le mobile puisqu'il se fait, pour rappel, à travers un décalage (offset) de toute la courbe de fréquence. Ce décalage revient à réduire la tension relative et donc à augmenter le rendement énergétique. Ainsi, même si la consommation ou la température maximale est atteinte, le gain reste bel et bien là. Si un GPU est limité à 900 MHz à 1.15V, un overclocking de 100 MHz fera par exemple qu'il tournera en pratique à 990 MHz et 1.14V. Il n'y a normalement aucun risque de fiabilité, en dehors de la stabilité bien entendu si l'overclocking est poussé trop haut.

De quoi nous laisser circonspects par rapport à ce virage de Nvidia. L'explication qui nous semble actuellement être la plus logique est qu'un problème de fiabilité aurait été détecté pour ces puces Maxwell mobiles, général ou limité à certaines machines. Ce n'est bien entendu qu'une supposition, mais Nvidia aurait alors pu prendre cette action radicale pour faire en sorte que les GPU tournent moins souvent dans la limite supérieure de leur enveloppe thermique. Si cela s'avérait être exact, ce sont peut-être plutôt les limites de consommation et de températures qui auraient dû être revues à la baisse, mais il est évidemment plus simple de faire en sorte de discrètement réduire l'occurrence d'un problème potentiel que de le corriger en revoyant à la baisse les spécifications d'un produit déjà commercialisé.

Nous mettrons à jour cette actualité si nous recevons plus de détails de la part de Nvidia.

Mise à jour du 19/02/2015 : Bonne nouvelle, Nvidia vient d'annoncer que l'overclocking des GTX 900M sera de retour dans la prochaine versions des pilotes.

Nvidia voit ses ventes augmenter de 9%

Nvidia a annoncé des ventes en hausse de 9% par rapport à l'an passé pour son dernier trimestre fiscal, qui prenait fin le 25 janvier, avec 1,251 milliards de $. La marge brute passe de 54,1 à 55,9%, et le bénéfice net s'établit à 193 millions de $ soit 31% de mieux qu'un an auparavant.

Nvidia a annoncé des ventes en hausse de 9% par rapport à l'an passé pour son dernier trimestre fiscal, qui prenait fin le 25 janvier, avec 1,251 milliards de $. La marge brute passe de 54,1 à 55,9%, et le bénéfice net s'établit à 193 millions de $ soit 31% de mieux qu'un an auparavant.

Dans le détail ce sont surtout les GPU qui tirent les revenus vers le haut avec 1,073 milliards de $, soit 13% de mieux que l'an passé. A contrario avec seulement 112 millions de $ Tegra est en baisse de 15%. Au sein des GPU le gros de la croissance vient des GeForce pour desktop et portables avec 38% de mieux. Nvidia ne donne pas de chiffre précis pour les Tesla et Quadro, mais on peut deviner que les ventes sont en légère hausse pour Tesla et à peu près stables pour Quadro.

DirectX 12 : Benchmarks et exclusivité Windows 10

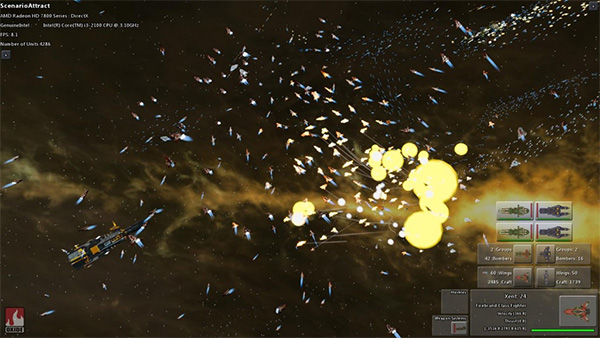

AnandTech a publié un article consacré à DirectX 12 se concentrant principalement sur des benchmarks obtenus sous Windows 10 Technical Preview 2 sous une version Direct3D 12 de Star Swarm Stress Test fournie par Oxide et Microsoft. Ce nom ne devrait pas vous être inconnu puisque cette démo dispose d'une version Mantle utilisée par AMD pour démontrer les bienfaits de son API à son lancement, mais elle a aussi déjà été utilisée en août dernier en version DX12 par Intel et Microsoft pour montrer les avantages du futur Direct3D.

Avant de passer aux résultats, nos confrères ont eu la confirmation par Microsoft que DirectX 12 ne sera disponible que sous Windows 10. Sachant que la mise à jour sera gratuite si effectuée durant la première année du lancement, cette annonce n'est pas problématique. Pour supporter DirectX 12, Windows 10 intègre la version 2 du WDDM. Côté GPU AMD et Nvidia disposent bien sûr de pilotes beta WDDM 2.0 et DX12, ce sont les versions 394.56 et 15.200 qui ont été fournies à nos confrères. A l'heure actuelle les pilotes AMD supportent les GPU GCN 1.0, 1.1 et 1.2, mais pour le moment Star Swarm Stress affiche des bugs de texture sur GCN 1.0. Côté Nvidia le support des Kepler et Maxwell est fonctionnel, mais les Fermi ne sont pas encore gérés.

Côté benchmark c'est donc sans grande surprise que les résultats obtenus sont très bons dans ce test très lourd en termes de draw calls. Ainsi une GeForce GTX 980 passe de 26,7 fps en D3D11 à 66,8 fps en D3D12, alors qu'une Radeon R9 290X est à 8,3 fps en D3D11, 42,9 fps en D3D12 et 45,6 fps sous Mantle. On note ici un avantage à Mantle sur ce test effectué avec 4 curs et confirmé avec 6 curs, mais avec 2 curs seulement c'est D3D12 qui reprend l'avantage avec 42,9 fps au lieu de 37,6 fps. Ces écarts sont en partie liés à un temps de traitement des lots de commande plus important sous Mantle du fait d'une optimisation du moteur effectuant une seconde passe côté CPU pour les optimiser, ce qui permet d'alléger la charge GPU au dépend de la charge CPU. Une fois celle-ci désactivée le temps de traitement des lots de commande est équivalent entre les deux API, par contre D3D12 repasse devant puisque sur 4 coeurs Mantle passe à 39,3 fps.

Pour rappel, pour contrer l'offensive Mantle, Nvidia a optimisé tant que possible les performances des commandes D3D11 via des optimisations génériques mais aussi spécifiques à certaines applications dont Star Warm. C'est ce qui explique que la version D3D11 soit 3,2 fois plus rapide sur GTX 980 que sur R9 290X, alors qu'AMD a orienté ses ressources sur Mantle qui reste 71% plus rapide. En Direct3D 12, l'avantage du dernier GPU Nvidia est probablement lié à des performances supérieures dans le traitement de la géométrie et/ou des commandes dans ce cas extrême.

DirectX 12 est donc toujours sur la bonne voie pour tenir les promesses d'une API bas niveau en termes d'allègement et de meilleure répartition entre les curs CPU de la charge liée aux commandes de rendu. Des bons résultats qui ont déjà été démontrés par AMD avec l'API Mantle qui a heureusement enfin fait bouger les lignes. Microsoft a encore beaucoup de choses à dévoiler sur DirectX 12, ce qui devrait se faire à l'occasion de la GDC 2015 en mars on pense notamment au nouveau niveau de fonctionnalité 11_3 ou 12_0. Reste qu'au-delà de l'API et des démos technologiques, il faudra bien sûr voir ce que les développeurs de jeux en feront !

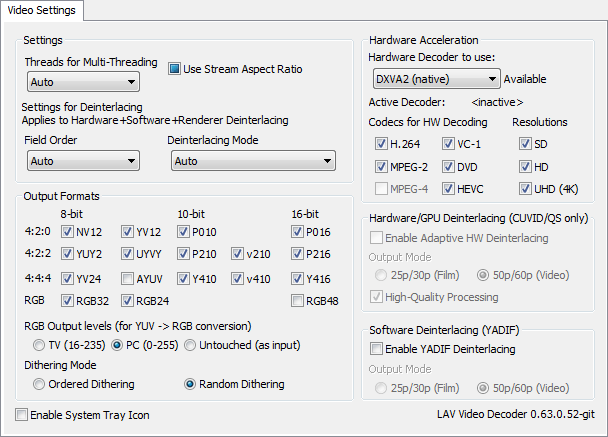

Décodage HEVC/H.265 sur GTX 960 en pratique

Nevcairiel, le développeur principal du pack de codec LAV Video, a publié des résultats obtenus en HEVC/H.265 sur GTX 960. Pour rappel, ce GPU est le premier à intégrer un décodage matériel de cette norme. Pour l'exploiter, il faut utiliser un codec H.265 utilisant le standard DXVA2, ce qui est le cas de celui de LAV Video qui est notamment intégré dans Media Player Classic Home Cinema. A noter qu'il faut activer manuellement l'accélération HEVC et UDH dans les paramètres de LAV Video, ces options ne sont pas cochées par défaut.

Les résultats sont au niveau attendus pour un décodage matériel, avec des vitesses de décodages allant de 118 à 153 fps pour des vidéos 4K ayant des débits de 4 à 12,3 Mbps, et 115 à 118 fps pour une autre vidéo 4K à 80 Mbps. Durant ces tests l'usage CPU est resté sous les 1%, sauf en mode CopyBack, preuve que c'est bien le GPU qui prenait en charge tout le décodage. Ces tests ont été faits sur des vidéos 8-bit, mais par la suite Nevcairiel a implémenté le support du 10-bit dans LAV Video et confirmé sa prise en charge par la GTX 960 .

Ces bons résultats ont également été relevés par nos confrères de Hardware.info , qui ont également relevé une utilisation processeur autour de 1%, alors que la consommation de la machine ne grimpait que de 3 watts durant la lecture. On est donc loin des solutions d'accélération logicielles qui nécessitent un processeur 4 curs ou même semi-matérielles qui restent assez gourmandes de ce côté, tout en ne pouvant pas tenir un framerate correct sur les vidéos aux bitrate les plus élevés. La GTX 960 est donc à ce jour la meilleure solution de décodage HEVC/H.265 sur PC, en attendant l'arrivée future de GPU plus abordables l'intégrant ainsi que des iGPU de l'AMD Carrizo et de l'Intel Skylake.