Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxComputex: Une GTX Titan custom chez Gigabyte ?

Dossier: Nvidia GeForce GTX 770 et MSI Lightning en test : GTX 680 1.1

Une baisse pour les GTX 670 et 680

GTX 780 Custom chez Gigabyte, EVGA et Inno3D

Pilotes GeForce 320.18 WHQL

Licences GPU: guerre AMD-Nvidia en vue ?

A travers son blog , Nvidia vient d'indiquer une nouvelle fois être en train de préparer la mise à disposition sous licence de ses technologies liées aux GPU. Nous précisons "une nouvelle fois" puisque Jen-Hsun Huang, le CEO de la société, avait déjà annoncé cela fin mars lors d'une conférence aux investisseurs.

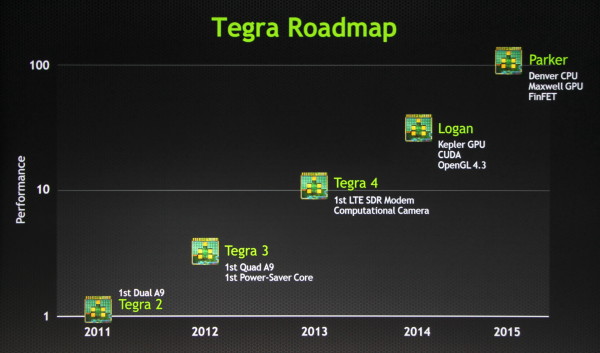

A partir de la génération Kepler mobile, qui sera introduite avec le SoC Tegra dénommé Logan, d'autres acteurs pourront avoir accès au GPU Nvidia en vue de l'intégrer dans leurs propres SoC. Nvidia va donc pouvoir concurrencer directement ARM (Mali), Imagination Technologies (PowerVR) et quelques autres acteurs secondaires, sur le plan des propriétés intellectuelles mises à disposition de l'industrie. CUDA en fera bien entendu partie même si nous pouvons supposer qu'il s'agira d'une option proposée en supplément.

Une manière pour Nvidia d'augmenter la part de marché représentée par ses GPU et bien entendu d'augmenter ses revenus en allant toucher d'autres clients. Si la qualité de son ensemble GPU et écosystème logiciel n'est pas à démontrer, la difficulté pour Nvidia sera probablement de convaincre les clients potentiels (Apple, Samsung ) de lui faire confiance dans la durée. Nvidia a pour habitude d'être très agressif en affaires, ce qui fait partie des raisons de son succès, et sera qui plus est en concurrence directe avec ses éventuels clients. Ainsi, Nvidia devra probablement leur garantir d'une manière ou d'une autre que ses propres SoC ne seront pas privilégiés que ce soit au niveau de petites différences d'architecture, des pilotes etc.

Les médisants verront dans cette évolution l'échec relatif des SoC Tegra de Nvidia. Si cela fait probablement partie des raisons, puisque ces derniers peinent à prendre des parts de marché significatives face au leader du domaine (Qualcomm) alors qu'Intel est en train d'arriver en force, nous y voyons également une manière de tenter de contenir AMD. Même si Nvidia n'est pas prêt à s'abaisser à admettre être inquiété par ce dernier, il ne fait aucun doute que l'intégration de technologies graphiques dérivées des Radeon dans toutes les consoles du marché est une menace.

Par ailleurs, il convient de ne pas confondre le temps des annonces et le temps des actions. En mars, juste avant que Jen-Hsun Huang n'indique discrètement que la mise sous licence de ses GPU allait arriver, des rumeurs intéressantes ont commencé à circuler : Qualcomm pour ses GPU Adreno et ARM pour ses GPU Mali seraient entrés en négociation avec AMD en vue de l'intégration future d'une variante mobile de l'architecture GPU GCN. Des rumeurs qui sont devenues insistantes lors de la GDC.

Pour AMD, qui mise beaucoup sur l'utilisation flexible de ses propriétés intellectuelles, il s'agit d'une évolution plus que logique. Rappelons que les GPU Adreno (anagramme de Radeon) ont été conçus par la division Imageon d'ATI/AMD, que Qualcomm a englobée. Par ailleurs, AMD, ARM, Qualcomm, Samsung, Imgagination, , ont formé un consortium, le HSA Foundation, chargé de poser un socle commun pour le GPU Computing.

AMD est ainsi plus que bien positionné pour fournir des GPU mobiles sous licence, et si aucune annonce officielle n'a été faite jusqu'ici, il n'est pas impossible que celle de Nvidia soit une réaction à des mouvements qui demeurent jusqu'ici silencieux.

Nvidia rappelle son attachement au jeu PC à l'E3

Face à l'offensive d'AMD de ces derniers mois autour du jeu PC, Nvidia se devait de réagir et l'a fait lors d'une conférence à l'E3. Pendant quelques années, Nvidia a pu profiter et s'habituer à un AMD anémique vis-à-vis des développeurs de jeux vidéo. Le changement de cap pris par son concurrent il y a quelques temps et qui commence progressivement à porter ses fruits agace donc au plus haut point. Du point de vue de Nvidia il serait éminemment injuste qu'AMD récupère la casquette du fabricant de GPU le plus actif auprès des développeurs.

Nvidia tient ainsi à réaffirmer son attachement au jeu PC tant sur une machine classique qu'à travers le streaming depuis le cloud ou vers sa console Shield. Le concepteur des GPU GeForce rappelle ainsi avoir mis en place de nombreux laboratoires de tests et autres outils destinés à améliorer l'expérience de jeu sur PC. Nvidia a également au cours de son histoire développé différentes techniques de rendu qui sont exploitées dans de nombreux jeux. Si les chiffres présentés (57% des "gros" jeux utilisent des technologies Nvidia, contre 7% des technologies AMD) illustrent probablement à la perfection toute la bonne foi dont peuvent faire preuve les communicants de la marque, la contribution de Nvidia au rendu 3D en temps réel n'est bien sûr plus à démontrer. Et la société indique continuer à investir dans cette voie.

Après avoir rappelé détenir près de 2/3 du marché du GPU, Nvidia a présenté quelques gros jeux sur lesquels ses équipes travaillent, que ce soit au niveau commercial, technique ou plus probablement les deux :

Assassin's Creed IV Black Flag

Batman Arkham Origins

Splinter Cell Blacklist

The Witcher 3 Wild Hunt

Watch Dogs

Nous remarquerons que tout comme AMD avec Square Enix, Nvidia semble ici avoir mis en place des partenariats à long terme puisque les 4 premiers jeux font partie de séries qui sont dans son giron depuis un petit temps. Tous ces jeux supporteront la tessellation et, à l'exception du prochain The Witcher, l'antialiasing TXAA que Nvidia a pour rappel malheureusement rendu artificiellement propriétaire pour les GeForce 600 et supérieures.

Si The Witcher 3 ne supporte pas le TXAA, Nvidia indique avoir travaillé avec le développeur sur d'autres effets tels qu'une fourrure réaliste pour les loups :

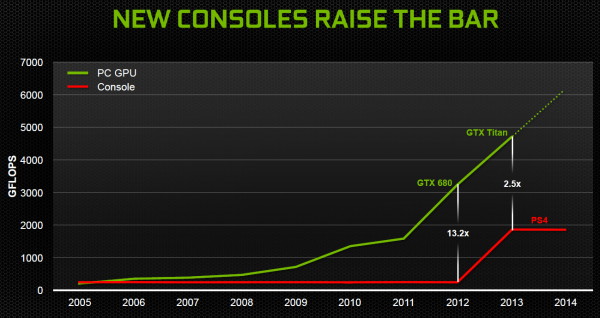

Sans nier qu'AMD va probablement profiter de sa présence dans les 2 consoles à venir de Microsoft et Sony, Nvidia voit avant tout dans cette évolution une opportunité pour le jeu PC puisque l'écart entre les possibilités de nos machines et les consoles va se réduire. Les développeurs vont pouvoir passer la barre plus haut pour la base de leur rendu ce qui devrait permettre d'aller encore plus loin côté PC.

Qui fournit le plus d'effort auprès des développeurs ? AMD ? Nvidia ? De notre côté, nous avons tenté à plusieurs reprises de creuser le sujet, sans succès. Tout d'abord, autant AMD que Nvidia balayent d'un revers de la main tout le volet commercial des accords avec les développeurs, circulez il n'y a rien à voir. Les relations se jouent pourtant bien à deux niveaux : assistance technique et accords commerciaux divers. Ces derniers vont de la présence d'un logo au démarrage d'un jeu à des accords de communication croisés en passant par l'intégration d'outils de bench plus ou moins orientés voire même d'handicaps pour la concurrence directement dans les jeux pour les cas les plus extrêmes.

Quand nous abordons le volet technique, AMD et Nvidia sont plus loquaces mais aiment avant tout se tirer dans les pattes. Nvidia voit ainsi les équipes d'AMD sous un regard condescendant : peu de moyens et manque d'ingénieurs de qualité, mais avec des dirigeants prêts à sortir le chéquier pour mettre en place des bundles et faire illusion. Pour AMD, les équipes de Nvidia ne recherchent que la possibilité de dégager un avantage compétitif, ignorant s'il le faut l'intérêt des joueurs et des développeurs mais sortant le chéquier pour aider ces derniers à regarder ailleurs.

Il est évident qu'AMD et Nvidia espèrent tirer un avantage compétitif en travaillant avec les développeurs, ne serait-ce qu'en prenant connaissance à l'avance de leurs plans. S'il serait naïf de penser qu'il n'y a pas d'abus, ce travail d'AMD et de Nvidia auprès des développeurs est nécessaire et avant tout utile pour l'évolution de la qualité graphique. Le fait qu'AMD s'efforce de revenir dans la course face à Nvidia ne fait qu'augmenter les moyens mis à dispositions du jeu PC, ce qui est une bonne chose, que vous possédiez une Radeon ou une GeForce.

Computex: GTX 760 et contrôle strict de Nvidia ?

L'intérêt d'un salon comme le Computex est de pouvoir rencontrer directement les responsables produits taiwanais dans un cadre relativement décontracté. De quoi bien souvent sortir de la langue de bois officielle et obtenir quelques informations confidentielles ou commentaires non filtrés sur certains aspects du marché.

Selon un partenaire de Nvidia, la GeForce GTX 670 serait sur le point d'être renommée en GeForce GTX 760 Ti avec une modification mineure de ses spécifications mais en reprenant le même design de référence. Un nouveau bios en somme. Par ailleurs, une version similaire à la GTX 670 (bus mémoire 256-bit), mais avec moins d'unités de calcul actives prendrait place en tant que GeForce GTX 760. Notez que si nous n'avons pu observer aucune GTX 760 Ti sur le salon, dont l'existence reste donc à prouver, plusieurs cartes nommées GTX 760 sont bien passées entre nos mains et le PCB et les modules mémoires indiquaient bien la présence d'un bus 256-bit.

Un autre partenaire de Nvidia nous a également expliqué un détail qui n'est pas sans intérêt concernant la manière dont sont fixées les spécifications des dernières GeForce GTX. Pour rappel, son turbo, GPU Boost, fonctionne sur base d'une limite de consommation et d'une limite de température. Des paramètres très importants pour les modèles extrêmes puisque sans augmenter une de ces valeurs, les possibilités sont très limitées pour proposer des overclocking d'usine ou des cartes adaptées aux overclockings massifs par les utilisateurs avancés.

Nvidia nous a indiqué ne pas autoriser ses partenaires à modifier la valeur de température. En cas de modification de ce paramètre, la garantie ne serait donc plus d'application. Par contre augmenter la limite de consommation est possible. Du coup comment font les partenaires de Nvidia ? Ils prévoient un étage d'alimentation massif et la modifie en conséquence ?

C'est ce qu'ils aimeraient faire, mais ce n'est pas aussi simple. En pratique, lorsqu'ils conçoivent un nouveau design (PCB + ventirad), ils doivent envoyer un échantillon à Nvidia qui va effectuer certains tests et décider de son côté de la valeur maximale qu'ils seront autorisés à appliquer. Nous pouvons supposer que cela fait partie de la stratégie de Nvidia pour s'assurer d'un niveau de qualité suffisant sur toutes les cartes équipées de ses GPU, que ce soit en termes de fiabilité ou de nuisances sonores.

Il s'agit cependant d'un contrôle qui agace certains fabricants puisque cela les ralentis et d'autre part représente un moyen de pression de plus dont peut user Nvidia pour les obliger à rester dans le rang sur de nombreux points. Ce partenaire s'inquiétait ainsi qu'en cas de discussion animée sur un détail commercial (nous ne saurons pas lequel), Nvidia ne retarde la validation d'un design

ou limite ses possibilités d'overclocking par rapport à un concurrent qui profiterait d'une relation plus amicale et qui se retrouverait donc avantagé sur un produit avant tout destiné à faire de la communication.

Ce n'est pas la première fois que les fabricants de cartes graphiques se plaignent de la mainmise de Nvidia sur de nombreux aspects de leur business. Tous ne manquent cependant pas de préciser que les affaires marchent mieux du côté des GPU Nvidia que de ceux d'AMD, raison pour laquelle ils serrent les dents en (presque) silence et ne se rebellent pas.

Computex: Tegra 4, DirectTouch et le calcul du stylet

Peu après le lancement de Tegra 3, Nvidia avait dévoilé la technologie DirectTouch qui consiste à remplacer le contrôleur de l'écran tactile par un pilotage logiciel. De quoi pouvoir profiter des performances plus élevées du SoC pour augmenter la sensibilité tactile par exemple. En pratique, de nombreuses tablettes ont cependant malgré tout fait appel à un contrôleur tel que ceux que propose Synaptics.

Au Computex, Nvidia a dévoilé une nouvelle technologie (le nom commercial viendra plus tard) qui se base sur DirectTouch ainsi que sur la puissance de traitement plus élevée des Tegra 4 et 4i pour offrir l'expérience d'un stylet actif avec un simple stylet passif. Actuellement, les surfaces tactiles manquent de sensibilité et pour améliorer le confort d'utilisation et la précision des tracés, un stylet actif est nécessaire. Wacom fourni de telles technologies par exemple, et elles impliquent bien entendu un surcoût, que Nvidia estime à 20$.

Avec la sensibilité de DirectTouch et l'exploitation de la puissance de calcul du GPU de Tegra 4 et 4i pour analyser les données, Nvidia est parvenu à obtenir un excellent résultat avec un simple stylet. De quoi permettre des courbes très précises, de varier l'épaisseur des traits avec la pression exercée (ce qui élargi la base du stylet) etc., et bien entendu de quoi ajouter de la valeur aux SoC Tegra vu l'économie non négligeable que cette approche autorise.

Démonstration de calligraphie chinoise par Jen-Hsun Huang, CEO de Nvidia.

Au passage, Nvidia démontre que même avec un GPU en retrait d'une génération sur la concurrence au niveau de la flexibilité de ses unités de calcul, ses équipes de développement sont loin d'être les mains liées par rapport à l'exploitation de cette puissance de calcul dans des domaines autres que le rendu 3D.

Reste à voir quand Nvidia pourra finaliser cette technologie et si elle séduira ses partenaires, d'autant plus que la question de l'incidence sur la consommation n'a pas été abordée et qu'il est possible qu'utiliser DirectTouch et le GPU soit moins efficace à ce niveau qu'utiliser un contrôleur dédié et un stylet actif.

Computex: Rencontre avec JH Huang, CEO de Nvidia

Juste avant l'ouverture du Computex, Nvidia a organisé autour d'un petit déjeuner une table ronde avec quelques journalistes et son CEO, Jen-Hsun Huang. Un espace de discussion toujours aussi intéressant que frustrant tant le discours parfaitement rodé et maîtrisé de Jen-Hsun Huang, ainsi qu'une durée très limitée rendent difficile de rentrer en profondeur dans les différents sujets qui concernent Nvidia (d'autant plus quand son CEO doit prendre le temps d'expliquer à un journaliste technique ce qu'est Steam).

S'il n'y aura pas eu de révélation tonitruante durant cette entrevue, Jen-Hsun Huang a malgré tout quelque peu précisé sa vision pour l'avenir de Nvidia. Tout d'abord en insistant clairement sur le fait que le graphique et l'évolution des GPU GeForce restent très importants pour la société, avec de nombreux développements en préparation. Un point qui n'est pas sans intérêt puisque depuis quelques temps, dans ses discours aux investisseurs, Jen-Hsun Huang place le GPU en retrait pour mettre en avant le marché potentiel pour les SoC Tegra.

Pragmatique, Jen-Hsun Huang admet également que Nvidia aura encore besoin du x86 pendant de longues années, certains marchés n'étant pas prêts de changer. C'est le cas par exemple des stations de travail et des applications liées, Nvidia ne les voit pas pouvoir se passer du x86 avant une dizaine d'années et ne compte bien entendu pas abandonner ce marché.

Dans d'autres domaines par contre, tels que les PC portables et même de bureau destinés au grand public ou aux joueurs, les barrières seront plus simples à franchir, et Jen-Hsun Huang ne prend pas de détour pour nous faire comprendre que Nvidia entend bien être prêt lorsque l'occasion se présentera, en précisant par exemple que de plus en plus de nouveaux développement en cours de jeux vidéo qui visent le PC prévoient également une version Android.

D'une manière subtile, Jen-Hsun Huang a également clarifié le positionnement des futurs cores ARMv8 maison, nom de code Denver. Il les destine à prendre le relai là où les cores ARM actuels montrent leurs limites, notamment face au x86. En d'autres termes, il faut comprendre qu'ils n'ont pas vocation à remplacer les cores ARM classiques dans tous les produits Nvidia, notamment dans les SoC Tegra ultra basse consommation. Il ne fait aucun doute que Nvidia ambitionne de pouvoir rivaliser avec les cores x86 d'Intel et d'AMD sur des marchés qui demandent des niveaux de performances plus élevés. Un pari risqué mais probablement pas complètement fou pour l'avenir de la société.