Actualités informatiques du 26-03-2013

- JMicron JFM667H pour le Galaxy Thunder GT

- Le Corsair Neutron GTX passe au 19nm

- Nvidia lance le GeForce GTX 650 Ti Boost

- Baisse pour les GeForce GTX 650, 650 Ti et 660

- L'ASUS GTX 670 DirectCU Mini en photos

- GeForce 314.22 WHQL pour BioShock Infinite

- GTC: Les Tesla K20X dans le Piz Daint suisse

- GTC: Performances GPU de Logan = GT 640M ?

- GTC: 5W Pour Tegra 4 et 1W pour Tegra 4i ?

| Mars 2013 | ||||||

|---|---|---|---|---|---|---|

| L | M | M | J | V | S | D |

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

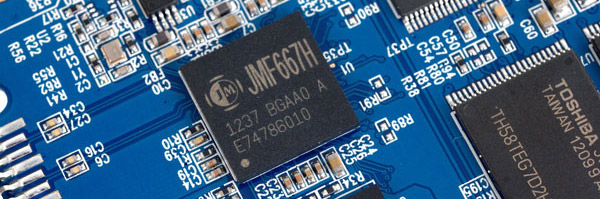

JMicron JFM667H pour le Galaxy Thunder GT

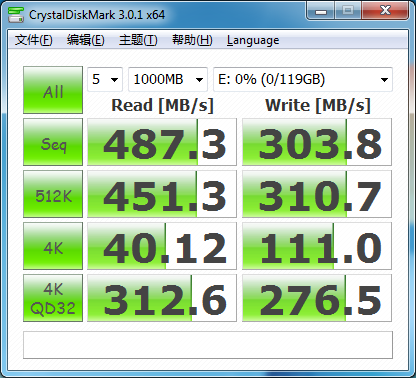

Le fabricant Galaxy est l'un des premiers à lancer un SSD basé sur un nouveau contrôleur JMicron, le JMF667H. Destiné au marché chinois, le Thunder GT 128 Pro est annoncé avec des débits de 480 Mo /s en lecture, 300 Mo /s en écriture pour 70K IOPS en lecture 4K QD64 et 58K IOPS en écriture 4K QD64, des chiffres de bon niveau.

Le JMF667H semble être une évolution du JMF661 utilisé dans le Kingston V200 et qui était plutôt correct avec un firmware à jour. On retrouve donc un lien SATA 6 Gbps d'une part et d'autre part 4 canaux Flash, le tout étant orchestré par un CPU ARM. Il est cette fois précisé qu'il est de type ARM9 alors que sa mémoire vive interne passe de 128 à 192 Ko, en sus d'une ROM de 32 Ko.

Point important, alors que le JMF661 ne gérait que la mémoire Flash Toshiba / Sandisk en 32 ou 24nm, cette fois le JMF667H gère les puces 19nm Toshiba / Sandisk et les puces 25 et 20nm Intel / Micron. La mémoire externe était de type DDR2 et ne pouvait excéder 256 Mo sur le JMF661, on passe à 512 Mo et en DDR3 sur le JFM667H.

Le Corsair Neutron GTX passe au 19nm

Corsair a lancé de nouvelles révisions de ses Neutron GTX 120 et 240 Go se distinguant au niveau de la mémoire Flash NAND MLC utilisée Toshiba. Sur les versions précédentes il s'agissait de puces gravées en 24nm par Toshiba et au format BGA, cette fois ce sont des puces 19nm au format TSOP.

- Neutron GTX 24nm : CSSD-N120GBGTX-BK, CSSD-N240GBGTX-BK

- Neutron GTX 19nm : CSSD-N120GBGTXB-BK, CSSD-N240GBGTXB-BK

Les spécifications officielles restent similaires côté lecture avec 555 Mo /s et côté écritures aléatoires avec 80K IOPS pour le 120 Go et 85K IOPS pour le 240 Go. Par contre Corsair n'indique pas le débit en écriture sur la version 120 Go "B" (330 Mo /s auparavant) alors que pour la version 240 Go "B" on est à 470 Mo /s, en légère baisse par rapport à la version précédente qui était à 511 Mo /s.

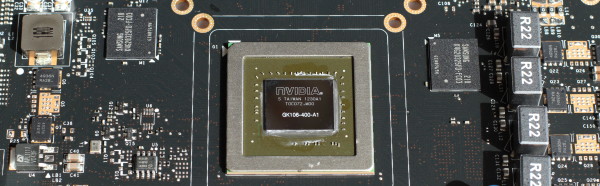

Nvidia lance le GeForce GTX 650 Ti Boost

En réaction à la Radeon HD 7790, Nvidia décline son GK106 dans une nouvelle version. Après les GTX 660 et GTX 650 Ti, voici donc le GPU GTX 650 Ti Boost.

Le GK106 dispose de 5 SMX qui englobent chacun 192 unités de calcul et 16 unités de texturing et de 3 contrôleurs mémoire de 64 bits associés chacun à 8 ROP chargés d'écrire les pixels après leur rendu. Sur la GTX 660, toutes ces unités étaient actives, alors que le GTX 650 Ti ne disposait que de 4 SMX et de 2 contrôleurs mémoires.

Le GTX 650 Ti se positionne en intermédiaire, comme le GTX 650 seuls 4 des 5 SMX sont actifs, par contre il dispose comme le GTX 660 des 3 contrôleurs mémoires 64 bits. Le Turbo Boost est également de la partie, avec des fréquences identiques au GTX 660 :

Le GTX 650 Ti Boost offre une puissance de calcul 5 à 11% supérieur au GTX 650 Ti, pour une bande passante 67% plus importante. Elle est identique à celle du GTX 660, qui offre par contre une puissance de calcul et de texturing 25% supérieure.

En pratique c'est plutôt la bande passante mémoire qui limite les performances sur GK106 sur les titres actuels et on peut s'attendre à des performances supérieures de 30% au GTX 650 Ti et inférieures de 15% au GTX 660 : le GeForce GTX 650 Ti Boost devrait donc être juste en dessous d'une Radeon HD 7850, ce que nous confirmerons dès que possible, l'actualité retenant actuellement Damien loin de ses systèmes de test (GTC puis GDC).

Avec un prix public annoncé à 149 pour 1 Go de GDDR5 et 169 pour 2 Go de GDDR5, le GeForce GTX 650 Ti Boost semble être bien positionné en version 1 Go, un peu moins en version 2 Go puisque le GTX 660 lui fait concurrence pour un écart de seulement 10 .

Il faut noter que si les versions 2 Go devraient être disponibles d'ici la fin de semaine (elles sont basées sur les GTX 660 2 Go), il faudra attendre mi-avril pour les 1 Go.

Baisse pour les GeForce GTX 650, 650 Ti et 660

Nvidia lance ce jour la GeForce GTX 650 Ti Boost et en profite pour annoncer une baisse des prix sur une partie de sa gamme :

- La GeForce GTX 650 passe de 119 à 109

- La GeForce GTX 650 Ti passe de 149 à 119

- La GeForce GTX 660 passe de 229 à 179

Il s'agit ici des prix publics conseillés par la marque, en pratique toutefois les prix étaient déjà inférieurs hors promotions ces dernières semaines pour les GTX 650 et 660, alors que le prix actuel des 650 Ti correspond au nouveau.

Reste donc à voir si l'officialisation de ces prix entrainera une nouvelle baisse au niveau des prix pratiqués. Quoi qu'il en soit la baisse récente permet à Nvidia de revenir sur AMD du côté du rapport performance/prix.

L'ASUS GTX 670 DirectCU Mini en photos

ASUS continue son teasing sur sa prochaine GTX 670 DirectCU Mini dont nous vous avions déjà parlé. Cette fois nous avons droit à des photos complètes de la carte :

Elle fait pour rappel 17cm de long contre 24cm pour la GeForce GTX 670 de référence et 27cm pour une DirectCU II ASUS. Il faut préciser PCB de référence fait en fait 17.2 cm, le surplus étant lié au système de refroidissement. ASUS a malgré tout mis au point un PCB personnalisé utilisant notamment ses composants habituels pour l'étage d'alimentation (Super Alloy Power) et un connecteur PCI-E 8 broches au lieu de deux 6 broches.

Il faudra voir si le DirectCU Mini ne sera pas trop éloigné du DirectCU II en termes de capacité de refroidissement, ce dernier étant particulièrement efficace sur les GeForce GTX 670 de la marque. La date de disponibilité et le prix de la DirectCU Mini ne sont pas encore connus.

GeForce 314.22 WHQL pour BioShock Infinite

Nvidia a mis en ligne la version 314.22 de ses pilotes WHQL. Ils reprennent les améliorations apportées par les 314.21 Beta et 314.14 Beta, et y ajoutent des améliorations de performances pour BioShock Infinite. A titre d'exemple Nvidia cite un gain de 41% sur GeForce GTX 680 en 2560x1600 en Ultra, ainsi que 30,9% dans les mêmes conditions en SLI (18,3% en 1920x1080 et SLI). Ce titre dispose également d'un profil pour l'occlusion ambiante.

Nvidia a mis en ligne la version 314.22 de ses pilotes WHQL. Ils reprennent les améliorations apportées par les 314.21 Beta et 314.14 Beta, et y ajoutent des améliorations de performances pour BioShock Infinite. A titre d'exemple Nvidia cite un gain de 41% sur GeForce GTX 680 en 2560x1600 en Ultra, ainsi que 30,9% dans les mêmes conditions en SLI (18,3% en 1920x1080 et SLI). Ce titre dispose également d'un profil pour l'occlusion ambiante.

Le téléchargement se fait directement sur le site du constructeur :

GTC: Les Tesla K20X dans le Piz Daint suisse

Après le supercalculateur Titan du Laboratoire national d'Oak Ridge, Nvidia a annoncé qu'un second supercalculateur venait de faire le choix de CUDA et de l'accélérateur Tesla K20X. Ce supercalculateur se nomme Piz Daint et est construit par le Centre national Suisse de Calcul Scientifique (CSCS) en collaboration avec MeteoSwiss. Bien que plus modeste que Titan, il devrait devenir le supercalculateur le plus puissant d'Europe avec une puissance de calcul supérieure au pétaflop. Il sera destiné à la recherche et à la modélisation météorologique.

Détail important concernant Piz Daint, il est basé sur la plateforme XC30 de Cray, qui repose sur des Xeon E5 et supporte l'accélérateur Xeon Phi en plus du Tesla K20X. Une double victoire donc pour Nvidia qui en plus de pouvoir fournir un nouveau supercalculateur, le fait en battant le concurrent direct proposé par Intel.

GTC: Performances GPU de Logan = GT 640M ?

Durant la GTC 2013, nous avons pu nous entretenir avec Ian Buck qui est à l'origine de la première version de CUDA et actuellement General Manager chez Nvidia pour les technologies du GPU Computing. Interrogé au sujet de Kayla, la plateforme de développement CUDA on ARM équipée d'un GPU GK208, Ian Buck nous a indiqué que les performances GPU, au niveau de CUDA, étaient bel et bien représentatives de celles de Logan, sans vouloir en dire plus.

Bien que ce niveau de performances représente le bas de gamme sur PC, il s'agit d'une évolution énorme pour un SoC Tegra. Si le passage au 20nm et sans aucun doute plusieurs évolutions de l'architecture (avec probablement une réduction du nombre d'unités de texturing), faciliteront l'arrivée de l'architecture Kepler et de CUDA dans le monde ultra-mobile, il est difficile d'imaginer que ces 384 cores (ou équivalents) flexibles ne consommeront pas plus que les 72 cores avec pipeline fixe de Tegra 4.

De quoi nous laisser spéculer qu'avec Logan, Nvidia devra se contenter de versions bridées (en termes d'unités actives ou de fréquences) pour les "petites" tablettes et les superphones, mais compte par contre revoir ses prétentions à la hausse avec un SoC capable de monter en gamme pour viser les "grosses" tablettes voire des ultra-portables et bien entendu le successeur de Shield.

Parallèlement à cela, Ian Buck nous a indiqué que CUDA devrait progressivement devenir "power aware" et devenir capable de prendre en compte l'aspect consommation ou tout du moins de permettre aux développeurs de le faire. Cela se fera tout d'abord au niveau des outils tels que Nsight (et sa version Tegra) qui d'ici quelques temps reporteront des informations liées à la consommation.

Il est possible qu'à terme, les compilateurs CUDA, permettent optionnellement d'améliorer le rendement énergétique, mais cela est encore à l'état de recherche et prendra encore plusieurs années avant d'éventuellement se concrétiser. Globalement, la meilleure stratégie reste d'exécuter le plus rapidement une tâche pour retourner au repos dès que possible mais ce n'est pas toujours vrai, d'autant plus dans le cas d'une tâche continue telle que le rendu 3D sur GPU. Par exemple, calculer une valeur au lieu de la lire en mémoire peut avoir un léger impact sur les performances mais augmenter le rendement énergétique.

En plus de préparer le futur avec CUDA, dans l'immédiat, le plus important pour Nvidia est probablement d'arriver à convaincre un maximum de développeurs que faire l'effort nécessaire pour arriver à utiliser 2 threads ou plus à fréquence modérée offre un meilleur rendement que se contenter d'un seul thread mais des performances de la fréquence CPU maximale.

Correction du 01/07/2013: le nom du GPU que nous pensions être GK117 est en réalité GK208.

GTC: 5W Pour Tegra 4 et 1W pour Tegra 4i ?

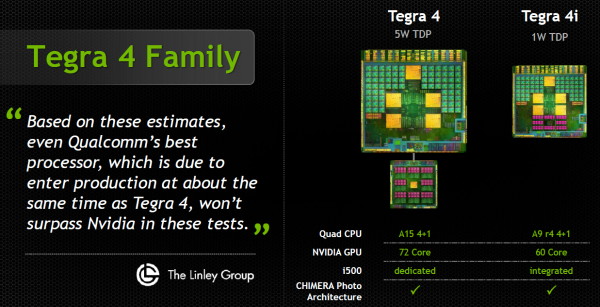

Lorsque nous avions rencontré Nvidia pour parler de l'architecture des Tegra 4 et 4i, il y a un point que le concepteur de ces SoC a catégoriquement refusé d'aborder : la consommation en charge et le TDP. Des chiffres délicats à avancer et à assumer puisque de toute évidence, la consommation maximale de Tegra 4 sera supérieure à celle de Tegra 3. Ceci n'étant bien entendu pas incompatible avec un rendement énergétique supérieur et avec une consommation en baisse lors de scénarios de types charge faible.

Lors d'une présentation dédiée aux investisseurs qui a suivi la keynote principale de la GTC, Jen-Hsun Huang, CEO de Nvidia, a avancé des chiffres concernant les TDP des futurs SoC : 5W pour Tegra 4 et 1W pour Tegra 4i. Deux chiffres relativement faibles, voire très faibles dans le cas du Tegra 4i qui intègre pour rappel 4 Cortex-A9 r4, un GPU relativement véloce et un modem 4G/LTE.

Pour comprendre ces chiffres, il faut cependant savoir que la définition du TDP est à géométrie variable, comme nous l'avions expliqué en nous intéressant de plus près au SDP d'Intel. Globalement le TDP représente la capacité de refroidissement nécessaire pour garantir le bon fonctionnement du composant. Historiquement cela représentait sa limite haute de consommation, mais progressivement, le fait de pouvoir fonctionner à une fréquence réduite pour éviter une surchauffe a été intégré à la définition même de "bon fonctionnement". Ajoutez-y les modes turbo et la prise en compte de l'inertie thermique et vous comprendrez qu'il devient difficile d'interpréter l'impact exact du TDP sur la consommation et sur les performances.

Les chiffres de 5W et de 1W avancés par Nvidia représentent ainsi probablement la capacité de dissipation nécessaire pour les variantes les moins gourmandes de Tegra 4 et de Tegra 4i. Des chiffres qui permettent de se faire une idée des types de designs et de formats qui pourront accueillir ces composants. De quoi confirmer que Tegra 4 est plutôt adapté à une tablette alors que Tegra 4i pourra être intégré facilement dans des smartphones compacts.

Difficile de dire par contre quel sera le niveau de performances soutenu autorisé par ces TDP puisqu'il est probable, comme c'est le cas pour la plupart des SoC actuels, que les Tegra 4 et 4i soient autorisés à consommer plus que cette valeur, jusqu'à atteindre une certaine température et voir leurs fréquences réduites. En plus de ces TDP, soit de la capacité de dissipation requise, il serait ainsi intéressant de connaître la capacité de dissipation conseillée par Nvidia pour pouvoir tirer le meilleur de ces SoC en termes de performances, notamment en ce qui concerne le jeu qui représente l'une des tâches les plus gourmandes qu'ils auront à exécuter.

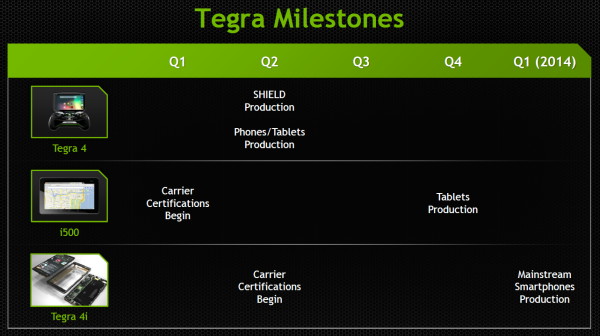

Enfin, notez que le CEO de Nvidia a précisé le timing de l'entrée en production des périphériques qui intégreront ces futurs SoC : Q2 2013 pour Shield, les tablettes et les superphones Tegra 4, Q4 2013 pour les tablettes Tegra 4 + modem i500 et enfin Q1 2014 pour les smartphones Tegra 4i (i500 intégré).