Actualités informatiques du 19-03-2013

- GTC: Le futur de Tegra: CUDA, Logan, Parker

- GTC: GPU: Maxwell puis Volta et DRAM stacking

- UEFI GOP chez Asus pour les GTX 680

- GTC: CUDA s'ouvre officiellement à Python

- GTC: Nvidia GPU Technology Conference 2013

| Mars 2013 | ||||||

|---|---|---|---|---|---|---|

| L | M | M | J | V | S | D |

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

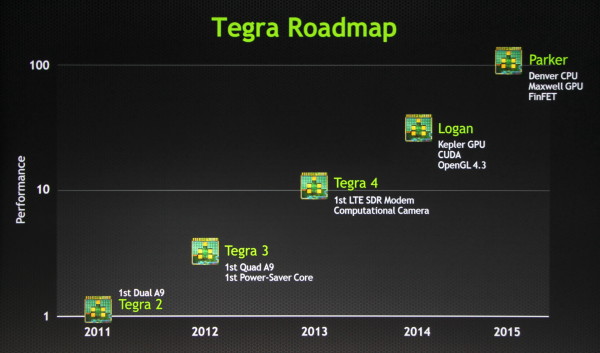

GTC: Le futur de Tegra: CUDA, Logan, Parker

Après la roadmap GeForce, Nvidia nous en a dit un peu plus sur la roadmap des SoC Tegra. Si certains ont été quelque peu déçus de ne pas retrouver un GPU plus moderne dans Tegra 4, cela est en passe de changer. Jen-Hsun Huang a ainsi confirmé que la prochaine architecture Tegra, Logan, intégrerait enfin une évolution GPU majeure qui fera le pont avec les technologies qui nous retrouvons dans la gamme GeForce traditionnelles.

Ainsi, le GPU de Logan sera dérivé de l'architecture Kepler avec un support complet d'OpenGL 4.3 et surtout de CUDA 5 pour permettre d'exploiter la puissance de calcul du GPU d'une manière plus flexible, par exemple pour le traitement d'images. En plus de sa plateforme propriétaire CUDA, nul doute que Nvidia supportera également la plateforme ouverte OpenCL, qui, dernièrement, a enfin reçu un support clair de la part de Google en ce qui concerne Android.

Pour le reste, il est probable que Logan reprenne les mêmes cores Cortex-A15 que Tegra 4 et soit fabriqué en 20 nanomètres. Jen-Hsun Huang a précisé que si Tegra 4 est arrivé en retard, Tegra 4i est de son côté arrivé légèrement en avance alors que Logan devrait être à l'heure avec des premiers prototypes à la fin de l'année et une production qui débutera début 2014. Vous pouvez donc vous attendre à une annonce de Tegra 5 au CES 2014.

Tout ceci n'est cependant qu'une confirmation de ce que nous supposions déjà. La nouveauté est l'arrivée de quelques premières informations sur le successeur de Logan : Parker. Ce dernier arrivera en 2015 et intègrera les premiers cores ARM conçus en interne par Nvidia et basés sur l'architecture ARMv8 qui supporte le 64-bit, nom de code Denver. Au niveau du GPU, Parker passera à la génération Maxwell, avec seulement une année de décalage par rapport aux gros GPU dekstop, les architectures GPU étant dorénavant unifiées entre les différentes divisions de Nvidia.

Parker devrait également être la première puce conçue par Nvidia en vue de l'utilisation d'un procédé de fabrication de type FinFET ("transistors 3D) et nous pouvons supposer qu'il s'agira alors du 14nm.

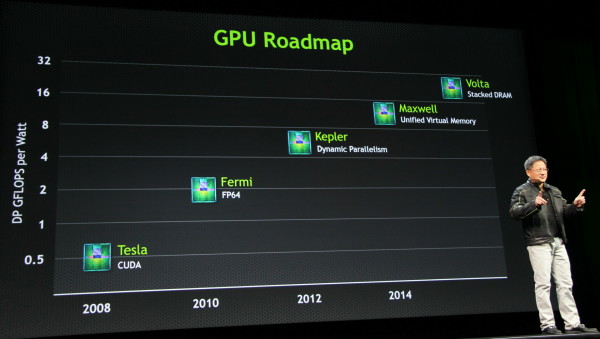

GTC: GPU: Maxwell puis Volta et DRAM stacking

Jen-Hsun Huang a profité de la keynote d'ouverture de la GTC pour mettre à jour la roadmap GPU globale de Nvidia. Pour rappel, après la génération Kepler actuelle, c'est la génération Maxwell attendue pour 2014 et fabriquée en 20nm qui représentera la prochaine évolution majeure avec le support d'une mémoire virtuelle unifiée, attendue depuis longtemps dans le monde du GPU computing.

Nvidia dévoile aujourd'hui la prochaine étape, nom de code Volta, en évitant de s'avancer trop précisément sur le timing, il dépend de nombreux facteurs dont certains extérieurs tels que le process 14nm, mais en la situant plus ou moins vers 2016. Quelle sera l'évolution la plus importante introduite sur cette future génération ? La mémoire empilée, ou DRAM stacking, qui consistera à placer plusieurs dies de DRAM au-dessus du die du GPU avec une connexion directe vers ce dernier à travers des vias.

Au prix d'une complexification de la production du GPU et de son packaging, éviter ainsi de passer par le PCB permettra de conserver plus facilement un signal de qualité en montant en fréquence voir en élargissant le bus mémoire. Nvidia vise alors une bande passante mémoire de l'ordre du téraoctet par seconde, soit un quadruplement par rapport à ce dont dispose une carte graphique haut de gamme actuelle telle que la GeForce GTX Titan.

Comme à son habitude, Nvidia communique sur une estimation de l'efficacité énergétique de ses futures architectures en double précision : +/- 12 Gflops/W pour Maxwell et +/- 24 Gflops/W pour Volta contre 6 Gflops/W pour Kepler et 2 Gflops/W pour Fermi. 200W de Volta permettra ainsi une puissance de calcul quadruplée en DP par rapport à 200W de Kepler, ce qui est en accord avec l'évolution de la bande passante mémoire. Ces chiffres ne se transposent bien entendu pas directement en performances graphiques, mais laissent néanmoins penser que l'évolution à ce niveau restera substantielle.

UEFI GOP chez Asus pour les GTX 680

Asus vient de rendre disponible sur son forum un nouveau BIOS pour ses cartes graphiques GeForce GTX 680. La mise à jour n'est disponible que sur leur forum pour l'instant, Asus souhaitant valider auprès d'utilisateurs volontaires et avancés son outil de mise à jour.

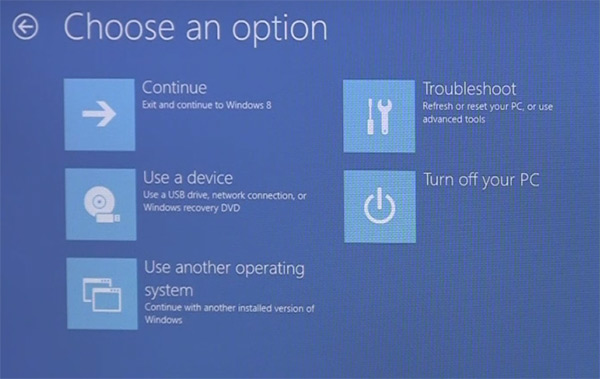

Qu'apporte cette mise à jour, donc, aux GeForce GTX 680 (tous les modèles du constructeur sont concernés par une update unique) ? Il s'agit d'un nouveau firmware hybride pour les cartes graphiques gérant en simultanée une procédure de boot classique (VGA) et une procédure GOP. L'avantage d'un boot GOP est multiple, mais on notera qu'il permet de booter dans la résolution native de l'écran et d'offrir au firmware et à l'OS, dès son chargement, un accès graphique avancé. Pour rappel, les BIOS traditionnels pré UEFI bootent en 640 par 480.

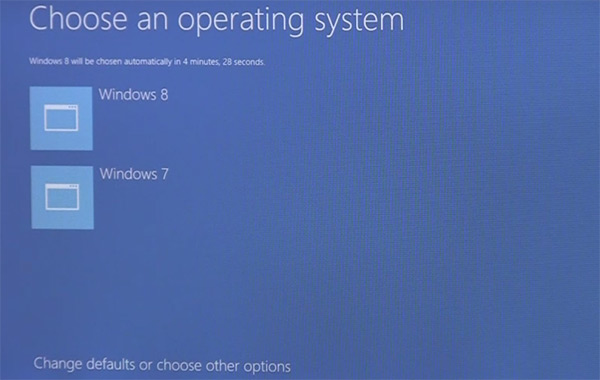

Cela permet par exemple à l'OS de proposer des écrans de dual boot graphiques qui peuvent proposer via des menus d'autres fonctionnalités avancées. On pourra également imaginer, pour l'UEFI, des bios graphiques qui s'adaptent à la résolution de l'écran (actuellement, les BIOS graphiques UEFI des différents constructeurs, par exemple ceux d'Asrock et d'Asus ici, sont tous rendus en 1024x768 via un pilote universel chargé au démarrage).

Les menus graphiques tels que ceux-ci sont ceux qui apparaissent au chargement de Windows 8. Les utilisateurs du nouvel OS peuvent ainsi profiter de ce que le marketing de Microsoft appelle "Fast Boot" et qui avait été explicité dans le blog Windows 8 .

Si le constructeur annonce que toutes ses GeForce GTX 680 sont compatibles avec l'outil, la mise à jour n'est pas forcément conseillée à tous. D'abord, cette mise à jour est définitive, il ne sera pas possible de flasher sa carte dans une version précédente. Ensuite, outre le fait qu'il faille disposer de Windows 8 pour profiter du Fast Boot, toutes les cartes mères ne sont pas forcément compatibles UEFI. Et toutes les cartes UEFI ne sont pas forcément compatibles Fast Boot (les P67/Z68 sont, selon Asus, incompatibles).

Enfin, Asus ne s'engage pas à ce que la carte fonctionne sur tous les modèles UEFI de tous les constructeurs, mais annonce avoir validé la mise à jour sur ses cartes mères (nous vous conseillons de mettre à jour le BIOS de la carte mère au préalable). Nous vous conseillons donc vivement, si vous êtes intéressés par cette mise à jour, de lire très attentivement les recommandations indiquées dans le forum du constructeur !

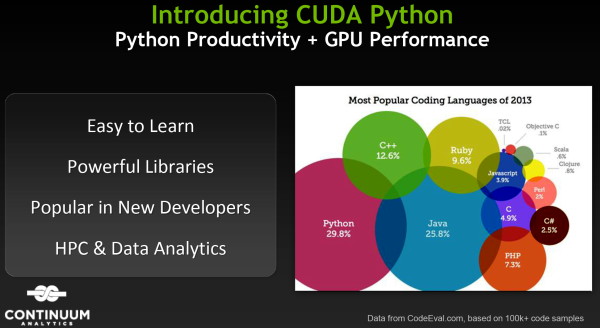

GTC: CUDA s'ouvre officiellement à Python

Après le C, Fortran et le C++, c'est Python qui devient le quatrième langage officiel pour CUDA. Contrairement aux trois premiers langages, ce support ne provient pas directement de Nvidia mais profite de LLVM, une infrastructure de compilateur open source qui a été adoptée pour les compilateurs CUDA il y a un peu plus d'un an. Grossièrement, LLVM expose une représentation interne qui fait office d'intermédiaire entre l'architecture CUDA et les compilateurs, ce qui facilite l'ajout du support de l'accélération via GPU à la plupart des langages.

Si plusieurs variantes plus ou moins complètes de compilateurs Python pour CUDA existent depuis quelques temps, c'est le nouveau compilateur NumbaPro développé par Continuum Analytics qui a atteint le premier un niveau suffisamment avancé pour que Nvidia puisse annoncer Python en tant que quatrième langage officiel pour CUDA

Bien que la suite Anaconda Accelerate qui intègre NumbaPro ne soit pas disponible librement, elle coûte 129$ (mais devrait passer en open source à terme), le fait que Nvidia puisse valider de la sorte un compilateur Python mis au point par un développeur externe témoigne de l'intérêt de la stratégie qui a dicté le passage à LLVM.

Ce support de Python, très répandu dans l'industrie et le monde scientifique, devrait permettre à Nvidia de convaincre quelques développeurs réticents de plus de passer au GPU computing ou tout du moins de jeter un coup d'il aux possibilités qu'il pourrait offrir.

GTC: Nvidia GPU Technology Conference 2013

Depuis quelques années déjà, la GPU Technology Conference (GTC) est un forum mis en place par Nvidia pour promouvoir le GPU computing et l'écosystème CUDA à travers la présentation des dernières évolutions liées à ce domaine, des formations pour les développeurs, ou encore des cas pratiques et autres retours d'expérience d'industries qui ont fait le choix de cette technologie, profitant des avantages du GPU, par exemple en termes de consommation ou de coûts par unité de puissance de calcul.

L'édition 2013 se tient actuellement à San Jose en plein cur de la Silicon Valley, et comme chaque année, nous sommes sur place pour couvrir les nouveautés éventuelles qui seront dévoilées au cours de l'évènement et rester à jour au niveau de ce qui se fait dans le GPU computing.

Si le sujet vous intéresse, la keynote principale, sera diffusée en direct à 17h (heure française) ici-même ou à partir d'un lien qui sera actif sur cette page . Durant celle-ci Jen-Hsun Huang, CEO de Nvidia, fera le point sur l'impact des GPU dans différents domaines et dévoilera les grandes lignes d'éventuelles nouveautés à venir.