Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxPilotes Nvidia R310 & BF3: maj des résultats

Assassin's Creed III en bundle chez Nvidia

Focus: DirectX 11.1: ni pour GeForce 600, ni pour Windows 7 ?

Pilotes Nvidia 310.61 beta

Pilotes GeForce beta 310.54

PDM GPU : AMD en difficulté dans le mobile

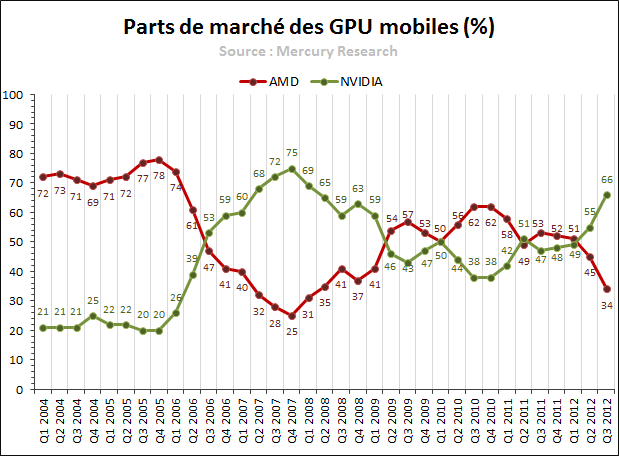

Les chiffres présentés il y peu par Jon Peddie Research, laissaient entrevoir une évolution importante au niveau des parts de marché des GPU mobiles entre AMD et Nvidia. X-bit Labs nous propose aujourd'hui, à travers un extrait d'une présentation Nvidia, les données de Mercury Research qui précisent cette évolution : les parts de marché d'AMD au niveau des GPU mobiles sont en chute libre.

Alors qu'AMD et Nvidia ont fait plus ou moins jeu égal pendant une année, de Q2 2011 à Q1 2012, l'arrivée des GeForce 600M a été bénéfique au second qui a vu ses parts de marché progresser jusqu'à 66% en Q3 2012, ne laissant plus qu'un tiers de ce marché à AMD. Nous avons compilé l'ensemble des chiffres de Mercury Research sur quelques années de manière à mettre en perspective l'évolution récente :

Notez que ces résultats ne prennent pas en compte les cores graphiques présents au sein des APU d'AMD. Un petit retour en arrière permet d'observer une domination nette d'AMD avant 2006 ainsi qu'en 2010, là où les Radeon HD 5000M ont eu le champ libre face aux GeForce 400M Fermi, en retard et peu efficaces sur le plan énergétique. En 2011, Nvidia s'est cependant rattrapé, notamment grâce à la technologie Optimus qui permet de profiter des cores intégrés pour éteindre le GPU quand il n'est pas sollicité. Enfin, Q2 2012 marque l'arrivée de la génération Kepler qui a effacé le déficit d'efficacité énergétique de Fermi.

Selon le CEO d'AMD, Rory Read, qui s'exprimait face à ses investisseurs, un pan de la stratégie d'AMD pour réduire ses coûts de fonctionnement consiste à se focaliser sur les projets qui peuvent générer des volumes importants, en délaissant les plus petits projets et clients. Une stratégie qui a un impact direct sur la vente de GPU mobiles puisqu'elle est liée à une myriade de projets dont une partie ne se concrétisent pas ou représentent une petite niche.

A l'inverse, Nvidia est très agressif sur ce marché et n'a pas caché son intention de mettre les moyens en termes de support aux fabricants pour s'assurer une place de choix dans les portables. Le plus petit GPU de la famille Kepler, dédié au bas de gamme pour les joueurs, avait par ailleurs été lancé en priorité dans le monde mobile, à travers les GeForce 660M, 650M, 640M et 640M LE.

Attribuer cette évolution des parts de marché, exprimées en unités, à un manque de volonté d'AMD ainsi qu'aux GPU Kepler de Nvidia comme l'on fait certains confrères serait cependant réducteur. Un autre aspect est probablement plus important. Nvidia a été plus pragmatique qu'AMD et a proposé aux fabricants un GPU ultra bas de gamme : le GF117. Celui-ci est basé sur la génération précédente, Fermi, mais fabriqué en 28 nanomètres, ce qui le rend peu cher à produire. Soyons clairs, ce GPU est tellement peu performant qu'il n'a aucun intérêt par rapport aux cores graphiques intégrés aux CPU/APU, mais il permet à moindre coût d'ajouter des logos et de muscler les fiches de présentation des portables en y ajoutant la présence d'une GeForce GT 620M et de sa mémoire dédiée.

De son côté, AMD a plus ou moins délaissé le très bas de gamme sur cette génération, se contentant de le former avec un renommage de l'entrée/milieu de gamme de la génération précédente. Ce qui fait sens techniquement compte tenu des capacités en hausse des cores intégrés, ne correspond cependant pas toujours à la vision commerciale des fabricants de portables.

Optimiser les jeux avec GeForce Experience

Nvidia vient de lancer la première version beta d'un projet en cours depuis plusieurs années et destiné à faciliter le paramétrage des jeux vidéo : GeForce Experience.

Le principe est relativement simple : une petite application se charge de détecter les jeux installés et de remplacer les paramètres par défaut de ces jeux par des paramètres mieux adaptés au PC en question.

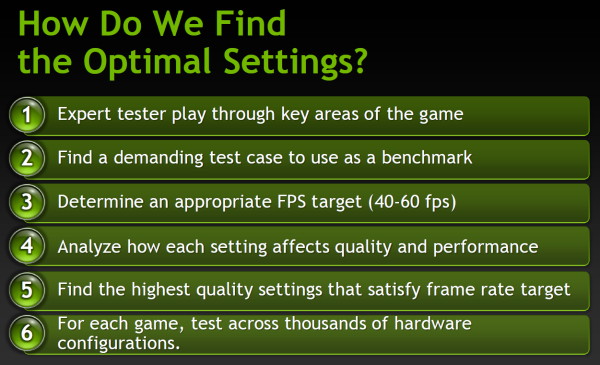

La mise en place est un petit peu plus complexe, ce qui explique pourquoi il a fallu aussi longtemps à Nvidia pour mener ce projet à terme. Le développeur des GeForce a formé une équipe de "joueurs experts" dont le travail consiste à tester l'ensemble des jeux vidéo. D'une part ils vont déterminer des scènes de test pertinentes ainsi que le niveau de fps nécessaire pour jouer confortablement (typiquement une moyenne de 40 à 60 fps avec un minimum de 25 fps), et d'autre part ils vont qualifier l'intérêt (subjectivement) et le coût de chaque option graphique.

Intervient alors ce que Nvidia nomme le gaming supercomputer. Il s'agit d'un ensemble de systèmes, chacun équipé d'une carte graphique différente, destinés à tester chaque jeu sur chaque GeForce. Ce supercomputer est similaire à celui que Nvidia utilise déjà dans son panel de services proposés aux développeurs qui peuvent ainsi tester le bon fonctionnement de leurs jeux sur tous les systèmes du marché (y compris sur les Radeon d'ailleurs).

Ce supercomputer va se baser sur les paramètres intérêt et coût des options graphiques pour tester progressivement, pour différentes résolutions et pour toutes les GeForce récentes, l'ajout d'options graphiques de manière à déterminer automatiquement une configuration optimale. Par exemple, l'algorithme donnera la priorité à l'augmentation de la qualité des textures (intérêt visuel élevé et coût faible) et ne testera le MSAA 8x (intérêt visuel réduit par rapport au MSAA 4x et coût élevé) qu'en dernier lieu.

Une base de données des paramètres qui couvre des milliers de configurations est ainsi générée et exploitée par l'application GeForce Experience qui pourra se charger d'aller modifier les fichiers de configuration des jeux à votre place. Voici un exemple présenté par Nvidia dans Crysis 2 :

[ Par défaut ] [ optimization GeForce Experience ]

La résolution est ici modifiée pour correspondre à l'écran et certaines options graphiques sont réduites pour obtenir une fluidité suffisante. L'activation des paramètres proposés par Nvidia reste bien entendu optionnelle et doit se faire manuellement au cas par cas. Il est possible de s'en servir comme base et de les modifier à sa guise une fois dans le jeu.

En pratique, nous avons pu observer que les propositions de Nvidia sont globalement pertinentes avec une remarque cependant : l'algorithme semble privilégier fortement la résolution native, ce qui peut être discutable dans le cas des résolutions telles que le 2560x1600 puisque que cela peut revenir à sacrifier complètement la qualité graphique.

Nvidia semble rester plutôt objectif sur la qualité graphique et ne privilégie pas outre mesure les options que démarquent les GeForce de la concurrence. Ainsi, effets PhysX et tessellation (traduite étrangement en mosaïque) n'ont pas la priorité sur d'autres effets graphiques qui peuvent avoir un intérêt visuel plus important.

Le but à terme est de permettre aux utilisateurs qui ne veulent pas perdre de temps dans les menus d'options de disposer facilement des paramètres qui permettent de tirer le meilleur de leur système et d'éviter que les néophytes ne jouent en qualité minimale simplement parce qu'ils ne savaient pas comment paramétrer leur jeu.

GeForce Experience est actuellement disponible en version beta pour les 10.000 premiers utilisateurs qui en feront la demande ici , le but étant d'obtenir un maximum de commentaires des joueurs avant de finaliser l'application. Cette version beta supporte actuellement une trentaine de jeux ainsi que les GPU de la génération Fermi et Kepler, qu'il s'agisse de versions desktops ou mobiles. Une version beta ouverte fera son apparition un peu plus tard.

Notez que GeForce Experience permet également au passage de mettre à jour les pilotes graphiques, les profils SLI et les profils 3D Vision.

Nvidia sort les GeForce 310.70

Les nouveaux GeForce 310.70 Beta, publiés hier, reprennent les améliorations des précédentes versions pour les derniers jeux, et y ajoutent quelques petites corrections.

Les nouveaux GeForce 310.70 Beta, publiés hier, reprennent les améliorations des précédentes versions pour les derniers jeux, et y ajoutent quelques petites corrections.

Comme toujours, les nouveaux GeForce incluent également leur lot de nouveaux profils SLI. En l'occurrence pour Call of Duty: Black Ops II (mis à jour), Hawken, Hitman: Absolution, Natural Selection 2 et Primal Carnage. Le profil de Far Cry 3 a également été corrigé afin de résoudre une chute de framerate rencontré sur certaines configurations avec les précédents profils.

Enfin quelques problèmes sont réglés:

- clignotement dans les zones ombragées résolu dans Assassin's Creed 3

- crash de BF3 avec des GeForce 500 et 600

- erreur indiquant que le pilote ne répond plus dans CoD Black Ops 2 avec des GTX 570 et 580

- erreur indiquant que le pilote ne répond plus dans Hitman Absolution avec une GTX 650Ti

- crash dans Final Fantasy XIV Online "DirectX device was lost"

- Les quad SLI de GeForce GTX 690 ne plantent plus en jouant en surround.

Les GeForce 310.70 Beta sont téléchargeables ici.

Pilotes GeForce beta 310.64

Nvidia comme AMD sortent décidément des pilotes beta au gré des sorties des hits de cette fin d'année. Voici donc au tour du caméléon de proposer les 310.64 destinés à améliorer les performances sous Far Cry 3. Nvidia fait mention de gains pouvant atteindre 38% sur GTX 680 et 40% sur GTX 660, sans préciser avec quels réglages, ce pilote intégrant également un profil SLI.

Nvidia comme AMD sortent décidément des pilotes beta au gré des sorties des hits de cette fin d'année. Voici donc au tour du caméléon de proposer les 310.64 destinés à améliorer les performances sous Far Cry 3. Nvidia fait mention de gains pouvant atteindre 38% sur GTX 680 et 40% sur GTX 660, sans préciser avec quels réglages, ce pilote intégrant également un profil SLI.

Sur le site GeForce.com , Nvidia affiche des benchs avec des gains de l'ordre de 35-40% sur GTX 670, 680 et 690 en 1920x1080 avec le niveau de qualité maximal ainsi que SSAO Ambient Occlusion, Transparency Supersampling et MSAA 8x. Des réglages exigeants qui ne sont toutefois pas jouable sauf à opter pour la plus grosse de ces cartes.

Le constructeur précise que les bugs rencontrés par certains utilisateurs avec Battlefield 3 et Assasin's Creed III avec les pilotes R310 devraient être corrigés dans les prochains pilotes WHQL.

Pour le téléchargement des 310.64, rendez-vous sur cette page .

Parts de marché GPU: Nvidia en forme

Les dernières données publiées par Jon Peddie Research relatives au marché du GPU pour le troisième trimestre 2012 viennent d'être publiées. Elles concernent le marché des solutions graphiques dédiées ou intégrées destinées au monde du PC (portable ou desktop, ainsi que les tablettes X86). Les tablettes ARM en sont exclues. Si on devait les résumer très rapidement on pourrait se contenter de dire que Nvidia s'en sort très bien, alors qu'Intel et AMD ont plongé en tandem.

Pour le troisième trimestre 2012 les livraisons de GPU ont baissé de près de 4,5% par rapport au trimestre précédent, ce qui en soi n'est pas encourageant. Mais en y regardant de plus près on voit que tous les acteurs ne sont pas égaux. A commencer par Intel qui a dévissé de 7% dans les desktops et de 8,6% dans les notebooks. AMD dans le même temps enregistrait aussi une baisse de 2% et 17% dans les mêmes secteurs respectivement. A l'inverse, Nvidia enregistre une croissance de 28,3% dans l'univers du desktop et de 12% dans celui du notebook.

Dans le détail les données sont encore plus saisissantes. Pour AMD, les ventes d'APU pour desktop ont plongé de 30% au Q3 par rapport à Q2. La baisse des livraisons d'APU dans les notebook est plus modérée, mais atteint tout de même les 4,7%.

Si on se projette face à l'année dernière tous les acteurs baissent. En tout les livraisons de GPU ont baissé de 20 millions d'unité par rapport au même trimestre de l'an dernier. Et même Nvidia baisse, perdant 0,5% par rapport à Q3 2011. Mais c'est une performance qui devient très encourageante si on la compare à celle d'AMD (-20%), d'Intel (-14%) et de VIA (-10%). Dernier point intéressant mis en avant par l'étude: 99% des processeurs Intel (hors produits serveur) vendus intègrent une partie graphique, la proportion est de 67% chez AMD. Les parts de marchés pour les solutions graphiques dédiées seules ne sont malheureusement pas communiquées.

Sur un an, malgré ces baisses trimestrielles, Intel est passé de 59,8% à 60,3% de parts de marché. Dans le même temps Nvidia est passé de 16,1 à 18,5%, contre 21,2% au lieu de 23% pour AMD.