Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxL'ASUS GTX 670 DirectCU Mini en photos

GeForce 314.22 WHQL pour BioShock Infinite

GTC: Les Tesla K20X dans le Piz Daint suisse

GTC: Performances GPU de Logan = GT 640M ?

GTC: 5W Pour Tegra 4 et 1W pour Tegra 4i ?

L'ASUS GTX 670 DirectCU Mini lancée

Après pas mal de teasing ASUS lance sa GeForce GTX 670 DirectCU Mini. Pour rappel cette carte double slot se distingue de par sa longueur de seulement 17cm contre 27cm pour le modèle DirectCU II et 24cm pour la carte de référence (avec 17,2cm pour le PCB seul).

La carte a été désossée ici et on peut voir que l'étage d'alimentation est composé de 4 phases pour le GPU et 1 phase pour la mémoire, comme c'est le cas sur la carte de référence (mais avec des composants de qualité supérieur chez ASUS) et alors que la DirectCU II classique est en 6+2 phases.

Le refroidissement prise en charge par une large chambre à vapeur en cuivre couvrant le GPU qui est incorporée dans un ensemble en aluminium couvrant également 1 et des 2 de GDDR5 et l'étage d'alimentation. On retrouve des ailettes au-dessus du bloc d'alimentation ainsi qu'un ensemble d'ailettes sous une forme ronde au-dessus de la chambre à vapeur.

La ventilation est confiée à un ventilateur assez spécial composé de 9 grandes pales et de 9 pales plus courtes. Malgré ces efforts le tout semble nettement moins efficace que le DirectCU II classique, nos confrères de Hardware.info ayant mesuré 12 dBA de plus en charge sur la GTX 670 DirectCU Mini par rapport à la GeForce GTX 670 DirectCU II TOP .

La carte devrait être disponible fin avril à un prix public de 449 , sa compacité se faisant donc a priori au détriment des nuisances sonores en charge mais aussi du prix.

GeForce 700M : de qui se moque Nvidia ?

Ce n'était pas un poisson d'avril, Nvidia a annoncé hier de nouvelles déclinaisons de GeForce 700M qui viennent s'ajouter aux GeForce GT 730M et GT 710M introduites il y a peu. Nvidia met en avant le support de la technologie Optimus, qui permet de profiter de l'IGP Intel pour réduire la consommation au repos, de GeForce Experience pour faciliter la configuration des jeux et de GPU Boost 2.0 pour optimiser les performances.

Sont ainsi introduites des GeForce GT 750M, GT 745M, GT 740M, GT 735M et GT 720M. La dernière est basée sur un GPU de la génération Fermi et représente de l'ultra bas de gamme, comme la GT 710M. Des GPU qui n'ont selon nous aucune utilité si ce n'est de permettre d'ajouter un logo de plus sur les portables. Les 4 autres GeForce GT 700 sont basées sur un GPU Kepler d'entrée de gamme, comme la GeForce 730M. Il s'agit du GK107 ou de son successeur, le GK208, aux performances identiques en dehors du bus mémoire limité à 64-bit, mais qui dispose d'un processeur de commandes plus flexibles pour CUDA.

De nouvelles cartes graphiques mobiles intéressantes ? Impossible à dire tant Nvidia joue de l'opacité sur les spécificités réelles de ces produits : l'occasion d'un petit, voire long, coup de gueule !

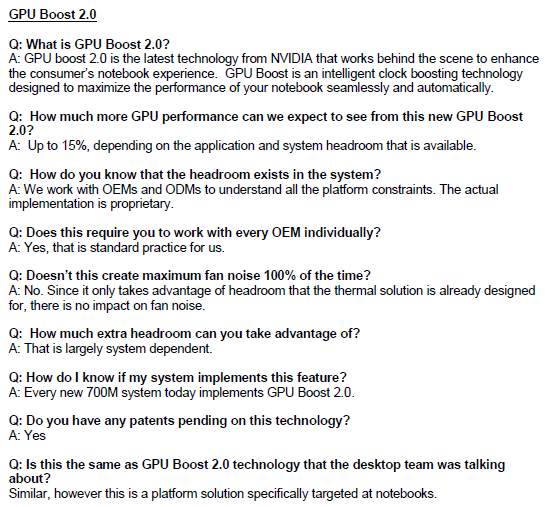

Commençons par GPU Boost 2.0. Si vous suivez l'actualité graphique desktop, vous savez probablement que Nvidia a toujours refusé d'expliquer clairement le fonctionnement de sa technologie GPU Boost, se contentant de donner des bribes d'informations qui se sont dans certains cas avérées incorrectes. La définition officielle de la version 2.0 de GPU Boost desktop est un non-sens et est probablement simplement le fruit d'un commercial en manque d'arguments à inscrire dans son PowerPoint. Qu'en est-il du côté mobile ? Voici ce que Nvidia communique à la presse spécialisée :

Très peu de concret et beaucoup d'arguments bateaux. En réalité, bien que pour une raison étrange Nvidia ait toujours refusé de communiquer officiellement sur le sujet, les GeForce 600M disposaient déjà d'un GPU Boost. Quelle est la différence avec le GPU Boost 2.0 des GeForce 700M ? Nous ne le saurons pas. Quelle différence avec la version desktop ? Nous ne le saurons pas.

Nvidia nous rassure cependant, inutile de creuser le sujet, il suffit de lui faire confiance : GPU Boost 2.0 va apporter un gain de performances (jusqu'à 15%) et n'a aucune influence sur les nuisances. Parce que bien entendu, maximiser l'utilisation d'une enveloppe thermique sur base de limites de consommation et de température ne va pas justement revenir à maximiser la température et la vitesse du ventilateur. Nvidia joue sur les mots : les nuisances maximales ne vont pas augmenter, c'est vrai, mais les nuisances pratiques vont s'en approcher plus souvent Bien entendu, le fabricant peut décider de calibrer son système de refroidissement de manière à contenir agressivement les nuisances, mais les performances seront alors dans certains cas inférieures avec GPU Boost 2.0 que sans cette technologie. Par rapport aux GeForce 600M et à leur GPU Boost fantôme, quelle différence ? Nuisances mieux limitées ou gain de performances de 15% ? Impossible à dire.

Ce point étant traité, passons aux spécifications ou plutôt à leur absence. Avec les GeForce 700M, Nvidia a décidé de réduire sa communication sur les spécifications, pourtant déjà très vague auparavant. A la place, un indice de performances par rapport au HD 4000 d'Intel dans Crysis 2. Nvidia se justifie en expliquant que les cartes graphiques mobiles sont personnalisées pour chaque portable et qu'il n'y a donc pas de spécifications fixes. Par contre, les performances, elles, seraient bien toujours similaires ! Fréquences revues à la baisse ? DDR3 vs GDDR5 ? 64-bit vs 128-bit ? Un impact sur les performances ? Pas du tout, faites confiance à l'indice !

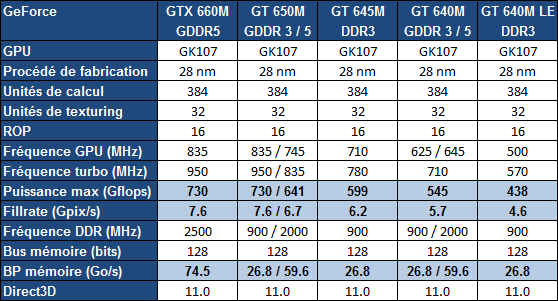

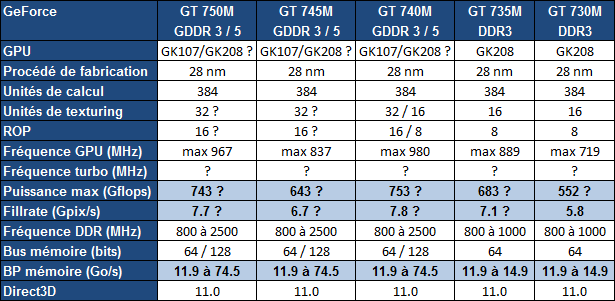

Voici les spécifications que nous avons pu observer en général pour les GeForce 600M en GK107 et les bribes d'informations communiquées par Nvidia pour les nouvelles GeForce GT 750M, GT 745M, GT 740M, GT 735M et GT 730M :

Toutes les GeForce 600M disposent d'un mode turbo, bien que quelques portables ne l'exploitent pas. Les GT 650M et GT 640 existent en version GDDR5 ou DDR3 (plus courante), la première variante se contentant d'une fréquence GPU réduite en version GDDR5 compte tenu de la limitation au niveau du TDP. Ces spécifications se retrouvent dans la majorité des portables équipés de ces cartes. Officiellement, il n'y a pas de version 64-bit et nous n'avons pas pu en observer.

Avec les GeForce 700M, ça se complique. Dans un document dédié à la presse spécialisée, Nvidia donne une fréquence de base maximale pour chaque GPU. Correspond-elle la fréquence habituelle de la carte graphique ou à un cas extrême ? A la version GDDR5 ou DDR3 ? Car en dehors des GT 735M et GT 730 qui seront toujours en DDR3 64-bit, les GT 750M, GT 745M et GT 740M peuvent exister soit avec de la GDDR5 très rapide soit avec de la DDR3 ainsi qu'en versions 64-bit et 128-bit. Nous pouvons supposer que 980 MHz pour la GT 740M n'est possible qu'en version DDR3 et que les versions 64-bit seront toujours en GDDR5, mais Nvidia ne dispose d'aucune information supplémentaire à communiquer à la presse à ce sujet.

Nvidia annonce par contre une GT 750M 50% plus performante que la GT 650M, une GT 745M 75% plus performante que la GT 645M et une GT 740M 40% plus performante que la GT 640M. Dans les deux premiers cas nous pouvons supposer que Nvidia compare la variante la plus véloce (GDDR5) des GT 750M et GT 745M aux variantes les moins véloces (DDR3) des GT 600M correspondantes.

Soyons honnête, sur base des informations officielles et de la communication à la presse spécialisée, il est impossible de juger de l'intérêt de ces nouvelles solutions graphiques. Cette situation n'est pas réellement nouvelle dans le monde des GPU mobiles, AMD et Nvidia ayant pris l'habitude d'y faire tout et n'importe quoi. Le lancement des GeForce 700M pousse cependant cette mauvaise habitude un pas plus loin dans la mauvaise direction.

Nvidia part du principe qu'il s'agit de produits grand public et qu'une communication sérieuse n'est pas nécessaire. Après tout, par rapport à ces produits, la presse spécialisée est en général plus que complaisante ou ne prend pas le temps de s'y intéresser et de réellement les tester. Et puis bon, au fond, le grand public n'y connaît pas grand-chose... DDR3 ou GDDR5 ? Ils ne verront pas la différence. GT 750M ou GT 740M ? Du moment qu'ils acceptent de payer un peu plus cher le portable équipé de la première

Pourquoi s'embêter avec une communication détaillée qui empêcherait d'annoncer des gains fantaisistes par rapport à la génération précédente tout en profitant d'une hyper segmentation ridicule de l'entrée de gamme ? Ou qui ne permettrait pas par exemple de commercialiser plus cher une GT 750M sous-cadencée aux fréquences d'une GT 740M ? Après tout, le client est roi, sauf que le client bien entendu est le fabricant de portable. Si ce dernier voit de la valeur dans la confusion qui règne autour des GPU mobiles ou dans la possibilité de tromper le consommateur final, autant aller dans ce sens.

Ce manque de respect vis-à-vis du client final est désolant. De notre point de vue, l'approche commerciale de Nvidia fait que vous ne pouvez pas faire confiance à ces GeForce 700M ni trouver de la valeur dans le fait qu'un portable affiche la marque GeForce GT 750M dans ses spécifications. Il faudra attendre des retours d'utilisateurs de portables qui en sont équipés pour savoir quelles sont les spécifications de leur GPU et à quel niveau de performances vous pouvez vous attendre.

Sans nous faire d'illusions, nous continuons d'espérer que les fabricants de GPU et les fabricants de portables finiront par faire preuve de plus de transparence au niveau des cartes graphiques mobiles, qui représentent un composant déterminant lorsqu'un portable est utilisé pour le jeu.

Notez que les premiers portables équipés en GeForce GT 730M (Acer M3/V3 et Gigabyte U2442) affichent des fréquences GPU/mémoire de 725/900 MHz, mais sans supporter GPU Boost. Quant à la GT 740 intégrée dans l'Asus A56CB, elle est, selon nos confrères de Noteboocheck , cadencée à 810 MHz pour le GPU, 895 MHz pour son mode turbo et 900 MHz pour sa mémoire DDR3.

Correction du 01/07/2013: le nom du GPU que nous pensions être GK117 est en réalité GK208.

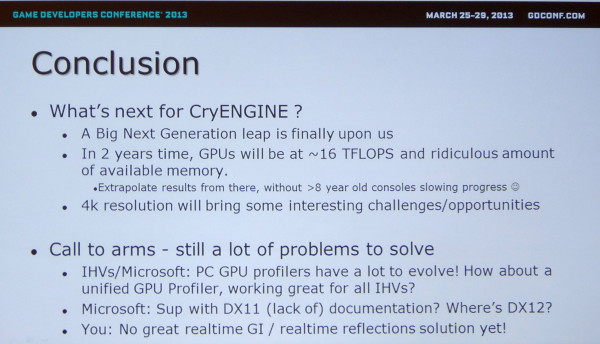

GDC: AMD, Intel, Nvidia, Qualcomm... à la GDC

Lors de la GDC, dont l'édition 2013 s'est terminée vendredi dernier à San Francisco, les plus importants fournisseurs de technologies graphiques (les GPU Radeon, Mali, PowerVR, HD Graphics, GeForce, Adreno) étaient présents avec notamment pour but de convaincre les développeurs de jeux vidéo d'exploiter toutes les possibilités de leurs produits récents à travers des techniques de rendu toujours plus évoluées que ce soit sur PC ou dans le monde mobile, qui progresse à vive allure.

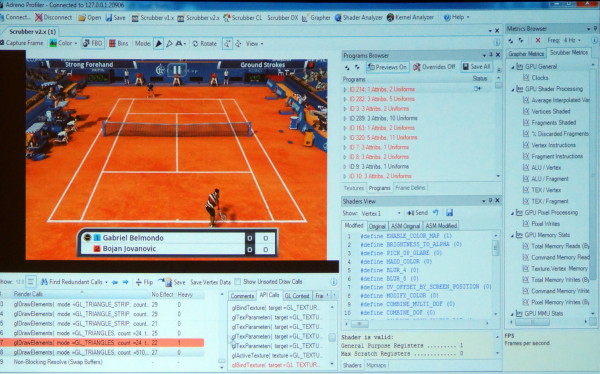

En plus de diverses présentations, AMD, ARM, Imagination, Intel, Nvidia et Qualcomm étaient présents à travers des stands principalement exploités pour mettre en avant leurs outils maisons : AMD GPU PerfStudio, ARM Mali Graphics Debugger, Imagination PVRTune, Intel Graphics Performance Analyzers, Nvidia Nsight, Qualcomm Adreno Profiler

Ici en exemple, l'Adreno Profiler de Qualcomm qui permet d'observer assez facilement le comportement des GPU Adreno et d'appliquer des modifications à la volée pour identifier des bugs ou des goulots d'étranglement (bottlenecks). Il est ainsi possible de modifier un shader, de désactiver la synchronisation verticale, de réduire la taille de toutes les textures, etc., et d'observer l'impact en temps réel sur le smartphone ou sur la tablette.

Les outils de tous les acteurs cités proposent des possibilités similaires, chacun ayant des petits avantages ou inconvénients par rapport à la concurrence. Ils sont en général autant adapté au débogage et à l'optimisation de la partie graphique que de la partie "compute" éventuellement exposée pour les GPU.

Lors de plusieurs rencontres avec des développeurs, nous avons voulu savoir quels outils ils préféraient et pourquoi. La réponse de nos interlocuteurs a été unanime : aucun ! Pourquoi ? Tout simplement parce que la multiplication de ces outils devient problématique et que peu importe leurs qualités ou leurs défauts, devoir utiliser un outil spécifique à chaque marque de GPU est tout sauf pratique, d'autant plus quand il faut en supporter bon nombre comme c'est le cas sous Android.

Même avec seulement 3 acteurs, c'est un problème dans le monde PC comme le rappelle Crytek en parlant des opportunités et défis à venir. Il serait ainsi intéressant que Microsoft et Google proposent des outils de développement plus évolués qu'actuellement et dans lesquels les concepteurs de GPU pourraient venir s'interfacer pour proposer autant de détails que dans leurs propres outils mais d'une manière plus ou moins unifiée.

Notez au passage que Crytek en profite pour rappeler à Microsoft qu'il serait peut-être bon de travailler sur la documentation de DirectX !

Nvidia lance le GeForce GTX 650 Ti Boost

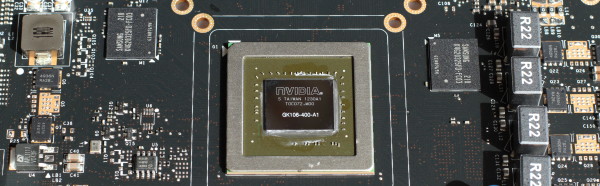

En réaction à la Radeon HD 7790, Nvidia décline son GK106 dans une nouvelle version. Après les GTX 660 et GTX 650 Ti, voici donc le GPU GTX 650 Ti Boost.

Le GK106 dispose de 5 SMX qui englobent chacun 192 unités de calcul et 16 unités de texturing et de 3 contrôleurs mémoire de 64 bits associés chacun à 8 ROP chargés d'écrire les pixels après leur rendu. Sur la GTX 660, toutes ces unités étaient actives, alors que le GTX 650 Ti ne disposait que de 4 SMX et de 2 contrôleurs mémoires.

Le GTX 650 Ti se positionne en intermédiaire, comme le GTX 650 seuls 4 des 5 SMX sont actifs, par contre il dispose comme le GTX 660 des 3 contrôleurs mémoires 64 bits. Le Turbo Boost est également de la partie, avec des fréquences identiques au GTX 660 :

Le GTX 650 Ti Boost offre une puissance de calcul 5 à 11% supérieur au GTX 650 Ti, pour une bande passante 67% plus importante. Elle est identique à celle du GTX 660, qui offre par contre une puissance de calcul et de texturing 25% supérieure.

En pratique c'est plutôt la bande passante mémoire qui limite les performances sur GK106 sur les titres actuels et on peut s'attendre à des performances supérieures de 30% au GTX 650 Ti et inférieures de 15% au GTX 660 : le GeForce GTX 650 Ti Boost devrait donc être juste en dessous d'une Radeon HD 7850, ce que nous confirmerons dès que possible, l'actualité retenant actuellement Damien loin de ses systèmes de test (GTC puis GDC).

Avec un prix public annoncé à 149 pour 1 Go de GDDR5 et 169 pour 2 Go de GDDR5, le GeForce GTX 650 Ti Boost semble être bien positionné en version 1 Go, un peu moins en version 2 Go puisque le GTX 660 lui fait concurrence pour un écart de seulement 10 .

Il faut noter que si les versions 2 Go devraient être disponibles d'ici la fin de semaine (elles sont basées sur les GTX 660 2 Go), il faudra attendre mi-avril pour les 1 Go.

Baisse pour les GeForce GTX 650, 650 Ti et 660

Nvidia lance ce jour la GeForce GTX 650 Ti Boost et en profite pour annoncer une baisse des prix sur une partie de sa gamme :

- La GeForce GTX 650 passe de 119 à 109

- La GeForce GTX 650 Ti passe de 149 à 119

- La GeForce GTX 660 passe de 229 à 179

Il s'agit ici des prix publics conseillés par la marque, en pratique toutefois les prix étaient déjà inférieurs hors promotions ces dernières semaines pour les GTX 650 et 660, alors que le prix actuel des 650 Ti correspond au nouveau.

Reste donc à voir si l'officialisation de ces prix entrainera une nouvelle baisse au niveau des prix pratiqués. Quoi qu'il en soit la baisse récente permet à Nvidia de revenir sur AMD du côté du rapport performance/prix.