Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxL'ASUS GTX 670 DirectCU Mini lancée

GeForce 700M : de qui se moque Nvidia ?

GDC: AMD, Intel, Nvidia, Qualcomm... à la GDC

Nvidia lance le GeForce GTX 650 Ti Boost

Baisse pour les GeForce GTX 650, 650 Ti et 660

Bundle: Metro Last Light pour les GTX 600 (MAJ)

Mise à jour du 16/04 : Nvidia vient d'officialiser l'offre ce mardi 16 avril. Les GeForce GTX 660 et supérieures sont donc concernées par ce nouveau bundle qui remplace le crédit de 110 dans des jeux Free-to-Play (certains commerçants pourront toutefois proposer les deux si ils leurs restent des codes). Les cartes GTX 650, 650 Ti et 650 Ti Boost conservent le crédit de 55 pour les jeux jeux Free-to-Play. Comme d'habitude il faudra veiller à ce que le commerçant propose l'offre Nvidia.

News du 13/04 : Après l'offensive d'AMD, qui vient d'être complétée par l'intégration de Far Cry 3 Blood Dragon, et une tentative dans le Free-to-Play qui n'a pas réellement convaincu, Nvidia se devait de réagir avec le retour d'un bundle jeu "AAA". Selon Techpowerup , ce titre sera le très prometteur Metro Last Light dont la sortie est prévue pour le 17 mai.

Ce nouveau bundle concernerait les GeForce GTX 660 et supérieures, sans que l'on ne sache si il viendra en complément du bundle Free-to-Play, si il le remplacera ou si les deux bundles coexisteront. Nvidia devrait officialiser cette offre dans le courant de la semaine prochaine, nous devrions donc en savoir plus d'ici quelques jours.

GTX Titan et WindForce 450W pour Gigabyte

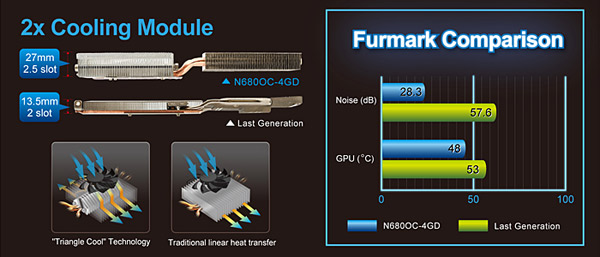

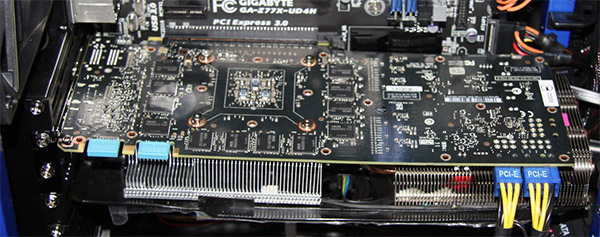

Gigabyte travaille sur une nouvelle GeForce GTX Titan utilisant un refroidissement de type WindForce 450W. Derrière cette dénomination se cache donc une version plus musclée du célèbre WindForce 3X, le WindForce 450W étant déjà utilisé sur la GV-N680OC-4GD :

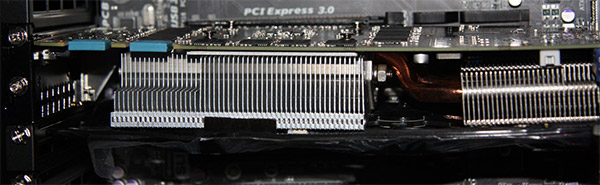

Le principe de base reste le même, à savoir un gros radiateur composé de groupes d'ailettes, la chaleur étant répartie via 3 gros caloducs qui sont en contact direct avec le GPU. Le tout est refroidi par 3 ventilateurs légèrement inclinés.

Le WindForce 450W se différencie du WindForce 3X par la taille du radiateur. Plus long, il dépasse légèrement du PCB de la GTX Titan alors que ça n'aurait pas été le cas du 3X, plus haut, il occupe 2.5 slots contre 2 pour le 3X. Au final la carte sera plus longue : 26,5 cm pour le refroidissement de référence, 27,5cm avec un WindForce 3X et 29,5cm avec un WindForce 450W. Il est du coup beaucoup plus lourd, la carte affiche une courbure importante voir inquiétante sur les photos. Sur la GV-N680OC-4GD, Gigabyte utilise un renfort métallique sur la partie supérieure de la carte qui devrait probablement être ré-utilisé sur la version définitive afin d'éviter ce problème.

Le refroidissement est annoncé comme bien plus efficace que celui de référence, avec par exemple une température GPU de 61°C à 28,4 dBA contre 82°C à 34,4 dBA sous Furmark. Sachant que les performances de la GeForce GTX Titan sont liées à la température, un meilleur refroidissement permettrait de maintenir plus facilement une fréquence Turbo Boost 2.0 supérieur, avec ou sans overclocking.

Nvidia 319.12 Beta et RandR 1.4 : Optimus débloqué

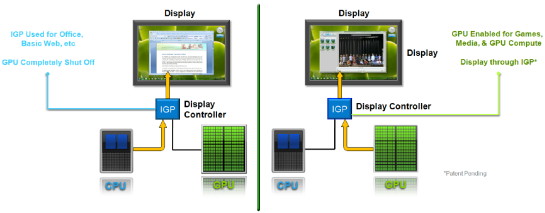

Lancée en février 2010, la technologie Optimus n'était à ce jour pas du tout supporté officiellement sous Linux par Nvidia ce qui bloquait généralement l'utilisation du GPU GeForce. Pour rappel, Optimus permet sur un portable sous Windows de faire appel de manière transparente à l'IGP ou à un GPU additionnel.

Lorsqu'une application dite lourde est utilisée, c'est le GPU qui prend en charge le rendu et qui transférera les images calculées via le PCI-Express à l'IGP qui reste en charge de l'affichage à proprement parler. A contrario lorsque l'application peut se contenter de l'IGP alors le GPU est en veille afin de ne pas consommer inutilement.

Le problème est qu'en l'absence de support logiciel d'Optimus il n'est alors généralement pas possible d'exploiter du tout le GPU additionnel, exception faite de quelques rares portables permettant de choisir dans le bios si c'est le GPU ou l'IGP qui doit être systématiquement utilisé, cela n'étant possible que si les deux sont reliés à l'écran du portable via une puce permettant de passer de l'un à l'autre.

Depuis 2011 toutefois un support non officiel est possible au travers du projet Bumblebee qui est désormais en version 3.1. Nvidia a finalement commencé à introduire un support d'une nouvelle fonction débloquant un peu la situation dans ses pilotes 319.12 Beta qui est détaillée ici . Au passage il faut noter que ces pilotes permettent désormais de créer des profils par application.

La version 1.4 de RandR ajoute en effet la possibilité pour pilotes graphiques de travailler de pair, de manière à ce que comme dans le cadre d'Optimus sous Windows une image calculée par le GPU Nvidia soit transmise pour l'affichage à un IGP. Nvidia précise qu'il n'y a par contre pas de synchronisation entre le GPU Nvidia et l'IGP, ce qui veut dire que l'image peut-être mise à jour par le GPU alors qu'elle est lue par l'IGP pour l'affichage, ce qui va entraîner du tearing comme quand on joue avec la synchronisation verticale désactivée (v-sync off).

De plus, si cette solution a pour mérite de permettre enfin d'utiliser de manière officielle le GPU Nvidia plutôt que de le laisser inutilisé dans un coin, elle ne permet a priori pas de passer de l'IGP au GPU en fonction des applications, ce que le pilote Nvidia fait automatiquement sous Windows et qu'il est possible de faire manuellement en modifiant le raccourci d'une application avec Bumblebee. On est donc loin d'avoir tous les avantages de la solution Optimus, la consommation devant de fait être supérieure mais c'est (enfin!) un début.

Test : Nvidia GeForce GTX 650 Ti Boost

Nous venons de mettre à jour le dossier consacré à la Radeon HD 7790 pour y intégrer le test de la GeForce GTX 650 Ti Boost 2 Go. Nous en avons profité pour ajouter BioShock Infinite au panel de test et mettre à jour les résultats sous Crysis 3, Far Cry 3 et Tomb Raider qui entre temps ont reçu un nouveau patch.

Notez que nous avons utilisé les pilotes 314.22 de Nvidia qui apportent des optimisations pour BioShock Infinite ainsi que pour Tomb Raider. Si des gains de 60% sont annoncés dans ce dernier cas par Nvidia, comme nous le supposions, ils concernent avant tout l'outil de bench intégré qui repose sur un rendu de type cinématique avec des propriétés quelque peu différentes des scènes de jeu classiques. Nous n'avons observé aucun gain dans notre scène de test.

Dossier : AMD Radeon HD 7790 et GeForce GTX 650 Ti Boost en test

GDC: Démo Nvidia: RealTime Dynamic Fracture

Après FaceWorks à la GTC, Nvidia présentait une nouvelle démo à l'occasion de la GDC, dans un registre différent puisqu'il s'agit de mettre en avant l'évolution de ses travaux au niveau de la destruction dynamique des environnements. Dénommée Real-Time Dynamic Fracture, la démonstration tourne à 30 fps sur une GTX 680 et se base probablement sur un prototype d'une future évolution de ses librairies PhysX dédiées à la simulation des corps solides.

La simulation n'est pas encore physiquement parfaite et Nvidia travaille à ajouter notamment la prise en compte de l'intégrité des structures pour leur permettre de s'effondrer sous leur propre poids lorsqu'elles sont endommagées.

Le niveau de détails, la possibilité d'une destruction complète, les poussières, rendent cependant la scène plutôt impressionnante et on ne peut qu'espérer pouvoir retrouver un jour ces possibilités dans un jeu. Pour cela, de nombreux défis se posent puisqu'il s'agit de permettre à des personnages, contrôlés au niveau du CPU, de se déplacer dans des structures dont la destruction est simulée sur le GPU.