Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxGDC: Nvidia met en avant son pilote Direct3D 11

GDC: DirectX 12: 'Mantle' standardisé en 2015

ASUS lance les Matrix R9 290X et GTX 780 Ti

Nouveaux bundles chez Nvidia

Support limité pour les GeForce 8/9/200/300

GDC: Mantle, Direct3D 12, l'uf et la poule

S'il y a bien un mot qui était tabou lors de toutes les sessions de la GDC consacrées à Direct3D 12, c'était Mantle. Microsoft, Nvidia et même AMD ont tout fait pour éviter de devoir mentionner cette autre API de bas niveau. Direct3D 12 est-il le résultat de la sortie de Mantle ? Voici ce qui nous semble être la meilleure actuelle théorie sur le sujet

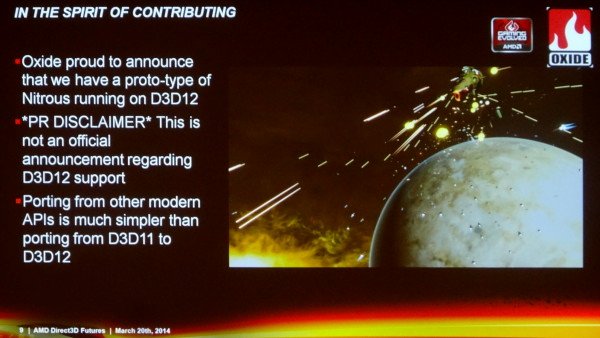

Durant la GDC, seul Oxide a osé un timide acte de rébellion en déclarant que "porter leur moteur depuis d'autres API modernes était plus simple que de porter de Direct3D 11 vers Direct3D 12". A chacune de ces sessions pourtant, la première question qui était posée était systématiquement la suivante : "comment se compare Direct3D 12 à Mantle ?". Eclats de rire assurés dans la salle mais aucune réponse en retour.

Nvidia, de son côté, explique travailler avec Microsoft sur DirectX 12 depuis plus de 4 ans et en collaboration rapprochée depuis un an. C'est sans aucun doute autant la réalité qu'un baratin énorme pour éviter d'admettre avoir été poussé dans cette direction par l'API Mantle d'AMD.

Microsoft travaille constamment avec ses partenaires au sujet de possibles évolutions de ses API. La machine ne s'arrête pas quand DirectX 11 sort, les discussions et autres phases de recherche continuent. Quand Nvidia indique travailler depuis plus de 4 ans avec Microsoft sur DirectX 12, cela veut simplement dire que Nvidia a poursuivi sa collaboration avec Microsoft au-delà de DirectX 11, comme tous les autres fabricants de GPU. Cela ne veut pas dire que Nvidia travaille depuis 4 ans sur le Direct3D 12 qui est présenté aujourd'hui.

Nous ne pensons pas que le fait que la démonstration de Microsoft d'un prototype de portage vers Direct3D 12 de Forza Motorsport ait été réalisée sur un GPU Nvidia, la GeForce GTX Titan Black, soit un élément significatif. Il est logique que Microsoft opte pour un GPU Nvidia pour mettre en avant l'aspect universel de sa solution. Une démonstration sur un GPU AMD aurait entraîné plus de liens vers Mantle et l'architecture d'AMD puisque le code de base de Forza Motorsport provient de la Xbox One équipée en GPU AMD.

Après de très nombreuses discussions avec tous les acteurs impliqués, à la GDC mais également auparavant, nous sommes convaincus que Mantle a été le déclencheur et l'accélérateur de la direction retenue pour Direct3D 12, quoi qu'en dise Nvidia. Cela ne veut pas dire que Direct3D 12 est un clone de Mantle, mais qu'il semble bel et bien avoir été bâti sur les mêmes bases ou tout du moins fortement tiré dans la même direction. Des bases qui impliquent de transférer une partie significative de la responsabilité des performances et des optimisations du pilote vers le moteur du jeu. Bien sûr, ce n'est pas un monde en noir et blanc, tout le pouvoir ne passe du pilote au moteur de jeu, les deux restent importants mais l'équilibre est modifié en faveur du second.

C'est selon nous la clé pour comprendre la position de chacun et la chronologie des évènements. Il ne faut pas être naïfs, AMD et Nvidia n'opèrent pas de virage important par pure conviction technologique, tous ces choix se font également avec une bonne dose de politique et de stratégie.

Pourquoi AMD a-t-il sorti Mantle ? Parce que Nvidia dispose de la meilleure équipe de développement des pilotes. Pourquoi Nvidia aurait-il été réticent jusqu'alors à faire évoluer Direct3D vers un niveau d'abstraction plus bas ? Parce que Nvidia dispose de la meilleure équipe de développement des pilotes.

Plus une API graphique est complexe, prend des chemins torturés et accuse un surcoût ou overhead élevé, plus les fabricants de GPU ont d'opportunités de se démarquer de la concurrence via leurs pilotes. Cela ne veut pas spécialement dire qu'AMD et Nvidia font ou ont fait volontairement en sorte de complexifier les API, mais que les simplifier et transférer une plus grosse part de la responsabilité de l'optimisation vers les développeurs pose des questions stratégiques importantes qui peuvent les inciter à trainer des pieds face à certaines évolutions.

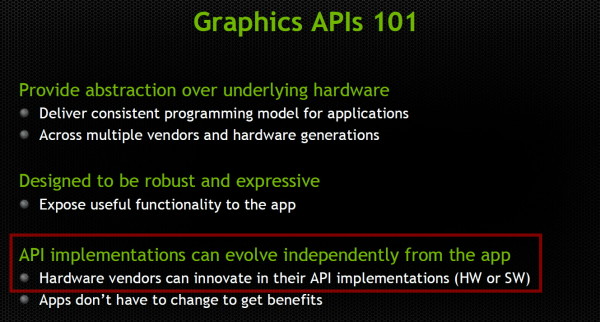

Les avantages d'une API de plus haut niveau, selon Nvidia.

Le travail important nécessaire pour obtenir des performances de premier plan, que ce soit globalement au niveau des pilotes ou spécifiquement au cas par cas pour chaque application, a permis à AMD et Nvidia de bénéficier de la sécurité d'un marché difficilement accessible à d'autres acteurs. Des sociétés telles que S3, Matrox, XGI etc. s'y sont cassé les dents, en partie pour cette raison. C'est également ce qui a permis à AMD et Nvidia de tenir Intel à l'écart.

Au cours de ses années les plus difficiles, AMD a dû se séparer de nombreux ingénieurs qui travaillaient sur ses pilotes alors même que Nvidia renforçait ses rangs. Même si AMD a récemment revu à la hausse ses investissements auprès du support des développeurs, il est évident que Nvidia dispose d'une force de frappe nettement plus importante sur le plan du développement des pilotes. AMD a probablement fini par prendre conscience du danger que cela pouvait représenter et revu sa stratégie en conséquence. Le réflexe qui pouvait être de trainer des pieds par rapport à un transfert de pouvoir des pilotes vers l'application n'avait plus lieu d'être. Au contraire, il a fini par devenir évident que pousser le marché dans cette direction serait utile pour la compétitivité de la société.

Pas facile cependant de convaincre tout le monde de bouger dans ce sens... Il nous semble évident que stratégiquement Nvidia n'avait au premier abord aucune raison d'abonder dans le sens d'AMD, et préférait opter pour d'autres approches de réduction du surcoût CPU, peut-être moins ambitieuses, qui lui auraient évité d'abandonner autant de contrôle sur les optimisations. Du côté de Microsoft il y avait probablement du pour et du contre, pas mal d'hésitation et d'avis contradictoires.

En développant et en concrétisant Mantle, avec le support de développeurs très enthousiastes, nous pouvons supposer qu'AMD a décidé de donner un coup de pied dans cette fourmilière. Le risque était limité. Dans le pire des cas, AMD pourrait bénéficier d'un mode spécifique dans quelques jeux, et dans le meilleur des cas, en profiter pour forcer la main des acteurs réticents de manière à pousser l'industrie dans une direction plus intéressante pour la société d'un point de vue compétitif.

De premiers résultats encourageants, l'engouement instantané de plusieurs développeurs pour les principes de Mantle (pas spécialement pour l'utilisation d'une API propriétaire !), la position délicate de la Xbox One, la menace de Steam OS, , tout cela a mis en place une atmosphère qui a permis à tout le monde d'accepter d'aller vers un changement plus radical que certains ne le voulaient au départ pour Direct3D 12. Au final, avec Mantle, AMD a pu influencer significativement Direct3D 12, en plus d'apporter un bonus dans quelques jeux pour les utilisateurs de Radeon, ce qui est toujours bienvenu sur le plan commercial.

Sur la base de la même réflexion, nous pouvons supposer qu'OpenGL ES va évoluer rapidement vers une version à overhead réduit, alors qu'il sera beaucoup plus lent et difficile de faire évoluer OpenGL dont l'importance dans le monde professionnel en fait un élément stratégique crucial. Un responsable du développement d'un des moteurs de jeux majeurs nous a d'ailleurs confirmé qu'un tel OpenGL ES était déjà sur la table.

Nous pouvons par contre supposer que Nvidia sera extrêmement prudent par rapport à une évolution d'OpenGL qui pourrait impacter son très rentable marché professionnel. Même si la tendance va de plus en plus vers une exploitation de toute la puissance des GPU, de nombreuses applications professionnelles liées à la 3D restent fortement limitées par le CPU et les performances du pilote. Une caractéristique qui, comme vous pourrez l'imaginer, fait bien les affaires de Nvidia.

GTC: Volta & Parker retardés, le 16nm TSMC responsable?

Les roadmaps présentées par Nvidia à la GTC ont semé pas mal de confusion en introduisant de nouveaux noms de codes, le GPU Pascal et le SoC Erista, à la place des anciens GPU Volta et SoC Parker. Nous avons pu confirmer avec Nvidia qu'en réalité les premiers, annoncés auparavant pour 2015, ont en fait été repoussés mais n'ont pas été annulés ou remplacés. Nvidia ne précise pas quelle est la raison de ce retard mais de nouvelles solutions ont dû être mises en place pour occuper le terrain et éviter que ses produits ne stagnent pendant trop longtemps.

Si Nvidia ne précise pas la raison de ce retard, un indice se trouve probablement dans les quelques informations communiquées l'an passé au sujet du SoC Parker. Nvidia parlait alors de l'utilisation d'un procédé de fabrication qui ferait appel aux FinFET, vraisemblablement le 16nm de TSMC. Nous pouvons supposer que c'était également le cas pour le GPU Volta.

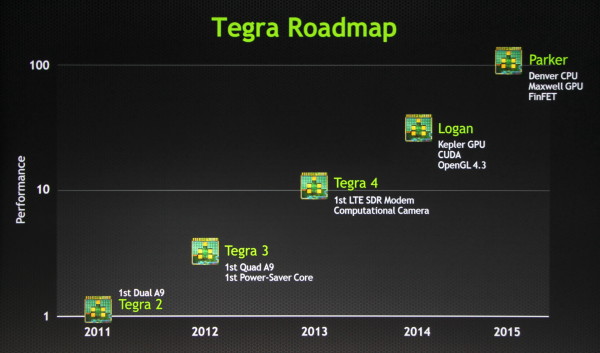

La roadmap des SoC Nvidia, version 2013.

Il semblerait donc que ce process 16nm FinFET ait posé problème, que ce soit en termes de timing, de volumes, de tarification et/ou de performances. Avec Pascal et Erista, Nvidia a dans tous les cas décidé d'introduire une génération intermédiaire en 20 nanomètres, ce qui explique ces changements sur les roadmaps.

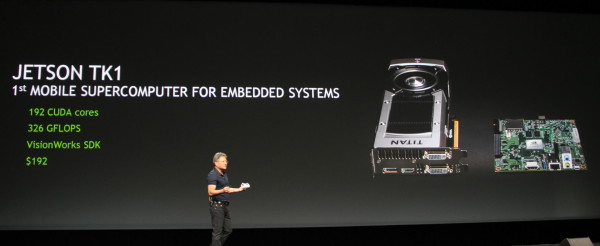

GTC: Tegra: Kit Jetson TK1, SoC Erista en 2015

L'intégration d'un GPU Kepler dans le SoC Tegra K1 lui permet de débarquer dans l'univers de CUDA et du calcul massivement parallèle. Avec la plateforme Kayla annoncée l'an passé, Nvidia avait clairement annoncé la couleur et son ambition d'amener CUDA dans le monde de l'embarqué.

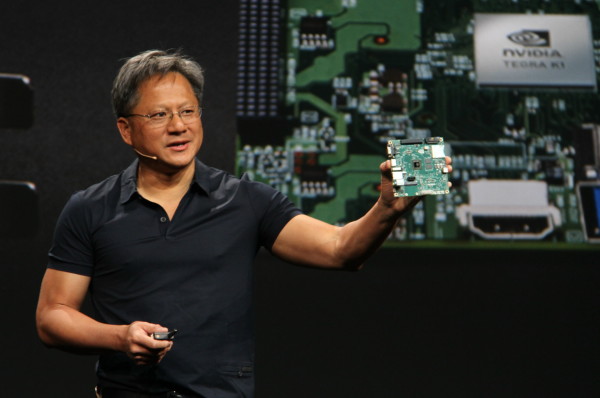

La version finale de cette initiative se nomme Jetson TK1 et correspond à un kit de développement articulé autour du SoC Tegra K1 et de son GPU qui propose 192 unités de calcul FMA 32-bit pour une puissance de calcul de 326 Gflops. Nvidia ne précise pas de quelle version du Tegra K1 il s'agit, mais nous pouvons supposer qu'il est question de la v1, qui repose sur des cores Cortex-A15, et que la v2 équipée de 2 cores Denver ARMv8 ne viendra que plus tard.

Cette plateforme intègre 2 Go de mémoire, de l'USB 3.0, du HDMI 1.4, du Gigabit Ethernet, de l'audio, du SATA, du mini-PCIe et un emplacement pour carte SD. Notez qu'en pratique un ventirad est placé sur le SoC, mais il était absent des photos officielles et de l'échantillon présenté lors de la keynote.

De quoi proposer un kit de développement relativement polyvalent et potentiellement ouvrir de nouvelles portes à Nvidia dans l'embarqué, principalement pour des solutions mobiles, compactes et/ou peu gourmandes. Ce kit Jetson K1 sera disponible sous peu (il est en précommande à partir de ce jour) à un tarif de 192$. En Europe, il sera distribué par Zotac, SECO et Avionic Design.

Comme d'habitude, le passage Tegra de la keynote principale de GTC a été l'occasion pour le CEO de Nvidia de présenter une roadmap mise à jour :

Nous n'apprendrons cependant que très peu de détails si ce n'est que le prochain SoC Tegra, qui succèdera au Tegra K1 (nom de code Logan), intégrera un GPU Maxwell, augmentera le rendement énergétique d'un peu plus de 50% et se prénommera Erista. Encore une fois il s'agit d'une référence aux superhéros de l'univers Marvel puisque Erista y représente le fils de Logan, alias Wolverine. A voir s'il disposera également de quelques pouvoirs

Tout comme pour le GPU Volta, le SoC Parker, annoncé l'an passé par Nvidia, a été repoussé et Erista est une solution intermédiaire. Parker était pour rappel prévu pour 2015 avec un GPU Maxwell, des cores Denver et l'exploitation d'un procédé de fabrication à base de FinFET. Nous ne savons pas à l'heure actuelle quelle est la différence entre ce le projet Parker et ce nouveau projet Erista.

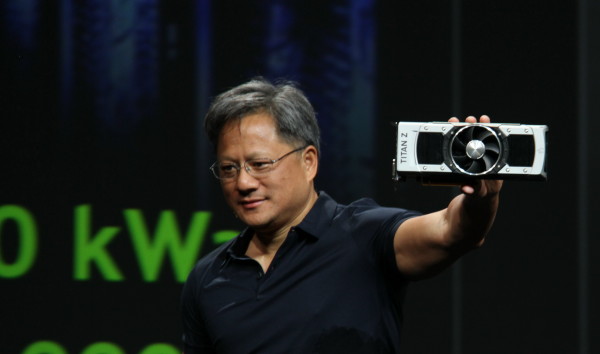

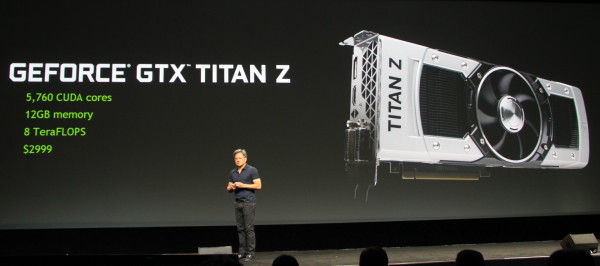

GTC: GeForce GTX Titan Z, 3000$, bi-GK110 en avril

Nvidia profite de la GTC pour annoncer la GeForce GTX Titan Z. Le fabricant explique avoir été surpris par le succès des GeForce GTX Titan et GTX Titan Black, malgré leur tarif de 1000$ / 1000, autant auprès des joueurs (fortunés) qu'auprès des amateurs de GPU computing qui ont besoin d'un maximum de puissance de calcul mais ne désirent pas investir dans des cartes Quadro ou Tesla. Dans ce cas, les GeForce GTX Titan s'intercalent ainsi assez bien entre les GeForce classiques et les cartes professionnelles.

Nvidia retente l'expérience avec la GeForce GTX Titan Z qui reprend le principe des cartes GTX Titan précédentes mais passe au bi-GPU. Elle est équipée de 2 GPU GK110 totalement fonctionnels pour un total de 5760 unités de calcul FMA 32-bit et 1920 unités de calcul FMA 64-bit. De quoi atteindre une puissance de calcul de 8 Tflops en simple précision. Chaque GPU dispose de sa propre mémoire de 6 Go interfacée en 384-bit et le système de refroidissement reprend le design haut de gamme cher à la marque. Il a cependant été quelque peu musclé pour l'occasion et semble passer de 2 à 2.5 slots d'épaisseur.

Par rapport à une GeForce GTX 690 en bi-GK104 (300W), le TDP a vraisemblablement dû être revu à la hausse mais Nvidia ne donne pas de précision à ce sujet. 350W ? 400W ? Nous ne devrions pas tarder à en savoir plus puisque la disponibilité est annoncée pour début avril avec un tarif de 3000$ ! Il s'agit d'un nouveau record pour une carte non-issue d'une gamme professionnelle et nous sommes curieux de savoir si cette GeForce GTX Titan Z pourra réellement trouver son public, aussi réduit soit-il...

GTC: Nvidia annonce Pascal: NVLink, stacked DRAM, 2016

Le forum technologique GTC de Nvidia commence fort avec l'annonce du successeur de Maxwell. Prénommé Pascal et prévu pour 2016, ce GPU intégrera une nouvelle technologie d'interconnexion, NVLink, ainsi que le support de la mémoire 3D.

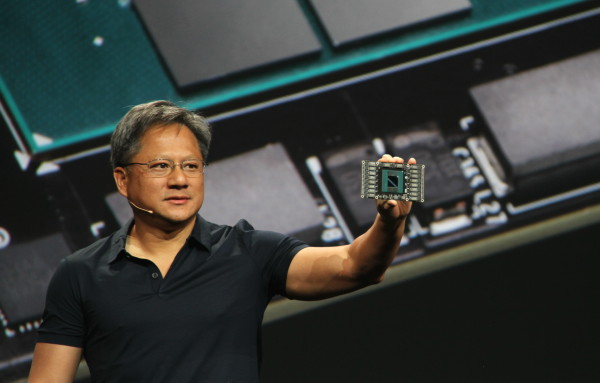

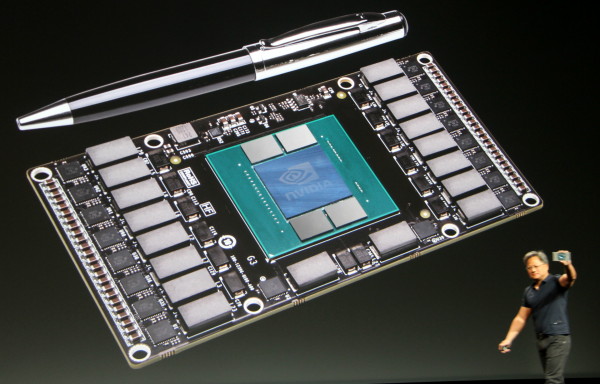

Jen Hsun Huang, le CEO de Nvidia présente le premier prototype du GPU Pascal.

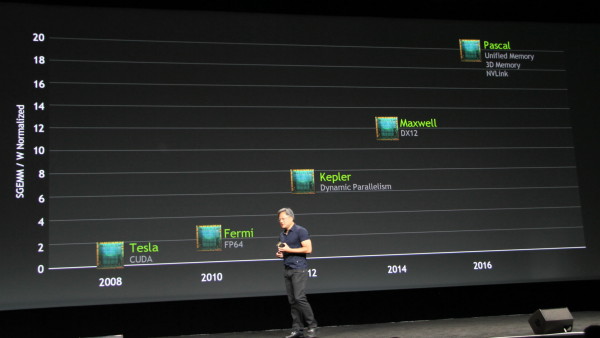

L'an passé, Nvidia nous avait présenté une roadmap qui mettait en avant l'arrivée des GPU Maxwell en 2014, nous y sommes, ainsi que des GPU Volta en 2016. Pour Maxwell, Nvidia mentionnait alors le support de la mémoire unifiée et pour Volta de la mémoire 3D ou stacked DRAM, qui consiste à empiler plusieurs puces mémoire pour former un module dont la bande passante va exploser.

A noter que dans ces présentations, le nom de l'architecture ou de la génération représente toujours le plus gros GPU de la famille. La nouvelle roadmap de Nvidia est quelque peu différente :

DirectX 12 est rentré dans l'air du temps et dorénavant mis en avant comme le point de communication principal pour la génération Maxwell. Etrangement la mémoire unifiée passe vers la génération suivante qui change de nom. Exit Alessandro Volta, bonjour Blaise Pascal. La génération Volta a en réalité été repoussée et une génération intermédiaire introduite. Avec Pascal, Nvidia entend s'attaquer aux goulets d'étranglements des GPU actuels, au moins sur 2 fronts.

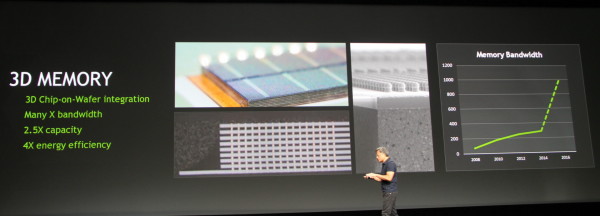

Tout comme cela était mis en avant pour Volta, Pascal bénéficie du DRAM stacking pour faire exploser la bande passante de sa mémoire locale. Nvidia précise avoir recours à la technique "3D chip-on-wafer integration" et estimer pouvoir atteindre une bande passante de 1 To par seconde en 2016. La quantité de mémoire pourra également progresser significativement, il est question de 2.5x plus de mémoire qu'aujourd'hui, soit probablement 10 Go dans le cas des GeForce et près de 30 Go dans le cas des cartes professionnelles. Tout ceci se ferait avec une progression de 4x de l'efficacité énergétique liée à la mémoire et à son interface.

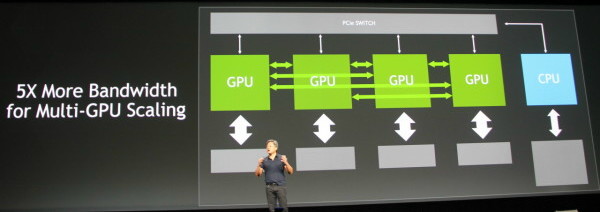

L'autre point sur lequel Nvidia travaille pour Pascal est l'interconnexion. Le bus PCI Express représente une limitation importante au niveau de la communication avec le CPU et entre GPU. Dans le cas d'une utilisation grand public, ce n'est pas un problème, mais cela peut le devenir dans d'autres situations liées au GPU computing.

Pour contourner ce problème et avoir le contrôle de sa propre interconnexion, Nvidia a mis au point NVLink. Il s'agit d'un bus de communication dont les protocoles sont annoncés similaires à ceux du PCI Express, prévus pour la mémoire unifiée et la cohérence des caches dès la génération 2.0, probablement pour le successeur de Pascal. NVLink pourra offrir 5 à 12X la bande passante du PCI Express, probablement avec une latence réduite. Dans un sens, NVLink peut être vu commme une version musclée et plus flexible du lien SLI.

NVLink pourra être implémenté pour la communication entre GPU, le schéma de Nvidia indique qu'au moins 4 GPU pourront ainsi disposer d'une connexion directe. Il sera également possible d'utiliser NVLink pour offrir au GPU un accès plus performant au CPU. Nvidia précise d'ailleurs avoir collaboré avec IBM lors du développement du NVLink et que ce dernier sera implémenté dans de futurs CPU POWER. Nous pouvons également raisonnablement estimer que Nvidia proposera ce support sur ses futurs SoC/CPU dérivés de ses propres cores ARMv8 Denver. Il est par contre improbable qu'Intel propose un jour une connexion NVLink sur ses Xeon.

Pour terminer, Nvidia indique déjà disposer dans ses labos des premiers prototypes de Pascal. Une plateforme relativement compacte dont nous ne savons cependant pas si elle est réellement fonctionnelle. Nous pouvons y apercevoir 4 modules de stacked DRAM et Nvidia précise que cette carte Pascal lui permet de travailler sur NVLink. Sur la face avant du PCB, aucune interconnexion n'est cependant visible, celle-ci étant probablement au dos. Rien ne dit cependant que c'est ce format qui sera retenu pour la version commerciale de Pascal.

La guerre s'annonce rude entre Pascal et les futurs Xeon Phi !