Les contenus liés au tag Nvidia

Afficher sous forme de : Titre | FluxGTX 960 4 Go chez Inno3D et EVGA

GDC: Nvidia GRID bientôt finalisé et payant

GDC: Nvidia annonce une console Shield pour Android TV

GPU, 71% pour Intel et 76% pour Nvidia

GTX 900M et OC : Nvidia fait machine arrière

GDC: D3D12: Une guerre des specs en vue ?

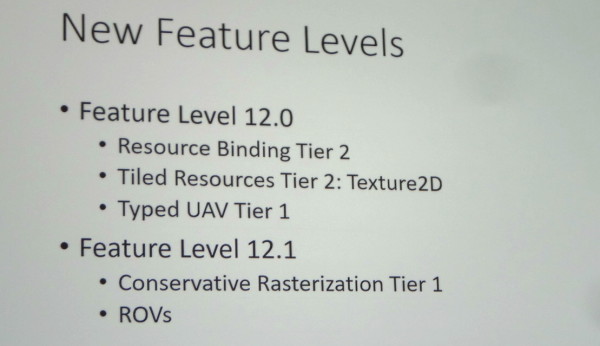

Comme nous l'expliquions il y a peu, Microsoft a dévoilé à la GDC les 2 nouveaux niveaux de fonctionnalités de Direct3D 12 : 12_0 et 12_1. Mais d'autres segmentations plus subtiles existent, de quoi nous laisser penser que les départements communications d'AMD et de Nvidia pourraient se battre à coups de niveaux de support de DirectX 12.

De toute évidence, Microsoft avait demandé à AMD et Nvidia de ne pas lancer de polémique à la GDC sur le niveau de support des spécifications de Direct3D 12 de leurs GPU. Il n'y a ainsi eu aucune communication officielle à ce sujet mais nous avons pu gratter quelques détails lors de discussions informelles ou en posant des questions à la fin des différentes sessions.

Tout d'abord, nous pouvons confirmer que les GeForce Maxwell de seconde génération (GTX Titan X, 980, 970 et 960) supportent bien le niveau de fonctionnalité le plus élevé : 12_1. Il a de toute évidence été modelé d'après les spécifications de l'architecture de Nvidia. Nous ne savons par contre toujours pas s'il existe des GPU actuellement commercialisés de niveau 12_0.

Cela ne veut pas dire pour autant que les dernières GeForce GTX supportent la totalité des possibilités de Direct3D 12. Ainsi, en plus des niveaux de fonctionnalités, des niveaux de support appelés Tiers existent pour différents points.

Le principal concerne les capacités de gestion des différentes ressources (Resource Binding) qui augmente en passant du Tier 1 au Tier 2 et atteint un niveau presqu'illimité au Tier 3. Microsoft a précisé que sur base des dernières statistiques de Steam, et en ne prenant en compte que le matériel compatible avec Direct3D 12, 39% du parc installé est limité au Tier 1, 44% au Tier 2 et 17% supporte le Tier 3. Mais quel GPU supporte quel Tier ?

Selon nos informations, les GPU Maxwell sont en fait limités au Tier 2, qui est nécessaire au support des niveaux 12_0 et 12_1 et qui a probablement lui aussi été modelé autour de leurs capacités. Une des différences les plus importantes avec le Tier 3 concerne la gestion des Constant Buffer Views (CBV) : ceux-ci ne sont pas virtualisés et sont limités en nombre à 14. Il est probable que l'architecture Maxwell soit capable de virtualiser les CBV, mais que l'implémentation logicielle/matérielle de Nvidia profite d'un mode plus performant avec une gestion "fixe" des Constant Buffers. Un compromis qui limite quelque peu la flexibilité accordée aux développeurs pour s'assurer que les GPU GeForce restent dans un mode optimal sur le plan des performances.

Mais alors à qui correspond les 17% de GPU compatibles Tier 3 ? Toujours selon nos informations, il s'agit des Radeon de type GCN qui profitent d'une architecture très flexible à ce niveau. D'un côté les GeForce GTX 900 supportent le niveau 12_1, d'un autre les Radeon R9 200 supportent le Resource Binding Tier 3. Un combat de spécifications en perspective ? Difficile pour AMD d'attaquer les GTX 900 sur base de cela pour l'instant mais cela risque de changer avec Fiji. Si ce futur GPU supporte le niveau 12_1 et le Tier 3, nul doute que vous en entendrez parler ! Si par contre Fiji est limité au niveau 12_0 et Tier 3, chacun devra préparer ses arguments.

Au final, voici comment le support des Resource Binding Tiers est de toute évidence réparti sur PC :

Tier 1 : Nvidia Fermi, Intel Haswell et Broadwell

Tier 2 : Nvidia Kepler et Maxwell 1/2

Tier 3 : AMD GCN

A noter que pour les fonctionnalités spécifiques au niveau 12_1, les Raster Ordered Views et la Conservative Rasterization, il existe également des Tiers 1 et 2 dont les spécificités nous sont pour l'heure inconnues. L'implémentation de Nvidia se limiterait au Tier 1 et il pourrait être possible là aussi pour AMD d'essayer de se démarquer. Affaire à suivre.

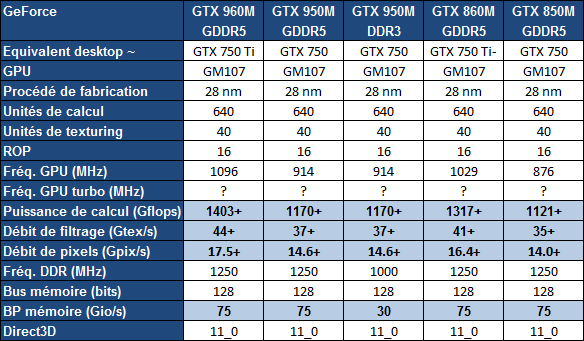

Les GeForce 800M renommées en 900M

Nvidia vient de lancer discrètement de nouvelles cartes graphiques mobiles, les GeForce GTX 960M/950M et 940M/930/920M. Une discrétion typique de produits qui correspondent plus à des renommages qu'à de réelles nouveautés.

Tout juste une année après l'introduction des GeForce 800M, une partie de celles-ci transitent vers la famille GeForce 900M. Il s'agit des modèles d'entrée et de milieu de gamme basés sur les GPU Maxwell de première génération. Une stratégie commerciale classique à laquelle nous nous attendions depuis l'annonce des GeForce GTX 980M/970M/965M, basées autour d'un GPU Maxwell de seconde génération.

Rappelons que les différences principales entre les deux générations Maxwell consistent en des techniques de compressions plus évoluées, des fonctionnalités supplémentaires pour DirectX 12, le support de l'antialiasing MFAA et du HDMI 2.0. Un dernier point qui est cependant peu utile dans le monde mobile puisque les sorties vidéos sont en général pilotées par le core graphique intégré Intel. Par ailleurs, certains GPU Maxwell de seconde génération supportent le décodage H.265, ce qui n'est pas le cas de ces petites GeForce 900M.

A noter que si nous nous attendions à ces renommages, nous imaginions par contre qu'il y aurait un glissement vers le bas dans la numérotation (860M -> 950M), de manière à faire de la place pour des dérivés mobiles du GM206 (GTX 960 desktop), qui sur le papier a tout d'un GPU très intéressant pour ce marché. Mais ce n'est pas le cas, Nvidia a choisi de ne pas l'exploiter pour l'instant.

Dans le milieu de gamme, les GTX 860M et 850M sont renommées en GTX 960M et 950M en profitant d'une petite hausse de leur fréquence GPU : +6.5% pour la première et +4.3% pour la seconde. A noter que les fréquences turbo ne sont pas précisées et nous ne savons pas si elles augmentent dans les mêmes proportions.

Malheureusement, en plus de ce renommage, Nvidia a eu une très mauvaise idée : lancer une variante de la GTX 950M pour laquelle la GDDR5 est remplacée par de la DDR3. De quoi brider fortement le GPU en divisant la bande passante par 2.5x (voir plus, Nvidia parle de DDR3 1 GHz mais en pratique elle sera probablement cadencée à 900 MHz). Inutile de dire que le but est de permettre aux fabricants de portables de commercialiser de la "GeForce GTX 900M" à pas cher et ainsi de tromper les joueurs mal informés sur le niveau de performances réel. Si le fabricant de portable ne précise pas le type de mémoire utilisée, notre recommandation est, comme vous vous en doutez, de ne pas faire confiance à la GeForce GTX 950M.

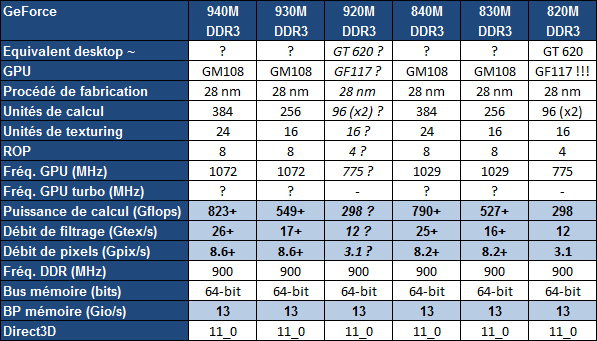

Dans l'entrée de gamme, les détails publiés par Nvidia sur les fiches produits sont plutôt maigres. Les spécifications font place à un indice de performances, calculé par rapport à l'Intel HD 4400. Une approche qui pourrait être intéressante si elle était complémentaire aux spécifications mais qui en l'état est plutôt boiteuse puisqu'elle laisse par exemple penser que la GeForce 940M (4.0X) est inférieure à la 840M (5.0X). En réalité ce n'est pas le cas mais Nvidia calcule son indice différemment pour les solutions plus récentes. Autrement dit, il est difficile de faire une différence entre cet indice et un chiffre tiré du chapeau d'un commercial.

D'après nos informations il s'agirait ici aussi d'un simple renommage des GeForce 840M/830M en 940M/930M avec petites hausse des fréquences GPU : +4%.

Nous n'avons obtenu aucune information sur la GeForce 920M. Sur sa page produit, Nvidia mentionne l'architecture Maxwell mais affiche la même image du GPU que pour la 820M, équipée d'un vieux GPU, non pas de génération Kepler mais encore plus ancien : le GF117 Fermi. Nous présumons donc que la GeForce 920M est similaire et n'a pas plus d'intérêt qu'une éventuelle licence pour coller un logo GeForce sur un portable d'entrée de gamme.

Les GTX 960 4 Go débarquent en nombre

Après Inno3D et EVGA, ASUS, Gainward, Gigabyte, MSI et Zotac ont également lancés des GeForce GTX 960 équipées de 4 Go de VRAM en GDDR5 128-bits 7 Gbps. Avec un surcoût de l'ordre 40 par rapport aux versions 2 Go, ces GTX 960 4 Go seront donc à plus de 250 et n'auront pas vraiment d'intérêt.

Chez ASUS la STRIX-GTX960-DC2OC-4GD5 devrait être disponible en avril. Le GPU est à 1291/1317 MHz contre 1127/1178 MHz pour les fréquences de référence, soit la même vitesse que sur la version 2 Go. Le design est également identique et on retrouve un ventirad qui bien qu'alléchant sur le papier pour un tel GPU ne nous a pas convaincu en pratique du fait de la position des caloducs sur le GM206.

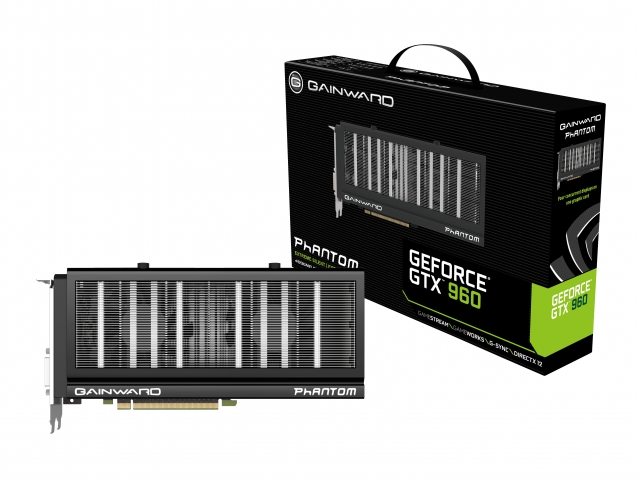

Côté Gainward la GTX 960 Phantom 4 Go reprend le design habituel des Phantom qui a pour défaut de prendre 2.5 slots, côté fréquence on est aux fréquences de référence alors que le modèle 2 Go était au-dessus avec 1203/1266 MHz.

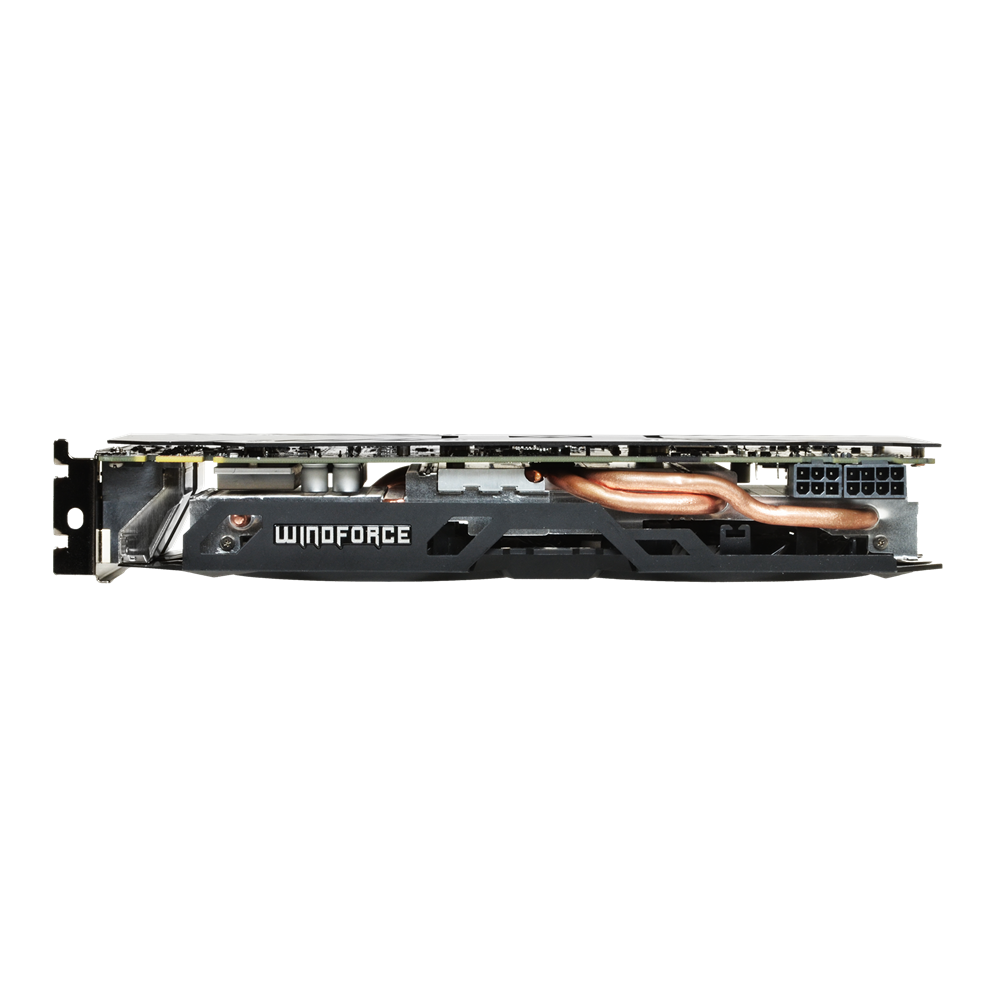

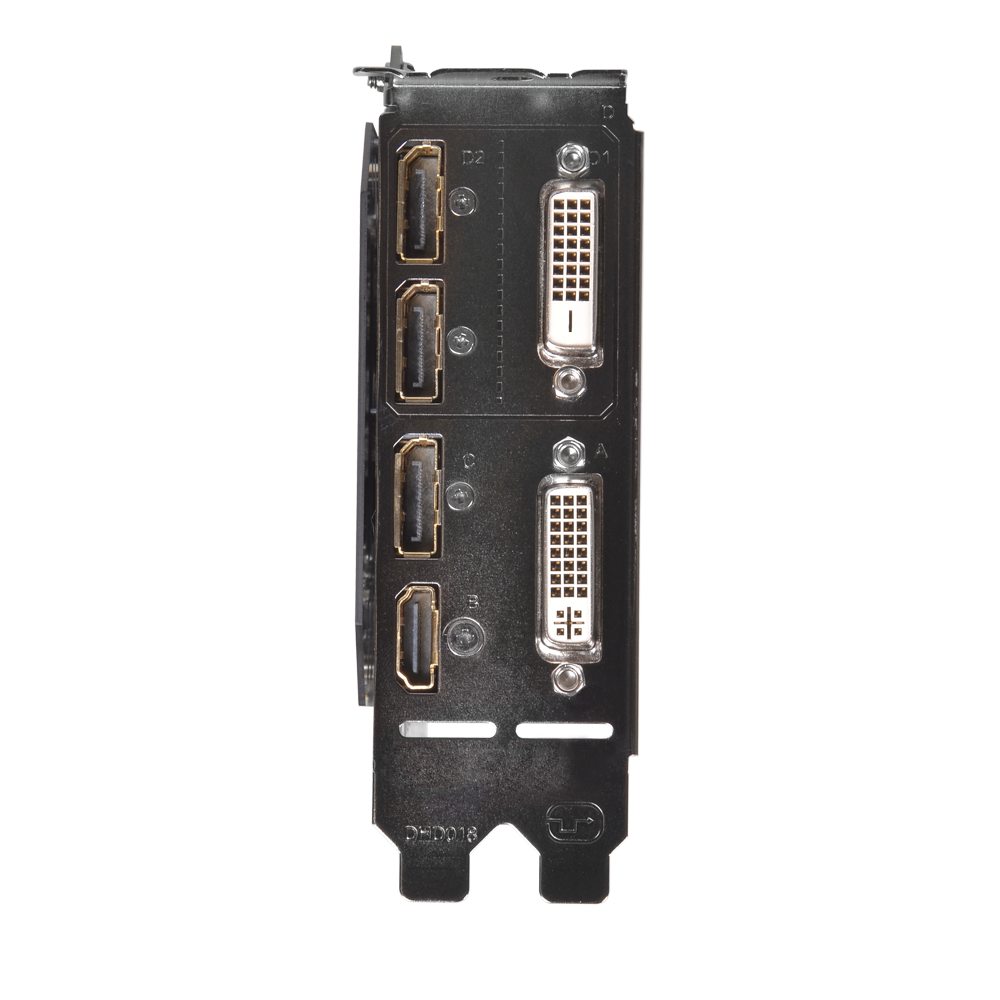

Gigabyte propose pour sa part 2 cartes, les GV-N960WF2OC-4GD et GV-N960G1 GAMING-4GD qui sont quasi identiques aux versions 2 Go et utilisent respectivement des designs à 2 et 3 ventilateurs, ce dernier étant un peu excessif pour un GM206. Sur la première carte le GPU est à 1216/1279 MHz par défaut et Gigabyte a ajouté par rapport à la version 2 Go un mode OC à 1241/1304 MHz. Sur la seconde on est à 1241/1304 MHz par défaut et 1266/1329 MHz en mode OC.

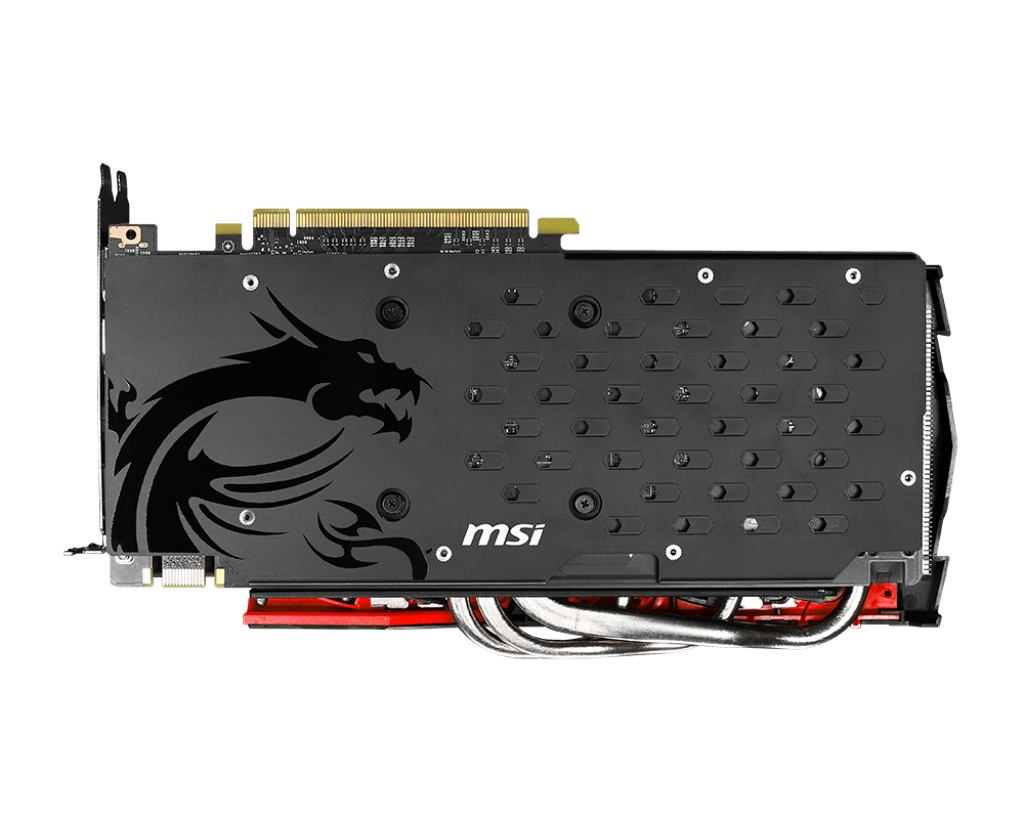

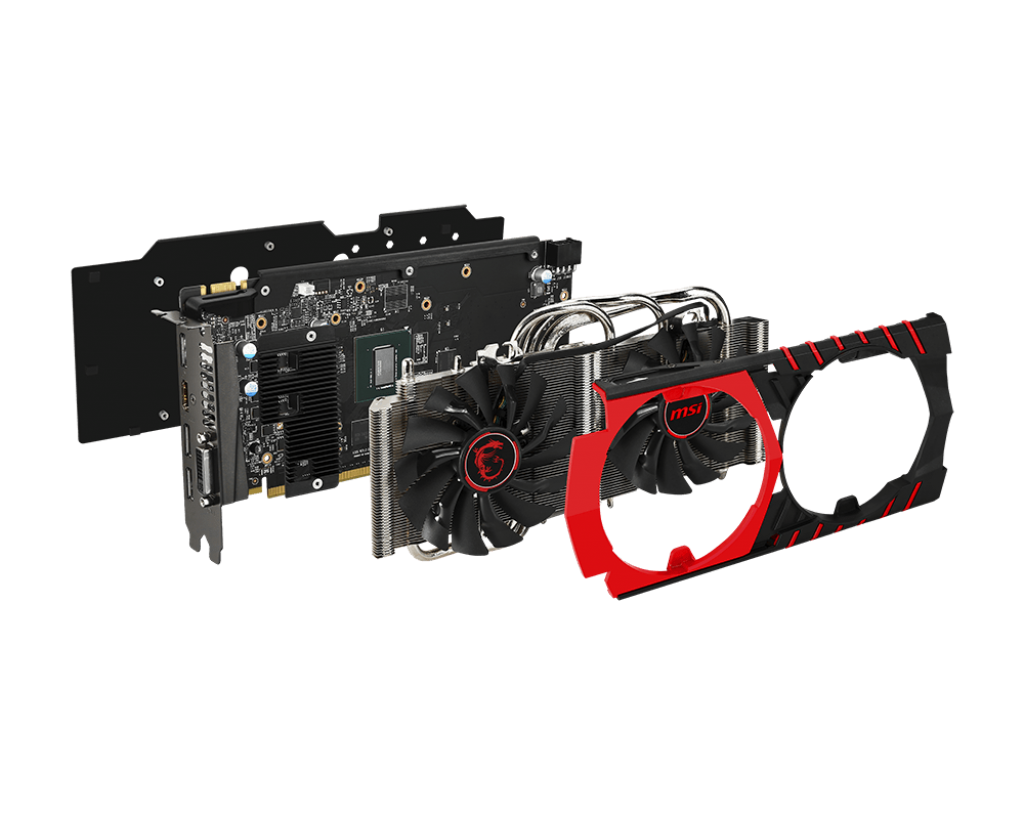

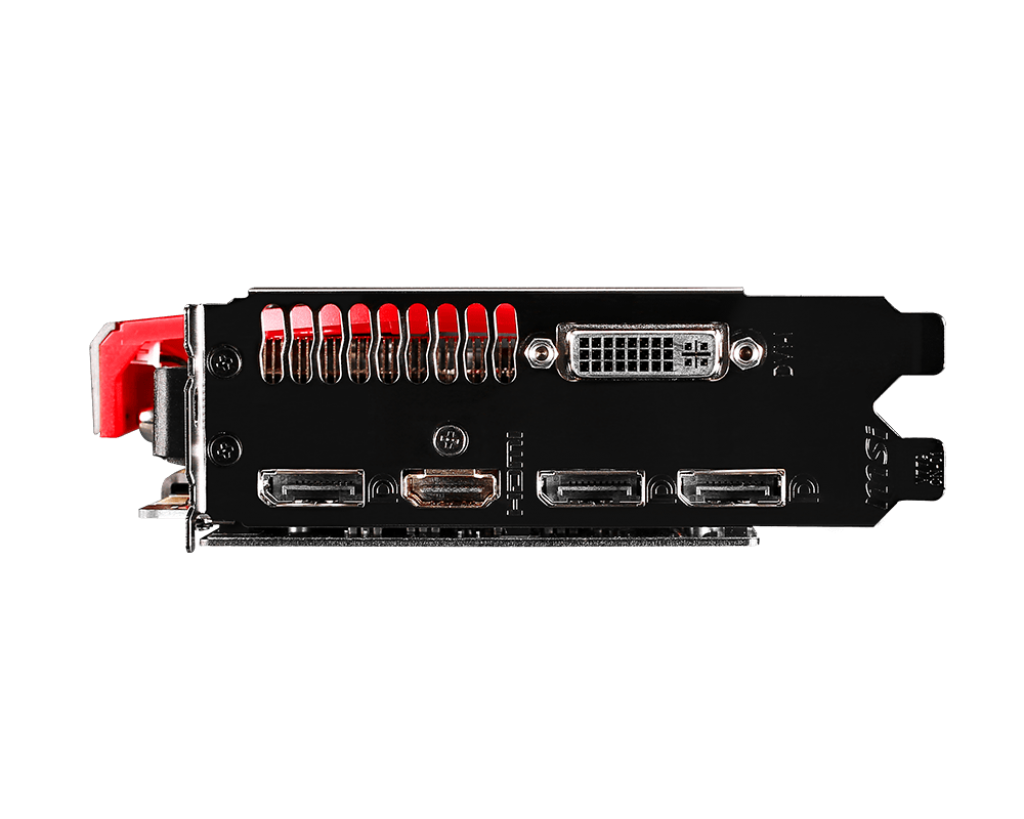

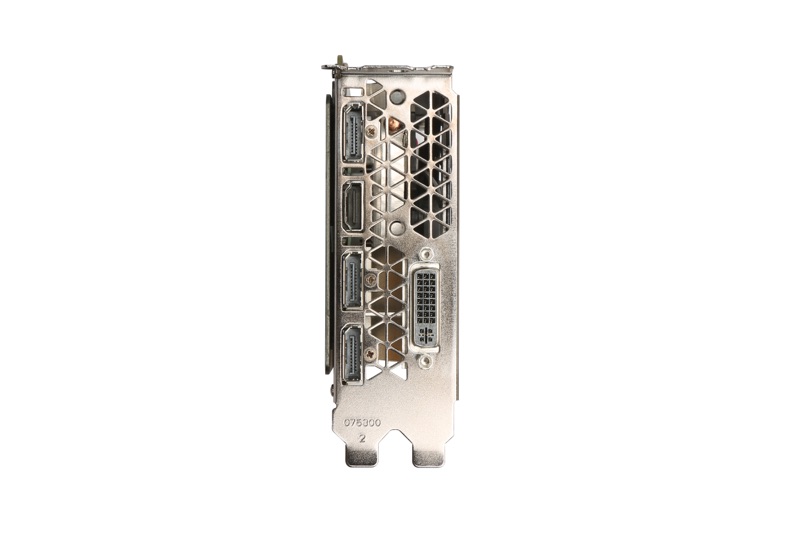

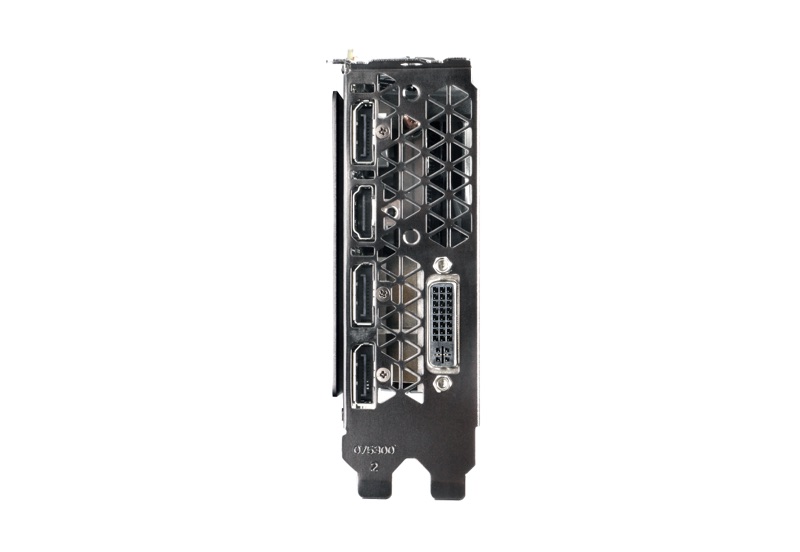

La GTX 960 Gaming 4G de MSI utilise des fréquences GPU par défaut de 1190/1253 MHz en mode Gaming (par défaut), mais il est possible en un click via l'application Gaming App de passer à 1127/1178 MHz (mode Silent) ou 1241/1304 MHz (mode OC). Par rapport à la version 2 Go le mode OC gagne 2% (25 MHz). Autre changement, la 4 Go dispose d'une backplate.

Enfin Zotac décline la GTX 960 sur deux cartes en version 4 Go, la GTX 960 (ZT-90308-10M) et la GTX 960 AMP! Edition (ZT-90309-10M). Dans le premier cas on a droit à deux ventilateurs 80mm et un GPU à 1177/1240 MHz, dans le second à deux ventilateurs 90mm et un GPU à 1266/1329 MHz.

The Witcher 3 offert avec les dernières GTX

Nvidia lance un nouveau bundle pour ces derniers GPU. C'est cette fois The Witcher 3 : Wild Hunt, dont la sortie est prévue pour le 19 mai prochain, qui est offert pour l'achat d'une GeForce GTX 960, 970, 980 ainsi que d'un portable en GTX 970M ou 980M (pas pour les 965M donc). Ce jeu utilise certaines technologies de NVIDIA GameWorks tel que HBAO+, HairWorks et PhysX.

Comme d'habitude vous recevrez de la part d'un revendeur partenaire mettant en avant l'offre un code qui vous permettra d'obtenir auprès de Nvidia de quoi télécharger le jeu sur GOG.com. En cas de vente en ligne ce code est généralement envoyé par courriel après expiration du délai de rétractation.

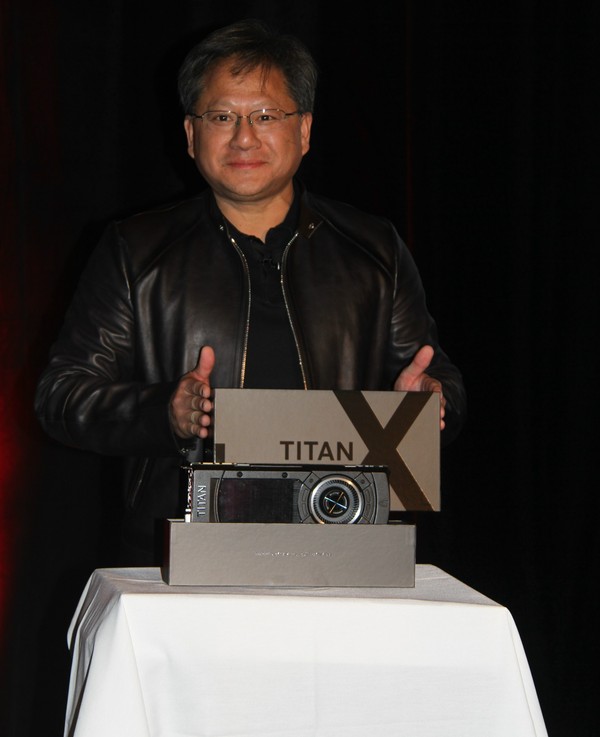

GDC: Nvidia dévoile la GTX Titan X 12 Go

Petite surprise ce matin à la GDC. Lors d'une session d'Epic dans laquelle Tim Sweeney revenait sur les récents développements autour de l'Unreal Engine et demandait des GPU plus performants pour permettre à la VR de prendre son envol, le CEO de Nvidia, Jen-Hsun Huang, a fait une apparition furtive pour y dévoiler une nouvelle GeForce ultra haut de gamme, la Titan X.

Ce n'est pas un secret, depuis quelques temps, un gros GPU Maxwell est attendu chez Nvidia, probablement dénommé GM200. Les détails exacts le concernant resteront encore confidentiels quelques jours. Tout au plus Jen-Hsun Huang aura précisé que le GPU embarque pas moins de 8 milliards de transistors, ce qui en fait un nouveau record, et que la GeForce GTX Titan X dispose de 12 Go de mémoire vidéo, ce qui pointe vers l'utilisation d'un bus 384-bit, un classique sur les gros GPU Nvidia.

La carte en elle-même reprend le design maintenant devenu habituel pour les GeForce haut de gamme même s'il y aura probablement quelques petites améliorations au niveau du bloc de refroidissement. Changement de style par contre puisque la couleur de la coque passe au noir.

Avec la GTX Titan X, Nvidia entend bien asseoir sa domination sur la concurrence mais il faut évidemment s'attendre à un tarif d'au moins 1000.

Si Jen-Hsun n'a pas donné de date de lancement exacte, au vu de son discours, il semble évident qu'il aura lieu durant la GPU Technology Conference qui ouvrira ses portes le 17 mars, soit dans 2 petites semaines. En attendant, Tim Sweeney pourra profiter du premier exemplaire qui lui a été remis et dédicacé par le CEO de Nvidia.