Les contenus liés aux tags Nvidia et AMD

Afficher sous forme de : Titre | FluxPilotes AMD et Nvidia pour Far Cry 4

Pilotes AMD et Nvidia pour AC Unity

Focus: Perfs avec 2, 4, 6 et 8 curs : 4 jeux à la loupe

MAJ du focus sur l'impact des pilotes en 'CPU limited'

Focus: Performances CPU : Catalyst 14.7 RC3 vs GeForce 340.52

GDC: D3D12: Une guerre des specs en vue ?

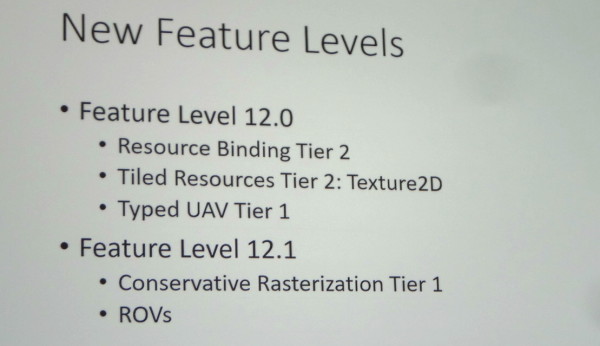

Comme nous l'expliquions il y a peu, Microsoft a dévoilé à la GDC les 2 nouveaux niveaux de fonctionnalités de Direct3D 12 : 12_0 et 12_1. Mais d'autres segmentations plus subtiles existent, de quoi nous laisser penser que les départements communications d'AMD et de Nvidia pourraient se battre à coups de niveaux de support de DirectX 12.

De toute évidence, Microsoft avait demandé à AMD et Nvidia de ne pas lancer de polémique à la GDC sur le niveau de support des spécifications de Direct3D 12 de leurs GPU. Il n'y a ainsi eu aucune communication officielle à ce sujet mais nous avons pu gratter quelques détails lors de discussions informelles ou en posant des questions à la fin des différentes sessions.

Tout d'abord, nous pouvons confirmer que les GeForce Maxwell de seconde génération (GTX Titan X, 980, 970 et 960) supportent bien le niveau de fonctionnalité le plus élevé : 12_1. Il a de toute évidence été modelé d'après les spécifications de l'architecture de Nvidia. Nous ne savons par contre toujours pas s'il existe des GPU actuellement commercialisés de niveau 12_0.

Cela ne veut pas dire pour autant que les dernières GeForce GTX supportent la totalité des possibilités de Direct3D 12. Ainsi, en plus des niveaux de fonctionnalités, des niveaux de support appelés Tiers existent pour différents points.

Le principal concerne les capacités de gestion des différentes ressources (Resource Binding) qui augmente en passant du Tier 1 au Tier 2 et atteint un niveau presqu'illimité au Tier 3. Microsoft a précisé que sur base des dernières statistiques de Steam, et en ne prenant en compte que le matériel compatible avec Direct3D 12, 39% du parc installé est limité au Tier 1, 44% au Tier 2 et 17% supporte le Tier 3. Mais quel GPU supporte quel Tier ?

Selon nos informations, les GPU Maxwell sont en fait limités au Tier 2, qui est nécessaire au support des niveaux 12_0 et 12_1 et qui a probablement lui aussi été modelé autour de leurs capacités. Une des différences les plus importantes avec le Tier 3 concerne la gestion des Constant Buffer Views (CBV) : ceux-ci ne sont pas virtualisés et sont limités en nombre à 14. Il est probable que l'architecture Maxwell soit capable de virtualiser les CBV, mais que l'implémentation logicielle/matérielle de Nvidia profite d'un mode plus performant avec une gestion "fixe" des Constant Buffers. Un compromis qui limite quelque peu la flexibilité accordée aux développeurs pour s'assurer que les GPU GeForce restent dans un mode optimal sur le plan des performances.

Mais alors à qui correspond les 17% de GPU compatibles Tier 3 ? Toujours selon nos informations, il s'agit des Radeon de type GCN qui profitent d'une architecture très flexible à ce niveau. D'un côté les GeForce GTX 900 supportent le niveau 12_1, d'un autre les Radeon R9 200 supportent le Resource Binding Tier 3. Un combat de spécifications en perspective ? Difficile pour AMD d'attaquer les GTX 900 sur base de cela pour l'instant mais cela risque de changer avec Fiji. Si ce futur GPU supporte le niveau 12_1 et le Tier 3, nul doute que vous en entendrez parler ! Si par contre Fiji est limité au niveau 12_0 et Tier 3, chacun devra préparer ses arguments.

Au final, voici comment le support des Resource Binding Tiers est de toute évidence réparti sur PC :

Tier 1 : Nvidia Fermi, Intel Haswell et Broadwell

Tier 2 : Nvidia Kepler et Maxwell 1/2

Tier 3 : AMD GCN

A noter que pour les fonctionnalités spécifiques au niveau 12_1, les Raster Ordered Views et la Conservative Rasterization, il existe également des Tiers 1 et 2 dont les spécificités nous sont pour l'heure inconnues. L'implémentation de Nvidia se limiterait au Tier 1 et il pourrait être possible là aussi pour AMD d'essayer de se démarquer. Affaire à suivre.

GPU, 71% pour Intel et 76% pour Nvidia

John Peddie Research a publié son analyse pour le marché graphique PC au quatrième trimestre 2014 et donne comme à son habitude une partie des éléments sur son site . Généralement ce trimestre est relativement stable par rapport au troisième, cette fois JPR note une baisse de 3,4% au global, plus précisément 2,7% sur les PC fixe et 3,9% sur les portables.

C'est Intel qui domine au global du fait des GPU intégrés à ses processeurs, même si ils ne sont pas toujours utilisés en pratique, avec 71,4% du marché. C'est un peu moins bien qu'au trimestre précédent (71,8%) mais la hausse est notable par rapport à l'an passé (66,8%). Nvidia occupe désormais la seconde place avec 15% du marché, un chiffre en hausse par rapport au trimestre précédent (14,1%) mais en baisse sur un an (15,7%). AMD rétrograde à la troisième place avec 13,6%, contre 14,1% il y a trois mois et 17,3% il y a un an.

Par rapport au trimestre précédent, en volume les ventes d'Intel et d'AMD baissent respectivement de 4 et 7% alors que celles de Nvidia augmentent de 2,9%. AMD souffrirait particulièrement d'une baisse de 30% des APU sur PC fixe, alors que celles sur portable sont en hausse de 4,6%. Les GPU additionnels seraient en baissent de 16% sur fixe et 16,6% sur portable. A contrario Nvidia aurait vu ses ventes augmenter de 5,5% sur les GPU pour PC fixe, contre un petit +0,1% sur portable. Sur les cartes graphiques, AMD ne serait plus qu'à 24% de parts de marché contre 76% à Nvidia.

JPR a également dévoilé au passage deux graphiques sur l'évolution historique du marché, le premier montre l'évolution depuis 1981 des ventes de PC fixes et portables ainsi que des GPU et iGPU pour PC fixes et portables. Le second écarte les GPU intégrés pour se concentrer sur les ventes de carte graphiques additionnelles comparées à celles du nombre de PC fixe depuis 2001. JPR en déduit un % de PC vendu avec carte graphique qui est passé de 70 à 80% en début de période à moins de 40% désormais, un chiffre qu'il faut encore minorer puisqu'un même PC peut très bien accueillir plusieurs cartes graphiques au cours de son existence, en même temps ou non.

Coil Whine et SAV, qu'en disent les fabricants ?

Le coil whine, vous en avez probablement déjà entendu parler, voire l'avez entendu tout court, peut dans certains cas être désagréable. Créé par des micro-vibrations au niveau des bobines qui se chargent de filtrer le courant au sein des circuits d'alimentations de nos machines, ce sifflement qui vire parfois au grésillement se fait de plus en plus entendre à mesure que nos PC gagnent en discrétion.

Tous les composants peuvent être impactés à divers degrés, de nombreux utilisateurs se sont par exemple plaints de ce phénomène avec des alimentations fanless ou avec un ventilateur à l'arrêt à faible charge. Les moniteurs peuvent également être touchés, et nous l'avons même rencontré sur des composants pour le moins inattendus tels que des SSD !

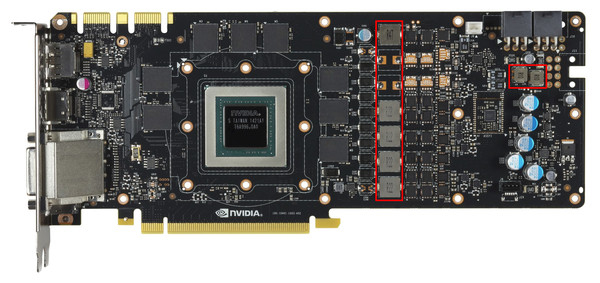

En rouge, les bobines des circuits d'alimentation GPU et GDDR5

Mais c'est surtout sur les cartes graphiques que le coil whine fait parler de lui. En soit il n'est pas nouveau, il se faisait déjà entendre sur certaines GeForce GTX 600 et Radeon HD 7900 par exemple, et même parfois avant, mais ces derniers temps il semble prendre de l'ampleur notamment du côté des GTX 900. De notre côté nous en avions particulièrement fait mention lors du test de la Radeon HD 7990, et en avons rencontré à des degrés divers dans notre test de 3 GeForce GTX 960. Bien sûr, le fait que les cartes graphiques soient de plus en plus discrètes en charge fait que la ventilation couvre moins le coil whine produit par les bobines, néanmoins on ne peut pas exclure que de mauvais choix de design ou de composant des étages d'alimentations l'amplifie. Le coil whine étant par nature aléatoire d'une carte à l'autre, il est difficile d'avoir une idée précise du phénomène.

Toujours est-il qu'il peut devenir gênant à l'usage, puisque audible même PC fermé. Plus les variations de charge sont rapides au niveau du GPU, plus le coil whine sera fort, c'est pourquoi de nombreux utilisateurs le remarquent particulièrement avec la synchronisation verticale désactivée dans certains menus de jeux qui entraînent des cadences de centaines ou milliers d'images par seconde. La synchronisation verticale ou le limiteur de fps (comme celui intégré dans Afterburner ) sont souvent appelés à la rescousse et réduisent le sifflement du fait d'une réduction des variations dans ces cas extrêmes ainsi que de la charge sur l'étage d'alimentation dans les jeux. Il ne s'agit pas pour autant d'une solution ultime, puisqu'au-delà d'un framerate élevé les variations de charge pour le calcul d'une même image ont un impact et qu'elles ont tendance à augmenter avec la complexification des moteurs 3D.

Que faire pour éviter de subir un coil whine gênant boitier fermé même avec une charge "classique" ? Le premier réflexe à avoir, c'est bien entendu de passer au crible cet aspect lors de la réception de la carte. On peut par exemple le faire sous Unigine Valley Benchmark , un benchmark gratuit qui offre une charge réaliste mais lourde avec un moteur 3D moderne. Attention nous parlons bien ici du coil whine durant la partie 3D, et pas dans l'écran de crédit quand on quitte l'application qui tourne à plusieurs milliers de fps : rares sont les cartes à être épargnées dans ce cas de figure, il semble plus opportun d'utiliser un limiteur de fps si vous ne souhaitez pas jouer avec la V-Sync pour ce cas. Mais si le coil whine est gênant en 3D, on peut alors utiliser son délai de rétractation dans le cadre d'une vente par correspondance. Si on n'est pas ou plus dans ce cadre, il faut alors faire face au service après-vente du magasin ou du constructeur qui ne sont pas forcément toujours réceptif à ce problème.

Nous avons questionné les quatre fabricants écoulant le plus de cartes graphiques en France afin de leur demander si ils acceptaient les SAV pour coil whine, et si oui dans quelles étaient les conditions requises. Voici leurs réponses :

ASUS est le premier à nous avoir répondu. Le coil whine est pris en charge pour peu qu'il soit "prononcé".Ces réponses pour le moins disparates montrent bien le problème que pose le coil whine aux constructeurs et aux services après vente. Reste qu'au-delà de ces positions il ne faut pas oublier que quelle que soit la politique de garantie du constructeur, votre vendeur doit vous garantir contre les défauts de conformité du produit. Vous êtes à ce titre couvert pour les cas important de coil whine, une carte graphique annoncée comme silencieuse comme c'est de plus en plus le cas ne l'étant plus si elle souffre d'un coil whine marqué en jeu. Bien entendu, et nous nous répétons, le plus simple reste encore de vérifier ce point durant le délai de rétractation en cas de vente par correspondance et de se rétracter si nécessaire.

MSI nous a ensuite indiqué ne pas prendre en charge ce cas de figure, tout en précisant faire le maximum pour réduire ce phénomène qui impacterai tous les constructeurs.

Pour sa part, Sapphire nous a répondu ne pas avoir de position officielle sur le coil whine. Il nous a été précisé qu'une majorité de ses revendeurs et grossistes ont pris l'option du rachat de garantie, c'est-à-dire qu'ils obtiennent une remise forfaitaire pour gérer directement le SAV sans repasser par Sapphire. Quand ce n'est pas le cas nous n'avons pas pu obtenir plus de précisions.

Enfin Gigabyte n'a toujours pas répondu après 13 jours et une relance. Mais c'est pour bientôt, parait-il.

Aussi complexe soit-il, le coil whine est un problème réel sur lequel tous les constructeurs de cartes et bien entendu de GPU se doivent de travailler, d'autant plus qu'ils essaient de nous vendre des produits silencieux. Le bruit ne vient pas que des ventilateurs ! Ce n'est qu'en leur mettant la pression, directement ou indirectement par les revendeurs, que ce qui semble être une tendance vers plus de coil whine sera inversée. De notre côté nous continuerons bien entendu à pointer du doigt les cartes passant entre nos mains qui en souffriront, mais malheureusement le côté aléatoire d'une carte à l'autre fait qu'on ne peut pas exclure un tri du constructeur en cas d'échantillonnage par celui-ci.

DirectX 12 : Benchmarks et exclusivité Windows 10

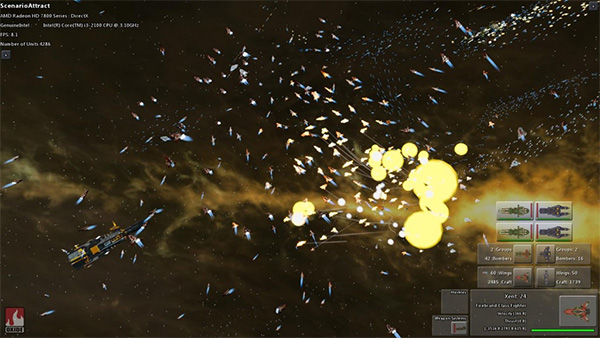

AnandTech a publié un article consacré à DirectX 12 se concentrant principalement sur des benchmarks obtenus sous Windows 10 Technical Preview 2 sous une version Direct3D 12 de Star Swarm Stress Test fournie par Oxide et Microsoft. Ce nom ne devrait pas vous être inconnu puisque cette démo dispose d'une version Mantle utilisée par AMD pour démontrer les bienfaits de son API à son lancement, mais elle a aussi déjà été utilisée en août dernier en version DX12 par Intel et Microsoft pour montrer les avantages du futur Direct3D.

Avant de passer aux résultats, nos confrères ont eu la confirmation par Microsoft que DirectX 12 ne sera disponible que sous Windows 10. Sachant que la mise à jour sera gratuite si effectuée durant la première année du lancement, cette annonce n'est pas problématique. Pour supporter DirectX 12, Windows 10 intègre la version 2 du WDDM. Côté GPU AMD et Nvidia disposent bien sûr de pilotes beta WDDM 2.0 et DX12, ce sont les versions 394.56 et 15.200 qui ont été fournies à nos confrères. A l'heure actuelle les pilotes AMD supportent les GPU GCN 1.0, 1.1 et 1.2, mais pour le moment Star Swarm Stress affiche des bugs de texture sur GCN 1.0. Côté Nvidia le support des Kepler et Maxwell est fonctionnel, mais les Fermi ne sont pas encore gérés.

Côté benchmark c'est donc sans grande surprise que les résultats obtenus sont très bons dans ce test très lourd en termes de draw calls. Ainsi une GeForce GTX 980 passe de 26,7 fps en D3D11 à 66,8 fps en D3D12, alors qu'une Radeon R9 290X est à 8,3 fps en D3D11, 42,9 fps en D3D12 et 45,6 fps sous Mantle. On note ici un avantage à Mantle sur ce test effectué avec 4 curs et confirmé avec 6 curs, mais avec 2 curs seulement c'est D3D12 qui reprend l'avantage avec 42,9 fps au lieu de 37,6 fps. Ces écarts sont en partie liés à un temps de traitement des lots de commande plus important sous Mantle du fait d'une optimisation du moteur effectuant une seconde passe côté CPU pour les optimiser, ce qui permet d'alléger la charge GPU au dépend de la charge CPU. Une fois celle-ci désactivée le temps de traitement des lots de commande est équivalent entre les deux API, par contre D3D12 repasse devant puisque sur 4 coeurs Mantle passe à 39,3 fps.

Pour rappel, pour contrer l'offensive Mantle, Nvidia a optimisé tant que possible les performances des commandes D3D11 via des optimisations génériques mais aussi spécifiques à certaines applications dont Star Warm. C'est ce qui explique que la version D3D11 soit 3,2 fois plus rapide sur GTX 980 que sur R9 290X, alors qu'AMD a orienté ses ressources sur Mantle qui reste 71% plus rapide. En Direct3D 12, l'avantage du dernier GPU Nvidia est probablement lié à des performances supérieures dans le traitement de la géométrie et/ou des commandes dans ce cas extrême.

DirectX 12 est donc toujours sur la bonne voie pour tenir les promesses d'une API bas niveau en termes d'allègement et de meilleure répartition entre les curs CPU de la charge liée aux commandes de rendu. Des bons résultats qui ont déjà été démontrés par AMD avec l'API Mantle qui a heureusement enfin fait bouger les lignes. Microsoft a encore beaucoup de choses à dévoiler sur DirectX 12, ce qui devrait se faire à l'occasion de la GDC 2015 en mars on pense notamment au nouveau niveau de fonctionnalité 11_3 ou 12_0. Reste qu'au-delà de l'API et des démos technologiques, il faudra bien sûr voir ce que les développeurs de jeux en feront !

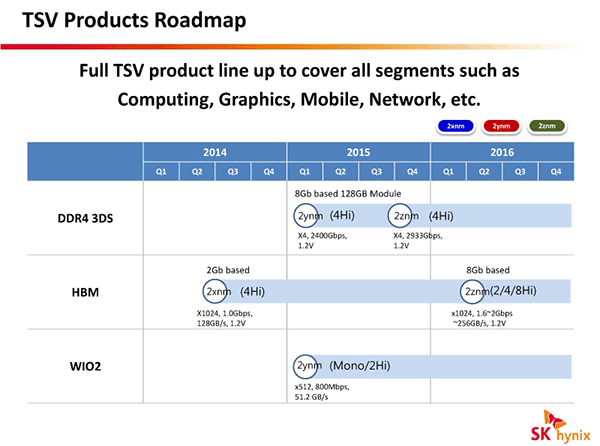

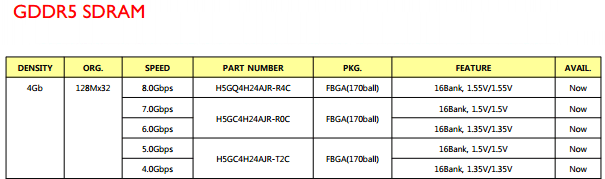

GDDR5 8 Gbps et HBM 128 Go /s chez Hynix

Dans son dernier catalogue destiné aux mémoires pour les puces graphiques, SK Hynix introduit une nouvelle GDDR5 à 8 Gbps soit 2000 MHz. La puce H5GQ4H24AJR-R4C est disponible en version 512 Mo et 32 bits, et offre seule une bande passante de 32 Go /s. Interfacée en 256 bits elle permet d'atteindre une bande passante de 256 Go /s contre 224 Go /s pour la GDDR5 7 Gbps qui prend place dans les GTX 970/980 par exemple.

Bien entendu une autre possibilité pour augmenter la bande passante mémoire disponible pour un GPU est d'augmenter la taille du bus, comme le fait AMD sur les R9 290/290X qui combinent de la mémoire à 5 Gbps et un bus 512 bits pour atteindre 320 Go /s.

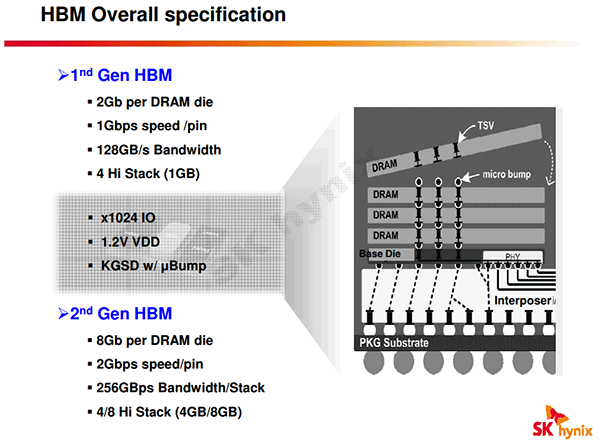

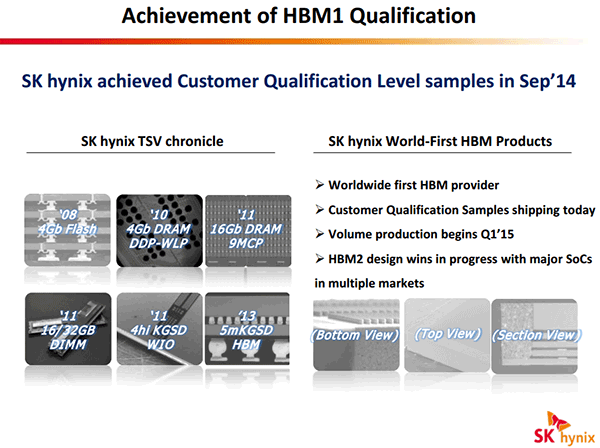

On note également la présence de mémoire HBM (High Bandwith Memory), avec cette fois une puce de... 128 Mo seulement (1 Gbits) ! A l'instar de la mémoire HMC (Hybrid Memory Cube), ce type de mémoire est composé d'un die logique de contrôleurs mémoire avec de multiples dies de mémoire, ici 4, le tout étant relié les uns aux autres par des TSV (Through Silicon Vias). Cette mémoire fonctionne a seulement 1 Gbps mais avec un bus 1024 bits, ce qui lui permet d'atteindre une bande passante pour une seule puce de 128 Go /s, 4 fois plus que la GDDR5 la plus rapide donc.

Si certains voient dans l'arrivée de la HBM au catalogue d'Hynix les prémices d'une association de la HBM avec des GPU AMD dès le 1er trimestre 2015, il faut temporiser ces ardeurs. Premièrement, la mémoire HBM n'est en fait pas nouvelle dans le catalogue Hynix, elle était déjà présente au troisième trimestre .

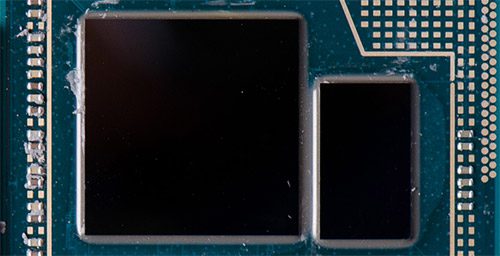

De plus, si AMD a effectivement collaboré avec SK Hynix au développement de la HBM, une puce de 128 Mo n'est pas assez dense pour être utilisée sur des GPU qui ont besoin de beaucoup plus de mémoire - il est plus qu'improbable d'avoir 16 à 32 puces HBM 1024 bits intégrées sur le packaging GPU ou sur le PCB ! Nvidia a déjà fait une présentation de sa génération de GPU Pascal prévue pour 2016 qui utilisera un type de mémoire proche, on pouvait voir 4 puces intégrées sur le packaging du GPU ce qui fait déjà un bus 4096-bit.

Toutefois la capacité annoncée pour cette puce HBM est en fait très étrange, SK Hynix a probablement fait une typo d'autant que la présence d'un "8G" dans la désignation fait penser à une capacité de 1 Go / 8 Gbits. C'est d'ailleurs de la HBM de 1 Go (4 die de 2 Gbits), atteignant également une bande passante de 128 Go /s avec un bus 1024 bits, qui a été qualifiée en septembre 2014 auprès des clients de SK Hynix, avec une production en volume devant débuter au cours du premier trimestre 2015 - on est donc loin de la disponibilité "Now" indiquée dans les catalogues des deux derniers trimestres. Courant 2016, une nouvelle génération de HBM doublera les débits alors que la capacité passera à 4 voir 8 Go (4 ou 8 die de 8 Gbits), mais on ne sait pas encore comment les fabricants de GPU utiliseront ces deux générations de HBM... est-ce qu'ils attendrons comme Nvidia le fait la seconde ou alors est-ce que AMD sautera le pas dès la première en 2015 ? L'avenir nous le dira !

Reste que si la puce de 128 Mo HBM qui est au catalogue de SK Hynix existe, elle sera pour sa part plutôt utile sur des APU en tant que cache externe, comme le fait déjà Intel sur les Haswell GT3e / Iris Pro 5200 qui intègrent sur leur packaging une puce d'eDRAM maison de 128 Mo interfacée en 512 bits et offrant une bande passante de 50 Go /s dans chaque sens, ce qui permet un gain de performance net vu la faible bande passante de la mémoire centrale (25,6 Go /s en DDR3-1600 sur deux canaux).