Les contenus liés au tag GPGPU

Afficher sous forme de : Titre | FluxPremier Centre d'Excellence CUDA

OpenCL: prochain standard GPGPU?

FireStream: le RV770 vient d'être lancé

Nvidia détaille sa stratégie

Dossier: Nvidia CUDA : plus en pratique

Dossier : Nvidia Fermi : la révolution du GPU Computing

Nvidia profite de sa GPU Technology Conference pour lever le coin du voile sur la partie computing de sa future architecture, Fermi, qui s'annonce très prometteuse dans ce domaine !

[+] Lire la suite

Computex : serveur Tesla chez Supermicro

Annoncé par Nvidia juste avant louverture du Computex, nous avons pu observer le nouveau serveur de Supermicro plus en détail. Celui-ci, au format 1U, est capable daccueillir deux cartes Tesla, 2 CPUs et 3 disques durs. Il sagit donc bien dun serveur complet contrairement au serveur Tesla S1070 qui ne contient que les accélérateurs et doit donc être connecté à un serveur maître.

Dans sa configuration par défaut, le serveur repose sur une plateforme bi-Xeon 5500 (Nehalem) et 2 accélérateurs Tesla M1060. Elle peut prendre en charge jusquà 48 Go de mémoire en plus des 8 Go présents au total sur les 2 cartes Tesla. Supermicro nous a précisé quil était possible dutiliser une plateforme différente, soit en mono-CPU, soit en Xeon de la génération précédente, soit en Opteron. Il est également possible dutiliser des cartes Tesla C1060 à la place des M1060, la différence étant leur format. Les premières sont des cartes classiques, équipées dun ventilateur alors que les secondes ne disposent que dun gros radiateur à travers lequel doit passer un flux dair suffisant, ce qui est le cas sur ce serveur.

Supermicro nous a indiqué une disponibilité prévue pour dans 2 semaines en précisant que sa commercialisation était prioritaire pour la société compte tenu des nombreuses commandes déjà enregistrées, ce qui témoigne bien de lintérêt porté à ces accélérateurs massivement parallèles. Il sagit également dun produit très important pour Nvidia qui dispose maintenant dun acteur reconnu dans le milieu des serveurs pour mettre en avant Tesla.

Quant au prix de ce serveur, dans sa configuration de base, il faudra compter entre 8 et 12.000 euros selon les marges que prendront les distributeurs. Enfin notez que Supermicro prépare un second serveur Tesla, au format 4U et qui pourra cette fois accueillir 4 cartes Tesla.

Computex : Nvidia mise sur GPU Computing

Le fabricant de GPUs a tenu une première conférence, avant l'ouverture officielle du Computex, qui était principalement tournée sur le GPU Computing.

Nvidia a pu annoncer l'arrivée chez SuperMicro d'un serveur équipé d'une plateforme Intel et d'accélérateurs Tesla offrant 2 teraflops en occupant seulement 1U. Les solutions proposées par Nvidia tiennent également dans 1U mais n'embarquent que les GPUs et doivent donc être liée à un serveur maître. La solution de SuperMicro présente donc un intérêt important même si nous n'en connaissons pas encore les spécifications exactes. Tout au juste pouvons nous déduire des 2 teraflops qu'elle sera équipée du côté GPU de 2 GT200b.

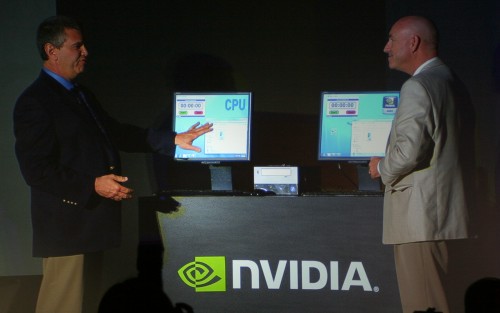

Jen-Hsun Huang, President & CEO, Nvidia.

Du côté grand public, Nvidia s'est félicité du nombre croissant d'applications capables de tirer partie du GPU en tant que coprocesseur parallèle tout en précisant que ce n'était qu'un début puisque l'arrivée de DirectX 11 et de Windows 7 devrait accélérer la tendance. Le premier permettra d'exploiter les GPUs (y compris les versions actuelles !) d'une manière standardisée à travers les Compute Shaders. Le second, en plus d'inclure DirectX 11 à sa base, intégrera un transcodeur capable d'exploiter les GPUs, à travers les Compute Shaders, pour accélérer la conversion des vidéos.

Microsoft et Nvidia mettent en avant la prise en charge native du GPU dans Windows 7 pour accélérer le transcodage vidéo.

Grâce à CUDA, Nvidia a pris une nette avance sur la concurrence du côté du GPU Computing puisque le fabricant est prêt depuis longtemps du côté logiciel. Si à l'avenir tous les composants devraient être supportés, dans l'immédiat, l'avance prise du côté logiciel permet aux GeForce de profiter de la primeur de ces accélérations dans quelques applications principalement dédiées au traitement des vidéos. Il en va de même avec PhysX qui offre aux GeForce le premier support matériel pour la physique d'effets.

Pour appuyer sa vision Nvidia a cependant recours à des artifices grossiers dont la société use et abuse et qui finissent par transformer un sujet intéressant en caricature de communication. Par exemple pour convaincre la presse que le GPU en tant que coprocesseur est l'avenir du PC, l'argument de Jen-Hsun Huang, CEO de Nvidia, est de dire que tout le monde affirme que c'est le cas. Sous-entendu « vous la presse devez écrire la même chose pour ne pas avoir l'air ridicule ». Autre exemple, quand Nvidia nous fait la démonstration d'un jeu avec effets physiques accélérés par le GPU, le volume sonore est réduit de moitié lorsque ces effets sont désactivés, pour accentuer la sensation de perte d'immersion.

Mais ce qui nous ennuie le plus, c'est la simplification qui consiste à présenter un élément d'une unité de calcul vectorielle des GeForce comme étant un core. Une simplification qui devient de plus en plus tordue à mesure que les GPUs et les CPUs s'affrontent. Si la rhétorique de Nvidia est acceptée, alors un CPU quadcore devrait être vu comme composé d'au moins 16 cores compte tenu de ses unités vectorielles. Tout le monde crierait alors au ridicule et à raison. Nvidia est cependant coincé puisqu'après avoir utilisé à la base de son marketing les cores de cette manière il est difficile de revenir en arrière. Comment dire maintenant que le GT200 est en fait composé de 10 voire 30 cores et non pas de 240 ?

Dossier : OpenCL : le GPU Computing enfin démocratisé ?

6 mois après son annonce, l'API OpenCL a été ratifiée. Destinée au calcul massivement parallèle elle offre une alternative ouverte aux langages propriétaires tels que CUDA. De quoi résoudre le problème de portabilité ?

[+] Lire la suite

Dossier : Nvidia CUDA : l'heure de la concrétisation ?

1 an après notre dernier article consacré à CUDA, nous avons décidé de faire le point à l'occasion de l'arrivée de nouvelles cartes Tesla. L'occasion également de revenir sur l'architecture du GT200.

[+] Lire la suite