Reportage : IDF Automne 2007

Publié le 28/09/2007 par Damien Triolet

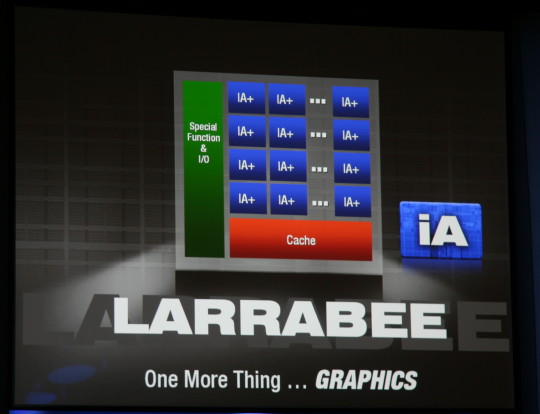

Larrabee et la 3DCe qui n'était autre qu'un secret de polichinelle a enfin trouvé une confirmation claire et nette puisque Paul Otellini, le CEO d'Intel a déclaré ouvertement que Larrabee était destiné au rendu graphique.

Pour rappel, Larrabee est un processeur massivement parallèle destiné à combler un vide dans l'offre d'Intel actuelle lorsqu'il s'agit de s'attaquer à des problèmes massivement parallèles, tout comme Nvidia le fait avec CUDA et tout comme AMD annonce le faire un jour. Un marché voué à devenir important et donc intéressant pour Intel qui ne compte pas laisser la concurrence y prendre une place trop importante.

Larrabee est un processeur qui sera composé de 16 ou 24 cores dans sa première version. Ces cores seront des cores IA (x86) simplifiés, c'est-à-dire in-order et dépourvus d'une grosse partie de la logique de contrôle pour se concentrer sur l'exécution. Ainsi leur unité de calcul vectorielle sera large de 512 bits (à ne pas confondre avec une précision de 512 bits) et permettra par exemple de traiter 16 opérations FP32 d'une seule traite.

A côté de cet amas de cores prendront place un gros cache global partagé ainsi qu'un bloc qui contiendra les fonctions spéciales et le contrôleur mémoire. Larrabbe devrait être capable de communiquer avec le reste du système soit en QuickPath, soit en PCI Express, en supportant Geneseo, un groupe d'extensions à ce bus de données.

Le marché du GPU se rapprochant de celui de la puissance de calcul, il est logique pour Intel de s'y intéresser. Ce sera le cas avec Larrabee. Etant donné qu'il est basé sur des cores IA, qui disposeront d'un SSE++ destiné à étendre leur jeu d'instructions aux nouvelles tâches qui leur seront confiées, Larrabee ne collera pas parfaitement aux API graphiques que sont Direct 3D et OpenGL. Intel devra donc convertir les fonctions de ces APIs en fonctions interprétables par Larrabee. Notez que Nvidia et AMD doivent en faire de même pour leurs GPUs bien que ceux-ci étant conçu dans cette optique il se rapprochent le plus possible des APIs.

Le travail d'Intel ne sera donc pas réellement différent mais plus complexe. Tout du moins, si parmi les fonctions spéciales, se retrouve la "colonne vertébrale" d'un GPU car si celle-ci doit également être émulée, les choses risquent de se corser.

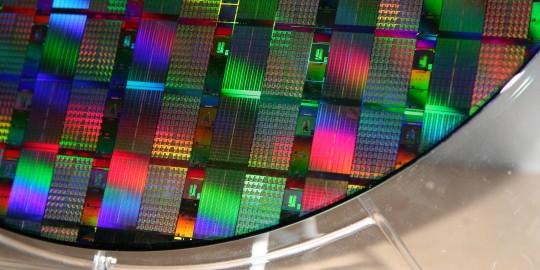

Wafer de Polaris, le CPU de 80 cores utilisés à des fins de recherche, dont Larrabee découle.

Mais si Intel veut réellement investir le marché graphique, pourquoi ne pas aller directement vers la conception d'un GPU ? Il y a plusieurs raisons à cela. Probablement le manque d'expertise qui rendrait une attaque directe difficile, la possibilité de faire d'une pierre deux coups en attaquant le graphique et le calculateur, mais surtout le ray tracing. Intel croit fermement en la viabilité de ce mode de rendu pour les applications rendues en temps réel, y compris les jeux.

Si ce rendu offre effectivement de nombreux avantages, il reste très gourmand et les démonstrations effectuées jusqu'ici, bien qu'impressionnante techniquement, restent très très basiques sur un plan visuel. A en croire Intel, Larrabee pourrait bien changer la donne et enfin démocratiser le ray tracing, une API dédiée serait d'ailleurs proposée en plus de Direct 3D et OpenGL. De notre côté, nous pensons qu'il est encore trop tôt pour que le ray tracing soit intéressant. Nous ne croyons donc pas réellement à ces promesses de jeux rendus en temps réel et en ray tracing sur Larrabee.

Justin Rattner et Daniel Pohl, admirant une démo de ray tracing que l'on voit et revoit depuis des mois. Certes cela va plus vite, mais pourrait-on avoir une nouvelle démo pour le prochain IDF ?

D'autant plus que pour développer un jeu vidéo, il faut plusieurs années et quand Larrabee sortira, les moteurs capables de gérer le ray tracing ne vont pas apparaître par magie. Il faut du temps pour qu'un tel changement puisse s'opérer. Nous nous attendons plutôt à un Larrabee qui dans 18 à 24 mois offrira des performances du niveau d'un GeForce 8800 aujourd'hui, et permettra de commencer à faire du développement sérieux autour du ray tracing, de quoi alors pouvoir alimenter ses successeurs. En bref il s'agirait plus d'une superbe plateforme de développement qu'un produit qui va être une révolution pour le joueur. Mais Intel peut bien entendu nous surprendre.

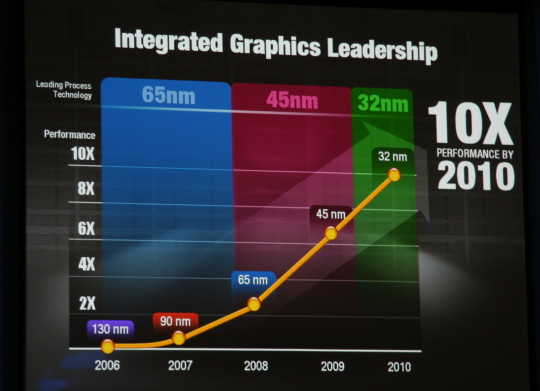

En attendant, Intel compte améliorer sensiblement les performances de ses cores intégrés. Tout d'abord avec le G35 qui sera un peu plus performant et supportera DirectX 10. Notez à ce sujet qu'Intel indique dans ses présentations que bien que le G965 ne supporte pas DirectX 10, le GM965, lui, supporterait bien cette API, via un driver prévu pour début 2008.

Enfin l'augmentation de performances la plus importante devrait intervenir avec Nehalem puisque le GPU sera alors intégré au CPU avec on peut l'espérer un meilleur accès à la mémoire et une fréquence boostée.

Ces évolutions successives devrait permettre de décupler les performances du graphique intégré d'ici 2010 selon le fondeur. De notre côté, on attend de voir, et on espère que les équipes de développement software d'Intel vont s'étendre puisque jusqu'ici nous n'avons rien vu venir de prometteur au niveau des drivers, qui, qui plus est, ne supportent ce qu'ils sont censés supporter que très tard. Bref il y a du boulot à ce niveau !

Sommaire

Vos réactions

Contenus relatifs

- [+] 09/12: Guide : Les PC HardWare.fr !

- [+] 14/11: Qualcomm dit non à Broadcom

- [+] 13/11: Thermaltake lance une chaise venti...

- [+] 11/09: Microsoft confirme des problèmes de...

- [+] 30/08: PCI Express 5.0 pour 2019, débit do...

- [+] 01/08: Les taux de retour des composants (...

- [+] 11/07: Le minage consommerait plus que Par...

- [+] 04/07: ASUS XG-C100C, le 10GBASE-T à 120

- [+] 26/06: Computex et le PC : changement et c...

- [+] 24/03: Corsair lance ses PC One avec deux ...