Les contenus liés aux tags Nvidia et GDC

Afficher sous forme de : Titre | FluxLe futur Direct3D dévoilé en mars, l'effet Mantle?

C'était un secret de polichinelle depuis quelques temps, Microsoft prépare l'arrivée d'une nouvelle mouture de DirectX et de son API graphique Direct3D. Les premières annonces se feront à la Game Developer Conference (GDC) qui aura lieu du 17 au 21 mars à San Francisco. Comme les années précédentes, nous avons d'ailleurs prévu d'être sur place, d'autant plus en sachant que des choses importantes devraient y être dévoilées autour des API graphiques.

Il ne fait aucun doute que Microsoft va réorienter Direct3D vers une réduction massive du coût CPU des commandes de rendu, AMD ayant ouvert la voie vers cela avec Mantle. Il y a dorénavant une demande importante de la part des développeurs et des possibilités à ce niveau en OpenGL qui pourraient être exploitées par Steam OS. Pour garder le contrôle, Microsoft se devait de réagir.

La plupart des informations à ce sujet sortiront des sessions du jeudi 20 mars :

DirectX: Evolving Microsoft's Graphics Platform (Presented by Microsoft)

DirectX Advancements in the Many-Core Era: Getting the Most out of the PC Platform (Presented by NVIDIA)

Approaching Zero Driver Overhead in OpenGL (Presented by NVIDIA)

DirectX: Direct3D Futures (Presented by Microsoft)

L'intitulé de cette dernière cession est d'ailleurs très clair concernant les orientations du prochain Direct3D :

Come learn how future changes to Direct3D will enable next generation games to run faster than ever before!Il est intéressant d'observer qu'AMD prendra part à la session sur le surcoût CPU en OpenGL de Nvidia (les équipes de développements de ces deux concurrents arrivent à s'entendre!), alors que c'est avec Oxide Games, qui propose la démo Mantle Star Swarm, que Nvidia s'est associé pour parler de la bonne exploitation des CPU multicores.

In this session we will discuss future improvements in Direct3D that will allow developers an unprecedented level of hardware control and reduced CPU rendering overhead across a broad ecosystem of hardware.

If you use cutting-edge 3D graphics in your games, middleware, or engines and want to efficiently build rich and immersive visuals, you don't want to miss this talk.

Une fois que nous en saurons plus sur ce que ce sera ce futur Direct3D, il restera à voir qui tirera le mieux parti de ce futur Direct3D, l'avantage alternant souvent entre AMD et Nvidia. D'un côté certains pourraient se dire qu'avec Mantle, AMD a irrité Microsoft qui pourrait être tenté de favoriser Nvidia. C'est possible, mais d'un autre côté AMD a également enlevé une épine du pied au père de Windows en lui donnant un prétexte pour une évolution plus radicale face à laquelle certains pouvaient peut-être trainer des pieds. L'expérience de Mantle est par ailleurs une bonne base de travail et de réflexion pour Microsoft, de quoi l'aider à bouger plus rapidement pour ne pas laisser d'avantage au couple OpenGL et Steam OS.

GDC: Démo Nvidia: RealTime Dynamic Fracture

Après FaceWorks à la GTC, Nvidia présentait une nouvelle démo à l'occasion de la GDC, dans un registre différent puisqu'il s'agit de mettre en avant l'évolution de ses travaux au niveau de la destruction dynamique des environnements. Dénommée Real-Time Dynamic Fracture, la démonstration tourne à 30 fps sur une GTX 680 et se base probablement sur un prototype d'une future évolution de ses librairies PhysX dédiées à la simulation des corps solides.

La simulation n'est pas encore physiquement parfaite et Nvidia travaille à ajouter notamment la prise en compte de l'intégrité des structures pour leur permettre de s'effondrer sous leur propre poids lorsqu'elles sont endommagées.

Le niveau de détails, la possibilité d'une destruction complète, les poussières, rendent cependant la scène plutôt impressionnante et on ne peut qu'espérer pouvoir retrouver un jour ces possibilités dans un jeu. Pour cela, de nombreux défis se posent puisqu'il s'agit de permettre à des personnages, contrôlés au niveau du CPU, de se déplacer dans des structures dont la destruction est simulée sur le GPU.

GDC: AMD, Intel, Nvidia, Qualcomm... à la GDC

Lors de la GDC, dont l'édition 2013 s'est terminée vendredi dernier à San Francisco, les plus importants fournisseurs de technologies graphiques (les GPU Radeon, Mali, PowerVR, HD Graphics, GeForce, Adreno) étaient présents avec notamment pour but de convaincre les développeurs de jeux vidéo d'exploiter toutes les possibilités de leurs produits récents à travers des techniques de rendu toujours plus évoluées que ce soit sur PC ou dans le monde mobile, qui progresse à vive allure.

En plus de diverses présentations, AMD, ARM, Imagination, Intel, Nvidia et Qualcomm étaient présents à travers des stands principalement exploités pour mettre en avant leurs outils maisons : AMD GPU PerfStudio, ARM Mali Graphics Debugger, Imagination PVRTune, Intel Graphics Performance Analyzers, Nvidia Nsight, Qualcomm Adreno Profiler

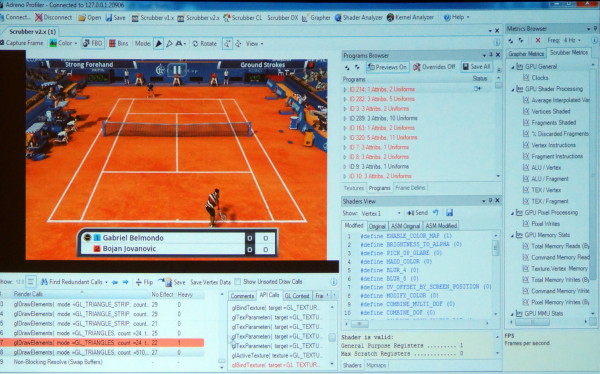

Ici en exemple, l'Adreno Profiler de Qualcomm qui permet d'observer assez facilement le comportement des GPU Adreno et d'appliquer des modifications à la volée pour identifier des bugs ou des goulots d'étranglement (bottlenecks). Il est ainsi possible de modifier un shader, de désactiver la synchronisation verticale, de réduire la taille de toutes les textures, etc., et d'observer l'impact en temps réel sur le smartphone ou sur la tablette.

Les outils de tous les acteurs cités proposent des possibilités similaires, chacun ayant des petits avantages ou inconvénients par rapport à la concurrence. Ils sont en général autant adapté au débogage et à l'optimisation de la partie graphique que de la partie "compute" éventuellement exposée pour les GPU.

Lors de plusieurs rencontres avec des développeurs, nous avons voulu savoir quels outils ils préféraient et pourquoi. La réponse de nos interlocuteurs a été unanime : aucun ! Pourquoi ? Tout simplement parce que la multiplication de ces outils devient problématique et que peu importe leurs qualités ou leurs défauts, devoir utiliser un outil spécifique à chaque marque de GPU est tout sauf pratique, d'autant plus quand il faut en supporter bon nombre comme c'est le cas sous Android.

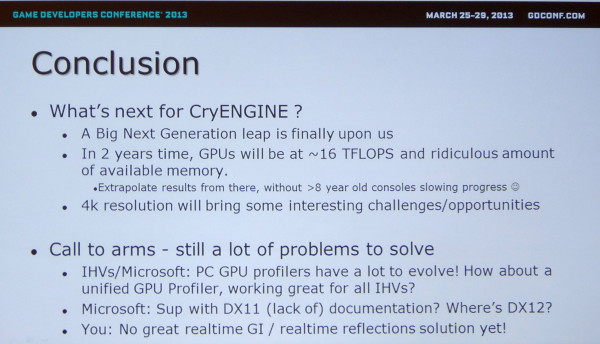

Même avec seulement 3 acteurs, c'est un problème dans le monde PC comme le rappelle Crytek en parlant des opportunités et défis à venir. Il serait ainsi intéressant que Microsoft et Google proposent des outils de développement plus évolués qu'actuellement et dans lesquels les concepteurs de GPU pourraient venir s'interfacer pour proposer autant de détails que dans leurs propres outils mais d'une manière plus ou moins unifiée.

Notez au passage que Crytek en profite pour rappeler à Microsoft qu'il serait peut-être bon de travailler sur la documentation de DirectX !