Les contenus liés au tag Qualcomm

Afficher sous forme de : Titre | FluxMSI adopte le Killer E2200

TMSC évoque le 28 et le 20nm

CES: Snapdragon 600, 800: Qualcomm accélère

Impact de l'EUV et du 450mm selon Intel

HSA, calcul hétérogène: Intel et Nvidia isolés?

Brevets GPU : Nvidia attaque Qualcomm et Samsung

Face à l'importance prise dans le monde du GPU mobile par des acteurs nouveaux, ou anciennement secondaires, Nvidia s'estime lésé et brandit l'arme des brevets.

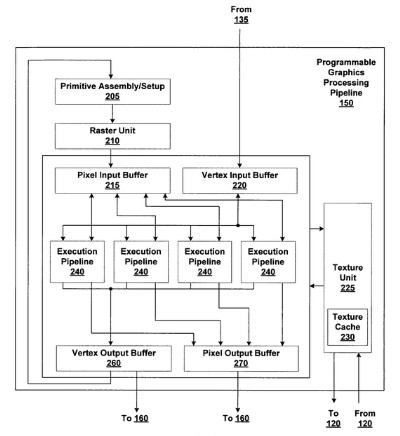

Nvidia a annoncé en fin de semaine passée avoir déposé une plainte à l'encontre de Samsung et Qualcomm pour violation de plusieurs de ses brevets . Parmi son arsenal, Nvidia a choisi de mettre en avant 7 brevets qui concernent la mise en place dans un GPU du T&L, des shaders, du multithreading etc.

Compte tenu de leur histoire relativement longue dans un domaine qui bouge beaucoup et de leurs différentes acquisitions, il est difficile de concevoir aujourd'hui un GPU sans entrer en conflit avec l'un des brevets d'AMD ou de Nvidia. Ils ont alors la possibilité de ne rien faire, estimant que ce serait contreproductif, de négocier un accord ou de passer par la case justice. C'est ce qu'a décidé Nvidia après deux années de négociations infructueuses avec différentes parties.

Au cours de son histoire, Nvidia a dépensé énormément en R&D et n'a pas manqué d'investir en proportion dans la rédaction de brevets relativement généralistes et plus spécifiques. Depuis à peu près 2 ans, le mot "invention" et tous ses dérivés font partie des éléments de langage de la société, exploités à chaque opportunité. C'est particulièrement le cas avec le CEO de la société, Jen-Hsun Huang, qui pousse dans certaines situations le concept à l'extrême quitte à déformer la réalité, comme c'était le cas lors du dernier CES durant lequel il a par exemple déclaré "Nous avons inventé le GPU" ou encore résumé l'épisode des GeForce FX par "Nous avons inventé DirectX 9". De petites phrases qui résument bien la pensée de Nvidia : la société a été au cur du développement des technologies graphiques, entend bien le faire savoir agressivement et en tirer le bénéfice.

Alors que les SoC Tegra de Nvidia peinent à prendre leur envol dans le monde des smartphones et tablettes, des produits concurrents voient leur volume de vente exploser. Ces produits intègrent tous un GPU sous une forme ou une autre, ce qui est difficilement acceptable pour Nvidia qui estime avoir développé des technologies qu'ils exploitent sans contrepartie. Ce dernier cite les GPU Mali d'ARM, PowerVR d'Imagination et bien sûr Adreno de Qualcomm.

Nvidia focalise dans un premier temps son action contre Samsung et Qualcomm, mais il nous paraît probable que c'est avant tout le second qui est visé. Pour rappel, Qualcomm fabrique les SoC Snapdragon équipés de GPU Adreno, des composants qui ont progressivement largement dominé le marché. Nvidia a probablement intégré Samsung dans sa démarche pour augmenter la pression sur Qualcomm qui n'entend pas céder si facilement. Samsung ayant été prévenu par Nvidia il y a plus de deux ans, la société ne pourra pas se justifier en disant n'y être pour rien et en renvoyant simplement la balle à Qualcomm.

Nvidia a ainsi demandé l'interdiction d'importation sur le sol américain de différents périphériques Samsung : Galaxy S4, Galaxy S5, Galaxy Note 3, Galaxy Note 4, Galaxy Note Edge, Gamaxy Tab S, Galaxy Note Pro. Bien entendu, après cet épisode, il sera difficile pour Nvidia d'obtenir des commandes du fabricant coréen, mais cette décision a probablement été prise parce que les liens commerciaux entre les deux sociétés étaient de toute manière insignifiants.

En débutant officiellement les poursuites, Nvidia accentue la pression sur Qualcomm, mais le but visé dans ce type de procédure est toujours de trouver un accord. Cela risque de prendre du temps, d'autant plus que la situation est complexe. Dans le cas d'un procès, il pourra être difficile à Nvidia de démontrer objectivement que ses brevets ne sont pas trop généralistes, ne représentent pas de petites évolutions évidentes et ont bel et bien été enfreints par l'implémentation de Qualcomm. Par ailleurs, si ce dernier est arrivé récemment dans le monde du GPU, il l'a fait en rachetant à AMD/ATI la division Imageon dont sont issus les GPU Adreno. Qualcomm profite ainsi probablement d'un accord par rapport à certains brevets d'AMD.

La capacité de Nvidia à obtenir un accord ou un jugement favorable pourra lui rapporter des revenus supplémentaires substantiels, et lui donner des arguments pour en faire de même avec d'autres acteurs de l'industrie. Par exemple, si Imagination fait la sourde oreille, Nvidia pourrait se retourner contre Apple, mais nul doute que ce dernier pourrait prendre très mal une action agressive de ce style et avoir par la suite quelques difficultés pour passer commande de GPU GeForce.

A noter que l'accord signé il y a quelques années entre Intel et Nvidia englobe l'accès à ces brevets. Intel est ainsi couvert, que ce soit pour ses propres GPU ou pour les GPU PowerVR qu'il intègre dans certains SoC. Dans sa démarche juridique, Nvidia exploite d'ailleurs cet accord en guise d'exemple.

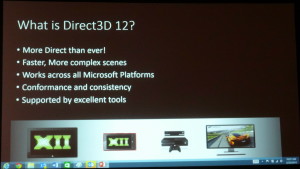

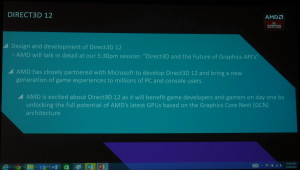

GDC: DirectX 12: 'Mantle' standardisé en 2015

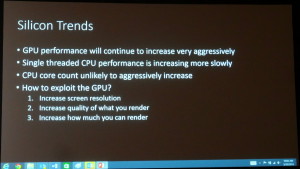

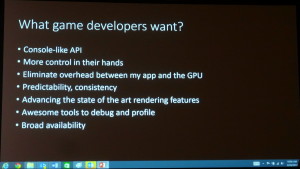

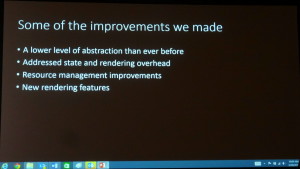

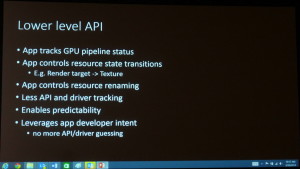

Comme prévu Microsoft vient de lever le voile sur sa future API DirectX 12 ou pour être plus précis sur sa composante graphique Direct3D 12. Lors de la première session consacrée au sujet, Microsoft n'est pas rentré dans le détail et s'est contenté de nous donner les grandes lignes de son API. Des grandes lignes qui correspondent à ce qu'AMD propose avec son API propriétaire Mantle.

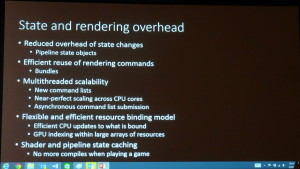

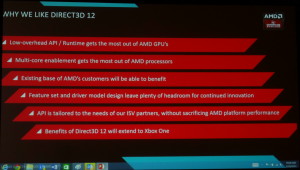

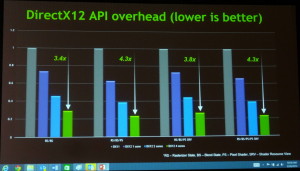

Direct3D 12 propose un niveau d'abstraction plus bas que les précédents Direct3D, la responsabilité du contrôle du GPU se retrouve alors en partie transférée de l'API et des pilotes vers l'application et les développeurs. Le premier intérêt est de réduire le surcoût CPU de la gestion des états et du rendu 3D en lui-même. L'API et les pilotes ont moins de vérifications à faire, ce qui réduit la pression au niveau du CPU. Par ailleurs, regrouper une grosse partie du contrôle en un seul endroit, l'application, permet d'enfin exploiter le multithreading de manière efficace. Actuellement, le développeur ne sait pas ce que vont faire de ses commandes le pilote et l'API et il lui est donc impossible de prévoir un multithreading efficace.

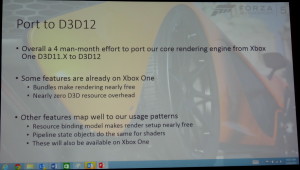

Plus spécifiquement, Direct3D 12 va tout d'abord réduire le coût des changements d'états à travers des "pipeline state objects", sorte d'empreinte de l'état du GPU pour un type de tâche particulière. De quoi pouvoir préparer les changements d'états en amont et appliquer ces changements en bloc. Ensuite, Direct3D 12 fait appel au concept de "bundles", des groupes de commandes de rendu liés à un objet particulier de la scène qui, une fois préparés, pourront être stockés en cache et réutilisés autant de fois que les développeurs le jugent nécessaire, que ce soit à l'intérieur d'une même image ou dans des images successives. Direct3D 12 supporte également un nouveau modèle de listes de commandes asynchrones pour faciliter le bon support du multithreading, une gestion des ressources plus flexibles, mieux adaptée aux GPU modernes etc.

Tout cela est très proche voire identique à ce que fait AMD avec Mantle. Oxide Games estime d'ailleurs que les performances de son renderer Direct3D 12 seront similaires à celles de son renderer Mantle.

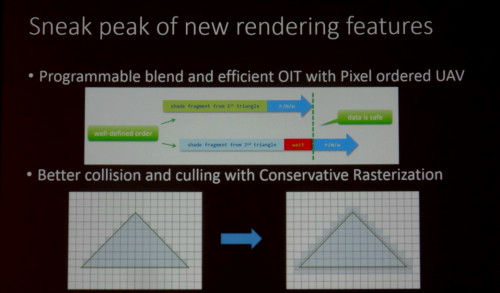

Direct3D 12 apportera également quelques nouvelles fonctionnalités, mais ce n'est pas l'objectif principal. Sans rentrer dans le détail, Microsoft cite par exemple le support du blending programmable, d'un OIT (order independant transparency) efficace ou encore d'une rastérisation conservative.

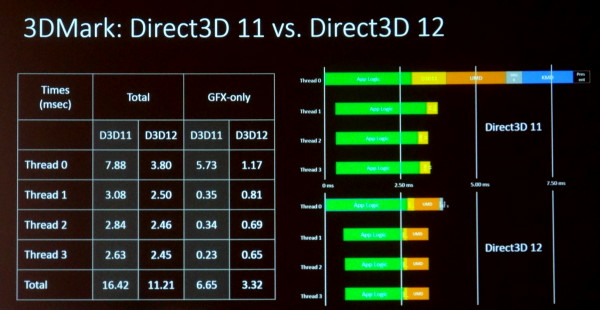

Microsoft a tenu à donner un exemple de la différence que peut faire Direct3D 12 en se basant sur 3DMark 11, dont le code lui a été fourni par Futuremark :

D3D11 à gauche, D3D12 à droite

Comme attendu, Direct3D 12 permet de réduire drastiquement le temps CPU qui est réduit par 2 sur la partie graphique. Plus important, le thread principal se retrouve nettement allégé au niveau de l'API et des pilotes (UMD et KMD), cette fois d'un facteur 5x. Un tel exemple met en avant la possibilité d'exploiter mieux de "petits" CPU multicores.

L'autre démonstration de Microsoft concernait le portage de Forza Motorsport de l'API D3D11.X de la Xbox One vers D3D12. Celui-ci aurait été très rapide, l'équivalent du temps de travail de 4 ingénieurs sur un mois.

Ensuite, lors de cette première session consacrée à Direct3D 12, Microsoft a tenu à inclure ses partenaires en les invitant tour à tour à prendre la parole et en organisant une improbable photo de famille de tous ces concurrents :

De gauche à droite, Chris Tector (Forza Motorsport, Microsoft), Anuj Gosalia (Microsoft), Eric Mentzer (Intel), Raja Koduri (AMD), Tony Tamasi (Nvidia), Eric Demers (Qualcomm, ex-ATI/AMD).

Tour à tour et par ordre alphabétiques, chacun a expliqué apprécier avoir travaillé en étroite collaboration avec Microsoft et abordé la question du support de cette future API :

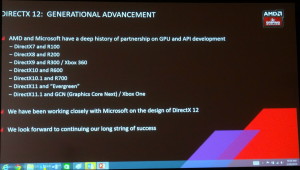

AMD :

Du côté d'AMD, qui a évité de prononcer le mot Mantle durant cette présentation, le support concernera tous les GPU depuis la première génération GCN, soit les Radeon HD 7000 (hors renommages), HD 8000, R200 et supérieures.

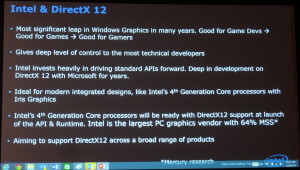

Intel :

Intel souligne qu'il s'agit de la plus grosse évolution de ces dernières années. Si Intel a largement profité dans le monde PC de l'inefficacité de Direct3D pour justifier l'utilisation de ses CPU les plus performants, une API plus efficace l'intéresse également puisque cela va permettre de libérer ses GPU lorsque l'enveloppe thermique est limitée. Si les cores CPU peuvent se contenter d'une fréquence plus faible, cela laisse plus de marge pour le turbo du côté GPU. Le support de Direct3D 12 sera assuré pour tous les processeurs Core à partir de la 4ème génération (Haswell).

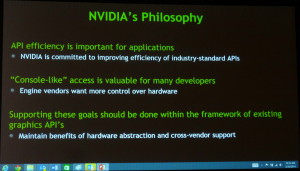

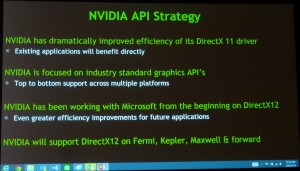

Nvidia :

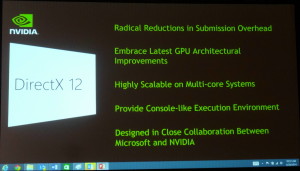

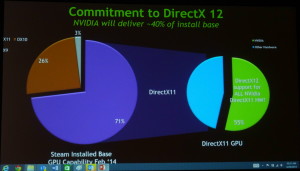

Nvidia est probablement le fabricant qui devrait proposer le plus large support de Direct3D 12 pour ses anciens produits puisque cela concernera les générations Fermi, Kepler et Maxwell. De quoi permettre à Nvidia d'estimer qu'à sa sortie, le parc compatible Direct3D 12 sera à 40% composé de GeForce.

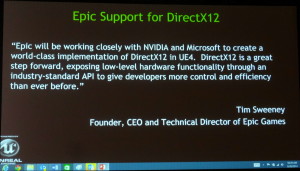

Nvidia indique avoir travaillé en étroite collaboration avec Microsoft depuis un an sur Direct3D 12 (la démonstration de Forza Motorsport tournait d'ailleurs sur une GeForce GTX Titan Black), et termine par citer Epic Games, un partenaire proche, qui annonce qu'ils travailleront main dans la main avec le fabricant de GPU pour porter l'Unreal Engine sous DirectX 12.

Qualcomm :

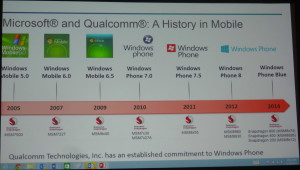

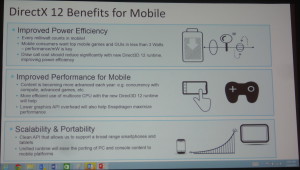

Enfin, Qualcomm explique voire dans Direct3D 12 de nouvelles opportunités d'augmenter le rendement énergétique, la priorité pour le fabricant de SoC. Ce dernier nous avait par ailleurs indiqué précédemment que les GPU Adreno 4xx, tels que l'Adreno 420 présent dans le Snapdragon 805, seraient compatibles avec ce nouveau Direct3D.

Au final, à partir de ce jour, Microsoft estime que tous les nouveaux GPU PC supporteront Direct3D 12, que 80% des nouveaux PC destinés aux joueurs supporteront Direct3D 12 et que 50% des joueurs seront équipés de matériel adapté lorsque l'API sera disponible. La Xbox One sera bien entendu compatible. Microsoft ne donne aucune information par rapport aux niveaux de fonctionnalités matérielles mais il est probable que tous les GPU compatibles Direct3D 12 n'en supportent pas toutes les fonctionnalités.

Malheureusement, il faudra encore patienter un petit peu pour cela. Dans l'immédiat, Microsoft propose un accès à une beta au cas par cas aux développeurs qui en font la demande et prévoit une préversion publique pour la fin de l'année. Le but visé par Microsoft concerne les jeux de Noël 2015, mais pour quel OS ? Un point que le géant de Redmond n'est pas encore prêt à aborder mais il est possible, sur PC, que passer à Windows 9 sera obligatoire pour profiter de DirectX 12 et Direct3D 12. De futures versions de Windows adaptées aux tablettes et aux smartphones profiteront elles aussi de cette API.

D'après le timing de Microsoft, AMD devrait encore disposer d'une fenêtre de plus d'une année pour profiter des avantages de Mantle. Et au vu de la proximité apparente entre les deux API, les développeurs devraient pouvoir réutiliser une grosse partie du travail fait autour de l'API propriétaire d'AMD.

SoC huit curs 64 bits chez Qualcomm et Mediatek

L'ouverture du Mobile World Congress aujourd'hui à Barcelone nous vaut l'occasion de quelques annonces côté SoC, la mode du moment étant aux versions 64 bits basés sur l'architecture ARMv8. Après l'annonce surprise des A7 64 bits d'Apple en septembre dernier - qui avait pris de court le reste de l'industrie - Qualcomm avait été le second à annoncer un SoC 64 bits, le Snapdragon 410.

Contrairement aux modèles haut de gamme ou le constructeur décline sa propre architecture ARM (Krait), il s'agissait ici d'un design proposé par ARM, le Cortex A53 (en version quatre cur). Pour rappel, ARM propose à ses partenaires deux cores distincts pour le 64 bits, le Cortex A53 très basse consommation (qui remplace l'actuel Cortex A7 que l'on retrouve dans l'entrée de gamme, et qui n'a rien à voir avec l'A7 d'Apple malgré le nom similaire) et le Cortex A57, haut de gamme et dédié aux smartphones/tablettes, voir un peu plus. Sur l'entrée de gamme, Qualcomm proposait jusqu'ici un mélange de Cortex A7 et de modèles Krait d'entrée de gamme, l'annonce du 410 n'était donc pas une surprise.

Ce qui l'est un peu plus, c'est l'annonce du jour des Snapdragon 610 et 615 , utilisant là aussi des Cortex A53 ! Jusqu'ici, la gamme Snapdragon 600 utilisait exclusivement des designs Krait de Qualcomm que l'on retrouvait par exemple dans les tablettes Nexus 7 ou encore dans le Galaxy S4. Le choix d'un design ARM, qui plus est dans sa version entrée de gamme est pour le moins surprenante. Si la version 64 bits de Krait semble nécessiter plus de temps pour être finalisée, il semble aussi que ce soit le cas du design des Cortex A57 dont les annonces commerciales se font attendre.

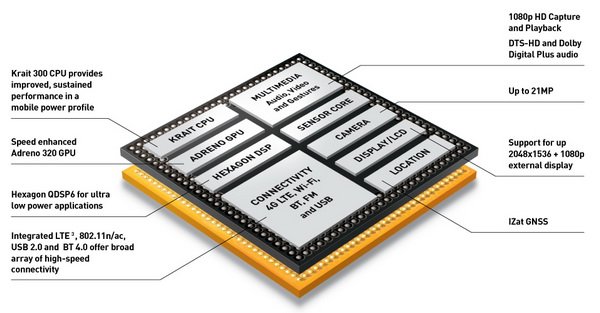

Le Snapdragon 600 utilisait l'architecture Krait

Pour compenser cela, Qualcomm emprunte la route de la multiplication des curs. Ainsi, si le modèle 610 utilise quatre curs Cortex A53, le 615 en compte huit. Un moyen simple d'annoncer un niveau de performance cumulé (dans les benchs multithreads) élevé alors que le niveau de performances sur un cur risque d'être assez limité. Côté GPU on retrouvera un Adreno 405, une version allégée de l'Adreno 420 qui avait été annoncé au CES avec le Snapdragon 805. Les Adreno 400 représentent la dernière génération de GPU type DirectX 11.2/OpenGL ES 3.0 de Qualcomm sur laquelle nous auront l'occasion de revenir ultérieurement. Ces SoC intègrent également un modem LTE, un décodage du H.265, et sont annoncés en échantillonnage pour le troisième trimestre, avec une disponibilité dans des appareils annoncée avant la fin de l'année.

Notez que Qualcomm n'est pas le seul à partir sur cette voie, puisque la société chinoise Mediatek a également annoncé un SoC huit curs Cortex A53, comme nous le rapportent nos confrères d'Ars. Ces derniers rapportent également les propos du VP de Mediatek qui confirme que l'A53 était prêt, contrairement à l'A57 ce qui vaut le lancement de ce produit. La marque annonce quelques caractéristiques, la partie CPU sera cadencée à 1.5 GHz. Le GPU sera aussi fourni par ARM, un Mali T760. L'échantillonnage est prévu pour septembre, tandis que la disponibilité dans des appareils est annoncée pour début 2015.

AMD 4è fabricant de microprocesseurs

Si les chiffres du marché du processeur x86 sont régulièrement publiés par divers instituts, ceux concernant le marché global des microprocesseurs sont plus rares. IC Insights a publié ces données pour l'année 2012. Attention il s'agit d'un classement en valeur et non en unités qui serait moins favorable à Intel et AMD qui disposent d'un prix de vente moyen supérieur :

Si Intel reste largement en tête avec 65,3% du marché, AMD a perdu la seconde place qu'il occupait depuis les années 90s à la faveur de Qualcomm et de Samsung (les chiffres de Samsung incluant les processeurs Apple qu'il fabrique). AMD pointe désormais à la 4è place avec 6,4% de part de marché, environ 1/10è d'Intel.

Cette baisse dans le classement est lié à une forte baisse (-21%) chez AMD alors qu'elles étaient en hausse chez Qualcomm et Samsung, avec respectivement +28 et +78%. Il est à noter que 83% des revenus de Samsung pour les microprocesseurs proviennent en fait d'Apple.

Au global IC Insights note que si les microprocesseurs restent toujours le produit du marché des semi-conducteurs avec 22% des ventes. La croissance n'a toutefois été que de 2% en 2012 après une hausse de 19% en 2011, une petite hausse portée par les microprocesseurs pour Smartphones et Tablettes alors que processeurs pour PC de bureau, PC portables, serveurs et applications embarquées ont connu un recul de 6%.

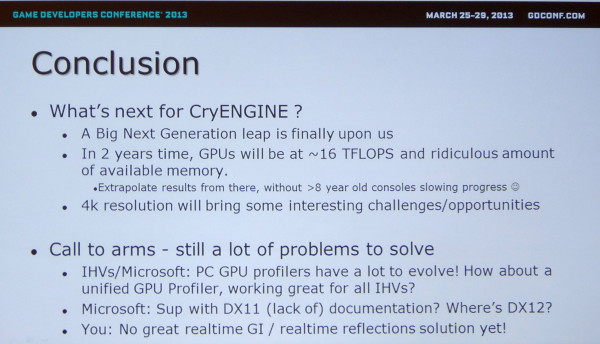

GDC: AMD, Intel, Nvidia, Qualcomm... à la GDC

Lors de la GDC, dont l'édition 2013 s'est terminée vendredi dernier à San Francisco, les plus importants fournisseurs de technologies graphiques (les GPU Radeon, Mali, PowerVR, HD Graphics, GeForce, Adreno) étaient présents avec notamment pour but de convaincre les développeurs de jeux vidéo d'exploiter toutes les possibilités de leurs produits récents à travers des techniques de rendu toujours plus évoluées que ce soit sur PC ou dans le monde mobile, qui progresse à vive allure.

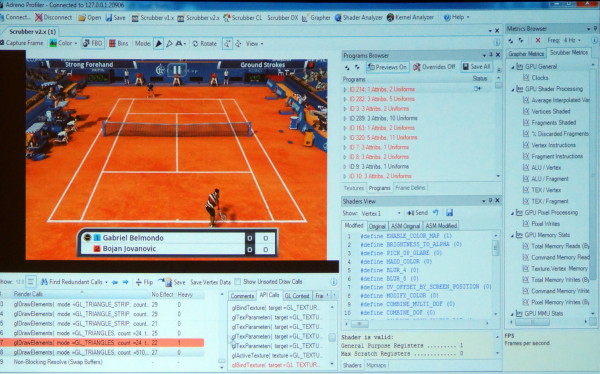

En plus de diverses présentations, AMD, ARM, Imagination, Intel, Nvidia et Qualcomm étaient présents à travers des stands principalement exploités pour mettre en avant leurs outils maisons : AMD GPU PerfStudio, ARM Mali Graphics Debugger, Imagination PVRTune, Intel Graphics Performance Analyzers, Nvidia Nsight, Qualcomm Adreno Profiler

Ici en exemple, l'Adreno Profiler de Qualcomm qui permet d'observer assez facilement le comportement des GPU Adreno et d'appliquer des modifications à la volée pour identifier des bugs ou des goulots d'étranglement (bottlenecks). Il est ainsi possible de modifier un shader, de désactiver la synchronisation verticale, de réduire la taille de toutes les textures, etc., et d'observer l'impact en temps réel sur le smartphone ou sur la tablette.

Les outils de tous les acteurs cités proposent des possibilités similaires, chacun ayant des petits avantages ou inconvénients par rapport à la concurrence. Ils sont en général autant adapté au débogage et à l'optimisation de la partie graphique que de la partie "compute" éventuellement exposée pour les GPU.

Lors de plusieurs rencontres avec des développeurs, nous avons voulu savoir quels outils ils préféraient et pourquoi. La réponse de nos interlocuteurs a été unanime : aucun ! Pourquoi ? Tout simplement parce que la multiplication de ces outils devient problématique et que peu importe leurs qualités ou leurs défauts, devoir utiliser un outil spécifique à chaque marque de GPU est tout sauf pratique, d'autant plus quand il faut en supporter bon nombre comme c'est le cas sous Android.

Même avec seulement 3 acteurs, c'est un problème dans le monde PC comme le rappelle Crytek en parlant des opportunités et défis à venir. Il serait ainsi intéressant que Microsoft et Google proposent des outils de développement plus évolués qu'actuellement et dans lesquels les concepteurs de GPU pourraient venir s'interfacer pour proposer autant de détails que dans leurs propres outils mais d'une manière plus ou moins unifiée.

Notez au passage que Crytek en profite pour rappeler à Microsoft qu'il serait peut-être bon de travailler sur la documentation de DirectX !