Actualités informatiques du 18-10-2013

- Nvidia G-SYNC: la v-sync enfin dynamique !

- La GeForce GTX 780 Ti en approche

- AMD dans le vert grâce aux consoles

- GameWorks : Nvidia investit dans le jeu PC

| Octobre 2013 | ||||||

|---|---|---|---|---|---|---|

| L | M | M | J | V | S | D |

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 | 31 | |||

Nvidia G-SYNC: la v-sync enfin dynamique !

Au cours de sa seconde conférence, et après avoir tiré en longueur sur une utilisation tordue de la console Shield, Nvidia a dévoilé une technologie pour le moins intéressante que la société est parvenue à maintenir secrète durant son développement : G-SYNC. Oubliez les compromis de la synchronisation verticale activée / désactivée, l'approche de Nvidia offre le meilleur des deux mondes.

Pour rappel, lorsque la synchronisation verticale (v-sync) est activée, la fluidité est affectée dès que la carte graphique ou le reste du système ne parviennent pas à produire une image dans l'intervalle d'un rafraîchissement de l'écran. La même image doit alors être affichée deux fois, ce qui entraîne une saccade et augmente la latence d'affichage moyenne. C'est particulièrement un problème sur PC, plateforme hétérogène pour laquelle il n'est pas possible pour les développeurs de garantir un temps de rendu adapté à la v-sync.

Désactiver la synchronisation verticale permet d'éviter en partie ces problèmes mais au prix d'une cassure dans l'image affichée qui peut être très gênante (tearing). Par ailleurs, si la fluidité s'en trouve améliorée, elle n'est pas parfaite : puisque l'affichage est constitué de deux morceaux d'images successives (ou plus), la fluidité n'est pas identique sur la totalité de l'écran.

Plusieurs tentatives ont permis de mettre en place des compromis entre le jeu en v-sync ON et OFF, mais sans jamais proposer de solution parfaite. C'était le cas notamment chez Nvidia avec la synchronisation verticale adaptative, approche que certains développeurs utilisent par ailleurs d'une manière plus globale dans leurs moteurs.

Avec G-SYNC, Nvidia s'attaque à la source du problème : l'écran doit en principe être rafraîchi à une cadence fixe. Cette limitation pénalise le jeu PC depuis des années et G-SYNC la fait enfin voler en éclats à travers une synchronisation verticale dynamique. Si un écran n'est pas capable d'accepter un taux de rafraîchissement supérieur à une certaine valeur, rien ne l'empêche cependant d'être rafraîchi à une vitesse inférieure et rien ne l'empêche d'être rafraîchi à une vitesse variable. Fort de ce constat, Nvidia a développé une logique de contrôle de l'écran plus flexible et en combinaison avec un support logiciel adapté au niveau des pilotes, le GPU est capable de contrôler quand l'écran va être rafraîchi.

Typiquement cela revient à dire à l'écran d'oublier toute cadence et de se rafraîchir en synchronisation avec le GPU, soit dès que ce dernier a terminé le rendu d'une image et inverse ses buffers de rendu. L'affichage est alors direct et aucun délai ne doit être inséré. Une fenêtre d'action est définie pour que la technologie soit active, avec un délai de rafraîchissement minimal lié aux spécifications de l'écran (16.667 ms pour un écran 60 Hz) ainsi qu'un délai maximal qui semble tourner autour de 33ms (~30fps, ~30 Hz).

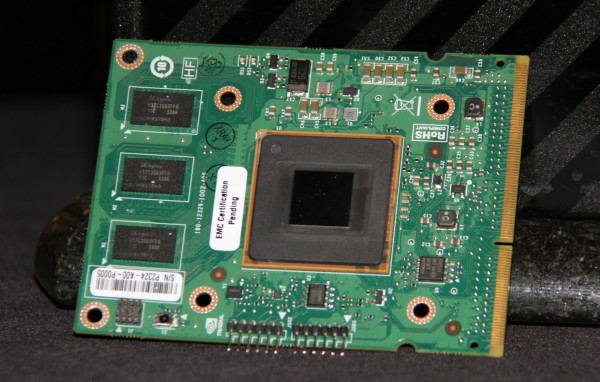

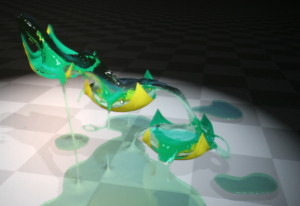

La carte contrôleur développée par Nvidia qui sera nécessaire au bon fonctionnement des premiers moniteurs G-SYNC.

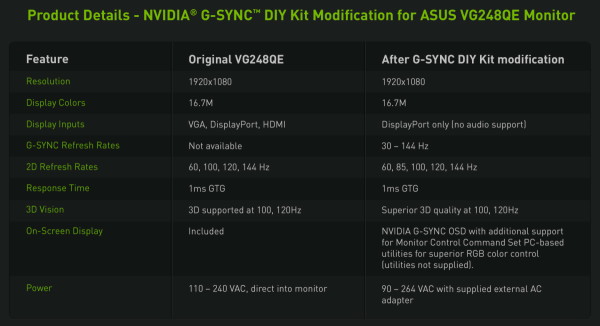

Nvidia a développé des prototypes sur base d'un moniteur d'Asus, qui fait partie des partenaires principaux pour G-SYNC et qui devrait être le premier sur le marché. Ce moniteur 24" 1080p est équipé d'une dalle adaptée à un taux de rafraîchissement maximal de 144 Hz, ce qui correspond également à la limite actuelle de la partie contrôle de Nvidia. Une fois G-SYNC activé dans les pilotes, le taux de rafraîchissement effectif varie dynamiquement entre 30 ou 40 Hz et 144 Hz, Nvidia n'est pas très clair sur la limite basse.

La cadence d'affichage ne peut par contre pas correspondre parfaitement à la cadence d'avancement de la simulation du jeu par le moteur graphique, ce dernier n'étant pas capable de prédire le temps de rendu et donc le délai de rafraîchissement pour une image particulière. En pratique cependant, en moyenne l'erreur à ce niveau semble être relativement bien lissée et sur les quelques exemples que nous avons pu observer, aucune sensation étrange ne se faisait ressentir.

La sensation de fluidité avec G-SYNC activé est excellente dès 40 fps, alors qu'entre 40 et 60 fps elle est souvent très mauvaise avec v-sync et tout juste passable sans v-sync. Nvidia a développé une petite démonstration technique pour mettre en avant G-SYNC, mais nous avons également pu le vérifier en pratique sur la scène de Tomb Raider que nous avons l'habitude d'utiliser pour nos tests de fluidité. Entre 30 et 40 fps par contre, G-SYNC n'apporte plus réellement d'avantage significatif.

Pour vanter cette technologie de Nvidia, trois pointures du développement de moteurs graphiques ont fait le déplacement : Johan Andersson (DICE, Frostbite), John Carmack (id Software, id Tech) et Tim Sweeney (Epic, Unreal Engine). Ce n'est pas courant que ces développeurs soient réunis au même endroit et encore moins qu'ils parlent d'une seule voix. Tous trois approuvent sans équivoque l'arrivée d'une technologie telle que G-SYNC. En partie parce qu'elle améliore l'expérience de jeu sur PC, mais avant tout parce qu'elle apporte la promesse de faciliter leur travail.

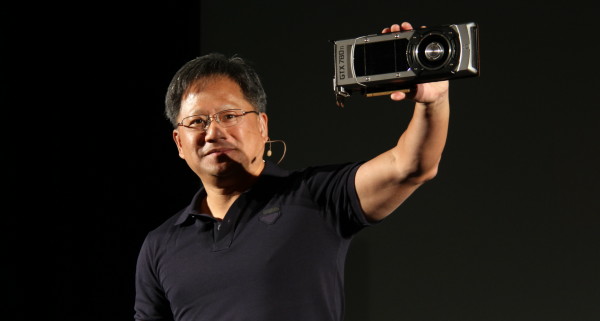

Pour vanter les mérites de G-SYNC, Jen-Hsun Huang, le CEO de Nvidia, a accueilli la crème des développeurs de moteurs graphiques : Tim Sweeney, Johan Anderson et John Carmack.

Essayer d'avoir un temps de rendu plus ou moins constant représente un challenge important lors du développement d'un jeu et d'un moteur graphique, ce qui peut dans certains cas conduire à une limitation par le bas. Ne plus devoir s'en soucier, ou tout du moins pouvoir moins s'en soucier permet de pouvoir accepter des charges momentanément plus lourdes, par exemple un effet d'explosion qui va faire chuter les performances de 60 à 40 fps pendant quelques secondes. Sans G-SYNC, la fluidité est affectée, avec G-SYNC cela passe avec un impact mineur.

Reste bien entendu que G-SYNC sera limité, tout du moins au départ à une poignée de joueurs : il s'agit d'une technologie propriétaire qui sera introduite sur des écrans relativement haut de gamme. Comme le précise John Carmack sur ce point, fondamentalement, la technologie n'est pas si complexe et onéreuse que cela sur le plan matériel, ce qui devrait à terme lui permettre de se généraliser. Reste bien entendu à voir quelle sera la politique de Nvidia qui licenciera sa technologie aux fabricants de moniteurs.

G-SYNC fonctionne actuellement sur base du DisplayPort, mais Nvidia nous a indiqué que le DVI et le HDMI étaient possibles également avec des limites maximales de taux de rafraîchissement adaptées à leur bande passante. Le protocole utilisé par Nvidia sort probablement des spécifications des normes standards et il serait utile qu'un mode avec synchronisation verticale dynamique soit intégré à leurs prochaines évolutions, ce qui ouvrirait la porte à un support standardisé et généralisé. Dans l'immédiat, il sera obligatoire de passer par la carte contrôleur de Nvidia mais à terme tous les contrôleurs pourraient supporter une version standardisée de la technologie.

Dans tous les cas, G-SYNC se présente réellement comme une évolution majeure pour l'affichage des jeux PC, à tel point qu'il est impossible de ne pas se demander pourquoi il a fallu tant de temps pour qu'elle voit le jour. Les premiers moniteurs seront commercialisés au mois de janvier selon Nvidia et nous présumons que le concepteur de GPU s'efforcera d'avoir des systèmes en démonstration chez certains revendeurs tant il est nécessaire d'avoir l'écran en face de soi pour prendre la mesure du gain de confort au niveau de la fluidité.

Notez par ailleurs que l'affichage de plus d'images sur un écran qui peut monter jusqu'à 144 Hz peut également être bénéfique, la netteté étant mieux préservée lors de mouvements longs ou rapides. C'est le même principe que pour le passage de 24 à 48 Hz au cinéma ou l'interpolation effectuée par les TV modernes. Il pourrait d'ailleurs être intéressant que Nvidia mette en place une telle interpolation, qui pourrait être un compromis intéressant par rapport au calcul gourmand de toutes les images.

La réponse de Nvidia au gain de performances des Radeon dans la version Mantle de Battlefield 4 serait-elle simplement qu'avec G-SYNC, les GeForce n'ont pas besoin de ce gain de performances ?

Mise à jour 23h30: Nvidia vient de donner un petit peu plus de détails concernant le moniteur utilisé pour les démonstrations. Il s'agit d'un VG248QE d'Asus qui a été modifié. La bonne nouvelle c'est que Nvidia envisage, mais ce n'est pas encore confirmé, la commercialisation d'un kit de modification dédié à ce moniteur pour apporter le support de G-SYNC. Une carte contrôleur devra être remplacée ainsi que le système d'alimentation. Le tarif reste inconnu et bien entendu la garantie Asus sera invalidée par l'opération.

La GeForce GTX 780 Ti en approche

Sans dévoiler ses spécifications, Nvidia vient d'annoncer l'arrivée d'une nouvelle GeForce haut de gamme, la GTX 780 Ti. L'arrivée dans le commerce est actuellement prévue pour la mi-novembre pour cette nouvelle carte graphique qui prendra place entre les GeForce GTX 780 et GTX Titan, dont elle reprendra le design de référence.

L'écart entre ces deux modèles est plutôt réduit, la première étant équipée de 12 SMX sur les 15 que comprend le GK110 alors que la seconde en profite de 14. Il est donc possible que la GeForce GTX 780 Ti soit équipée de 13 SMX ou bien tout simplement qu'il s'agisse d'une GeForce GTX Titan 3 Go puisque nous avons pu observer qu'il s'agit de la quantité de mémoire qu'elle embarque. De quoi contrer la Radeon R9 290X ?

AMD dans le vert grâce aux consoles

Comme prévu, AMD renoue enfin avec les bénéfices, avec 48 millions de $ dans le vert ce trimestre contre une perte nette de 157 millions il y a un an. Le chiffre d'affaires en en nette progression sur un an, passant de 1,27 à 1,46 milliards (+15%). La marge brute est de 36%, contre 31% il y a un an.

Comme prévu, AMD renoue enfin avec les bénéfices, avec 48 millions de $ dans le vert ce trimestre contre une perte nette de 157 millions il y a un an. Le chiffre d'affaires en en nette progression sur un an, passant de 1,27 à 1,46 milliards (+15%). La marge brute est de 36%, contre 31% il y a un an.

Ces bons résultats masquent toutefois l'effondrement des ventes de la branche Computing Solution (CPU, APU et Chipsets), avec 790 millions de $ contre 927 l'an passé (-14,8%). AMD souffre d'une baisse des ventes en unités sur les portables, compensée en partie seulement par une hausse sur les PC de bureau, avec un prix de vente moyen en baisse. Cette branche est toutefois bénéficiaire avec 22 millions de $ de bénéfice opérationnel, contre une perte de 114 millions il y a un an qui était en grande partie dû à une dévaluation du stock d'APU Llano (100 millions !).

La division Graphics and Visual Solutions (GPU et revenus liés aux consoles) affiche par contre des ventes en nette hausse, avec 671 millions de $ soit une hausse de

96,2% en un an ! Le bénéfice opérationnel passe lui de 18 millions à 79 millions de $. Attention toutefois, sur les GPU seulement, AMD enregistre une baisse des ventes dont l'ampleur n'est pas communiquée sur un an, y compris par rapport au trimestre précédent ou les ventes n'étaient que de 320 millions de $.

350 à 400 millions de $ des ventes de la division GVS proviennent donc des ventes de puces semi-personnalisés à Microsoft et Sony, et AMD précise qu'il a déjà livré des millions d'unités aux deux géants en préparation du lancement de leurs nouvelles consoles. AMD précise d'ailleurs que si sa marge augmente sur un an, elle est en baisse de 4 points sur un trimestre du fait de la marge plus faible sur ces puces (entre 10 et 20%, probablement dans le bas de la fourchette).

Si d'un point de vue financier le retour d'AMD aux bénéfices est une bonne chose, il ne se fait donc pas via son cur de métier habituel qui est toujours en recul.

GameWorks : Nvidia investit dans le jeu PC

Nvidia organise en ce moment à Montréal une conférence centrée sur son programme "The Way It's Meant To Be Played", qui englobe tout ce qui concerne ses relations avec les développeurs de jeux vidéo. Le but est bien entendu de s'affirmer à ce niveau pour occuper le terrain et contrebalancer les récents efforts d'AMD.

Depuis quelques temps, AMD a démultiplié ses efforts pour supporter les développeurs de jeux vidéo et n'a bien entendu pas manqué de communiquer sur le sujet, ce qui a pu donner l'impression d'un Nvidia moins actif, d'autant plus que ce dernier a pendant quelque temps centré sa communication sur Tegra et son potentiel de croissance pour la société, reléguant en apparence le jeu PC au second plan. Le jeu PC reste cependant de loin le premier marché de Nvidia, et supporter et influencer les développeurs est primordial.

A travers l'évènement de Montréal, et au moment où AMD s'apprête à lancer un nouveau GPU, Nvidia tient ainsi à rappeler son attachement au jeu PC et à expliquer que "The Way It's Meant To Be Played" est plus que ce logo agaçant que les joueurs s'efforcent de passer le plus vite possible au démarrage de leurs jeux. Si le côté business, notamment avec des accords de co-marketing, représente une partie importante de ce programme, Nvidia affirme que son objectif principal est le support technique aux développeurs.

Tony Tamasi, SVP Content and Technology de Nvidia, est au volant du programme GameWorks.

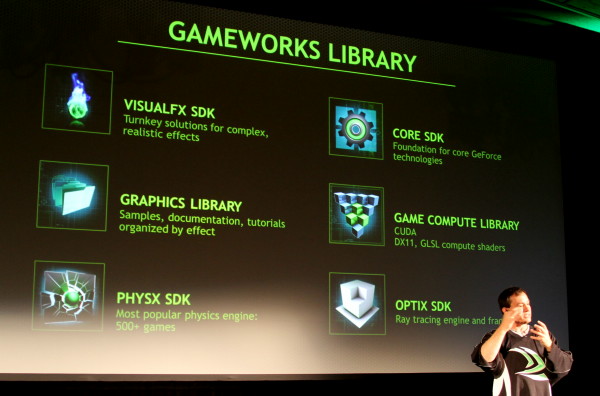

Pour mettre cela en avant, Nvidia vient de créer une marque qui englobe son programme pour les développeurs de jeux vidéo : GameWorks. Selon le concepteur des GPU GeForce, GameWorks représente pas moins de 300 de ses ingénieurs spécialisés dans le rendu 3D temps-réel, un effectif décrit comme largement supérieur à celui de la concurrence (qui nous a indiqué ne pas vouloir rentrer dans une guerre des chiffres). Tous ne sont cependant pas focalisés sur le jeu PC puisqu'une partie de ces ingénieurs travaillent également sur d'autres plateformes telles qu'Android et Tegra.

Ces ingénieurs développent de nouvelles techniques de rendu, des outils d'analyse ou encore peuvent être envoyés en renfort pendant quelques temps directement dans les studios de développement de jeux vidéo pour aider à l'optimisation ou à l'intégration de certains effets graphiques. GameWorks englobe également la bibliothèque d'effets prêts à l'emploi (HBAO), d'API (PhysX, OptiX) et d'outils divers proposés par Nvidia.

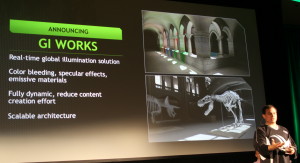

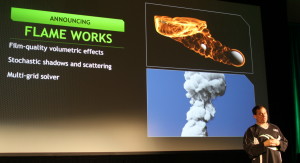

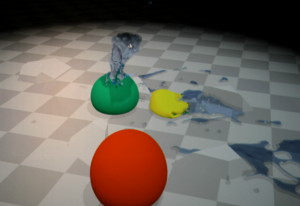

Cette bibliothèque vient d'ailleurs de s'enrichir, 3 nouveautés ayant été annoncées à Montréal. La première se nomme GI Works et est un module d'illumination globale relativement souple dans ses possibilités et bien entendu optimisé pour tourner en temps-réel sur GPU. Au vu des performances affichées par la démonstration de Nvidia, il semble cependant rester très gourmand pour les GPU actuels. Ensuite, Flame Works est un algorithme de rendu des flammes de type volumétrique qui permet une interaction réaliste avec les objets.

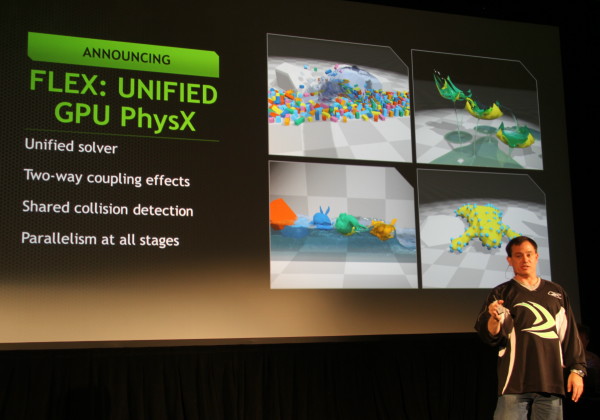

Enfin, et il s'agit sans aucun doute des démonstrations les plus intéressantes qui ont été faites par Nvidia, la partie accélérée par GPU de PhysX évolue avec l'arrivée d'un nouveau module : FLEX. Celui-ci permet de combiner ensemble différents effets physique qui devaient jusqu'ici être traités dans des "mondes" distincts avec des possibilités d'interactions très limitées. Avec FLEX, un effet de particules peut interagir avec un effet de vêtements ou avec des corps solides et mous d'une manière très réaliste. L'exemple le plus frappant et celui de ballons remplis d'eau qu'il est possible de faire exploser pour qu'ils se vident de leur liquide en respectant les lois physiques, certes simplifiées, exploitées par l'API de Nvidia. Impressionnant sur le plan des possibilités que cela pourrait ouvrir.

Malheureusement, FLEX comme tout ce qui concerne GPU PhysX reste propriétaire et accéléré uniquement par les GeForce, ce qui fait que les débouchés potentiels se limitent à quelques effets visuels accessoires au gameplay. De quoi profiter d'options exclusives dans 2 jeux chaque année, mais pas de quoi faire réellement évoluer la physique dans les jeux, ce qui est dommage tant on sent qu'on s'approche de possibilités très intéressantes.

Ces 3 nouvelles technologies pourront permettre au PC, tout du moins quand ils seront équipés de GeForce, de profiter de quelques raffinements graphiques supplémentaires et de se démarquer des consoles. Au vu des différentes présentations de jeux à venir auxquelles nous avons assisté, c'est cependant à travers un autre phénomène que la qualité graphique sur PC va probablement progresser le plus dans les 12 mois à venir : le fait que les développeurs visent les possibilités des consoles "next gen". Une base de rendu plus évoluée, à partir de laquelle travaillent les artistes, est bien entendu nettement plus bénéfique qu'un effet graphique ajouté en fin de développement pour améliorer un tant soit peu le rendu PC.

Assassin's Creed IV qui sortira fin du mois, devrait en être un très bon exemple avec une qualité graphique qui nous a agréablement surpris. Les développeurs d'Ubisoft expliquent avoir voulu placer la barre haut pour en faire un jeu pleinement adapté aux possibilités des nouvelles consoles, et cela se ressent directement. Si la plupart des développeurs font le même effort, le jeu PC, qu'il tourne sur GeForce ou sur Radeon, pourra remercier les PS4 et autres Xbox One.