Les derniers contenus liés au tag Tegra

Afficher sous forme de : Titre | FluxGDC: Nvidia annonce une console Shield pour Android TV

CES: Nvidia Tegra X1: Maxwell + Cortex A57/53

GTC: Tegra: Kit Jetson TK1, SoC Erista en 2015

Focus: Nvidia Tegra K1 et son GPU Kepler : les details

CES: Nvidia annonce Tegra K1, avec Denver en option

AMD annonce la restructuration de RTG

Après le "repos sabbatique" (et le départ) de Raja Koduri, Lisa Su avait annoncé reprendre temporairement la main sur la branche graphique du constructeur.

Hier, AMD a annoncé remettre en place une nouvelle direction pour son Radeon Technology Group, et la première nouvelle est que le nom RTG reste en place. C'est une petite surprise puisque l'un des problèmes qui semblait avoir conduit au départ de Raja Koduri était l'insularité du groupe et la "compétition", pour ne pas dire les relations tendues entre ce groupe et l'activité CPU d'AMD.

AMD dans son communiqué fait fi de ce problème mais il semble qu'une réorganisation interne ait bien eu lieu pour limiter, à défaut de changer les esprits d'un claquement de doigts, les problèmes rencontrés précédemment.

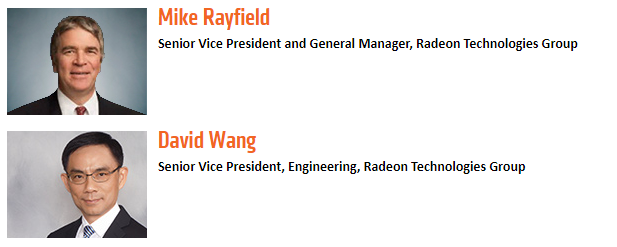

Ce que la société annonce, c'est l'arrivée de deux nouveaux Senior Vice President pour diriger le groupe. D'un point de vue technique d'abord, c'est le retour de David Wang lui aussi ingénieur et qui avait obtenu le titre de Corporate Vice President précédemment chez AMD pour la partie GPU. Il avait rejoint plus récemment Synaptics. Wang dispose de 25 ans d'expérience dans le monde graphique ayant travaillé pour SGI, et ayant fait parti de la (complexe) transition d'ATI vers AMD lors du rachat en 2006. D'un point de vue technique, il a travaillé sur les architectures graphiques d'AMD jusque la première version de GCN. Il aura en charge tous les sujets techniques et stratégiques, que ce soit sur l'architecture, le hardware et la partie logicielle.

La seule chose dont il ne s'occupera pas est la question commerciale et la gestion au jour le jour du groupe, qui sera à la charge de Mike Rayfield. En provenance de Micron, il est surtout connu pour avoir dirigé la division mobile/Tegra de Nvidia. Il sera également en charge des relations commerciales de l'activité "semi-custom" (qui comprend entre autres les ventes de SoC pour les consoles).

Nvidia annonce le SoC Xavier avec GPU Volta

Depuis un peu plus de deux ans, Nvidia s'était abstenu de présenter une roadmap pour ses SoC. Il faut dire que ses plans à ce niveau ont changé à plusieurs reprises, notamment avec l'abandon du marché du smartphone, trop concurrentiel, trop coûteux au niveau de la certification pour les différents réseaux et dans lequel il était difficile de réellement se démarquer en respectant une enveloppe thermique très stricte.

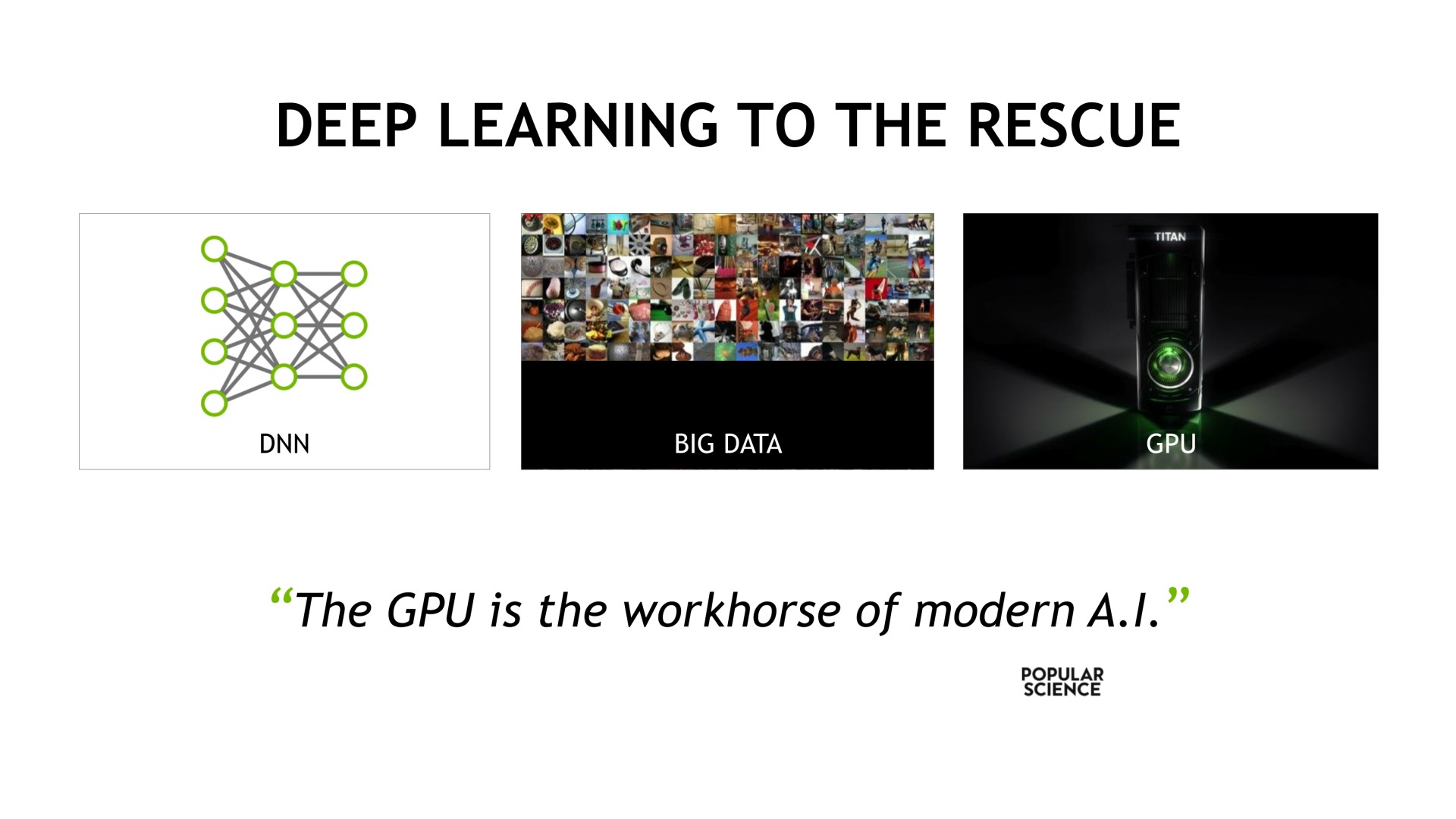

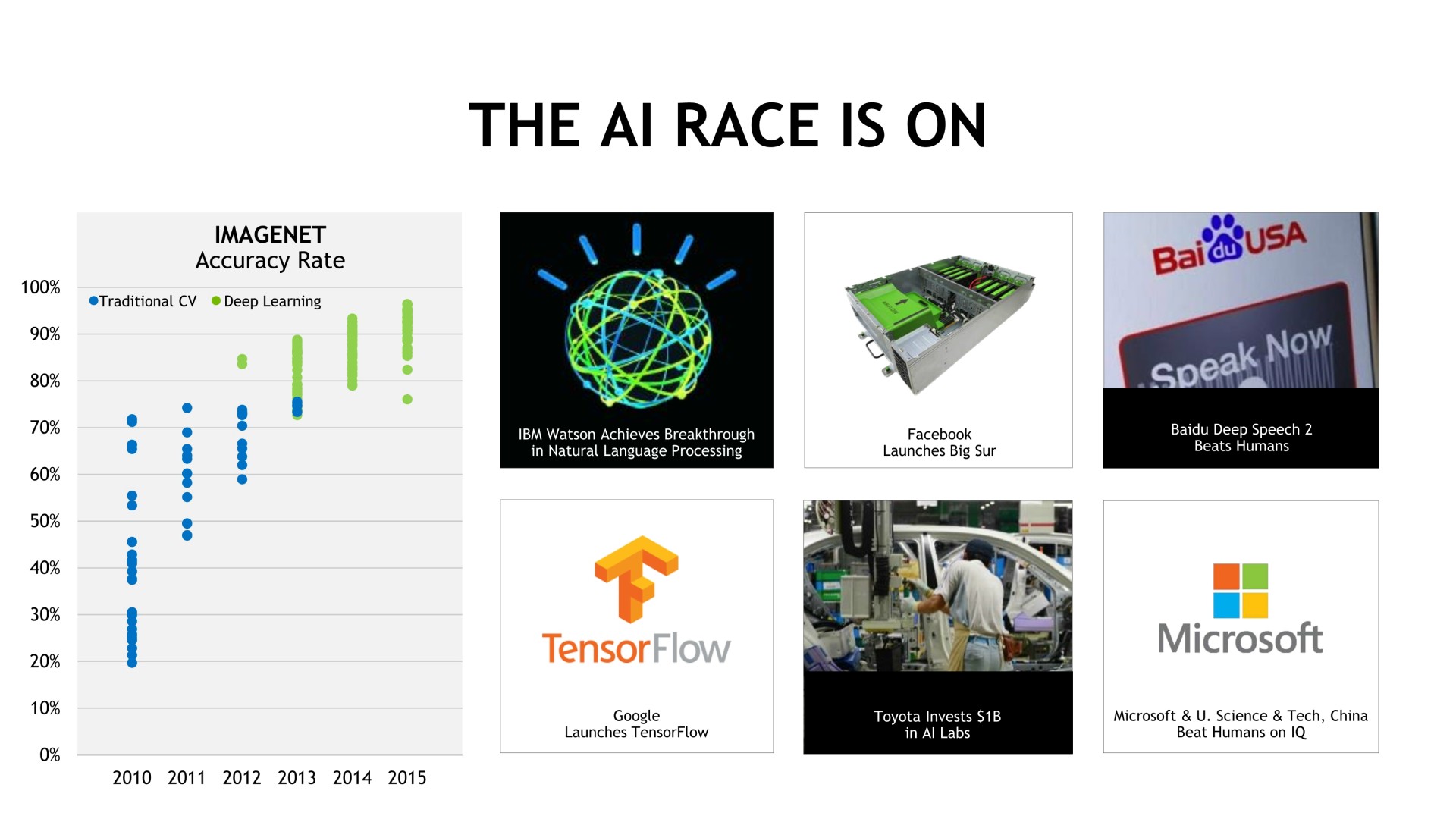

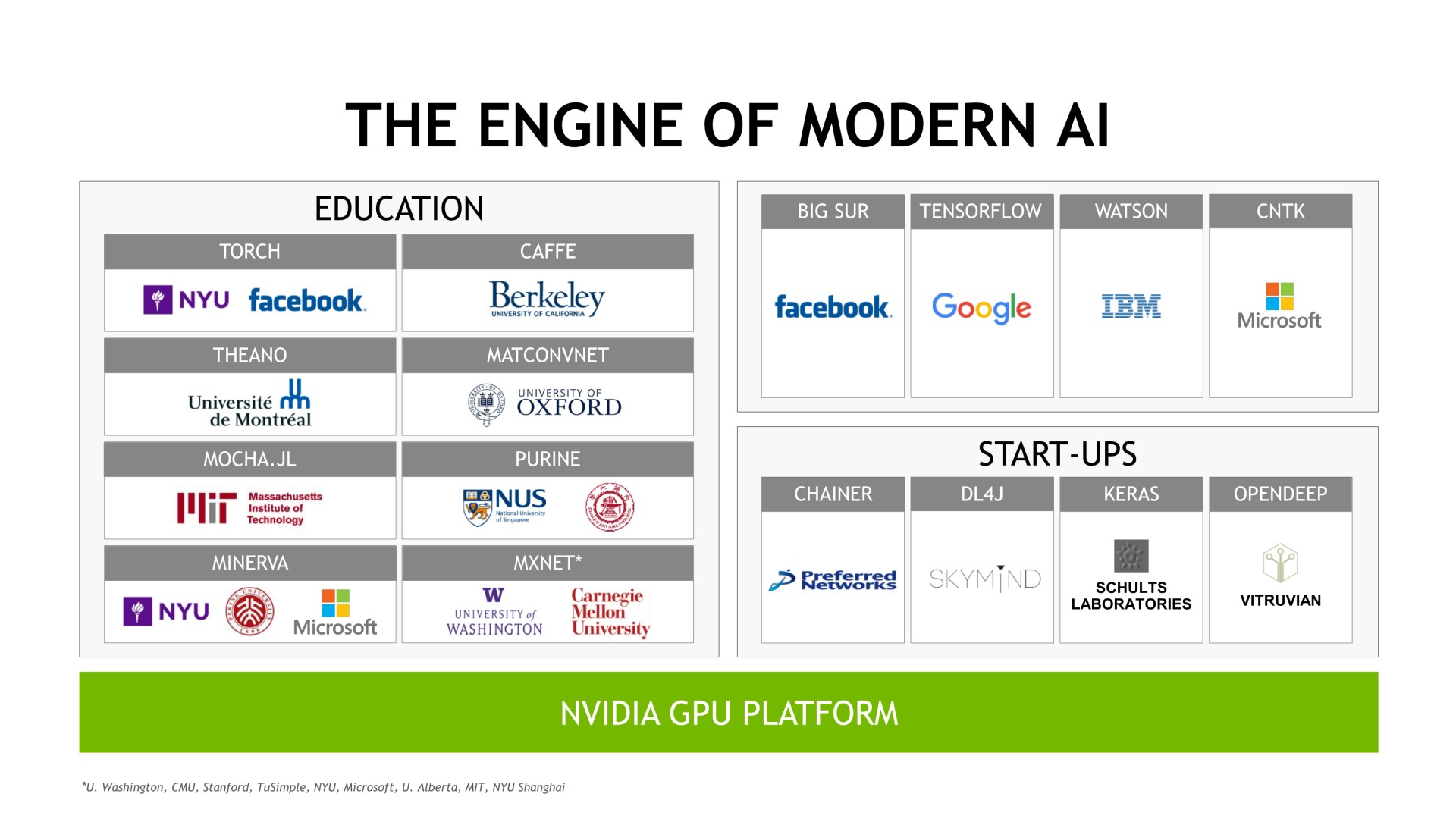

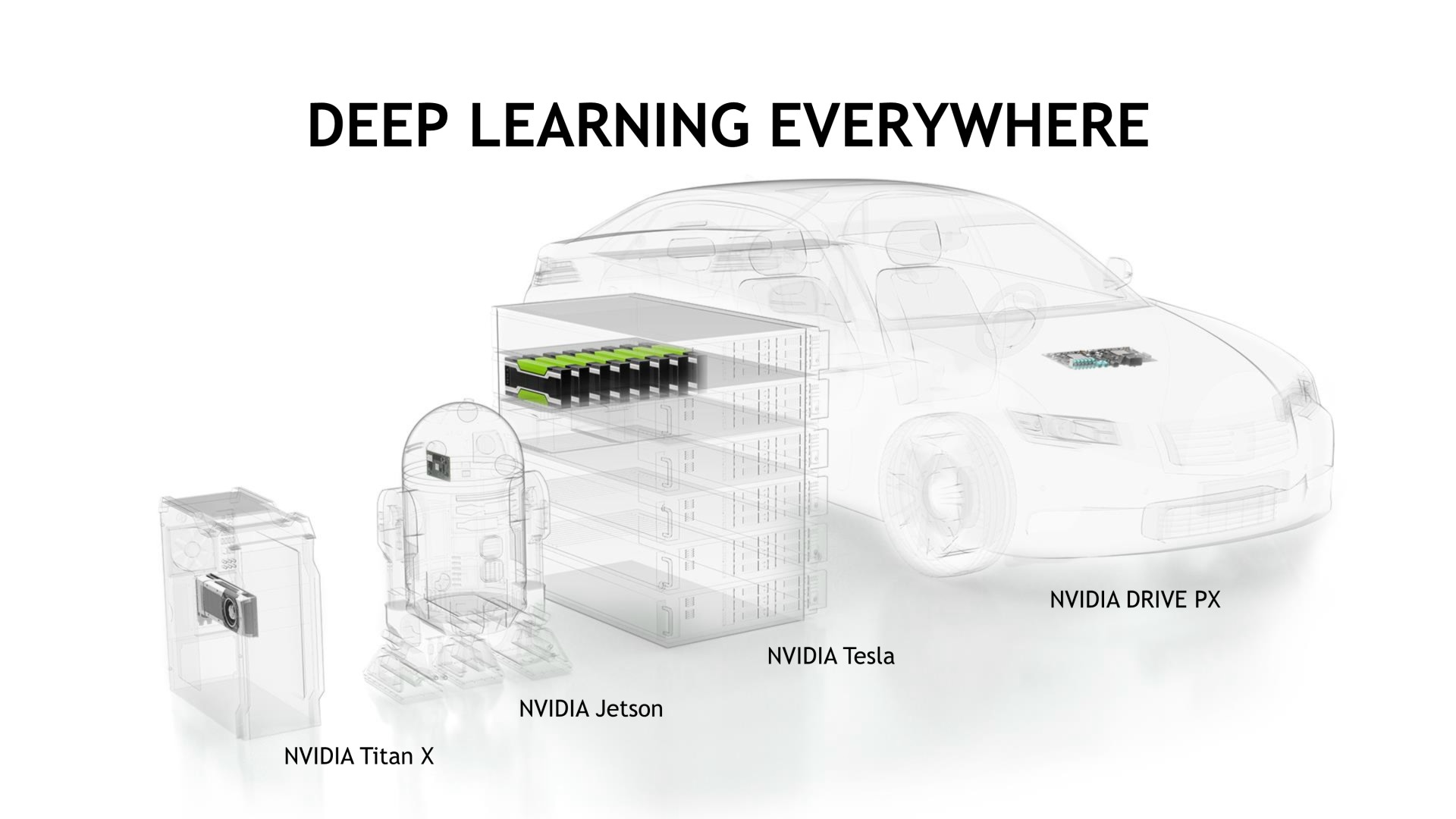

Progressivement, Nvidia a repositionné ses SoC Tegra sur d'autres marchés pour lesquels son expertise peut plus facilement apporter une plus-value. C'est le cas pour la conduite autonome ou pour tout ce qui concerne l'AI et plus précisément l'inférence, soit l'exploitation d'un réseau de neurones artificiels (deep learning). Pour ce type d'utilisation d'un SoC, il est aujourd'hui crucial d'apporter un maximum de performances dans une enveloppe thermique raisonnable mais pas aussi stricte que dans le monde mobile. Par ailleurs, ses gros GPU se sont retrouvés, un peu par hasard au départ, au coeur de l'évolution du deep learning. Une expérience qui a permis à Nvidia de construire un écosystème logiciel efficace et d'apporter de petites touches à ses architectures CPU et GPU qui peuvent avoir un impact crucial sur les performances. Alors que la concurrence s'annonce extrêmement rude pour le deep learning voué à se répandre dans de nombreux secteurs, que ce soit au niveau de l'entraînement des réseaux que de l'inférence, Nvidia conserve donc une bonne carte à jouer à condition de soutenir une cadence élevée dans ses développements.

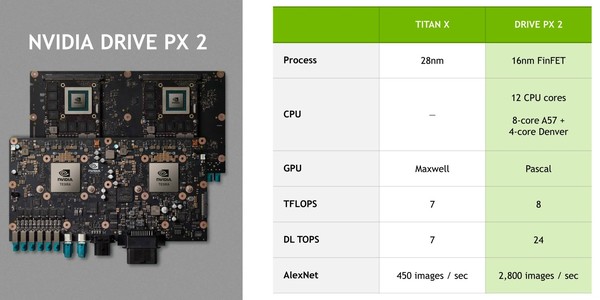

Il y a tout juste un mois, Nvidia dévoilait ainsi quelques détails sur son SoC Parker fabriqué en 16nm. Celui-ci va succéder d'ici quelques temps aux SoC Logan (Tegra K1) et Erista (Tegra X1) avec une claire orientation pour le marché automobile. Il est pour rappel équipé d'une partie CPU composée de 2 coeurs maison Denver 2 et de 4 coeurs Cortex-A57 associés à un GPU Pascal de 256 unités de calcul (2 SM), le tout étant interfacé en 128-bit LPDDR4.

Pour le marché automobile, il supporte notamment des instructions spécifiques au deep learning (pour booster certaines opérations en INT8 / FP16), la mémoire ECC, la virtualisation hardware, 12 caméras et une connectique adaptée. La première utilisation de Parker se fera dans la plateforme Drive PX 2 dérivée en deux versions. L'une se contente d'un seul SoC Parker et est dédiée aux aides à la conduite simples, l'autre associe 2 SoC Parker et 2 GPU GP106 pour une conduite semi-autonome alors que Nvidia parle d'associer plusieurs de ces plateformes pour une conduite totalement autonome. De quoi démontrer au passage le besoin de plateformes plus performantes encore.

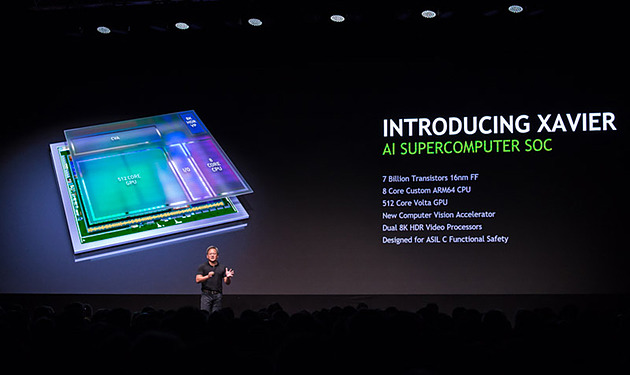

C'est là qu'intervient le successeur de Parker dont le nom de code est Xavier, en référence au super-héros. Dévoilé à l'occasion de la première édition de la GTC Europe qui se tient actuellement à Amsterdam, Xavier sera basé sur 8 coeurs ARM custom (Denver 3 ?) et un GPU Volta de 512 unités de calcul avec un moteur vidéo capable de travailler en 8K. Toujours fabriqué en 16nm, il embarquera pas moins de 7 milliards de transistors, ce qui est énorme pour un SoC. Nvidia vise une puissance de calcul de pas moins de 20 téraops en deep learning pour une enveloppe thermique de 20W.

De quoi potentiellement remplacer une plateforme Drive PX 2 complète par un simple SoC (ce que Nvidia illustre par la version simple de Drive PX 2 pour l'aide à la conduite, il n'y a actuellement aucune vraie photo de Xavier ou de la plateforme qui l'accueille). Reste bien entendu qu'il y a une astuce et que cette valeur de 20 téraops est un maximum obtenu sur des instructions spécifiques. Avec 512 unités de calcul cadencées par exemple à 2 GHz, Xavier affichera une puissance de +/- 2 téraflops en FP32 (contre 8 téraflops pour Drive PX 2). Se contenter des instructions INT8 de Pascal ne permettrait de monter qu'à 8 téraops en deep learning (contre 24 téraops pour Drive PX 2).

En annonçant 20 téraops, Nvidia dévoile donc que l'architecture GPU Volta apportera de nouvelles évolutions qui donneront un coup de boost significatif à certains algorithmes liés au deep learning et de toute évidence à l'inférence. Précision de calcul inférieure à 8-bit ? De nouvelles instructions spécifiques équivalentes à plus d'ops ? Il faudra encore patienter quelques temps avant d'en savoir plus. Nvidia prévoit un premier échantillonnage de Xavier fin 2017 pour une disponibilité commerciale en 2018. D'ici-là les premiers GPU Volta devraient avoir été lancés.

Accord de licence Nvidia-Samsung

En 2013, Nvidia avait commencé à parler de proposer des licences pour ses technologies. Quelque chose que nous avions interprété, logiquement, en la volonté pour Nvidia de proposer des blocs d'IP pour les autres fabricants de SoC ARM. L'écosystème ARM fonctionne pour rappel sur un modèle ouvert, un designer de SoC comme Mediatek piochant dans le catalogue des différents acteurs, ARM proposant par exemple de nombreux cores CPU - les Cortex - mais aussi des GPU - les Mali - des interconnexions et des contrôleurs mémoires, tandis que d'autres comme Imagination Technologies proposent plus spécifiquement des GPU (les PowerVR). Le designer de SoC assemble ces blocs (payant les licences nécessaires), parfois avec des blocs d'IP propres pour terminer son design de puce, qui sera fabriqué chez un fondeur tiers comme TSMC par exemple.

En 2013, Nvidia avait commencé à parler de proposer des licences pour ses technologies. Quelque chose que nous avions interprété, logiquement, en la volonté pour Nvidia de proposer des blocs d'IP pour les autres fabricants de SoC ARM. L'écosystème ARM fonctionne pour rappel sur un modèle ouvert, un designer de SoC comme Mediatek piochant dans le catalogue des différents acteurs, ARM proposant par exemple de nombreux cores CPU - les Cortex - mais aussi des GPU - les Mali - des interconnexions et des contrôleurs mémoires, tandis que d'autres comme Imagination Technologies proposent plus spécifiquement des GPU (les PowerVR). Le designer de SoC assemble ces blocs (payant les licences nécessaires), parfois avec des blocs d'IP propres pour terminer son design de puce, qui sera fabriqué chez un fondeur tiers comme TSMC par exemple.

Nvidia proposait à l'époque ses SoC Tegra en accolant des blocs CPU développés par ARM à ses propres blocs GPU GeForce. Les dernières générations avaient cependant reçu un accueil frileux auprès des constructeurs de smartphones et de tablettes, le marché des SoC étant excessivement compétitif (Depuis, Nvidia s'est recentré en fabricant ses propres produits et en visant le marché automobile ou les contraintes de puissance, souvent pointés comme problématiques, sont moins importantes). Le nom officieux de la licence (« licence kepler ») semblait confirmer la volonté de Nvidia.

En coulisse cependant, Nvidia tentait de négocier un tout autre type d'accord auprès des constructeurs de SoC, souhaitant obtenir des royalties pour des brevets qu'ils jugeaient essentiels à la création de GPU, et qu'ils pensaient enfreints par leurs concurrents. Une stratégie lucrative dans le mobile lorsqu'elle réussit, on sait par exemple que Microsoft obtient de chaque constructeur de smartphone Android des royalties (un montant variable estimé à 3.41 dollars pour Samsung en 2013, et 5 dollars pour HTC ) pour certaines de ses technologies (comme le système de fichiers FAT32, plus de 310 brevets sont concernés d'après une liste ayant fuité en 2014 ).

Dans le cas de Nvidia, les négociations ont été infructueuses (et coûteuses, on notera par exemple qu'à compter de cette période, les GPU Nvidia ont complètement disparus des gammes Apple) qui ont culminé en septembre 2014 par un dépôt de plainte de Nvidia auprès de l'ITC (U.S. International Trade Commission). Cette plainte envers Samsung et Qualcomm demandait le retrait du marché américain de produits qui enfreignaient, selon Nvidia, leurs brevets.

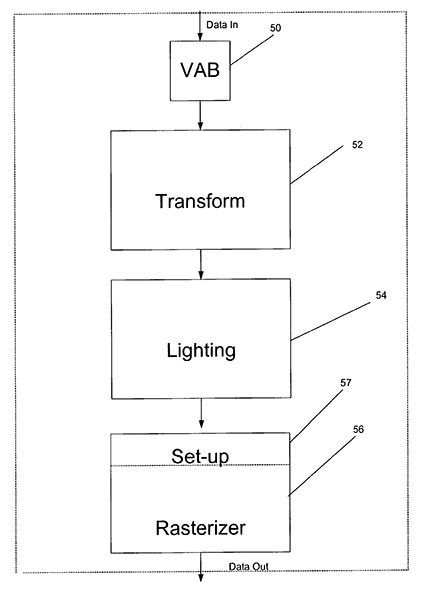

Un des brevets "essentiels" de Nvidia concernait le Transform&Lighting, une technologie ayant disparue des GPU modernes

En octobre 2015, l'ITC avait statué de manière défavorable sur la plainte de Nvidia, un jugement que nous vous avions relaté en détail dans cet article. Le résultat de ce jugement avait été entériné définitivement en décembre : ni Samsung, ni Qualcomm, n'enfreignaient les brevets de Nvidia.

Bien que Samsung et Qualcomm étaient directement visés (parce qu'ils produisent les SoC et que ces derniers étaient visés par l'interdiction d'importation), techniquement ce sont les GPU ARM (Mali), Imagination Technologies (PowerVR) et Adreno (Qualcomm) qui enfreignaient potentiellement les brevets. Ce jugement empêche donc toute procédure du type de la part de Nvidia contre d'autres fabricants de SoC qui utiliseraient ces mêmes coeurs graphiques.

Conséquences coûteuses

En parallèle, Samsung avait bien évidemment contre attaqué Nvidia (et l'un de ses clients, Velocity Micro) auprès de l'ITC (la plainte est ici ). En décembre dernier, nos confrères de Bloomberg rapportaient que l'ITC avait jugé en première instance que trois brevets de Samsung avaient été enfreints par Nvidia.

Un jugement définitif était attendu hier, pouvant entraîner dans la foulée une interdiction d'importation aux états unis de produits Nvidia. Cependant, comme le relate une fois de plus Bloomberg , quelques heures avant l'annonce définitive de l'ITC, Nvidia et Samsung ont annoncé un accord croisé de licence mettant un terme à leurs différentes procédures. Le communiqué est particulièrement avare en détails, indiquant simplement qu'il se limite à quelques brevets (il ne s'agit pas d'un accord de licence croisé « large ») et qu'il n'y aurait pas eu de compensation additionnelle (comprendre financière) en contrepartie. Etant donné la position de faiblesse de Nvidia au moment de la négociation, on imagine que d'autres concessions ont été faites, mais ces dernières resteront, d'après le communiqué, secrètes.

Il était bien évidemment dans l'intérêt de Nvidia d'éviter un retrait du marché de ses produits. La plainte originale visait spécifiquement les tablettes Nvidia Shield, même si Samsung avait étendu le cadre de sa plainte à Biostar et ECS (on ne sait pas exactement pour quels produits). Nvidia va également pouvoir tourner la page de cette stratégie de « licence kepler » mal pensée dès l'origine.

Pour Samsung, dont le département légal est rôdé, la normalisation des relations entre les deux sociétés sera une bonne chose, d'autant que Nvidia semble travailler avec Samsung Foundries pour produire certaines de ses puces, quelque chose qui avait été noté dans un document administratif l'année dernière. Bien évidemment, Samsung Foundries a longtemps produit des puces pour Apple tout en entretenant des relations légales hautement conflictuelles, même si là aussi, ces deux dernières années, les deux sociétés ont progressivement normalisé leurs relations .

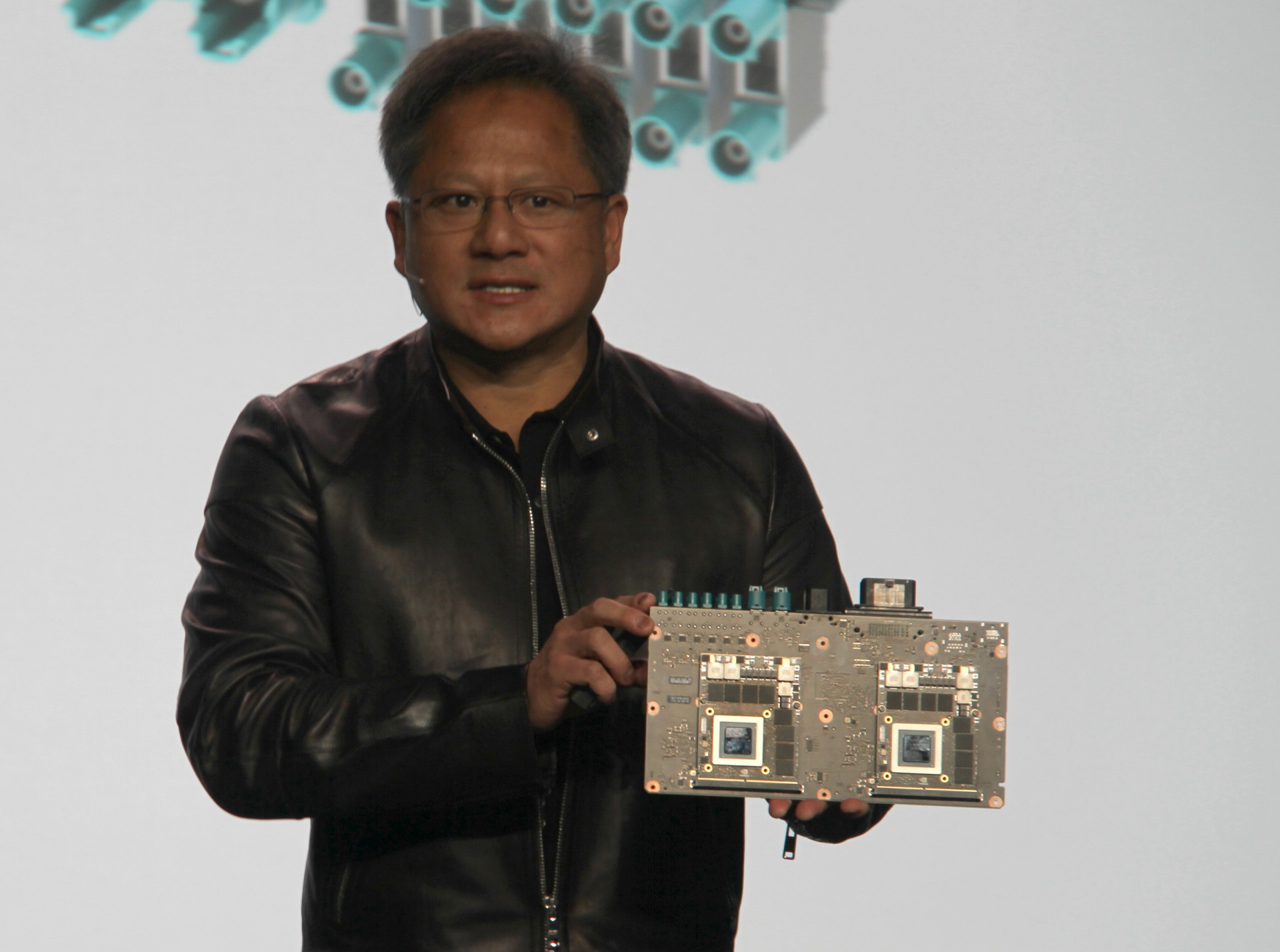

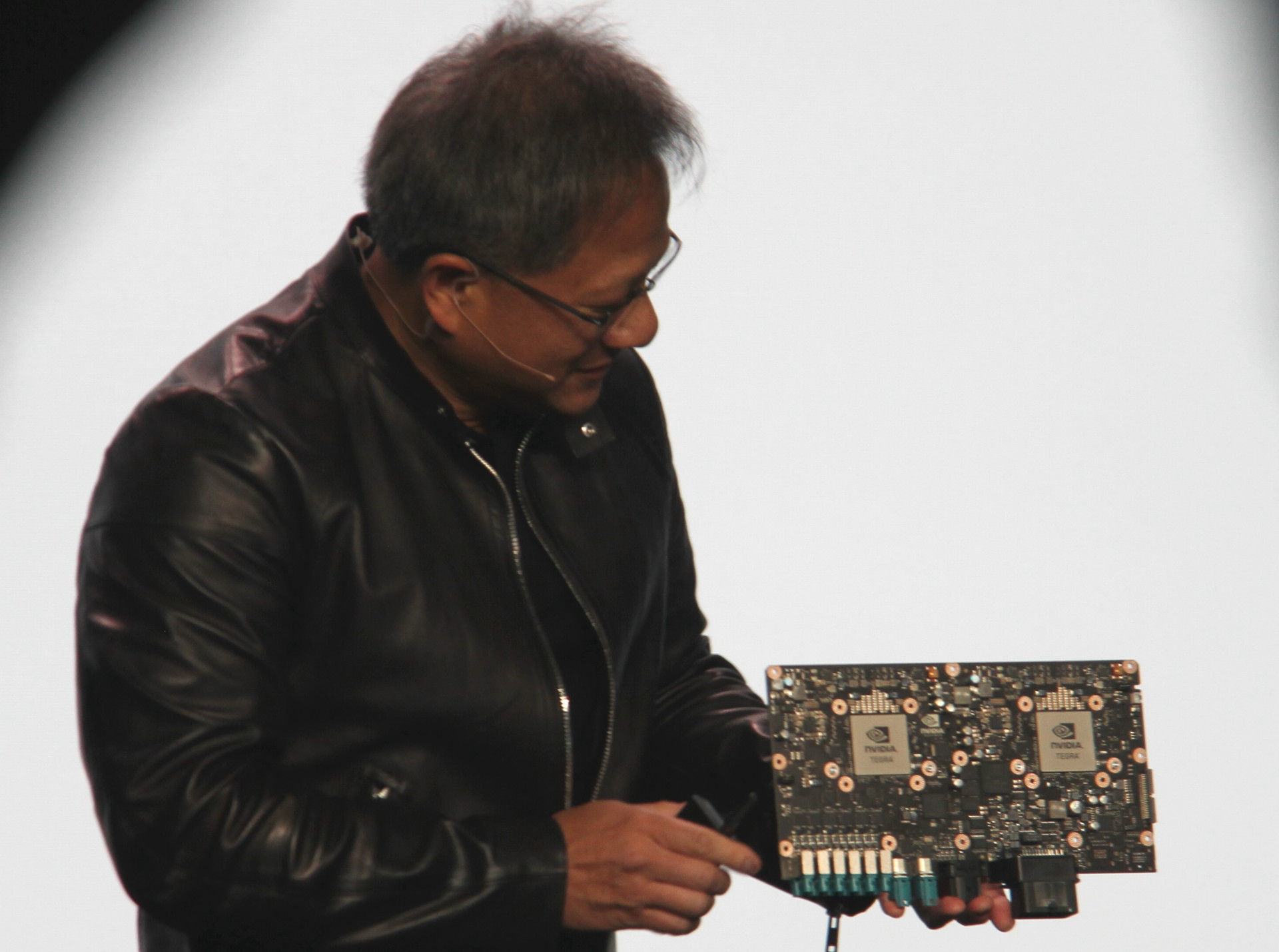

CES: Drive PX 2: Tegra et Pascal au pilotage

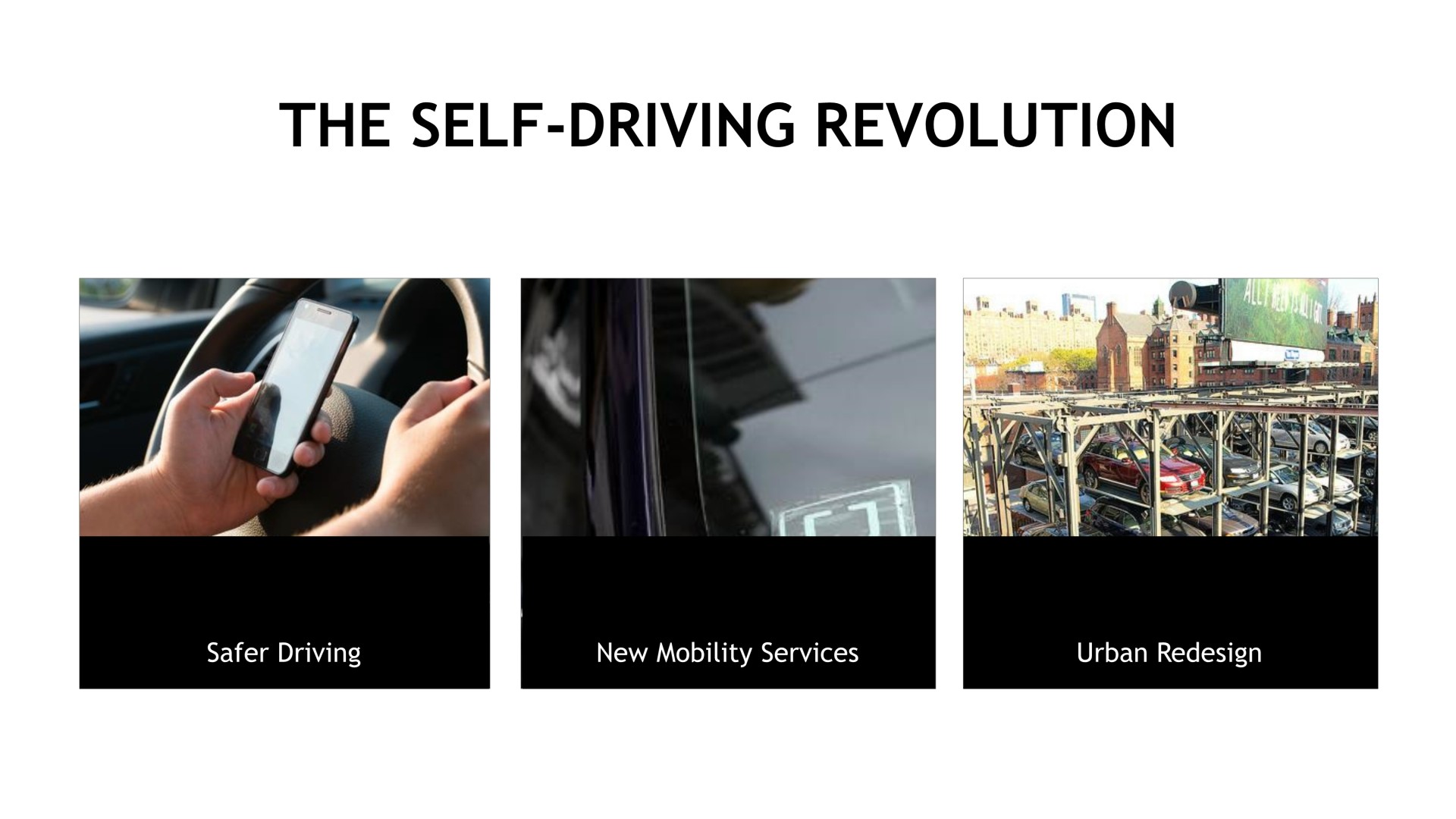

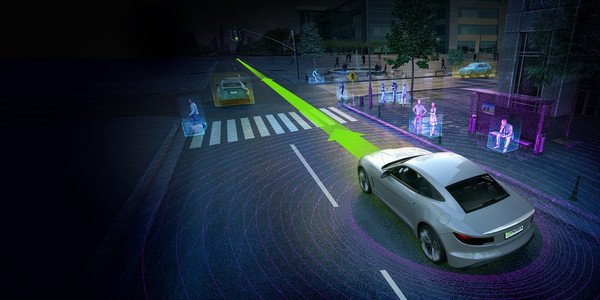

Comme l'an passé, Nvidia a consacré sa traditionnelle conférence du CES au marché automobile pour lequel la société nourrit d'importantes ambitions, notamment en ce qui concerne la conduite autonome. Traditionnellement tournée autour du SoC Tegra, cette conférence du CES a progressivement évolué des smartphones et tablettes vers l'automobile au fur et à mesure que Nvidia repositionnait ses SoC.

Probablement arrivé sur ce marché un petit peu par hasard, Nvidia en a rapidement déduit le potentiel énorme, d'autant plus face à l'échec des SoC Tegra dans le monde des smartphones. Au départ, Nvidia s'est attaqué aux systèmes multimédia et d'affichage embarqués qui peuvent profiter de son expertise au niveau graphique et vidéo. Avec à la clé quelques succès pour les SoC Tegra, mais insuffisants pour justifier tous les efforts nécessaires à la conception de telles puces. Toujours à la recherche de marchés à plus forte valeur ajoutée, se battre sur les prix avec d'autres acteurs tels que TI et depuis peu Qualcomm ne fait pas partie de sa stratégie, Nvidia se concentre dorénavant en priorité à la conduite autonome.

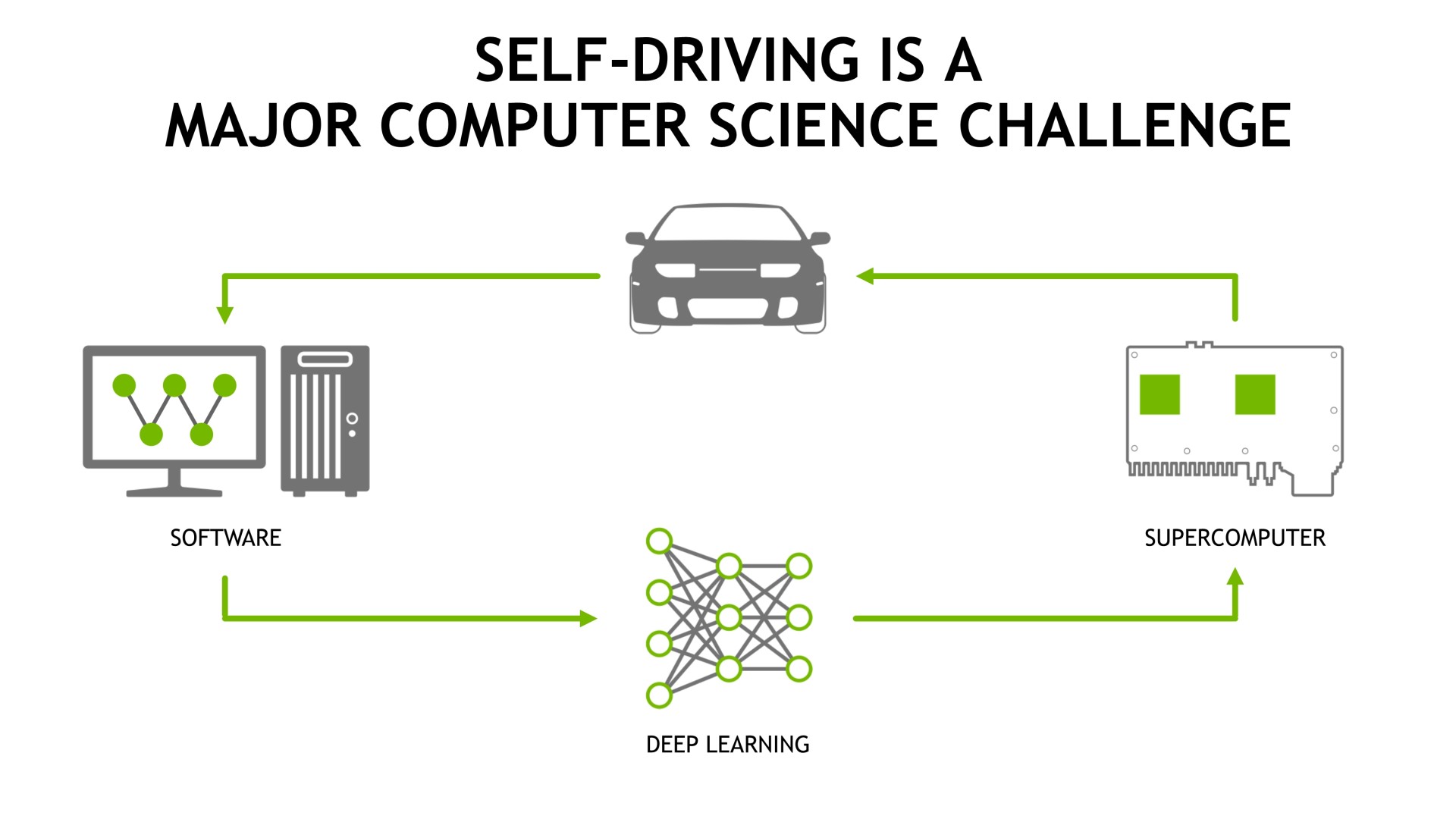

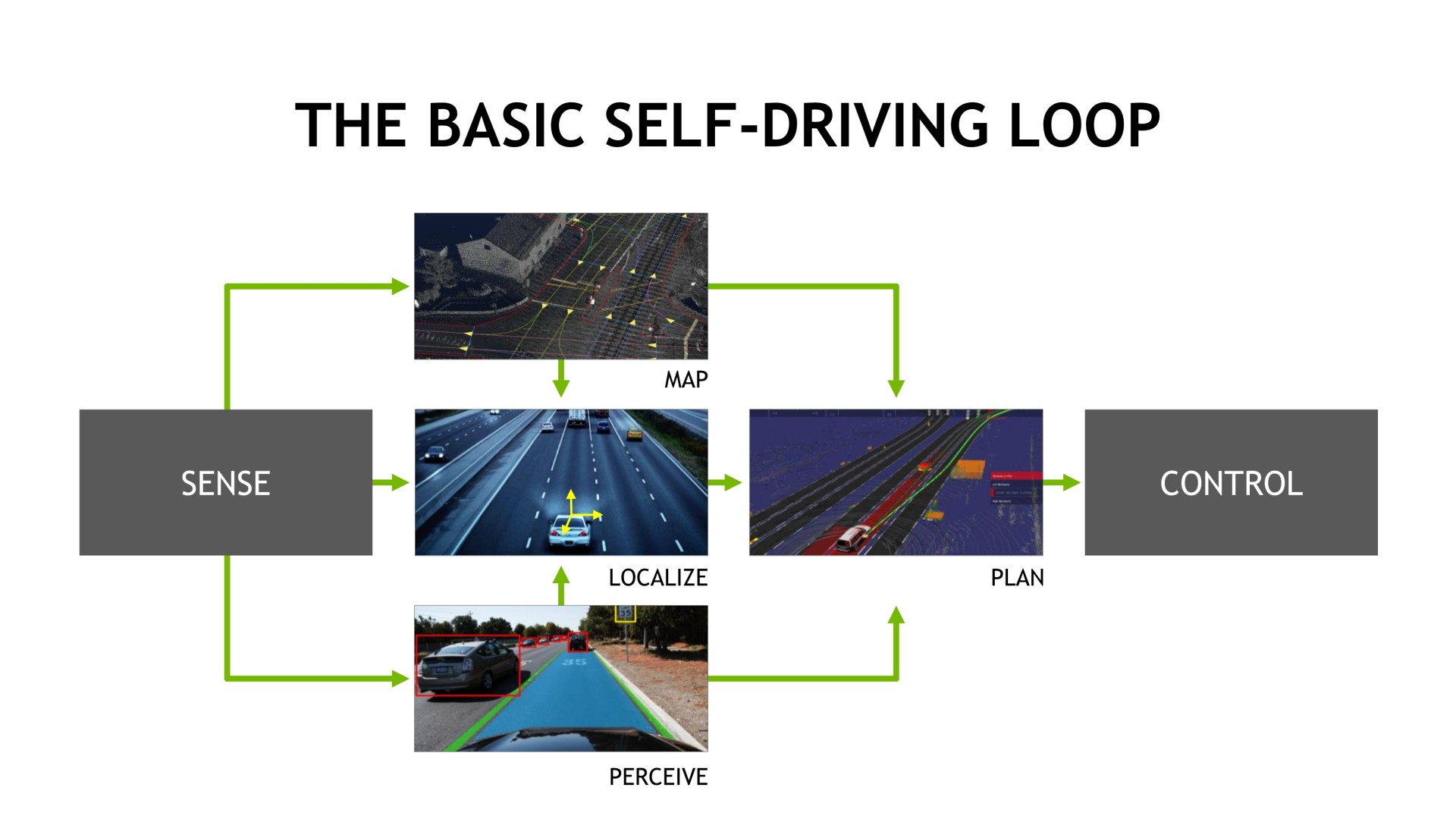

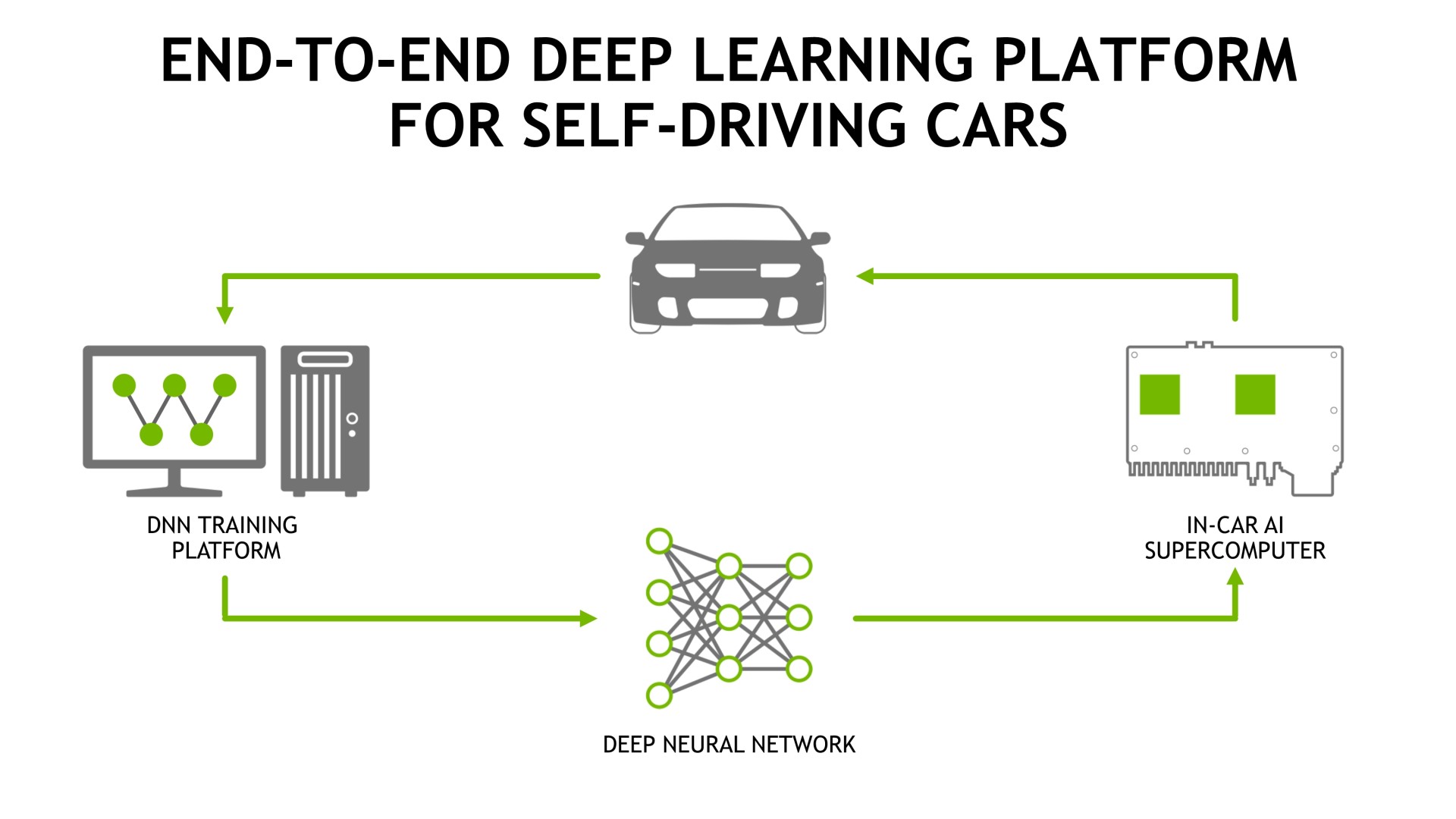

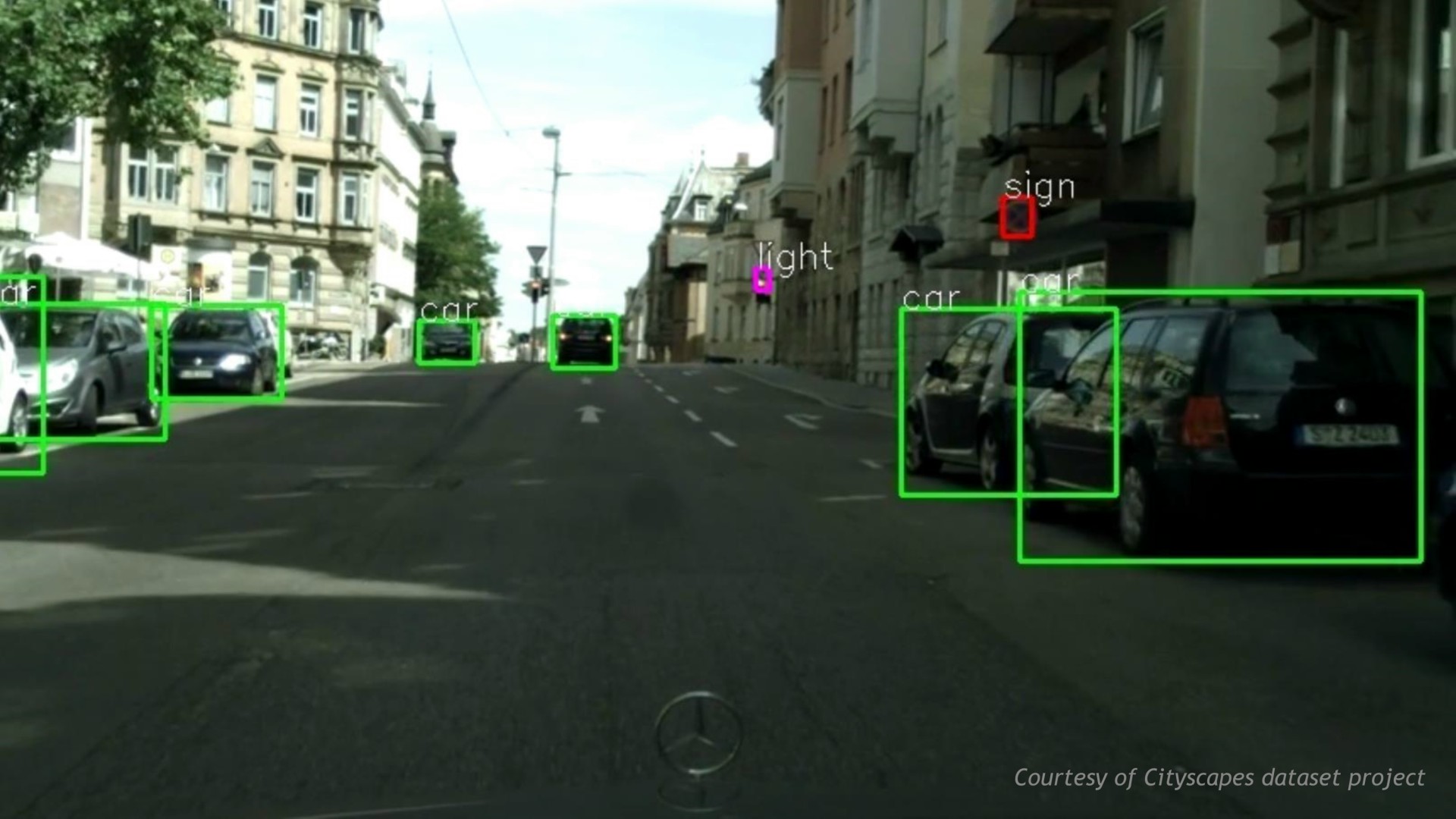

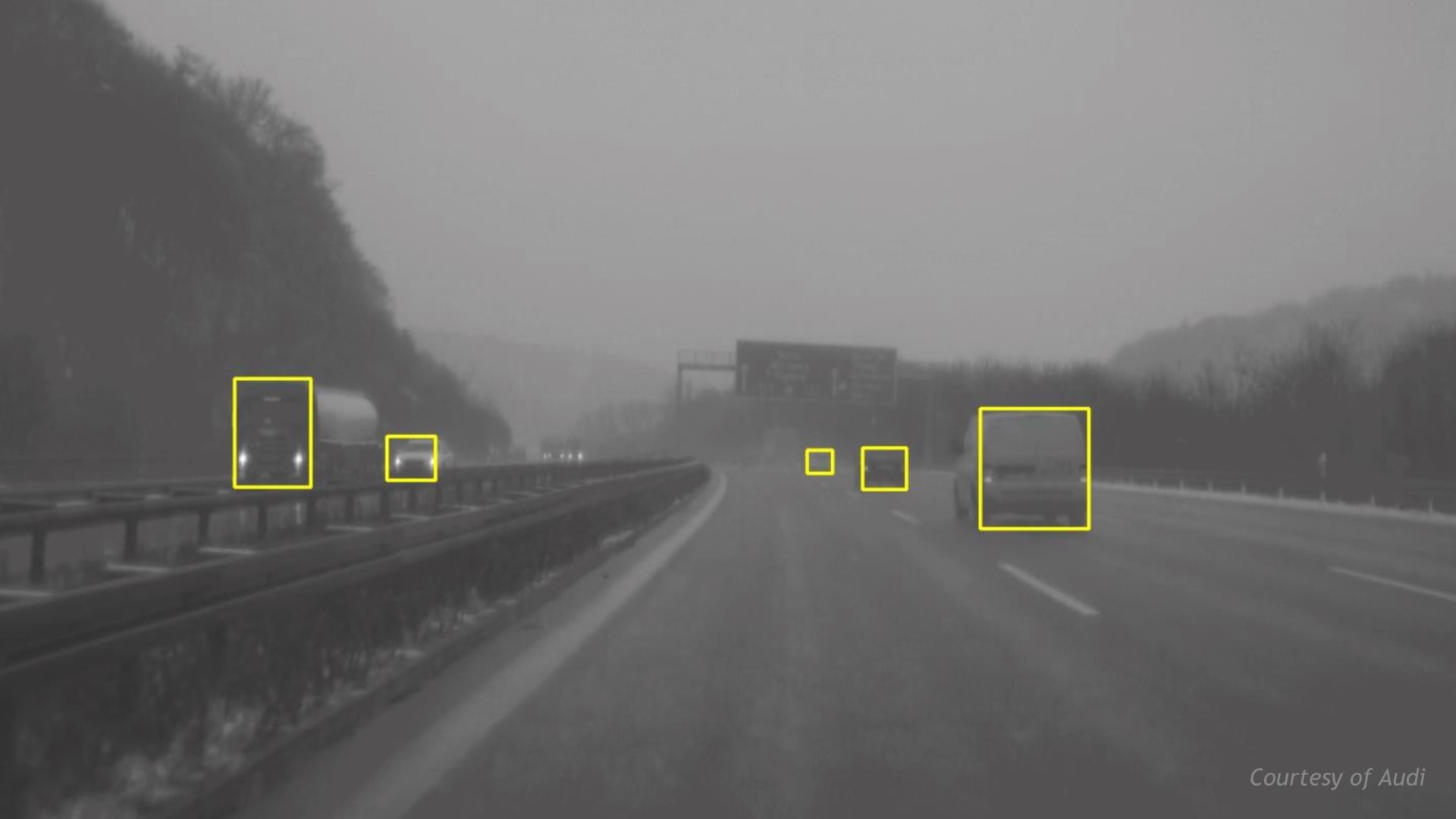

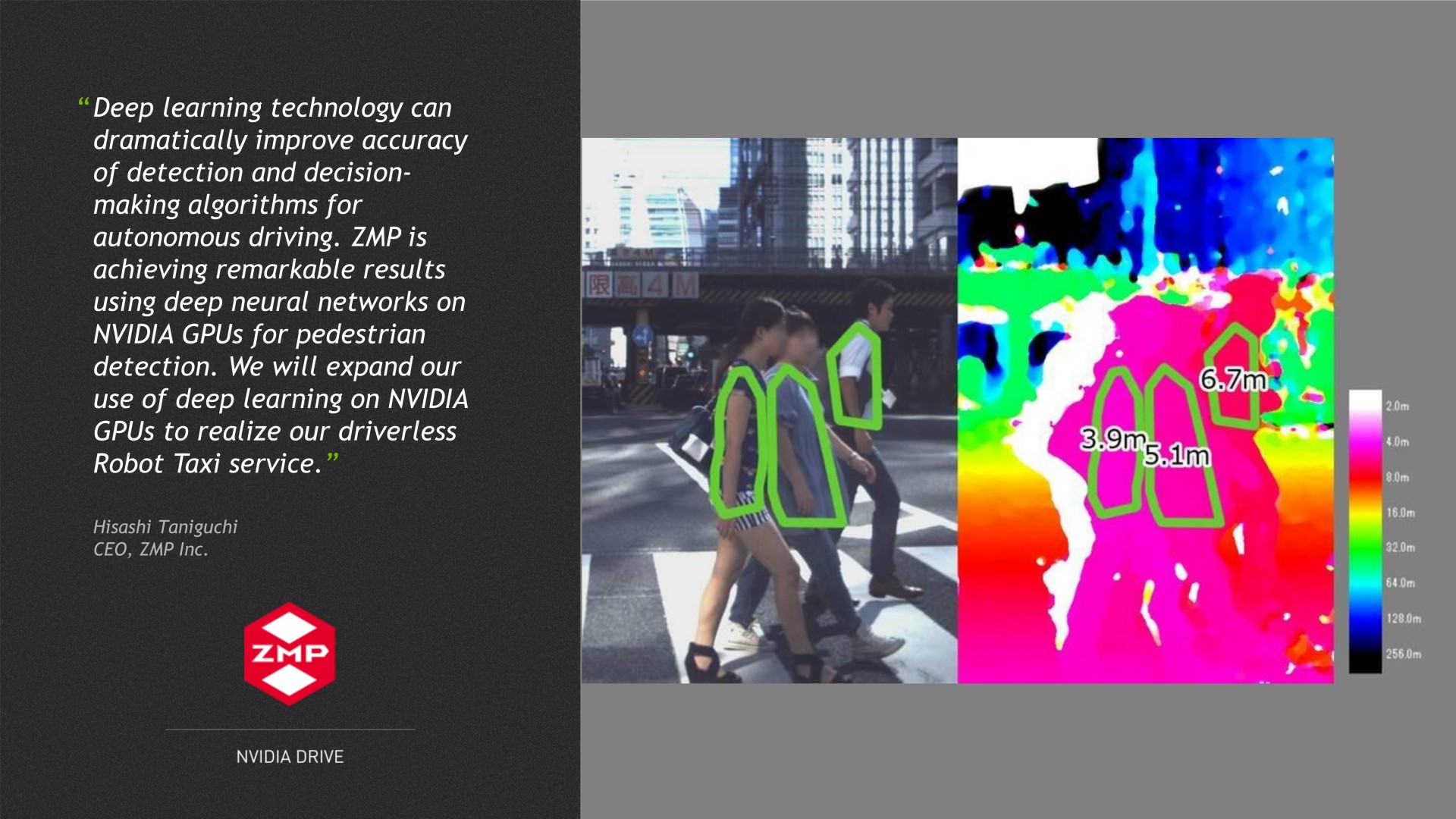

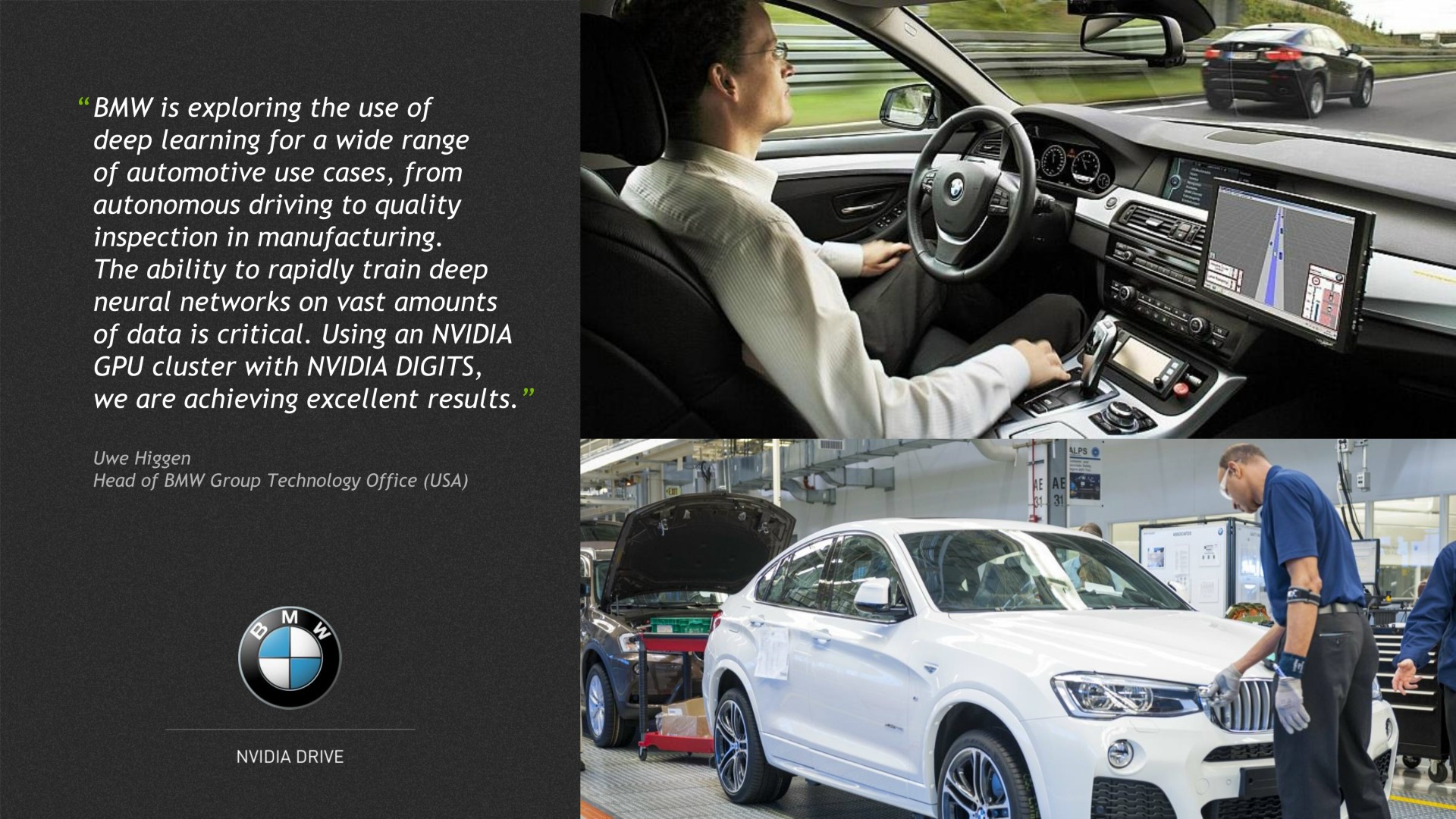

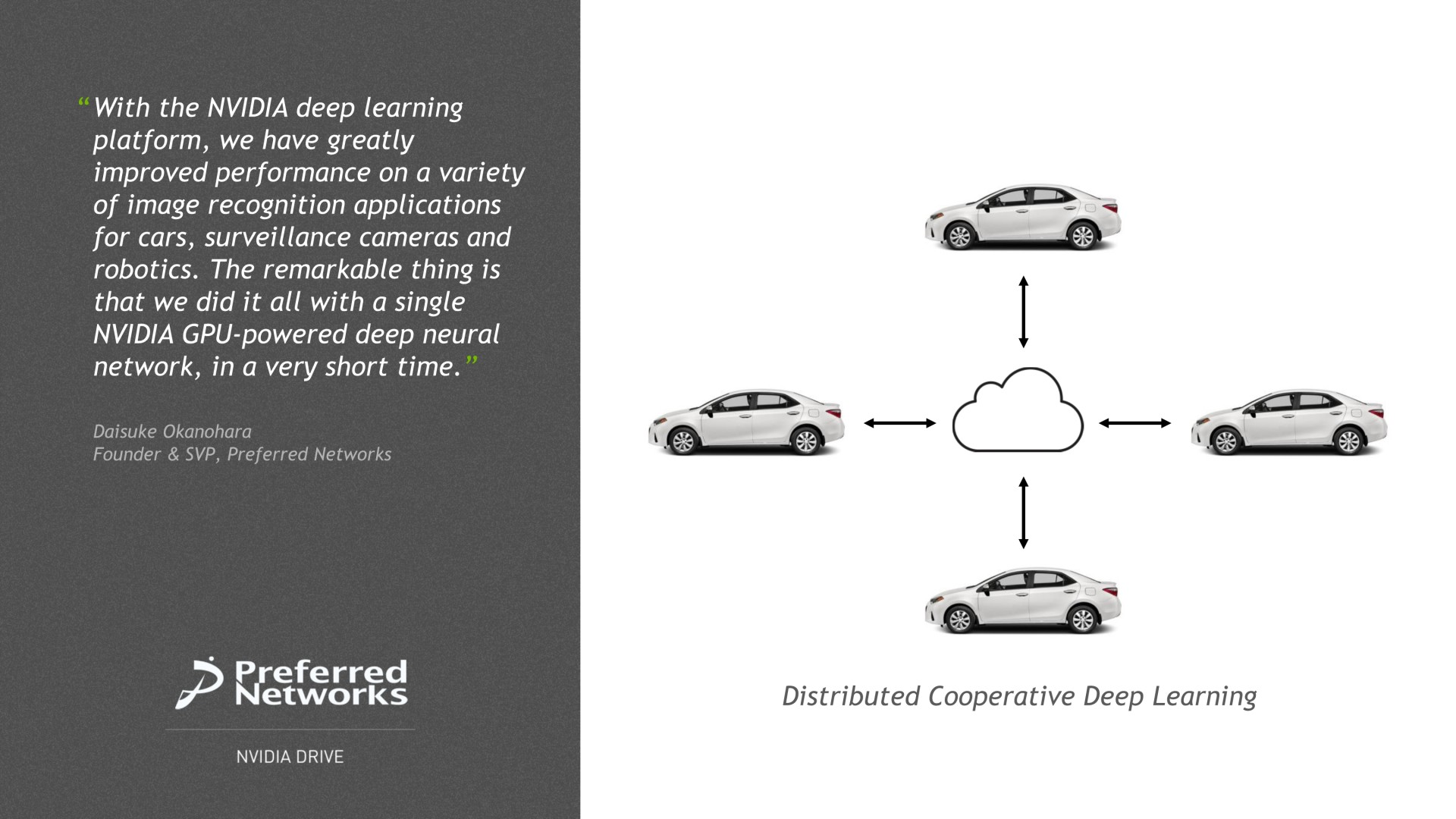

Cet aspect de l'évolution entreprise dans le monde des transports a d'une part besoin de plus de puissance de calcul et d'autre part d'une expertise dans le domaine du deep learning, soit de l'apprentissage progressif par un réseau de neurones artificiels (ce qui fonctionne extrêmement bien dans le cas de la reconnaissance d'éléments à l'intérieur d'une série d'images). Deux points pour lesquels Nvidia peut compter sur ses technologies et ses ingénieurs pour essayer de se démarquer.

L'an passé, Nvidia a ainsi annoncé Drive PX, une plateforme de pilotage automatique bâtie autour de 2 SoC Tegra X1. Mais comme c'est devenu une tradition avec ces SoC, plusieurs annonces annuelles successives sont nécessaires avant que des résultats n'émergent éventuellement. Drive PX n'aura donc pas réellement d'existence commerciale et se contentera des rôles de kit de développement et d'illustration de la stratégie de Nvidia.

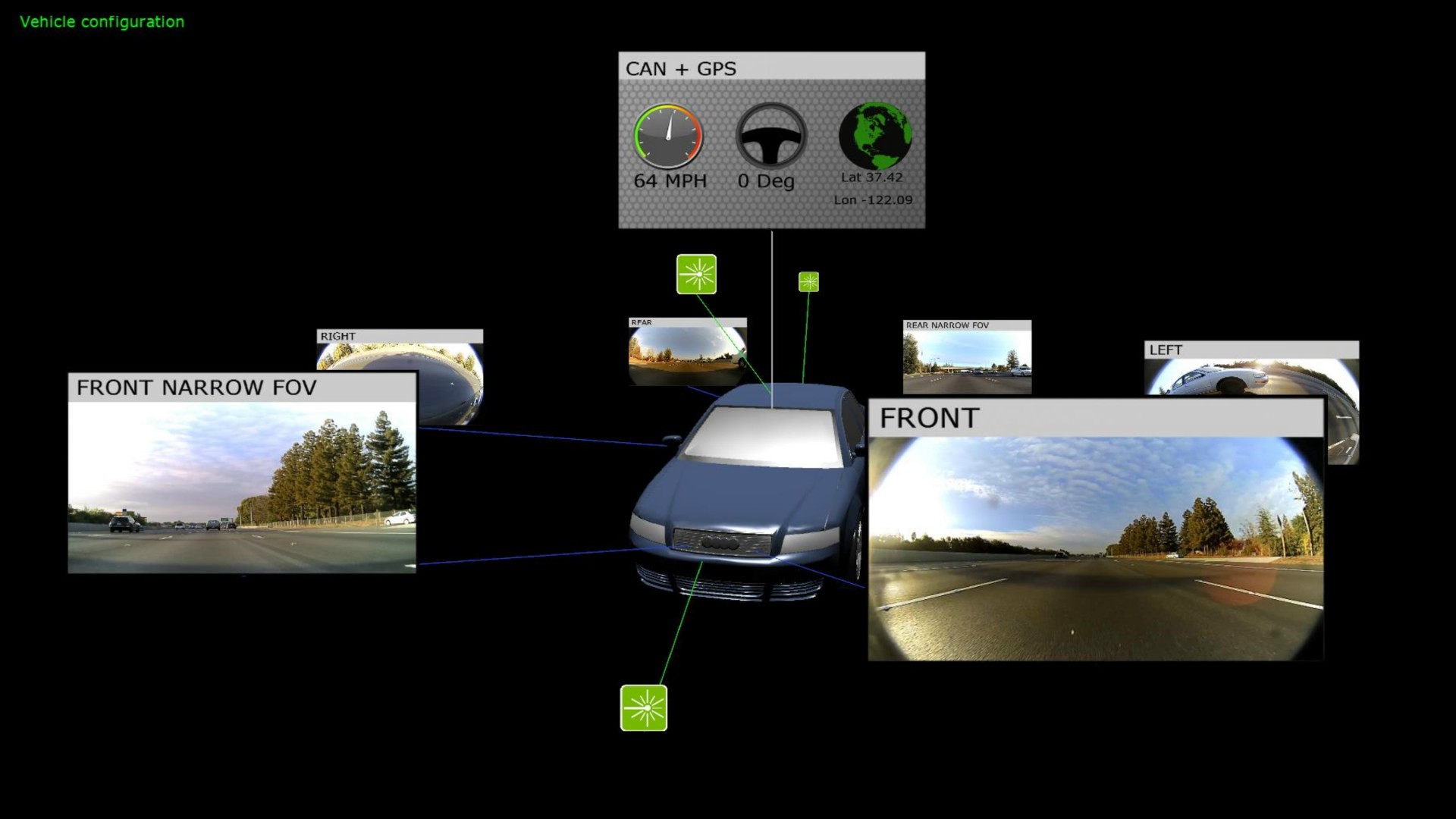

Fort logiquement, lors de ce CES, Nvidia a donc doublé la mise et annoncé son successeur, Drive PX 2, et peaufiné son angle d'attaque pour ce nouveau marché. Au cours des développements entrepris avec Drive PX, Nvidia a probablement fait le constat que sa solution n'était pas suffisamment performante, notamment au niveau des GPU Maxwell intégrés aux 2 Tegra X1 qui sont chargés de la détection des véhicules, personnes, panneaux et autres obstacles.

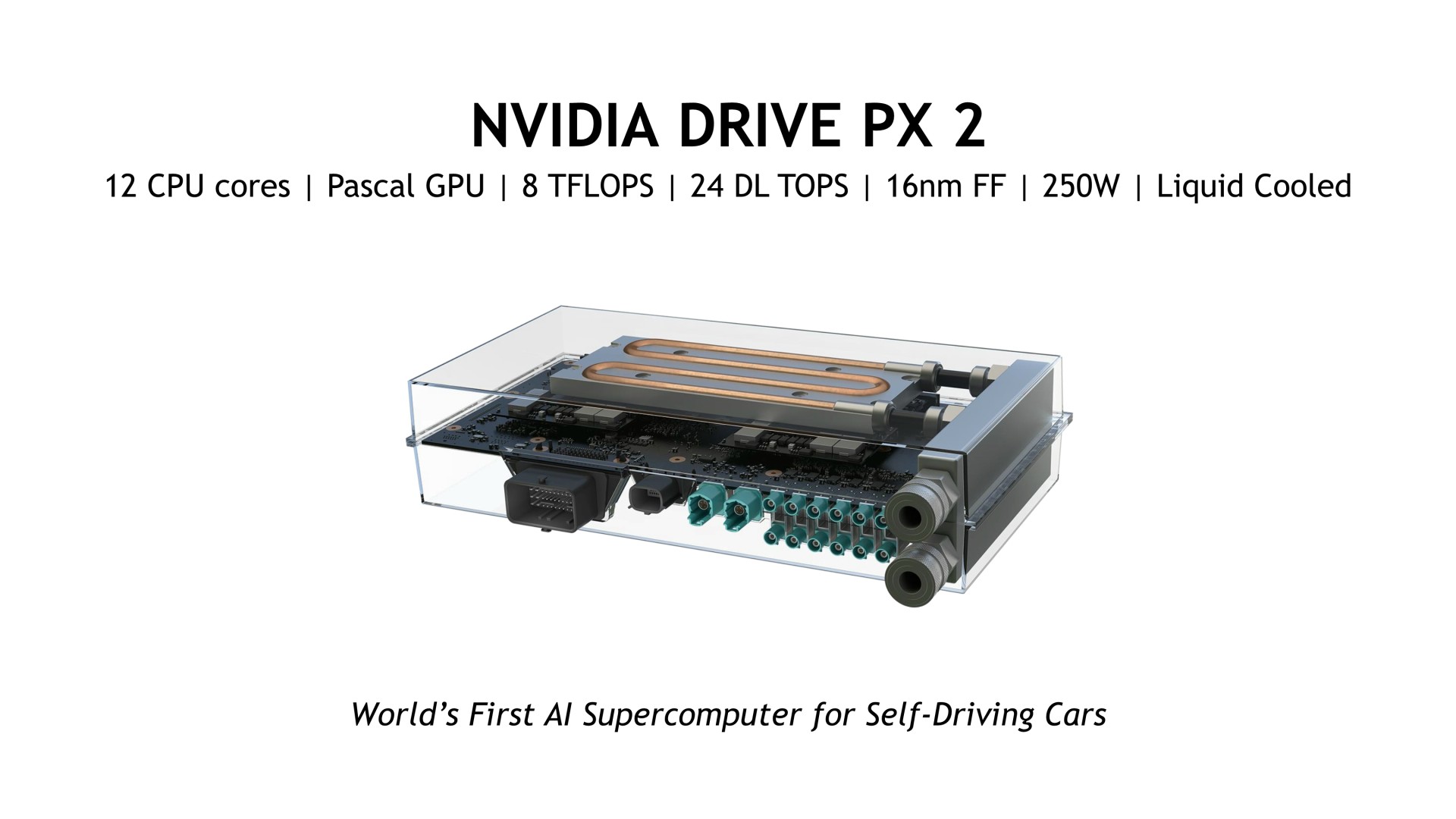

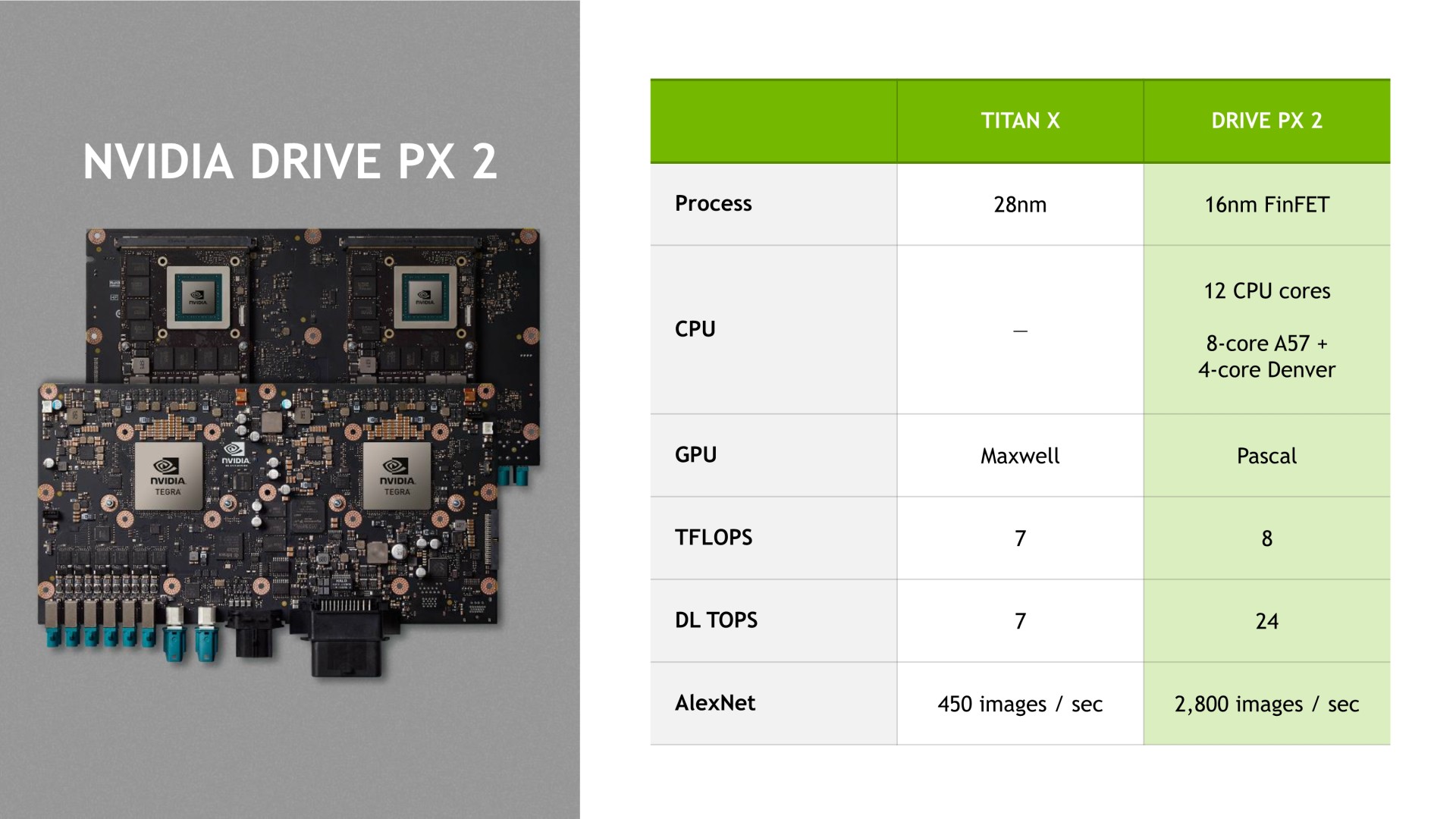

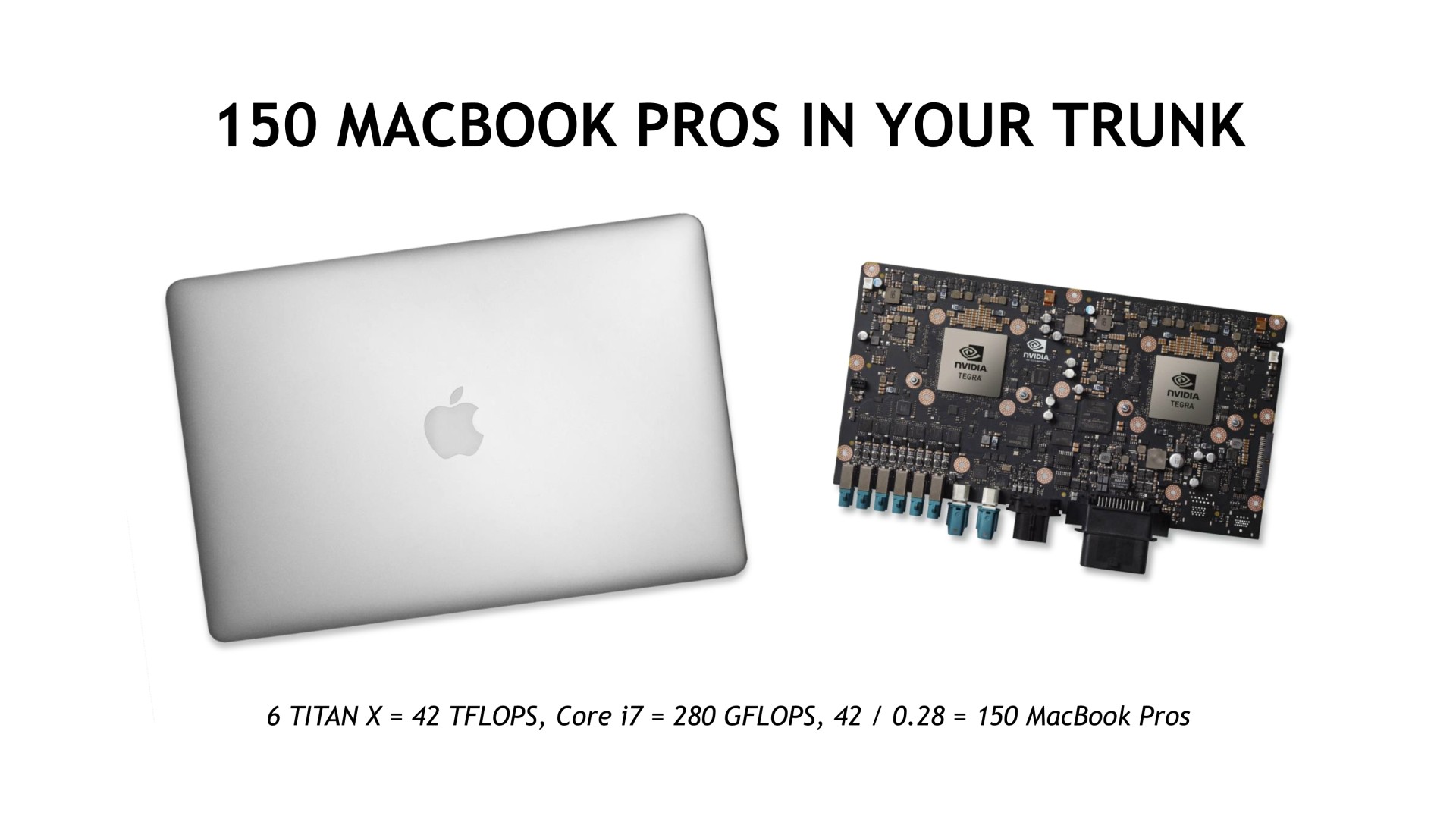

Pour Drive PX 2, Nvidia va toujours faire appel à 2 SoC Tegra mais d'une part il s'agira de SoC plus musclés et d'autre part ils seront accompagnés de 2 GPU dédiés ! Ces SoC seront fabriqués en 16nm FinFET et chacun équipés de 2 curs CPU Denver maison, de 4 curs Cortex-A57 et d'un GPU non précisé, qui ne sera peut-être pas exploité ici. Il est possible que ce SoC soit en fait celui qui était présenté depuis deux ans sous le nom de code Parker et qui serait donc équipé d'un GPU Maxwell.

Chacun de ces SoC sera connecté à un GPU de génération Pascal, également fabriqué en 16nm FinFET. Nvidia n'en communique pas les spécifications mais se contente de parler d'une puissance de calcul de 4 Tflops ce qui correspond à peu près à une GeForce GTX 970 et à un ensemble supérieur à la puissance de calcul d'une GTX Titan X. Et ce n'est pas tout, Nvidia annonce ces GPU Pascal comme étant 3x plus rapides dans le cadre du deep learning qu'un GPU Maxwell de puissance de calcul équivalente. Un coup de boost important qui découle probablement en grande partie du support natif des opérations en 16-bit et/ou 8-bit. A noter que les illustrations de Drive PX 2 sont basées sur un prototype équipé de GPU Maxwell GM204, ne cherchez donc pas à déduire de quelconques informations sur les futurs GPU Pascal sur base de ces photos.

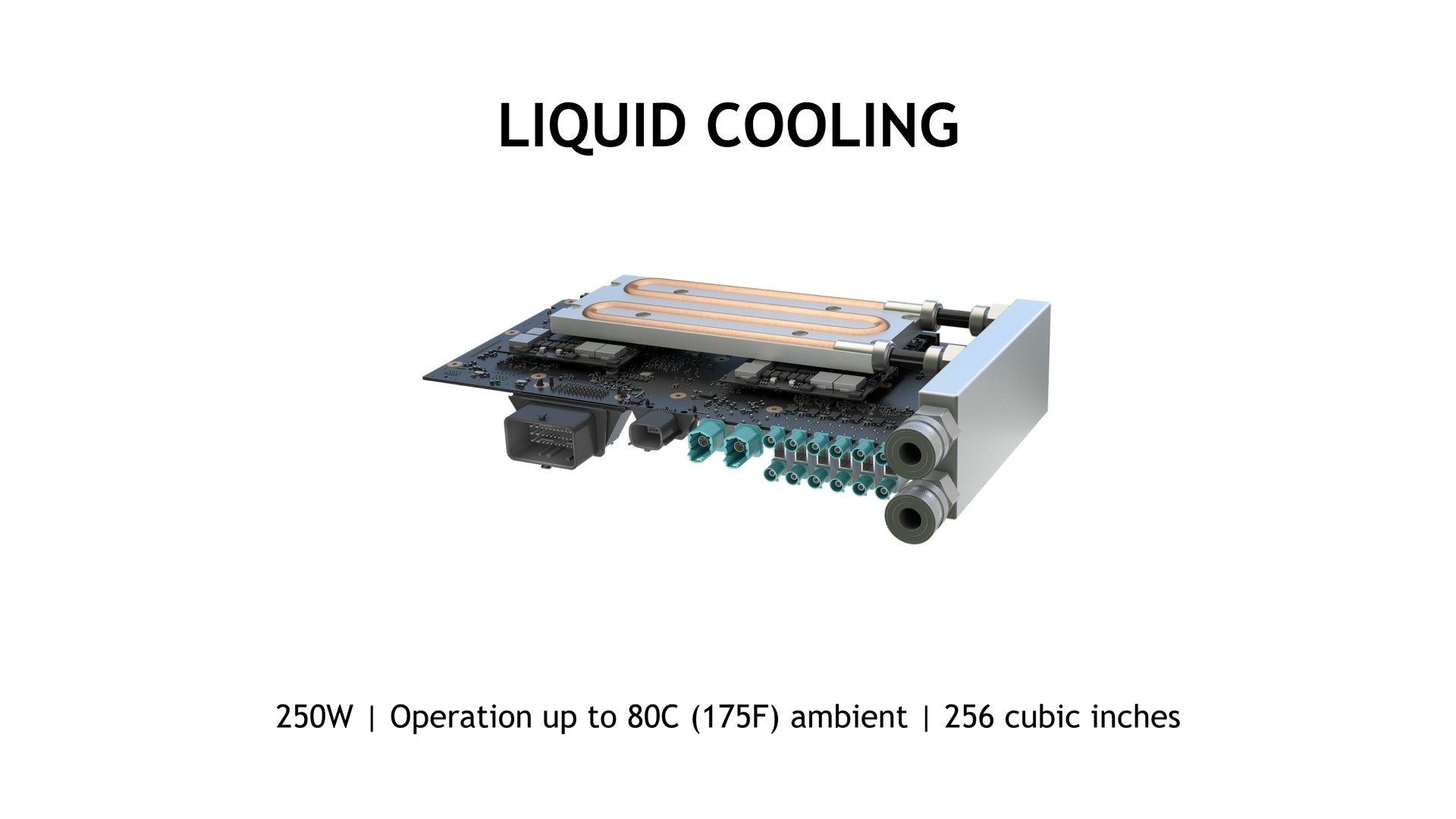

Malgré le recours au 16nm FinFET, l'ensemble sera relativement gourmand et Nvidia parle de 250W. Au passage, nous pouvons ainsi imaginer grossièrement qu'un équivalent Pascal de la GTX 970 verrait sa consommation chuter de 150 à 100W. Pour refroidir l'ensemble, dont la fiabilité doit être garantie en toutes circonstances dans la cadre du pilotage d'une voiture, Nvidia a développé un système de watercooling spécifique mais les éventuels fabricants de voiture intéressés par Drive PX 2 seront bien entendu libres de mettre en place leur propre solution.

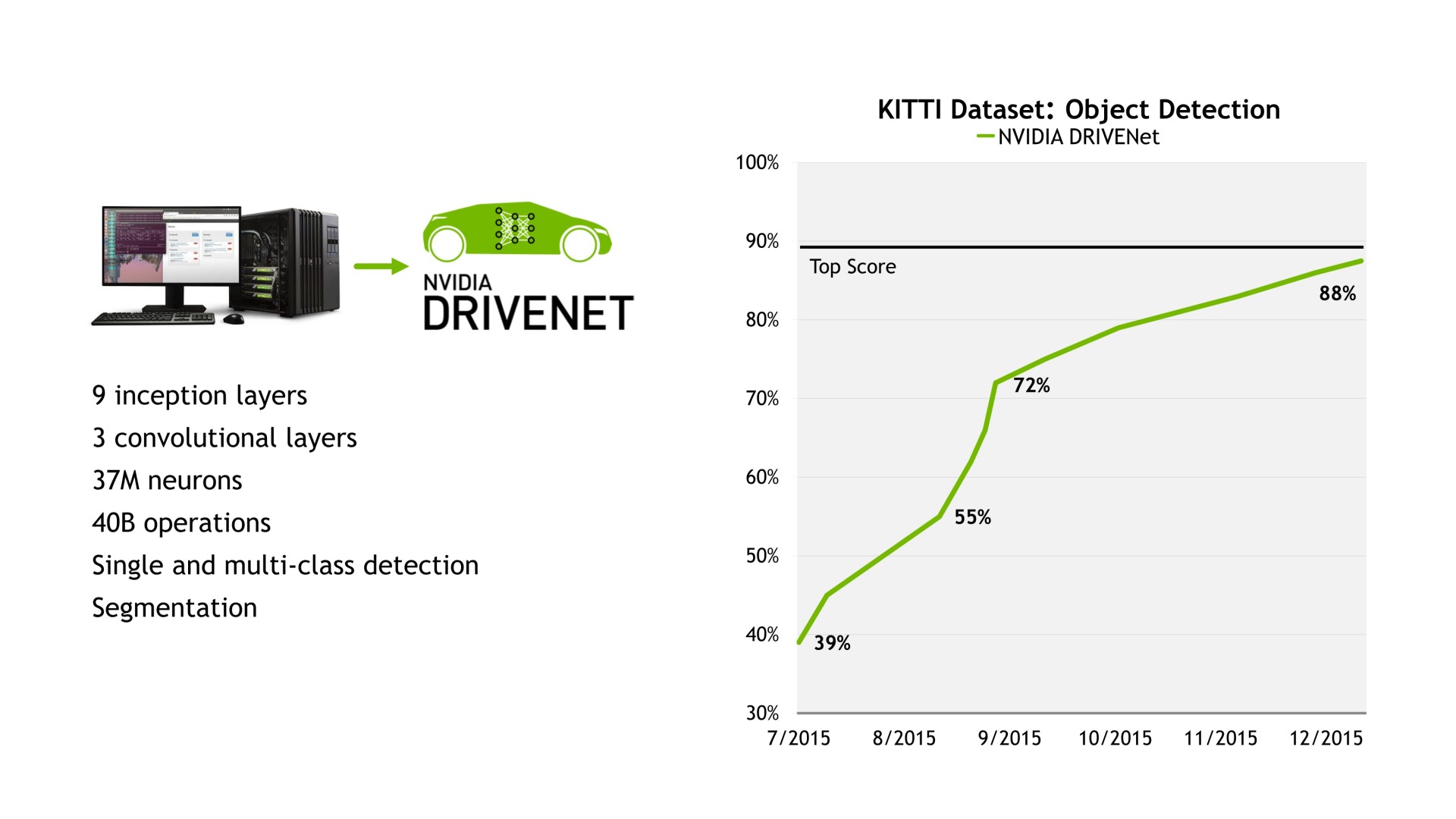

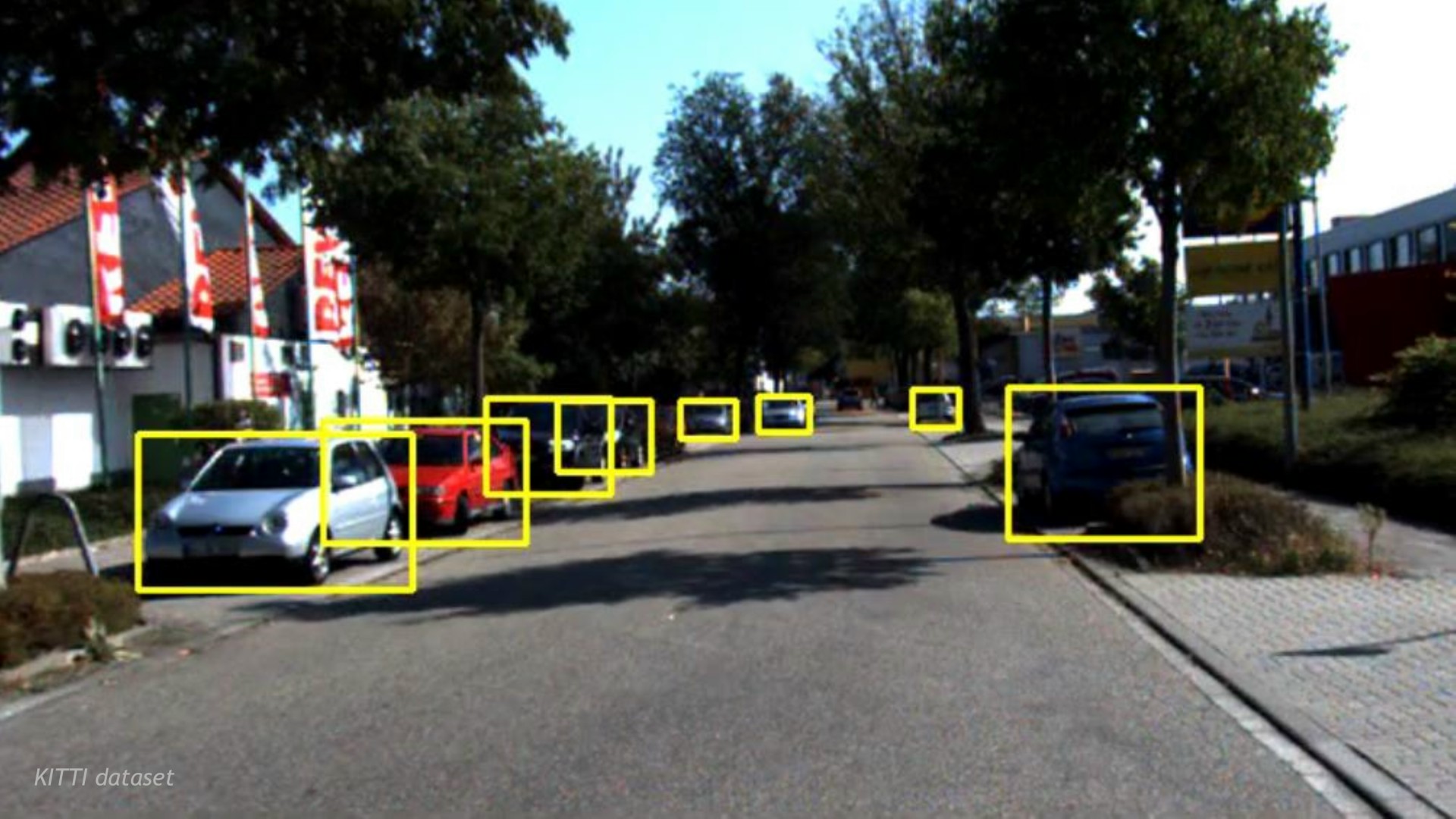

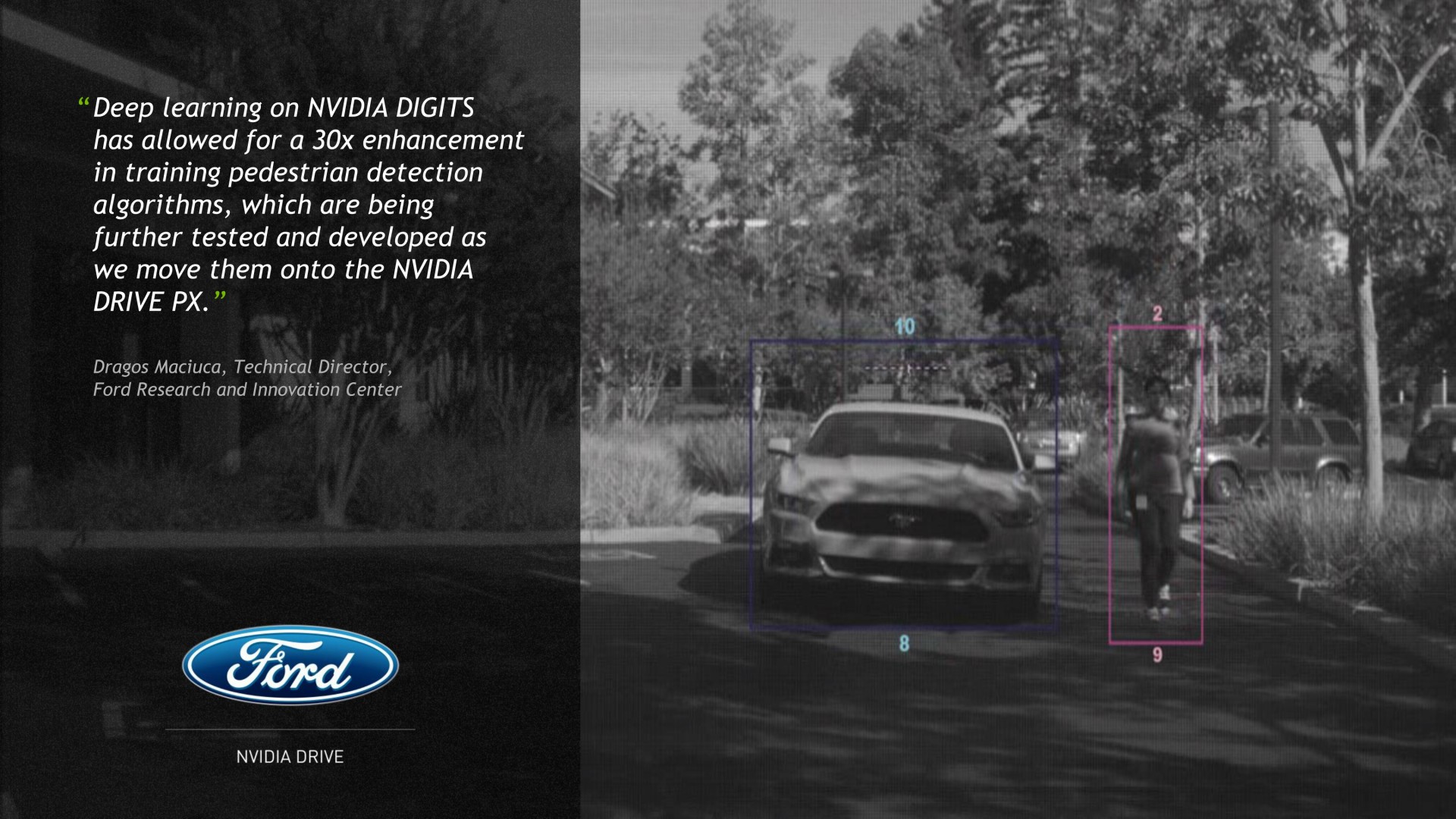

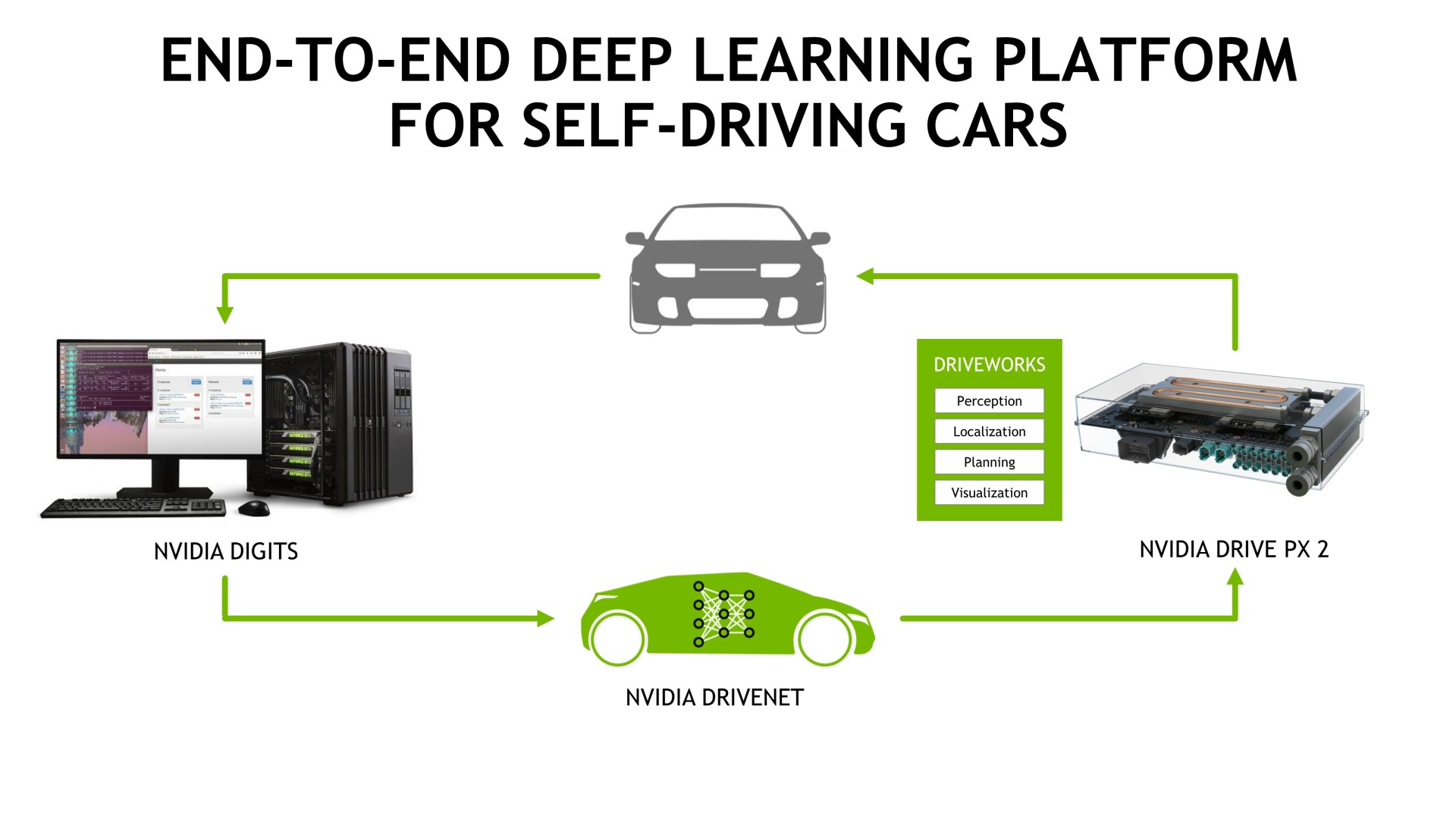

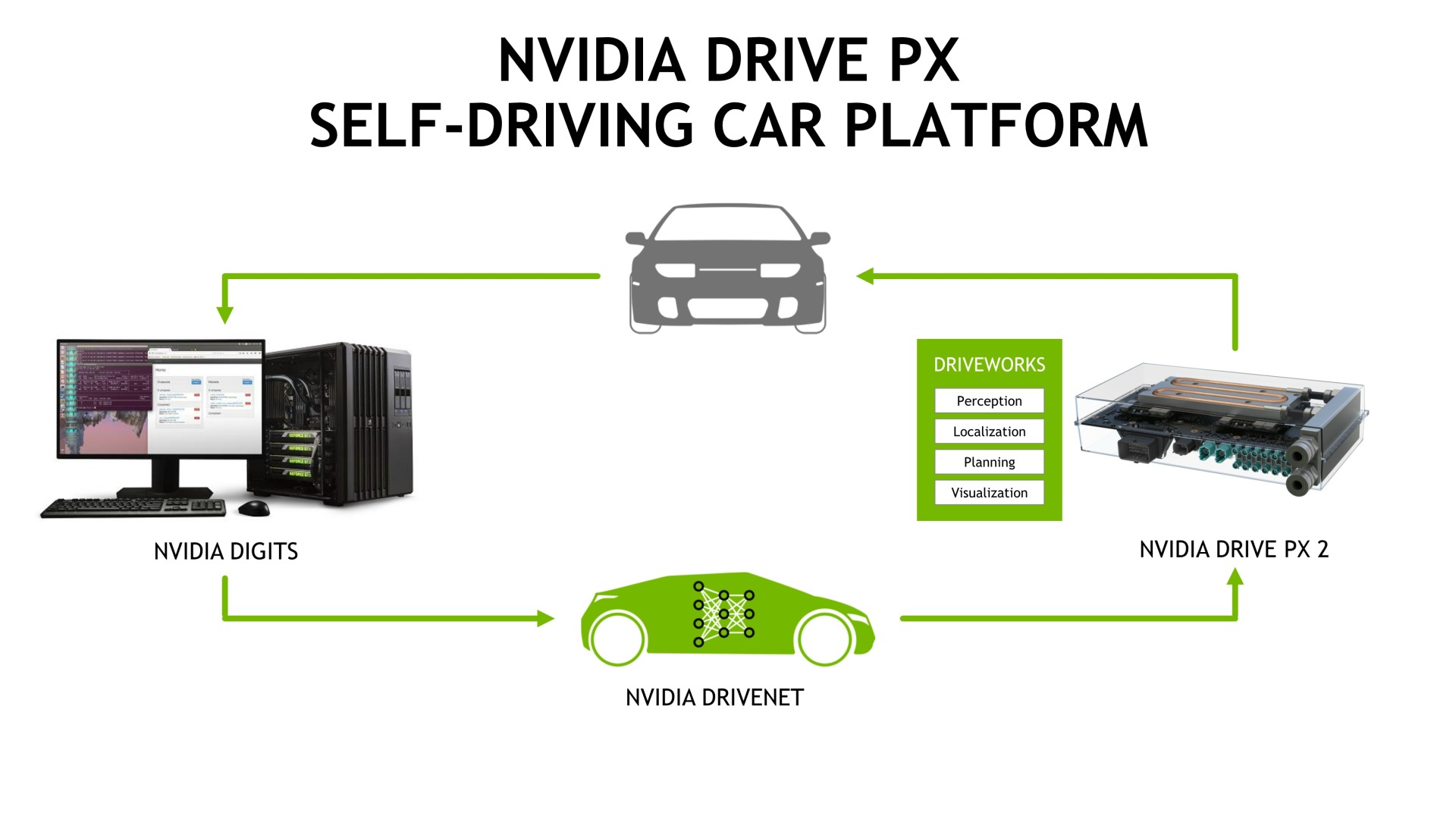

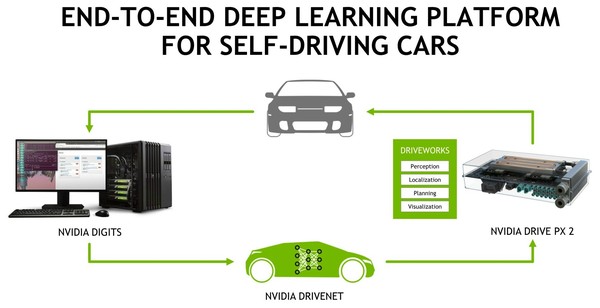

Enfin, pour mieux s'attaquer à ce marché, Nvidia a mis en place un écosystème complet qui passe par DIGITS, sa plateforme de deep learning, et d'autre part par DRIVENET, un réseau neuronal que ses ingénieurs ont commencé à entraîner il y a 6 mois et qui affiche déjà de très bons résultats. Nvidia peut ainsi fournir à des clients potentiels tous les outils nécessaires au développement de leur propre réseau neuronal ou une base déjà totalement fonctionnelle.

Un premier constructeur a déjà annoncé être intéressé par cette solution de Nvidia : Volvo qui intégrera Drive PX 2 en 2017 dans une centaine de voitures autonomes pour une première phase de test. De quoi peut-être permettre à "Drive PX 3" de trouver un succès commercial ?

Vous pourrez retrouver l'intégralité de la présentation de Nvidia ci-dessous :

Nvidia va arrêter les modems Icera

Nvidia vient d'annoncer qu'il allait fermer sa division Icera au prochain trimestre. La société spécialisée dans les modems a été rachetée en 2011 pour 367 millions de $, et avait développé récemment le Nvidia i500 4G LTE qui est disponible sous forme de puce externe mais également intégré au Tegra 4i.

Nvidia vient d'annoncer qu'il allait fermer sa division Icera au prochain trimestre. La société spécialisée dans les modems a été rachetée en 2011 pour 367 millions de $, et avait développé récemment le Nvidia i500 4G LTE qui est disponible sous forme de puce externe mais également intégré au Tegra 4i.

Devant le peu de succès commercial pour le Tegra 4i et les faibles marges sur le marché du SoC pour smartphone moyen de gamme, Nvidia semble vouloir orienter ses efforts au profit d'autres usages pour ces SoC tels que le jeu, l'automobile et le cloud computing pour lesquels la présence d'un modem intégré n'est pas primordiale.

A court terme Nvidia indique que le modem Icera 4G LTE couvrira ses besoins pour l'année qui vient voir plus, et à plus long terme Nvidia s'associera avec des fabricants de modems tiers. La division Icera emploie 500 employées, particulièrement au Royaume-Uni et en France. Nvidia dit être ouvert à la vente de la technologie ou de la division dans son intégralité.