Les derniers contenus liés au tag Intel

Afficher sous forme de : Titre | FluxPas de MAJ Microcode pour les Gulftown et Penryn !

Intel lance la 2ème vague de sa 8ème génération

Microcode final pour Spectre chez Intel

Intel présente un prototype de (mini) dGPU

Focus: Windows 10, Meltdown et Spectre : quel impact sur les performances ?

Dossier : AMD Ryzen 7 2700, Ryzen 5 2600 et Intel Core i7-8700, Core i5-8600

Après les Ryzen 7 2700X et les Ryzen 5 2600X, nous nous intéressons aujourd'hui au 2700 et 2600 de la nouvelle gamme d'AMD. Sans oublier les Core i7-8700 et Core i5-8600 qui s'invitent, eux aussi à 65W...

[+] Lire la suite

Un Coffee Lake 8 coeurs en préparation ?

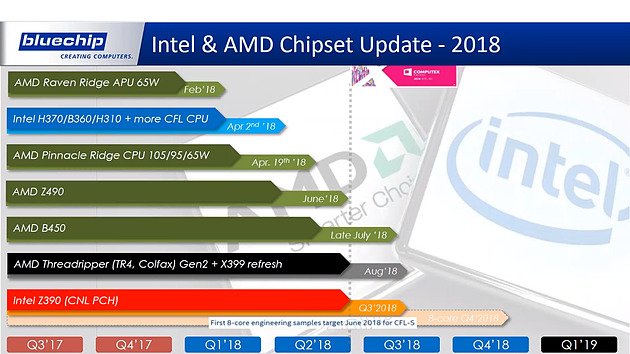

Le fabricant de PC allemand bluechip a publié par mégarde sur Youtube une présentation intégrant ce que seraient les nouveautés AMD et Intel pour cette année.

Côté AMD tout d'abord, il est question des chipsets AMD Z490 et B450 pour juin et fin juillet. On ne sait pas encore ce qu'apporteront ces puces, le X470 offrant les mêmes fonctionnalités que le X370. C'est en août qu'on devrait voir débarquer de nouveaux Threadripper basés sur les mêmes dies que les Ryzen 2xxx qui profitent du 12nm.

Côté Intel si Cascade Lake-X LGA 2066 n'est bizarrement pas présent, bluechip annonce l'arrivée pour le dernier trimestre 2018 d'un Coffee Lake 8 coeurs. Les prototypes seraient prévus pour juin. Ce n'est pas la première fois qu'il est question de l'arrivée d'un 8 coeurs "grand public" fin 2018 chez Intel, mais il était question à l'époque de Ice Lake. Le 10nm étant en retard, l'arrivée d'une version 14nm est logique et devrait permettre à Intel de répondre pleinement à l'offensive Ryzen d'AMD.

Il faut par contre espérer que ce processeur sera bien compatible avec toutes les cartes mères LGA 1151 et non pas seulement avec celles en Z390 prévues pour le troisième trimestre avec Intel rien n'est moins sûr !

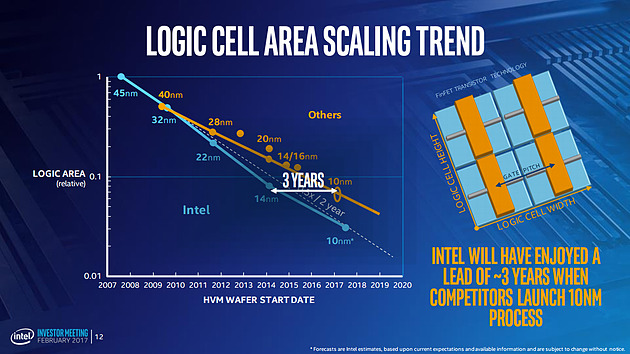

Le 10nm d'Intel (encore) retardé, le 7nm TSMC lancé

Intel vient d'annoncer lors de la présentation de ses résultats trimestriels que le 10nm sera de nouveau retardé. La production en volume ne débutera ainsi plus au second semestre 2018 mais en 2019, sans plus de précisions. Le fabricant insiste sur le fait qu'il fabrique et livre des produits (lesquels ?) 10nm en faible volume, mais le taux de rebus est encore trop élevé et nécessite des améliorations qui nécessitent encore du temps pour être implémentées et qualifiées.

Début 2017, Intel positionnait le 10nm pour mi 2017 sur ce graphique

Le 14nm d'Intel va donc encore être appelé à la rescousse cette année, en plus de Cascade Lake pour les serveurs qui sera également décliné en version Core i7 LGA 2066, un Whiskey Lake (!) a priori destiné au marché de portable.

En quelques années Intel aura donc perdu son avance sur ses concurrents, puisque dans le même temps TSMC vient de confirmer que sa production en 7nm, dont la densité est a priori équivalente en pratique au 10nm Intel, a bien débuté ce second trimestre comme prévu.

Il s'agit d'une première étape pour le taiwanais avant le "N7+" prévu pour l'an prochain et qui intégrera un peu d'EUV et offrira une densité en hausse de 20% pour une consommation en baisse de 10%.

Jim Keller rejoint... Intel !

C'est une petite surprise, Jim Keller, ingénieur connu pour les plus gros succès d'AMD (Athlon, Athlon 64 et Zen) rejoint aujourd'hui Intel d'après nos confrères de Fortune .

Connu pour son rôle dans le design des DEC Alpha, il a également dirigé les équipes qui ont conçu les K7 (Athlon) et K8 (Athlon 64) pour AMD, avant de se retrouver suite à un rachat (de P.A. Semi) en charge de la future architecture ARM custom d'Apple. Il est retourné en 2012 chez AMD ou il s'est occupé de l'architecture de Zen.

Depuis, il avait tenu plusieurs postes, dont un passage éclair chez Samsung. Depuis deux ans, il avait rejoint Tesla en tant que Vice Président en charge du hardware custom embarqué. Suite au départ de Chris Lattner (ex-Apple), il avait également récupéré la direction d'Autopilot.

Intel n'a pas encore communiqué officiellement sur son rôle, le communiqué de Tesla indiquant simplement que "la passion principale de Jim était l'ingénierie de micoprocesseurs et qu'il rejoint une société ou il pourra de nouveau s'y consacrer exclusivement".

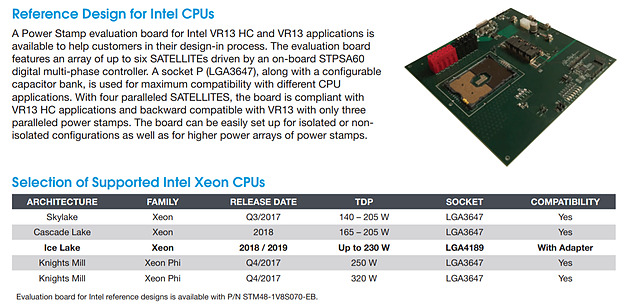

LGA4189 pour les Xeon Ice Lake !

Le Socket LGA3647 des Xeon actuels, qui accueillera prochainement une nouvelle génération de processeurs 14nm dénommée Cascade Lake, sera ensuite remplacé pour les Icelake 10nm par un LGA4189 d'après les documents de la Power Stamp Alliance.

Ces Xeon sont indiqués pour 2018/2019 sur le document (on penche fortement vers 2019), et il est question d'un TDP pouvant attendre 230W contre 205W pour les Xeon actuels. Ils seraient a priori capables de supporter la DDR4 sur 8 canaux, ce qui explique entre-autres l'augmentation du nombre de contacts sur le Socket.