Les contenus liés aux tags Nvidia et AMD

Afficher sous forme de : Titre | FluxGPU Mobiles : 500 pour l'équivalent d'une HD 7790

Parts de marchés GPU : AMD et Intel en forme

TSMC aurait signé Apple pour le 20nm

Windows 8.1 et pilotes graphiques

Licences GPU: guerre AMD-Nvidia en vue ?

Le futur Direct3D dévoilé en mars, l'effet Mantle?

C'était un secret de polichinelle depuis quelques temps, Microsoft prépare l'arrivée d'une nouvelle mouture de DirectX et de son API graphique Direct3D. Les premières annonces se feront à la Game Developer Conference (GDC) qui aura lieu du 17 au 21 mars à San Francisco. Comme les années précédentes, nous avons d'ailleurs prévu d'être sur place, d'autant plus en sachant que des choses importantes devraient y être dévoilées autour des API graphiques.

Il ne fait aucun doute que Microsoft va réorienter Direct3D vers une réduction massive du coût CPU des commandes de rendu, AMD ayant ouvert la voie vers cela avec Mantle. Il y a dorénavant une demande importante de la part des développeurs et des possibilités à ce niveau en OpenGL qui pourraient être exploitées par Steam OS. Pour garder le contrôle, Microsoft se devait de réagir.

La plupart des informations à ce sujet sortiront des sessions du jeudi 20 mars :

DirectX: Evolving Microsoft's Graphics Platform (Presented by Microsoft)

DirectX Advancements in the Many-Core Era: Getting the Most out of the PC Platform (Presented by NVIDIA)

Approaching Zero Driver Overhead in OpenGL (Presented by NVIDIA)

DirectX: Direct3D Futures (Presented by Microsoft)

L'intitulé de cette dernière cession est d'ailleurs très clair concernant les orientations du prochain Direct3D :

Come learn how future changes to Direct3D will enable next generation games to run faster than ever before!Il est intéressant d'observer qu'AMD prendra part à la session sur le surcoût CPU en OpenGL de Nvidia (les équipes de développements de ces deux concurrents arrivent à s'entendre!), alors que c'est avec Oxide Games, qui propose la démo Mantle Star Swarm, que Nvidia s'est associé pour parler de la bonne exploitation des CPU multicores.

In this session we will discuss future improvements in Direct3D that will allow developers an unprecedented level of hardware control and reduced CPU rendering overhead across a broad ecosystem of hardware.

If you use cutting-edge 3D graphics in your games, middleware, or engines and want to efficiently build rich and immersive visuals, you don't want to miss this talk.

Une fois que nous en saurons plus sur ce que ce sera ce futur Direct3D, il restera à voir qui tirera le mieux parti de ce futur Direct3D, l'avantage alternant souvent entre AMD et Nvidia. D'un côté certains pourraient se dire qu'avec Mantle, AMD a irrité Microsoft qui pourrait être tenté de favoriser Nvidia. C'est possible, mais d'un autre côté AMD a également enlevé une épine du pied au père de Windows en lui donnant un prétexte pour une évolution plus radicale face à laquelle certains pouvaient peut-être trainer des pieds. L'expérience de Mantle est par ailleurs une bonne base de travail et de réflexion pour Microsoft, de quoi l'aider à bouger plus rapidement pour ne pas laisser d'avantage au couple OpenGL et Steam OS.

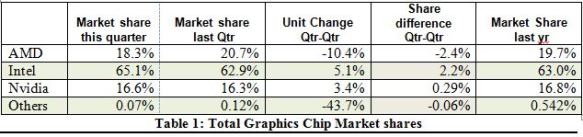

Parts de marché GPU T4 2013

John Peddie Research a publié son analyse du marché graphique PC pour le quatrième trimestre 2013. Il en ressort qu'Intel reste logiquement leader grâce à ses iGPU (hors serveurs, 99% de leurs CPU en intègrent), avec pas moins de 65,1% du marché contre 62,9% au T3 2013 et 63% au T4 2013.

Ces estimations de Jon Peddie Research regroupent les ventes de PC desktop, mobiles, et tablettes x86. Les serveurs sont exclus.

Egalement aidé par les iGPU qui sont intégrés dans 67% des processeurs qu'il a vendus (hors serveurs), AMD conserve la seconde place avec 18,3% de part de marché, un chiffre en baisse par rapport au trimestre précédent (20,7%) et il y a un an (19,7%). La baisse séquentielle provient de mauvais résultats sur les portables, avec des baisses de 26,7% côté APU et 6,7% en GPU, alors que côté desktop les hausses sont de 15 et 1,8%.

Nvidia est le dernier du trio avec 16,6% du marché, soit une légère hausse par rapport au trimestre précédent (16,3%) mais une baisse sur un an (16,8%). Comme chez Intel ce gain sur un trimestre est lié à une hausse des volumes équilibrée entre portables et pc de bureau.

Au global les ventes de GPU/iGPU se portent assez bien, avec une hausse de 1,6% séquentiellement et de 2% sur un an. Pour les GPU additionnels seuls, la hausse de volume est de 1,5% séquentiellement et de 2,4% sur un an. 66% des machines n'ont pas de GPU additionnel et au global le nombre de GPU par machine est de 1,37. Cela signifie donc que sur les 34% de machines restantes il y a environ 2,1 GPU par machine mais pas forcément un SLI et un CrossFire, qui doit représenter plus ou moins de 1% du marché, mais plutôt un iGPU et un GPU. Il y a 6 mois, le taux de GPU par machine était "quasiment de 1,4" : puisque la part de CPU AMD et Intel avec iGPU n'a pas évolué, de plus en plus de machines se passent logiquement d'un GPU additionnel.

GTX 750 Ti et 750 chez Nvidia et R7 250X pour AMD

Comme nous l'indiquions à l'époque des rumeurs de décembre annonçant une arrivée prochaine de l'architecture Maxwell de Nvidia, c'est bien sous la forme d'une puce d'entrée de gamme, le GM107, qu'elle va débarquer dans un premier temps.

Selon les dernières rumeurs, cette puce sera composée de la sorte :

- GM107 : 156mm² en 28nm, 5 SMX, 16 ROPs / GDDR5 128 bits

- GK106 : 221mm² en 28nm, 5 SMX, 24 ROPs / GDDR5 192 bits

- GK107 : 118mm² en 28nm, 2 SMX, 16 ROPs / GDDR5 128 bits

Rappelons que sur Kepler, mais cela reste une inconnue pour Maxwell, un SMX est constitué de 192 unités de calculs. Le GM107 serait un compromis entre le GK106 (GTX 660, et bridé en GTX 650 Ti Boost et 650 Ti) et le GK107 (GTX 650), avec la puissance de calcul du premier, si le nombre d'unités par SMX est inchangé, mais le fillrate et la bande passante du second.

Vu la taille du die en nette baisse, il est probable que Nvidia ait fait quelques compromis supplémentaires au niveau de son architecture. Pour rappel, si sur les GK1xx chaque SMX intégrait 16 unité de texturing, sur le GK208 ce nombre est passé à 8. Il est possible que cette simplification ait été reprise par Nvidia sur le GM107. Selon le choix fait au niveau du nombre d'unités de texturing par SMX, on sera de ce côté 25% (8 unités par SMX) à 150% (si c'est 16) au-dessus d'un GK107. Il semble également évident que Nvidia soit passé de 3 à 2 rasterizers pour s'aligner sur le débit de pixels autorisé par 16 ROP, réduisant au passage le débit de petits triangles rendus.

On peut s'attendre à des performances intermédiaires, plus proche de l'un ou de l'autre des GPU Kepler en fonction des jeux. Deux déclinaisons sont pour l'instant prévues :

- GTX 750 Ti : GPU à 1085-1163 MHz, 5 SMX actifs, GDDR5 128 bits à 5,5 Gbps

- GTX 750 : GPU à 1085-1163 MHz, 4 SMX actifs, GDDR5 128 bits à 5,1 Gbps

Le niveau de fréquence GPU est comparable à la génération précédente, avec un léger mieux du fait d'un boost qui était absent des 650 et 650 Ti. Côté mémoire on est à des niveaux comparables à ces deux solutions et en dessous d'une 660 qui dispose de mémoire 6 Gbps. Nvidia a probablement intégré des PHY GDDR5 plus simples et à la fréquence maximale limitée mais moins gourmands. Car c'est bien sur le point de l'efficacité énergétique que les nouvelles venues devraient se distinguer.

Les GTX 750 et 750 Ti seront respectivement plus rapides que les GTX 650 et 650 Ti, mais la GTX 660 et son GK106 restera intouchable alors même qu'elle n'est pas déclinée dans la gamme GeForce 700. Assisterons-nous à un renommage de celle-ci en 750 Ti Boost ?

AMD semble assez bien paré pour contrer cette offensive, les GTX 750 et 750 Ti ne feront sauf surprise que se repositionner face à l'offre R7 260 et 260X qui met à mal les GTX 650 Ti. Une Radeon R7 250X serait toutefois à l'étude afin de combler le "trou" entre R7 250 et R7 260X, cette dernière étant environ 35% plus rapide pour 20 de plus.

AMD 'FreeSync': proposition pour le DP 1.2a

Durant le CES, AMD nous a surpris en dévoilant une alternative gratuite au G-Sync de Nvidia. Si de nombreuses questions restent en suspens, nous en savons aujourd'hui un peu plus : elle devrait passer par une nouvelle option intégrée au standard DisplayPort 1.2a actuel.

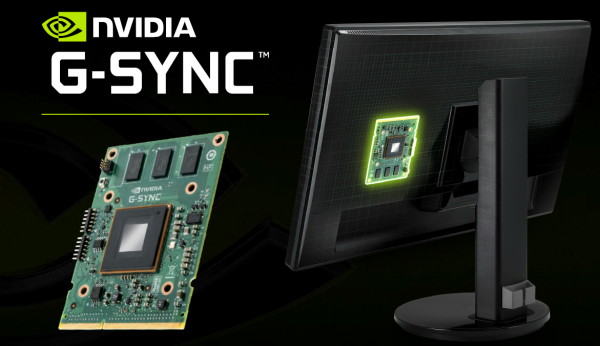

Pour rappel, en octobre dernier, Nvidia a dévoilé G-Sync, un mode d'affichage qui repose sur une fréquence de rafraîchissement variable (ou dynamique, ou encore non-isochrone, FRV) destinée à forcer l'écran à se synchroniser par rapport au GPU. L'intérêt est d'éviter les désagréments de la fréquence de rafraîchissement fixe traditionnelle : elle force le GPU, qui par nature ne produit pas les images à intervalle parfaitement régulier, à se contorsionner pour se synchroniser par rapport à l'écran, ce qui entraîne suivant les cas et le mode de V-Sync des cassures dans les images, des saccades et/ou une latence supplémentaire. Des désagréments que les joueurs PC doivent accepter depuis de nombreuses années, à moins de disposer de systèmes très puissants capables de maintenir en permanence un niveau de performances égal ou supérieur au taux de rafraîchissement de l'écran.

Pour pouvoir proposer ce mode d'affichage miracle, Nvidia a recours à un "module G-Sync", relativement onéreux, qui vient prendre la place des contrôleurs de dalles LCD tradionnels ("scalers"). Nous avons pu tester un écran compatible G-Sync et les résultats sont probants : aucune cassure dans les images et une fluidité qui progresse nettement quand les performances se situent entre 40 et 60 fps.

Durant le CES, soit 4 mois plus tard, AMD a enfin réagi en indiquant qu'un standard VESA (Video Electronics Standards Association) allait permettre de faire de même sans devoir passer par un module spécial. Une initiative surnommée "FreeSync" en référence au surcoût élevé de la solution de Nvidia, et directement mise en démonstration à travers Toshiba Satellite Click (2-in-1 13.3") pour lequel la fréquence de rafraîchissement variable a été activée.

Bien que très brève, cette démonstration a mis en avant un résultat identique à celui de G-Sync et pour cause, son fonctionnement est exactement le même : partir de la fréquence de rafraîchissement maximale de l'écran et moduler la durée du VBLANK (espace entre 2 images sur le signal vidéo) pour forcer l'écran à "patienter" le temps que le GPU lui propose une nouvelle image à afficher.

Une démonstration qui a soulevé de nombreuses questions. Comment est-ce possible de faire aussi bien que G-Sync sans module spécial ? A quoi sert ce module G-Sync ? De quel standard s'agit-il ? Quand est-ce que cela pourrait être disponible ? Pourquoi Nvidia fait-il mine d'ignorer qu'un standard est en approche ? Tant AMD que Nvidia ont préféré éviter de répondre à des questions trop précises, le premier probablement parce que sa solution n'est pas encore prête, le second probablement pour éviter d'avoir à admettre ne pas nous avoir tout dit

Nous avions en effet dès le départ posé de nombreuses questions aux responsables de Nvidia concernant G-Sync, et à nouveau au début du mois de décembre en préparant le test du premier écran compatible. La possibilité qu'il fonctionne sur base d'un standard actuel ou futur ? Son intégration dans les portables qui pourrait être plus simple via l'eDP ? Nvidia n'a jamais répondu clairement à ces questions, se contentant de tourner autour du pot et de laisser penser que rien de tout cela n'était à l'ordre du jour, mais que tout était possible dans l'avenir. Après la démonstration d'AMD, Nvidia n'était pas plus pressé de répondre à ces questions, mais a tenu à préciser que la gestion de l'affichage est différente sur un écran intégré dans un portable par rapport à un moniteur de bureau et que sa solution repose sur une technologie propriétaire pour laquelle des brevets ont été déposés.

Rappelons à ce niveau qu'un brevet déposé n'est pas un brevet accordé (cela prend du temps) et encore moins un brevet validé puisque cela n'intervient en pratique aux Etats-Unis que s'il est contesté. Si la fameuse mention "patent pending" est prévue pour prévenir des concurrents éventuels qu'ils risquent d'enfreindre un brevet, son utilisation est devenue courante, toutes industries confondues, pour renforcer la communication en termes de crédibilité, de sentiment de complexité, d'exclusivité, etc.

Le plus simple aurait bien entendu été que VESA clarifie la situation. AMD indique que pas mal de personnes qui prennent part à l'organisation ont fait de gros yeux quand ils ont vus Nvidia annoncer une technologie propriétaire de gestion de la fréquence de rafraichissement variable. En fait, cette fonctionnalité existe depuis 2008 dans le standard eDP 1.0 (DisplayPort interne) puisqu'elle peut permettre des économies d'énergie, par exemple en ne rafraîchissant pas l'affichage du bureau Windows quand rien ne bouge. Nvidia ne ferait donc qu'en profiter dans une situation différente.

Malheureusement, VESA se contente de répondre qu'il ne leur est pas possible de commenter officiellement le sujet et qu'une communication officielle aura lieu plus tard dans l'année. L'accès à toutes les documentations des standards VESA est par ailleurs restreint à ses seuls membres.

En l'absence de plus de détails de la part de Nvidia, d'AMD ou de VESA, nous avons heureusement pu compter sur un lecteur bien informé, que nous remercions, puisqu'il a eu accès à ces documents et a pu nous les communiquer.

Nous apprenons ainsi qu'une demande de type SCR (Specification Change Request) a été déposée de manière à intégrer le support optionnel de la fréquence de rafraîchissement variable au standard DisplayPort 1.2a. Compte tenu du nom du document daté du 25 novembre, DP1.2a Extend MSA Tmg Para AMD SCR, il semble évident que la proposition a été soumise par AMD. Elle est actuellement au stade GMR (General Member Review) est donc en bonne voie d'être finalisée et ratifiée.

Voici un extrait du document en question :

Summary

Extend the "MSA TIMING PARAMETER IGNORE" option to DisplayPort to enable source based control of the frame rate similar to embedded DisplayPort.

Intellectual property rights

N/A

Benefits as a result of changes

This enables the ability for external DisplayPort to take advantage of the option to ignore MSA timing parameter and have the sink slave to source timing to realize per frame dynamic refresh rate.

Assessment of the impact

The proposed change enable per frame dynamic refresh rate for single stream devices that expose dynamic refresh rate capability in EDID for DisplayPort interface. The source will be able to enable this with an SST interface or MST hub with physical ports. Logical MST port support of the feature is not included as part of this SCR. A generic framework to enable such feature for logical port is required that can accommodate other feature where stream related configuration is programmed in DPCD.

Analysis of the device software implication

SST device which support "MSA TIMING PARAMETER IGNORE" option will be able to expose the capability in EDID and DPCD to let source enable dynamic refresh rate.

Source driver would have to be updated to parse EDID and enable "MSA TIMING PARAMETER IGNORE" feature when source want the sink to be refreshed based on its update rate.

Analysis of the compliance test and interop implications

Currently this feature is tested as part of eDP CTS. New test would have to be added as part of DP LL CTS and EDID CTS.

D'ici quelques temps, les écrans DisplayPort 1.2a pourront donc, si les fabricants le désirent, supporter une fréquence de rafraîchissement variable. Pour cela, il faudra que la dalle LCD l'accepte ainsi que le contrôleur de l'écran. Durant le CES, AMD avait affirmé que certains moniteurs actuels seraient capables de supporter cette évolution avec une simple mise à jour de leur firmware, sans donner plus de détails. Nos questions à ce sujet sont restées lettres mortes et nous n'en savons donc pas plus, ni quand ces écrans actuels pourraient être mis à jour, ni quand de nouveaux modèles pourraient être commercialisés.

AMD nous a affirmé que le support de la fréquence de rafraîchissement variable était déjà intégré aux pilotes Catalyst récents mais qu'une interface pour en donner le contrôle aux joueurs était toujours en cours de développement. Même si les moniteurs compatibles FRV tardent à arriver, AMD devrait ainsi pouvoir proposer cette fonction rapidement sur certains portables, ce qui tombe d'ailleurs très bien puisque leur puissance graphique plus limitée fait qu'ils en auraient bien besoin pour proposer plus de confort aux joueurs.

Il est probable que Nvidia ait été le premier à réaliser l'intérêt que pourrait avoir la fréquence de rafraîchissement variable pour les joueurs. Friand de solutions propriétaires, Nvidia a cependant évité de soumettre son idée à VESA et opté pour le développement confidentiel d'un G-Sync limité à ses seules cartes graphiques. Une approche qui réduit immanquablement l'offre et empêche de généraliser son utilisation, même chez les utilisateurs de GeForce, mais qui a l'avantage de permettre de tirer des revenus supplémentaires de cette fonctionnalité, de se démarquer de la concurrence et d'aller vite.

Ajouter une fonctionnalité à un standard VESA existant ou en cours de développement demande de prendre le temps qu'elle soit débattue par tous ses membres, validée et exploitée par l'industrie. Avec G-Sync, Nvidia a pu aller très vite, certes au prix d'un contrôleur écran émulé à l'aide d'un composant relativement cher. Ainsi, le module G-Sync est réellement utile à l'heure actuelle, car en attendant que des contrôleurs classiques supportent la FRV, que ce soit à travers un nouveau firmware, une nouvelle révision ou un nouveau modèle, c'est le seul moyen d'activer ce support sur les écrans de bureau.

Mais pourquoi Nvidia ne s'est-il pas contenté dans un premier temps de proposer G-Sync sur les portables, domaine où le lien eDP connecte la dalle au GPU d'une manière plus directe ? Sans surcoût ou revenu direct supplémentaire, cela aurait malgré tout apporté de la valeur à ses cartes graphiques mobiles. Le problème est que sur la majorité des portables équipés en GeForce, Nvidia n'est plus maître des sorties vidéos ! A travers la plateforme Optimus, toute cette partie est sous-traitée à l'IGP Intel. Ce dernier aurait donc dû collaborer à son support, or il a tout intérêt à préférer attendre un standard que favoriser une solution propriétaire de Nvidia.

Au final, vous l'aurez compris, aussi intéressante que soit la fréquence de rafraîchissement variable pour les joueurs, de nombreuses questions restent encore en suspens quant à sa généralisation éventuelle. Nvidia va-t-il supporter sa version standardisée dès qu'elle sera disponible ou tenter de forcer les joueurs à payer, en plus de leur carte graphique, la taxe d'une solution propriétaire ? Nvidia va-t-il arriver à s'entendre avec Intel pour l'arrivée de la FRV sur la plateforme Optimus ? Quand est-ce que des moniteurs DisplayPort 1.2a avec support de la FRV seront disponibles ? Si certains contrôleurs actuels acceptent la FRV via mise à jour de leur firmware, y aura-t-il des limitations telles que la désactivation de l'overdrive ?

En attendant d'en savoir plus, la technologie G-Sync de Nvidia doit être vue comme une manière d'accéder en primeur aux bénéfices du DisplayPort 1.2a + FRV, avec tout ce que cela implique : surcoût élevé et possibles limitations dans le futur en terme de compatibilité. Sans changer fondamentalement notre avis sur G-Sync tel que nous l'avions exprimé dans le test du premier écran compatible, avant d'apprendre l'arrivée d'une version standardisée, cela rend le surcoût plus difficile à accepter. Opter pour un des premiers écrans G-Sync en 1920x1080, les modèles de séries ne vont plus tarder, est difficilement justifiable s'ils s'accompagnent d'une surtaxe de 200, de 150 voire même de 100.

Plus haut en gamme, par exemple sur le futur Asus RoG Swift PG278Q en 2560x1440 ou sur un éventuel moniteur UHD / 4K, notre avis est moins tranché. Il est plus difficile pour les cartes graphiques, même haut de gamme, de générer un affichage fluide dans cette résolution et dans les jeux gourmands. Nous pouvons donc comprendre que Nvidia se presse d'y apporter une solution d'autant plus que le tarif plus élevé de ces moniteurs, 800 pour cet exemple, permet d'y intégrer plus facilement le surcoût actuel de G-Sync. Reste néanmoins à accepter de faire une croix sur toute possibilité d'évolution de son système vers une future carte graphique Radeon.

Le PG278Q d'Asus au CES.

Nous aurions bien entendu préféré que Nvidia se contente de lancer G-Sync tel qu'il existe aujourd'hui sur ce type d'écran, sans chercher à cacher le fait qu'il s'agit d'une version primeur d'un mode d'affichage qui est voué à être exploité par tous puisque basé sur le transfert d'une technologie qui existe déjà vers un autre type d'utilisation. Plus loin dans l'idéalisme il serait sans aucun doute bénéfique pour tous si Nvidia pouvait voir plus grand de temps en temps et viser des retours sur investissements indirects en transformant ses bonnes idées en propositions ouvertes, pour faire progresser l'écosystème PC, plutôt que de chercher une variante propriétaire à chaque technologie, dont la portée est mécaniquement plus limitée.

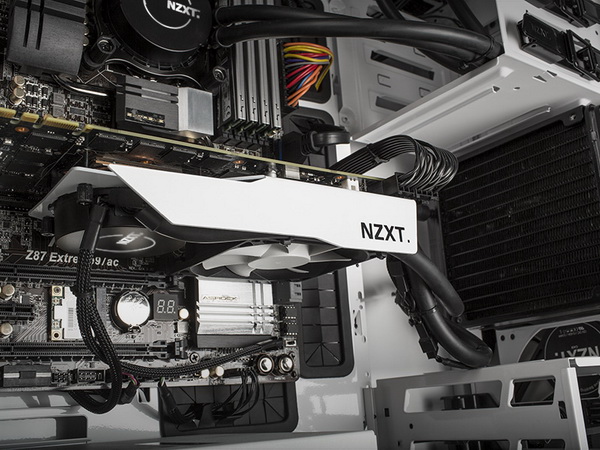

Bracket GPU pour kit watercooling chez NZXT

NZXT vient d'annoncer un produit assez original, le Kraken G10. Il s'agit d'un bracket de montage qui permet d'assembler un kit de watercooling all-in-one habituellement réservé aux processeurs sur une carte graphique.

Ce bracket triple slot mesure 18cm de long pour 11 de large avec une hauteur de 32.5 mm. On retrouve à gauche de la plaque une fixation pour un kit type Asetek et sur la droite un emplacement pour un ventilateur 92mm afin de refroidir les étages d'alimentation. Un ventilateur DC 92mm est fourni, annoncé avec une vitesse de rotation de 1500 tours/minute et l'on pourra le remplacer si besoin.

Côté compatibilité avec les kits, NZXT annonce une série de modèles d'origine Asetek que l'on retrouve chez les différents constructeurs à savoir :

- NZXT : Kraken X60, Kraken X40

- Corsair : H110, H90 , H55 , H50

- Antec : KUHLER H2O 920V4, KUHLER H2O 620V4, KUHLER H2O 920, KUHLER H2O 620

- Thermaltake : Water 3.0 Extreme, Water 3.0 Pro, Water 3.0 Performer Water 2.0 Extreme, Water 2.0 Pro, Water 3.0 Performer

- Zalman : LQ-320, LQ-315, LQ-310

Du côté de la compatibilité avec les cartes graphiques, elle est large et l'on retrouve à peu près tous les haut et milieu de gamme récents, même si NZXT précise se baser sur les PCB de référence :

- Nvidia : GTX 780, 770, 760, Titan, 680, 670, 660Ti, 580, 570, 560Ti, 560, 560SE

- AMD : R9 290X, 290, 280X, 280, 270X, 270, HD7970, 7950, 7870, 7850, 6970, 6950, 6870, 6850, 6790, 6770, 5870, 5850, 5830

Le concept d'utiliser un kit de watercooling sur une carte graphique n'est bien sur pas une première, on se souvient par exemple de l'Accelero Hybrid d'Arctic Cooling . L'idée de détourner l'usage principal de kits existants et dédiés aux CPU parait sur le papier intéréssante. Côté prix, il faudra compter une trentaine de dollars pour s'offrir ce kit de montage, disponible en blanc, noir ou rouge.