Actualités informatiques du 10-05-2017

- Nvidia dévoile le GV100: 15 Tflops, 900 Go/s

- Résultats Nvidia : +48% avec Nintendo et les datacenter

- Concours: HardWare.fr fête ses 20 ans !

- HardWare.fr a 20 ans !

| Mai 2017 | ||||||

|---|---|---|---|---|---|---|

| L | M | M | J | V | S | D |

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 | ||||

Nvidia dévoile le GV100: 15 Tflops, 900 Go/s

Nvidia profite de sa GPU Technology Conference pour dévoiler quelques détails sur le GV100, le premier GPU de la génération Volta qui sera dédié au monde du calcul et en particulier de l'intelligence artificielle.

Comme c'est à peu près le cas chaque année, le CEO de Nvidia Jen Hsun Huang vient de profiter de la GTC pour dévoiler les grandes lignes du premier GPU de sa future génération Volta. Ce sera un monstre clairement orienté vers l'intelligence artificielle, un débouché qui monte en puissance pour les GPU Nvidia.

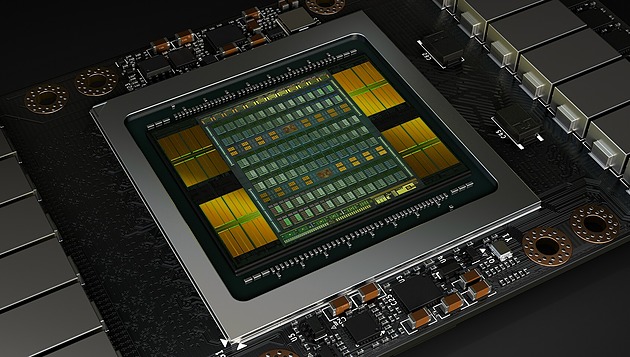

Le GV100 est le successeur direct du GP100 et reprend un format similaire : il s'agit d'une puce énorme placée sur un interposer avec 4 modules HBM2. Grossièrement c'est la même chose en mieux : plus gros et plus évolué.

Plus gros tout d'abord avec un GV100 qui profite de la gravure en 12 nm FFN de TSMC (personnalisé pour Nvidia) pour passer à 21.1 milliards de transistors, plus de 30% de plus que les 15.3 milliards du GP100. Malgré le passage au 12 nm, la densité ne progresse presque pas et le GV100 est énorme avec 815 mm² contre 610 mm² pour le GP100. Le 12 nm permet ici avant tout de pouvoir monter en puissance à consommation similaire.

Tout comme le GP100, le GV100 utilise des "demi SM" par rapport aux GPU grand public. Leur nombre passe de 60 à 84, ce qui représente 5376 unités de calcul. Ils restent répartis dans 6 blocs principaux, les GPC, ce qui laisse penser que Nvidia a tout misé sur un gain de puissance de calcul, sans trop toucher au débit de triangles ou de pixels qui étaient déjà à un niveau très élevé sur GP100.

Comme sur le GP100, ces SM sont capables de traiter différents niveau de précision : FP16 (x2), FP32 et FP64 (/2). Par ailleurs, Nvidia a ajouté quelques instructions spécifiques au deep learning et y fait référence en tant que tensor cores. Ils permettent aux algorithmes qui y feront appel de doubler la mise par rapport aux instructions 8-bits (produit scalaire avec accumulation) des GPU Pascal (sauf GP100) et du futur Vega d'AMD. A voir évidemment dans quelle mesure les différents algorithmes de deep learning pourront profiter de ces nouvelles instructions.

Nvidia en a profité pour améliorer le sous-système mémoire qui sera plus flexible pour demander moins d'efforts d'optimisation de la part des développeurs. Le cache L2 passe de 4 à 6 Mo et de la HBM2 Samsung plus rapide est exploitée mais qui restera au départ limitée à 4 Go par module soit 16 Go au total. Par ailleurs, le GV100 profite de 6 liens NV-Link de seconde génération (25 Go/s dans chaque direction) pour offrir une interface qui peut monter à 300 Go/s.

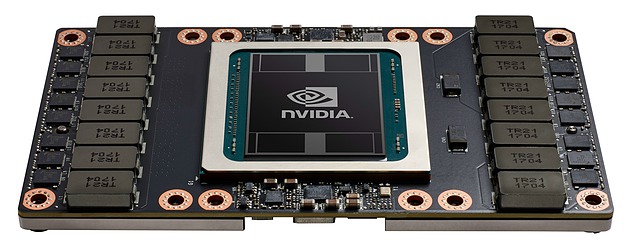

Le premier accélérateur qui profitera du GV100 est comme nous pouvions nous y attendre le Tesla GV100 qui sera initialement proposé dans un format de type mezzanine. Un tel module sera bien entendu gourmand mais Nvidia parle d'une enveloppe thermique maximale qui reste à 300W. Par ailleurs, deux modes énergétique seront proposé : Maximum Performance et Maximum Efficiency. Le premier autorise le GV100 à profiter de toute son enveloppe de 300W alors que le second limite probablement la tension maximale pour maintenir le GPU au meilleur rendement possible, ce qui a évidemment du sens pour de très gros serveurs.

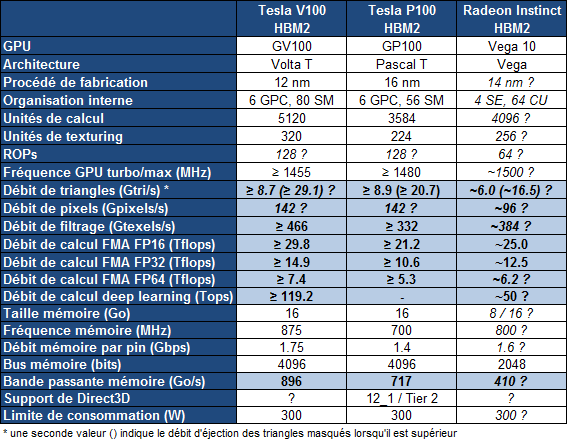

Sur le Tesla GV100, le GPU sera amputé de quelques unités de calcul, pour faciliter la production seuls 80 des 84 SM seront actifs. Voici ce que cela donne :

Le Tesla GV100 augmente la puissance brute de 40% par rapport au Tesla GP100, mais ses différentes optimisations feraient progresser les performances en pratique de +/- 60% dans le cadre du deep learning selon Nvidia. La bande passante mémoire progresse un peu moins avec "seulement" +25%, mais le cache L2 plus important et diverses améliorations compensent quelque peu cela.

Le GV100 devrait devancer assez facilement le Vega 10 d'AMD, mais ce dernier devrait être commercialisé en version Radeon Instinct à un tarif nettement moindre que le Tesla GV100 et en principe plus tôt. Nvidia parle de son côté du troisième trimestre et de 150.000$ pour les premiers serveurs DGX-1 équipés en GV100 et de la fin de l'année pour les accélérateurs au format PCI Express. Nvidia proposera évidemment d'ici-là des versions mises à jour de ses logiciels, compilateurs et autres librairies dédiées au deep learning.

Résultats Nvidia : +48% avec Nintendo et les datacenter

Nvidia vient de nouveau d'annoncer d'excellents résultats financiers pour son trimestre fiscal qui prenait fin le 30 avril dernier. Les ventes sont en hausse de 48% par rapport à il y'a un an et atteignent 1,937 milliards de $, alors que la marge brute progresse de 1,9 points à 59,4%. Le bénéfice opérationnel passe de 245 à 554 millions de $, et le net de 208 à 508 millions.

Nvidia vient de nouveau d'annoncer d'excellents résultats financiers pour son trimestre fiscal qui prenait fin le 30 avril dernier. Les ventes sont en hausse de 48% par rapport à il y'a un an et atteignent 1,937 milliards de $, alors que la marge brute progresse de 1,9 points à 59,4%. Le bénéfice opérationnel passe de 245 à 554 millions de $, et le net de 208 à 508 millions.

Le gros des ventes se fait toujours côté GPU avec 1,562 milliards, en hausse de 45% sur un an. Mais les ventes de Tegra sont également en forte hausse puisque doublées à 332 millions de $, porté par le SoC destiné à la Nintendo Switch. Par segment c'est sont les ventes liées au Datacenter (Tesla, NVIDIA GRID, DGX-1) qui augmentent le plus avec 186% de mieux pour atteindre 409 millions de $.

On notera que les versements liés à l'accord de licence signé avec Intel en 2011 prenaient fin ce trimestre, il aura permis à Nvidia de récolter 1,5 milliards de $.

Concours : HardWare.fr fête ses 20 ans !

A l'occasion des 20 ans de HardWare.fr nous organisons un concours afin de vous remercier pour votre fidélité. 4 500 bon d'achats sur la boutique sont à gagner, bonne chance à tous !

[+] Participer au concours !

HardWare.fr a 20 ans !

Il y a 20 ans jour pour jour naissait Achat PC, un petit site perso destiné à partager ma passion du matériel informatique. Il fût rapidement accompagné d'un forum et renommé en HardWare.fr !

A l'époque, le site était hébergé sur Mygale.org , nous bavions tous sur les cartes puces 3D telles que le Voodoo Graphics de 3Dfx (à 50 MHz et avec 4 Mo de mémoire !) ou le PowerVR PCX2, Nvidia venait d'annoncer son Riva 128, les Intel Pentium II (1940$ en version 300 MHz), AMD K6 et Cyrix 6x86 venaient d'entrer dans l'arène. Quantum lançait ses Fireball SE 8.4 Go en Ultra ATA-33 (3800 FF), les premiers graveurs CD-RW, chez Ricoh par exemple, commençaient à faire leur apparition (pour seulement 4000 FF, et 190 FF le CD-RW) alors que les sauvegardes se faisaient plutôt sur un Zip 100 Mo de Iomega. Côté carte mère, ASUS était déjà leader sur le marché du PC de bidouilleur mais allait commencer à se faire chahuter par d'autres acteurs tels que ABIT. Certaines de ces marques ont depuis disparues.

Durant ces 20 dernières années, l'augmentation de la puissance, la baisse des coûts et la miniaturisation ont révolutionné l'informatique. Ou en seront-nous dans 20 ans ? Bien malin qui pourra le prédire, si vous avez une petite idée n'hésitez pas à nous en faire part en commentaire ! Du côté de l'industrie les challenges s'annoncent en tout cas nombreux, ne serait-ce que pour garder le rythme des avancées lié à l'abaissement de la finesse de gravure.

De son côté, le site a évolué petit à petit jusqu'à sa forme actuelle et ces 20 années furent semées de multitudes aventures et rencontres. Revenir sur chacune d'entre-elles serait probablement ennuyeux pour vous tous, mais que ceux qui nous ont accordé leur confiance et leur aide depuis le départ soient certains de notre gratitude. Il y a ainsi bien longtemps que HardWare.fr n'est plus un simple site perso, les premières contributions "tierces" datant de 1999 avant le passage en SARL et la première embauche officielle de début 2000. Nombreux sont ceux qui ont depuis participé à l'aventure !

Ces dernières années, 2 personnes m'ont accompagné sur l'éditorial : Damien qui est depuis 2003 notre gourou GPU d'outre-Quiévrain et Guillaume qui depuis 2010 fait office de véritable couteau normand, aussi bon dans le software que le hardware. Il faut bien entendu y ajouter les nombreux modérateurs du forum, ainsi que les personnes qui nous donnent des coups de mains sur certains points à l'occasion. Merci à tous !

Pour finir nous nous devons bien entendu de vous remercier, sans lecteurs HardWare.fr n'existerait pas. Afin de joindre le geste à l'écrit nous organisons comme chaque année un concours, il débutera à 16h et prendra fin dimanche à 23h59... bonne chance !