Actualités informatiques du 07-01-2013

- Un adaptateur 2.5 pouces vers 3.5 original !

- Travelstar 7K1000: 1 To, 2.5'' et 7200 tpm

- Sandisk passe chez Marvell avec l'Ultra Plus

- L'USB 3.0 va passer à 10 Gbps

- CES: Nvidia dévoile Shield, une console portable

- CES: Nvidia dévoile le couple Tegra 4 / i500

| Janvier 2013 | ||||||

|---|---|---|---|---|---|---|

| L | M | M | J | V | S | D |

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 | 31 | |||

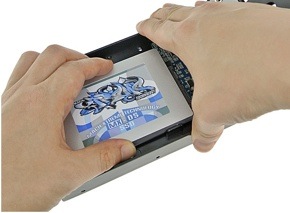

Un adaptateur 2.5 pouces vers 3.5 original !

La marque chinoise Orico vient de lancer un adaptateurs pour SSD/disques durs 2.5 pouces vers 3.5 pouces pour le moins original puisqu'il est en forme... de disques dur !

Comme vous pouvez le voir sur cette photo, le design n'est pas sans rappeler (de loin) celui des disques de feu Maxtor. Les connecteurs Serial ATA (données et alimentation) sont reportés à l'arrière, mais le boitier intègre aussi un contrôleur USB 3.0 permettant d'utiliser le boitier de manière externe. Côté prix, comptez environ 35 euros pour vous offrir cette drôle de curiosité...

Travelstar 7K1000: 1 To, 2.5'' et 7200 tpm

La sortie de ce nouveau disque avait été éventée fin 2012... le voilà officiel. HGST (propriété de Western Digital) vient en effet de dévoiler son nouveau Travelstar 7K1000 de 2,5" pour une capacité de 1 To. Si les disques de 1 To en 2.5" d'une épaisseur de 9,5 sont disponibles depuis 2011, ils étaient limités à une vitesse de rotation de 5400 tpm alors que le 7K1000 fonctionne à 7200 tpm.

La sortie de ce nouveau disque avait été éventée fin 2012... le voilà officiel. HGST (propriété de Western Digital) vient en effet de dévoiler son nouveau Travelstar 7K1000 de 2,5" pour une capacité de 1 To. Si les disques de 1 To en 2.5" d'une épaisseur de 9,5 sont disponibles depuis 2011, ils étaient limités à une vitesse de rotation de 5400 tpm alors que le 7K1000 fonctionne à 7200 tpm.

D'après sa fiche technique, le disque utilise des secteurs de 4K, dispose d'un cache de 32 Mo et d'une interface SATA 6Gbps. Sa commercialisation est annoncée comme immédiate à un prix gravitant autour des 100$.

Sandisk passe chez Marvell avec l'Ultra Plus

Sandisk lance une nouvelle gamme de SSD, les Ultra Plus. Alors que les Extreme utilisent un contrôleur SandForce SF-2281, Sandisk fait ici appel à un Marvell 88SS9175, une déclinaison du 88SS9174 (Crucial M4, Intel SSD 510, Plextor M3, M3P, M5S entre autre) dotée de 4 canaux Flash au lieu de 8.

Côté mémoire on retrouve de la MLC 19nm fabriquée par Flash Forward (alliance Toshiba et Sandisk) alors que les débits annoncés varient comme d'habitude en fonction de la capacité :

- 520 Mo /s et 155 Mo /s pour le 64 Go (lecture et écriture)

- 530 Mo /s et 290 Mo /s pour le 128 Go

- 530 Mo /s et 445 Mo /s pour le 256 Go

Malgré l'utilisation de seulement 4 canaux les débits sont au rendez-vous, ce qui combiné à la MLC 19nm pourrait permettre à Sandisk de tirer son épingle du jeu point de vue positionnement tarifaire.

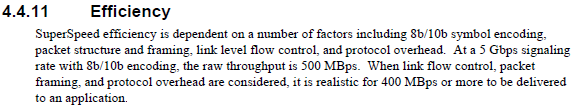

L'USB 3.0 va passer à 10 Gbps

L'USB 3.0 Promoter Group vient d'annoncer le développement d'une amélioration de la norme SuperSpeed USB, plus connue sous le nom d'USB 3.0. Les caractéristiques clefs de cette évolution sont les suivantes :

L'USB 3.0 Promoter Group vient d'annoncer le développement d'une amélioration de la norme SuperSpeed USB, plus connue sous le nom d'USB 3.0. Les caractéristiques clefs de cette évolution sont les suivantes :

- Débit qui passe de 5 à 10 Gbps

- Compatibilité avec les connecteurs et câbles actuels

- Amélioration de l'encodage des données

- Compatibilité avec la surcouche logicielle USB 3.0 existante

- Maintien de la rétrocompatibilité USB 3.0 5 Gbps / USB 2.0

Cette nouvelle norme devrait être terminée d'ici à la mi-2013. L'USB 3.0 actuel fonctionne à 5 Gbps pour un débit maximal pratique de l'ordre de 400 Mo /s mais qui peut être bien inférieur en fonction du protocole utilisé et de la vitesse des contrôleurs.

L'encodage 8b/10b étant a priori abandonné au profit d'un algorithme moins gourmand en bande passante, les 1 Go /s seront-il atteints par l'USB 3.0 10 Gbps ?

CES: Nvidia dévoile Shield, une console portable

Selon les rumeurs qui courent depuis quelques temps, les solutions de Nvidia n'auraient été retenues ni par Microsoft ni par Sony pour le GPU de leurs prochaines consoles. Pour éviter d'être exclu du salon et de tout un pan du monde du jeu vidéo, Nvidia a cependant mis les bouchées doubles pour proposer d'autres approches.

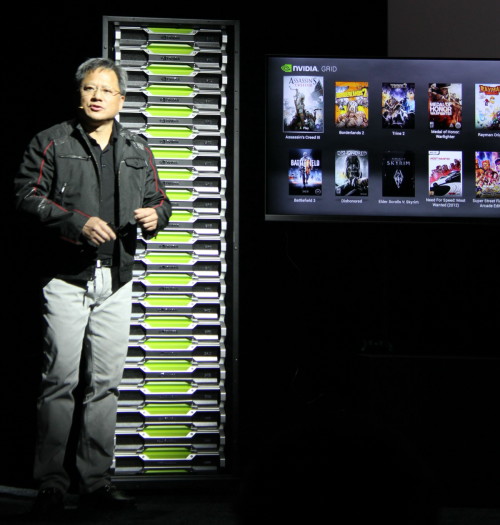

Tout d'abord, Nvidia a finalisé GRID (au départ appelé GeForce GRID), une plateforme de cloud gaming qui repose sur ses GPU. Le principe est simple : la TV est connectée au réseau et les commandes sont transférées à un serveur qui se charge du rendu puis renvoie les images sous forme de flux h.264. Toute la problématique de cette approche repose sur la qualité de l'encodage et la latence supplémentaire liée au passage par le réseau.

Grâce aux encodeurs vidéo présents dans les GPU et à une couche logicielle présentée comme très efficace, Nvidia estime avoir limité la latence à un niveau suffisant pour que GRID puisse réellement concurrencer les consoles. Un point qu'il faudra bien entendu vérifier en pratique et en conditions réelles, tout le monde n'ayant pas la possibilité de se connecter en Ethernet directement au serveur !

Si au départ Nvidia présentait GRID comme une plateforme qui serait proposée à différents partenaires qui pourraient développer leurs propres serveurs, il s'agit finalement d'un produit fini. Nvidia a ainsi décidé de concevoir en interne un serveur complet prêt à l'emploi et qui intègre pas moins de 240 GPUs. Etant donné la puissance de calcul affichée, 200 Teraflops, il s'agit probablement de GPU GK107 relativement modestes, comme ceux qui équipent les GeForce GTX 650 et GT 640. Nvidia précise que cela représente malgré tout la puissance de 700 Xbox 360.

Nvidia imagine par exemple convaincre les ISP de mettre en place des serveurs GRID pour pouvoir proposer un service jeu à leurs abonnés.

Ce n'est pas tout ! En plus de GRID, Nvidia travaille depuis quelques temps sur un autre projet, qui est resté secret jusqu'à ce jour : une console de jeu portable. Dénommée actuellement projet Shield, il s'agit d'un périphérique Android (Jelly Bean) dédié au jeu vidéo. Un smartphone intégré dans un gamepad en quelque sorte. Ou encore un mix entre un gamepad Microsoft et une Wii U, une image utilisée par Nvidia pour s'assurer de ne laisser aucune ambiguïté sur son intention de concurrencer les consoles traditionnelles.

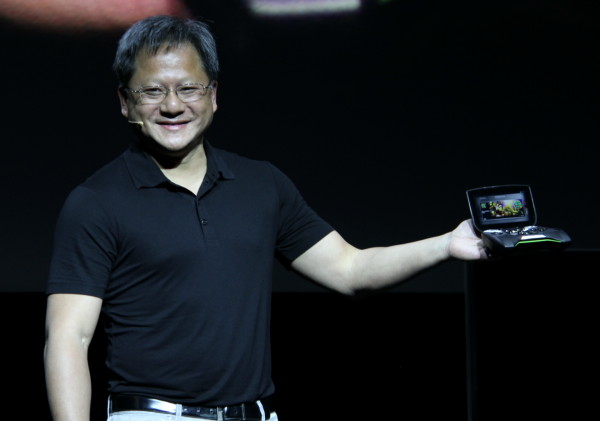

Jen Hsun Huang, le CEO de Nvidia, dévoile le projet Shield.

Projet Shield repose bien évidemment sur le SoC Tegra 4 maison. Il est accompagné d'une batterie de 38 Wh, similaire à ce que l'on retrouve sur les tablettes, et dispose d'un écran multi-touch de 5" en 720p. Nvidia précise avoir soigné la qualité des éléments de contrôle ainsi que le système sonore et la connectique qui comprendra une sortie HDMI, un port micro-USB et un slot microSD. Enfin, un contrôleur wifi 802.11n 2x2 MIMO est de la partie.

Si Nvidia a opté pour un contrôleur wifi performant, c'est parce que la stratégie n'est pas simplement de supporter la bibliothèque de jeu Android compatibles avec Tegra 4. Tous les PC équipés d'une GeForce Kepler (à partir des GTX 650/660M) pourront ainsi à travers une future version du logiciel GeForce Experience, diffuser les jeux vers la console de Nvidia. Une connexion wifi performante du côté du PC sera bien entendu recommandée, et globalement le résultat sera proche de celui de GRID, sans le coût de l'abonnement.

Par ailleurs, Nvidia prévoit également la possibilité d'utiliser Shield comme contrôleur alors que le PC diffusera les images du jeu directement vers la TV, qui devra être équipée d'un adaptateur WiFi avec décodeur H.264. Reste qu'un PC de jeu et une TV étant par essence fixes, une liaison HDMI entre les deux en gardant Shield en tant que manette WiFi parait être une meilleure solution, il faudra voir si Nvidia le permettra.

Projet Shield devrait se concrétiser dans le courant du printemps. La tarification reste inconnue (300 ?) tout comme la stratégie de distribution de Nvidia. En direct ? Via ses partenaires habituels ? Sera-t-il réellement possible pour Nvidia de se battre face aux grands noms de la console de jeu ? Face aux smartphones ?

Nvidia disposant pour sa présentation de plusieurs prototypes fonctionnels, nous supposons que nous pourrons les approcher de plus près durant le CES.

CES: Nvidia dévoile le couple Tegra 4 / i500

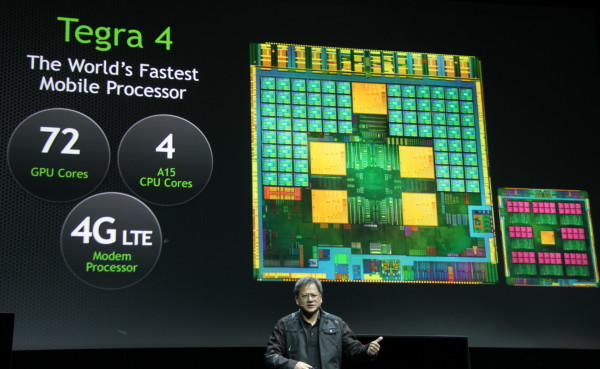

Comme prévu, Nvidia profite du CES 2013 pour dévoiler officiellement un nouveau SoC destiné au monde mobile : Tegra 4. Connu précédemment sous le nom de code Wayne, en référence au superhéros, il s'apprête à succéder au Tegra 3.

Nvidia reprend ici une structure similaire à celle de ce dernier mais profite d'une fabrication en 28 nanomètres, sur le process HPL de TSMC (optimisé pour réduire les courants de fuite et donc la consommation). L'utilisation de cette technologie plus avancée permet de pouvoir augmenter la complexité de la puce par rapport au 40nm de Tegra 3.

La base de Tegra 4 reste composée d'un CPU ARM quadcore, mais il évolue du Cortex A9 vers l'architecture Cortex A15 nettement plus performante et passe de 1.7 GHz à 1.9 GHz. Nvidia conserve l'architecture Variable SMP qui consiste à implémenter un cinquième core CPU optimisé pour une faible consommation, notamment à travers une fréquence réduite. En pratique ce core CPU supplémentaire est une doublure basse consommation d'un des 4 cores principaux qui rentre en scène dès que la charge CPU est faible.

Dans Tegra 3, ce cinquième core était implémenté via un type de transistors différents, mais cette possibilité n'existe pas sur le procédé de fabrication 28nm HPL de TSMC. Il est donc possible que son influence soit moindre sur Tegra 4, bien que Nvidia ne donne pas de détails à ce sujet.

Le die de Tegra 4. Ne cherchez pas à y trouver les secrets du SoC, il s'agit d'un montage photoshop créé pour faire ressortir visuellement ses spécifications principales.

Le GPU évolue également et passe de 12 à 72 cores, encore une fois sans précision au niveau des capacités exactes de ces cores, si ce n'est qu'il s'agit d'une architecture non-unifiée, c'est-à-dire qui se rapproche plus de l'architecture des GeForce 6800 que des GPU récents de la marque. Nvidia annonce un gain de 6x par rapport à Tegra 3 ce qui nous laisse penser qu'il s'agit de 24 unités de calcul pour le traitement de la géométrie et de 48 unités de calcul pour le traitement des pixels.

La conservation de ce type d'architecture GPU, similaire pour Tegra 2 et Tegra 3, est lié au fait qu'elle permet de réduire la consommation, notamment en réduisant la précision de calcul de la majorité des unités qui sont dédiées au calcul des pixels (20-bit au lieu de 32-bit). Nvidia semble ainsi faire le choix de la puissance brute plutôt que des fonctionnalités graphiques avancées.

Pour alimenter le Tegra 4, le contrôleur mémoire de Nvidia passe enfin au double canal et supporte la LPDDR3 alors que le Tegra 3 devait se contenter de LPDDR2 (ou de DDR3 basse tension) en simple canal.

Le moteur vidéo évolue pour passer en version VP8. Il supporte l'encodage et le décodage en 1440p et le h.264 high profile. Le moteur d'affichage de son côté peut piloter des résolutions jusqu'au 4Kx2K ainsi que le 1080p 120 Hz grâce au support du HDMI 1.4b.

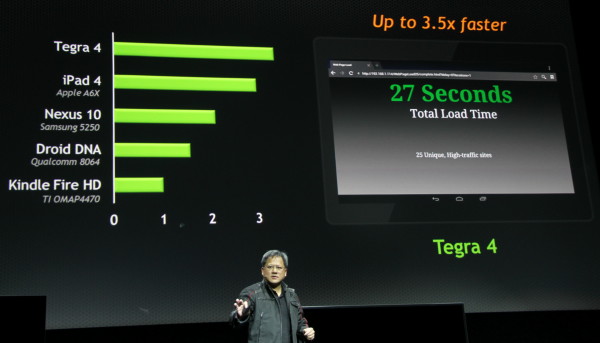

Pour mettre en avant les performances de Tegra 4, Nvidia l'a comparé au SoC Exynos 5 de Samsung intégré dans une Nexus 10, un SoC plus modeste qui se contente de 2 cores Cortex A15 à 1.7 GHz. Le test représentait le chargement/rendu de 25 pages web stockées sur un serveur local et comme vous vous en doutez, le Tegra 4 était presque 2x plus rapide. Il faut par contre préciser que les navigateurs n'étaient pas les mêmes, ce qui peut avoir une grande influence dans ce type de test...

Pour exploiter cette puissance de calcul, Nvidia a mis en avant 2 autres exemples. Tout d'abord les jeux vidéo, qui ne demandent qu'à exploiter toute la puissance disponible, ne serait-ce que pour s'adapter à la résolution grandissante des smartphones et tablettes.

Ensuite Nvidia a pris longuement en exemple le cas des photos HDR qui peuvent profitent des 4 cores et du GPU pour être traitées et affichées presque instantanément. Par ailleurs, Nvidia a intégré directement le support du HDR dans le driver du processeur d'image et du capteur pour pouvoir faciliter son support par les applications et pour réduire le temps entre les clichés exploités pour créer l'image finale : Nvidia parle de 0.2s d'intervalle pour Tegra 4 contre 2s pour certains smartphones actuels. En pratique ce type d'évolution va se retrouver progressivement dans l'ensemble des solutions mobiles équipées de capteurs photos et n'a pas de lien réellement spécifique avec le Tegra 4 autre que le fait qu'elle profite de l'évolution de la puissance de calcul et qu'en terme de communication, Nvidia aimerait pouvoir en faire un élément différenciateur pour son dernier SoC.

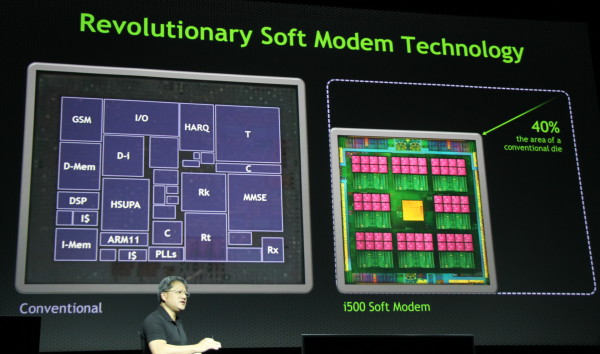

Notez que si le Tegra 4 n'intègre pas de modem, Nvidia propose optionnellement un modem 4G/LTE externe baptisé i500 et tiré du rachat d'Icera. Ce modem repose sur une architecture particulière qui fait la part belle aux unités programmables (il est annoncé avec 8 "cores") et laisse tomber les unités fixes. De quoi pouvoir supporter plus efficacement tous les standards et réduire considérablement la taille de la puce : -40% par rapport à une solution conventionnelle selon Nvidia.

Reste un point que Nvidia n'a pas abordé, que ce soit pour le Tegra 4 ou pour l'i500 : la consommation. Un point bien entendu primordial, et nous pouvons supposer que l'absence de communication à son sujet n'en fait pas le point fort de ces composants par rapport à leurs concurrents, certes moins puissants. Il faudra probablement attendre l'arrivée de produits finaux pour en savoir plus à ce sujet.