| |

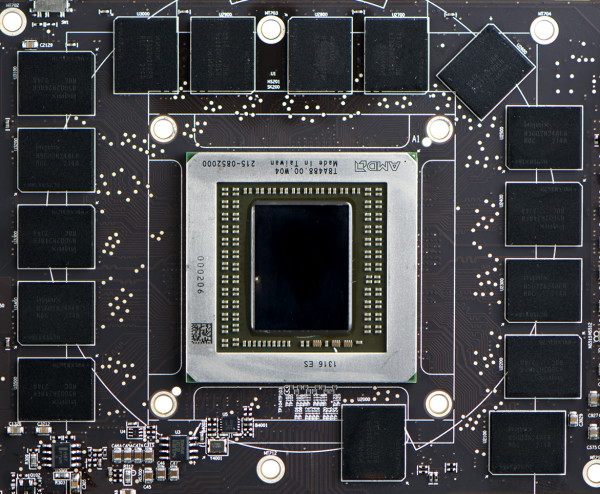

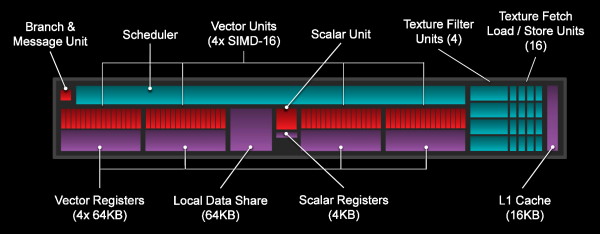

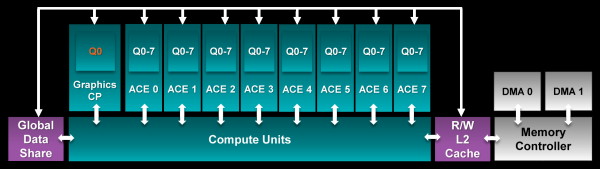

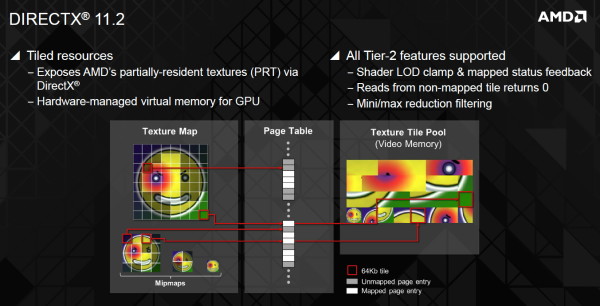

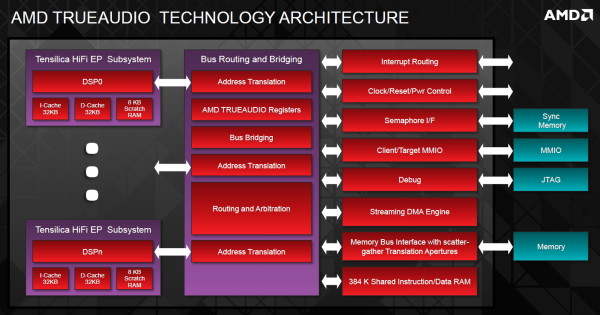

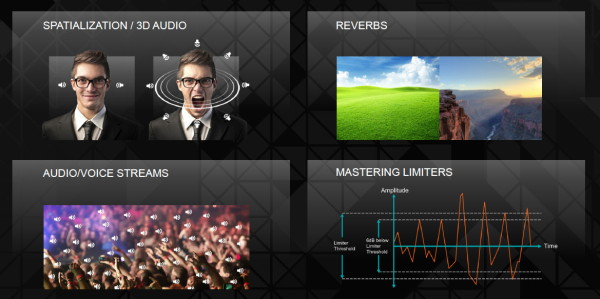

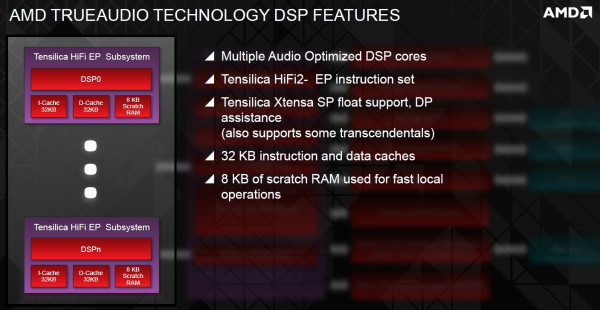

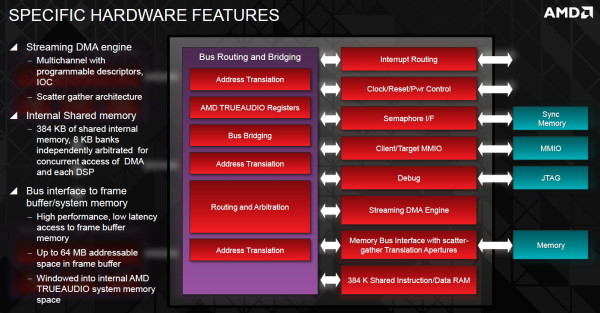

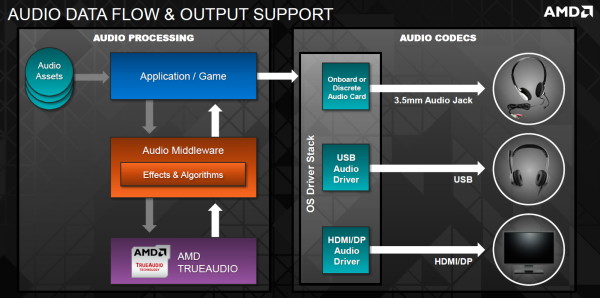

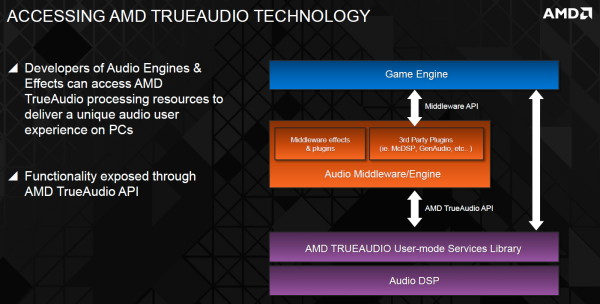

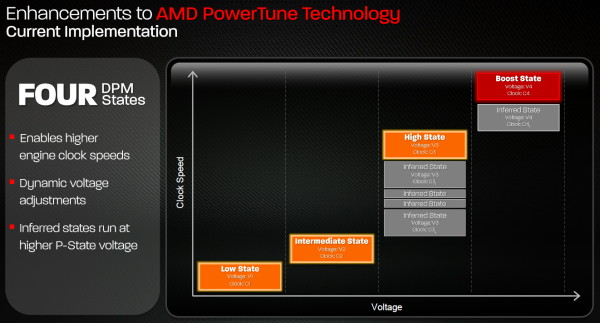

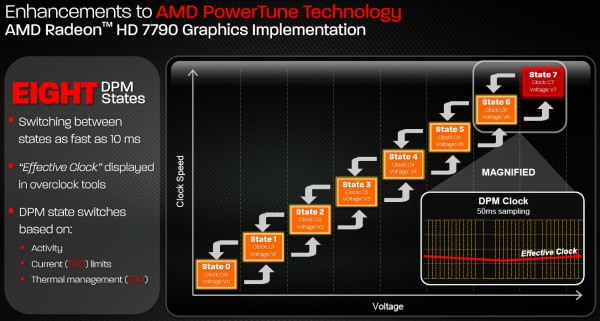

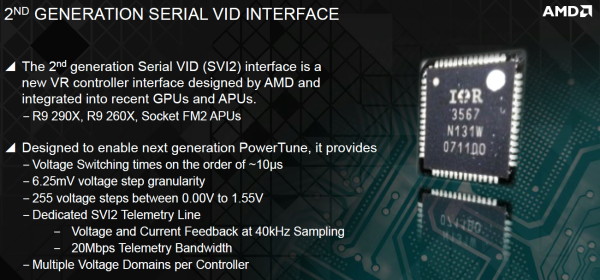

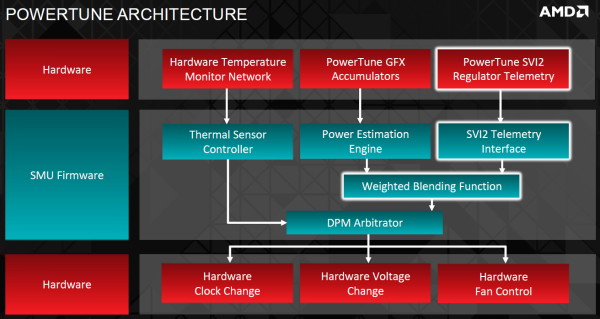

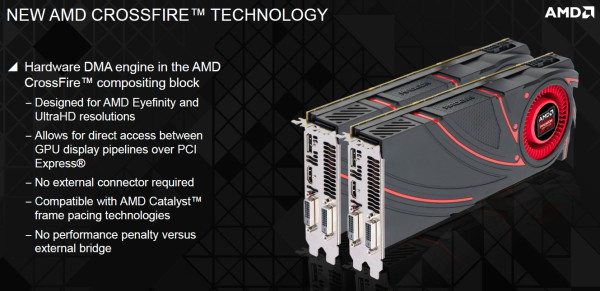

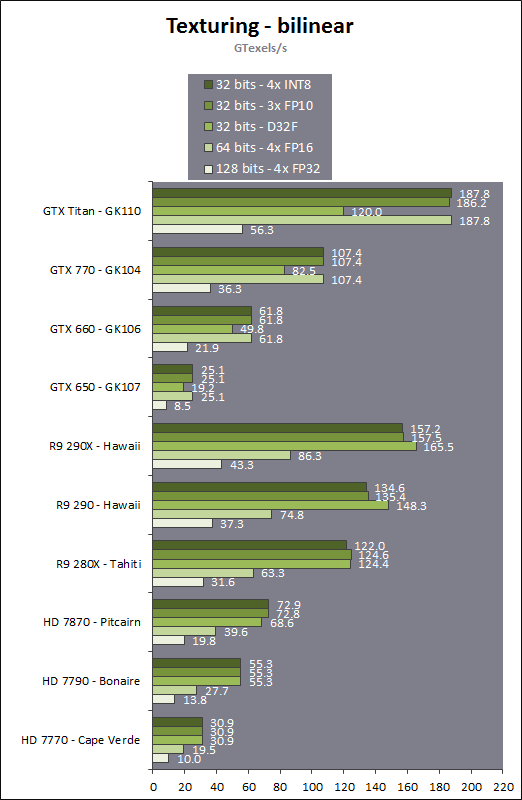

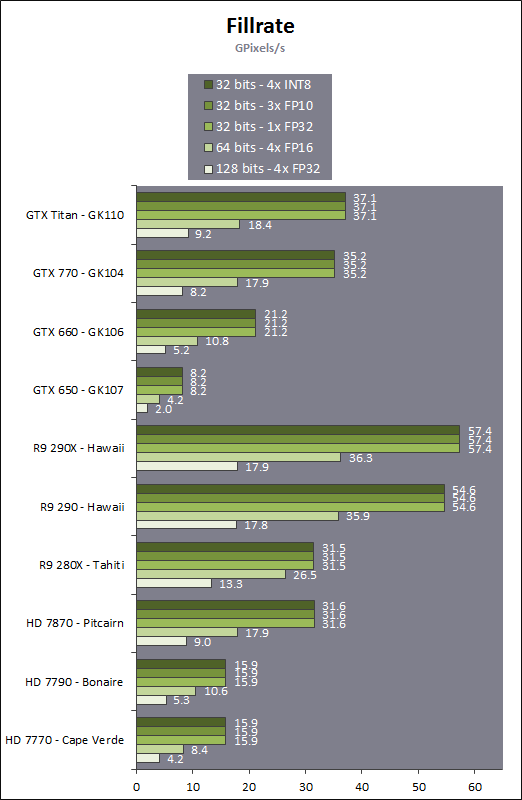

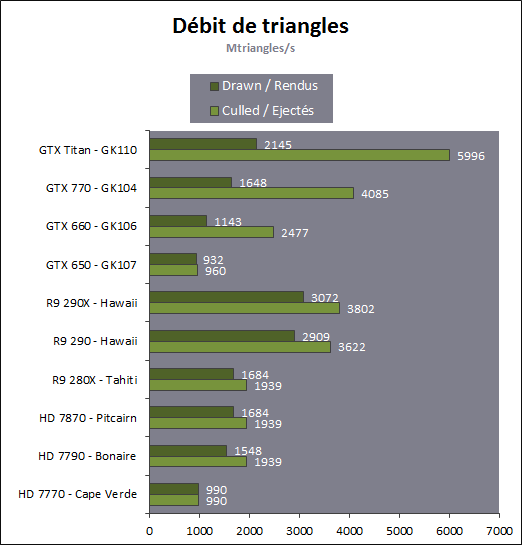

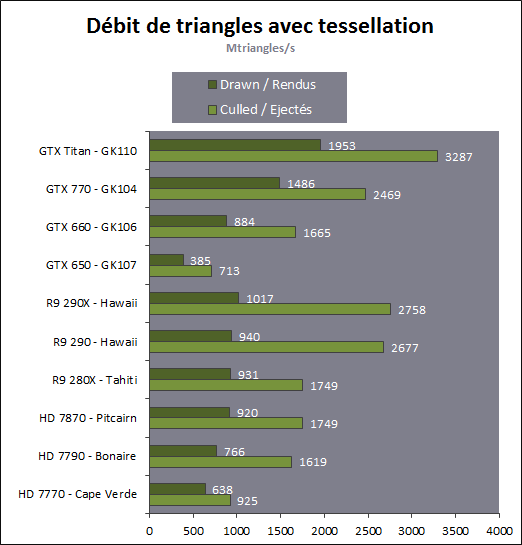

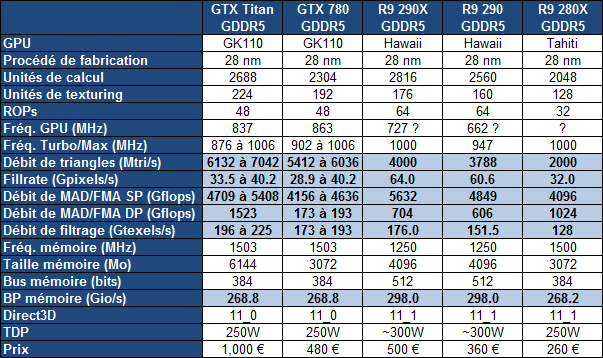

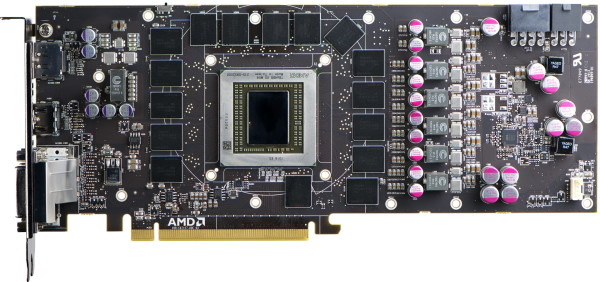

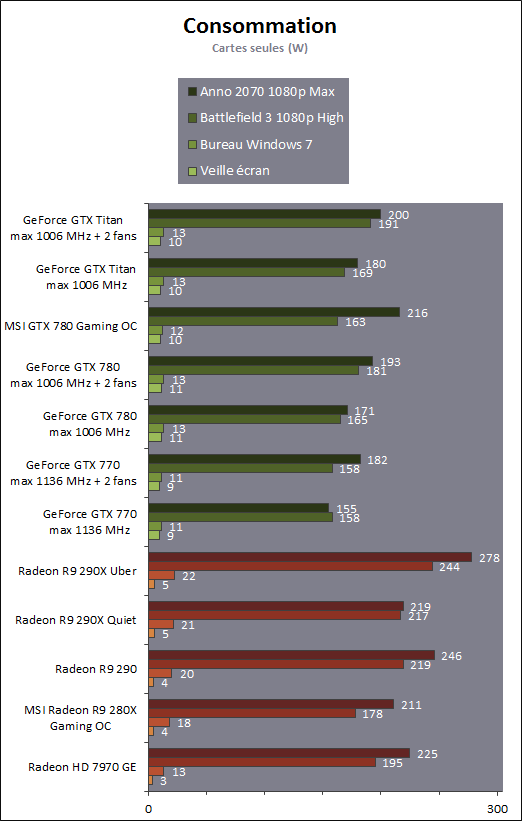

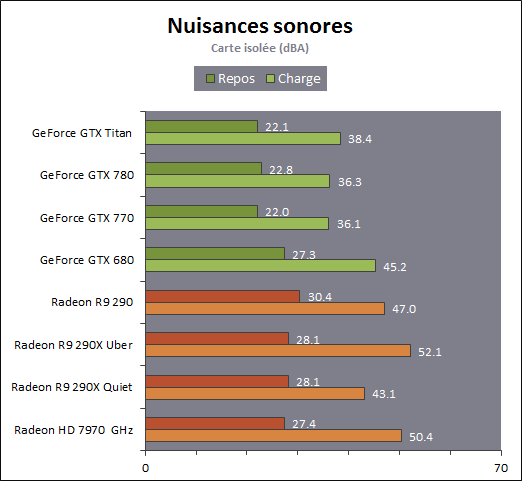

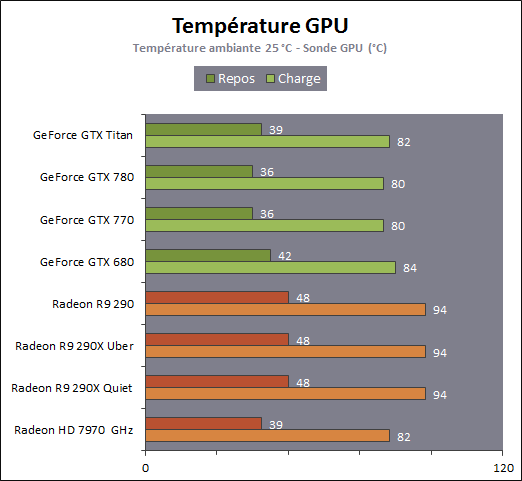

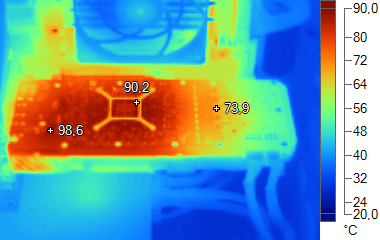

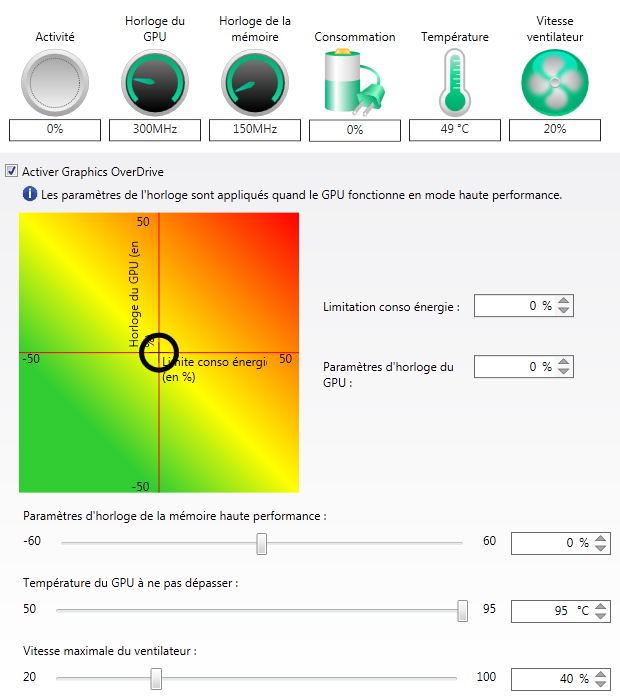

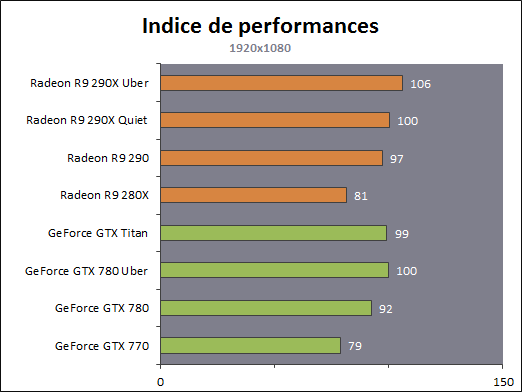

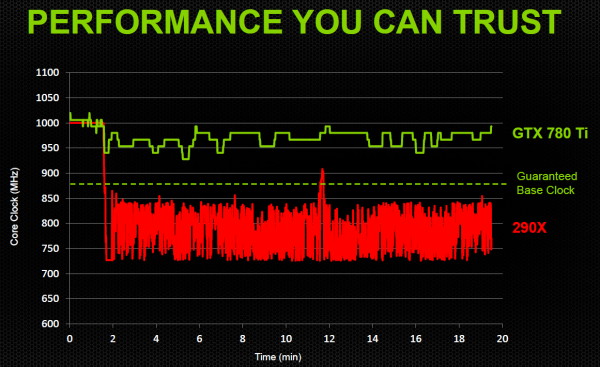

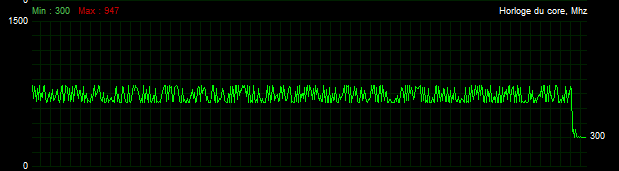

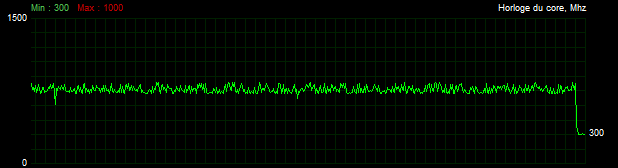

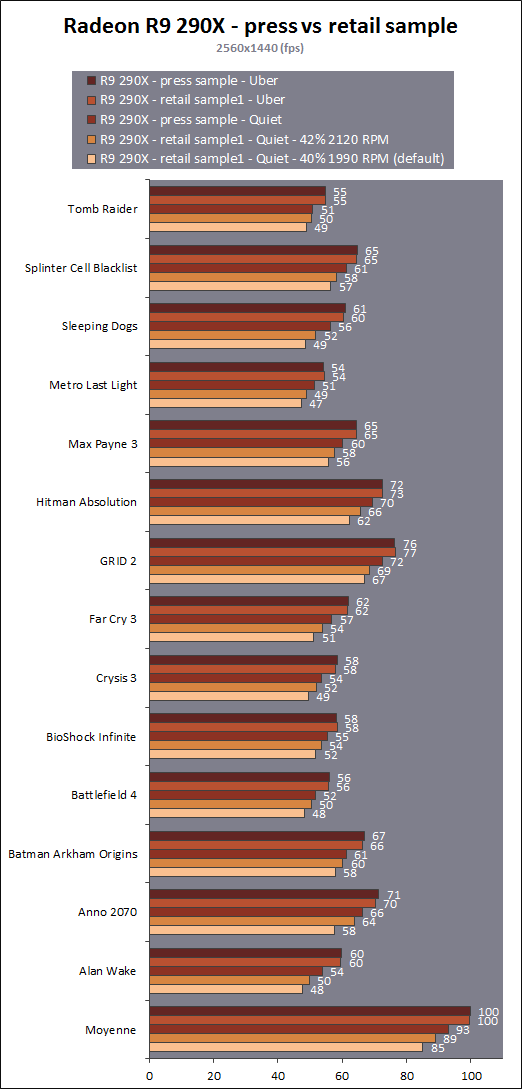

| AMD Radeon R9 290X et R9 290 en test : Hawaii sort ses watts Cartes Graphiques Publié le Mercredi 6 Novembre 2013 par Damien Triolet URL: /articles/910-1/amd-radeon-r9-290x-test-hawaii-sors-ses-watts.html Page 1 - Introduction Enfin ! Cela s'active sur le segment haut de gamme jusqu'ici largement dominé par Nvidia et les GeForce GTX Titan et GTX 780. Avec un nouveau GPU de 6.2 milliards de transistors qui prend place dans les Radeon R9 290X et R9 290, AMD compte bien jouer des coudes pour convaincre les joueurs à la recherche des meilleures performances.  Hawaii : un compromis à 6.2 milliards de transistorsProposer une évolution des cartes graphiques haut de gamme alors que le procédé de fabrication exploité pour leurs GPU n'évolue pas est loin d'être simple. C'est pourtant ce qu'attendent de nombreux joueurs et tant AMD que Nvidia doivent y répondre en essayant de tirer le meilleur compromis en termes de performances, de coûts de fabrication, de consommation et nuisances liées etc. Pour passer du GK104 ou GK110, Nvidia a opté pour un élargissement massif de l'architecture de son GPU, ce qui lui a permis d'augmenter significativement les performances dans une enveloppe thermique donnée. Cela peut paraître contre-intuitif au premier abord, mais à l'intérieur d'une certaine plage de performances, plus un GPU est gros, moins il consomme. Ceci s'explique par le fait qu'un plus gros GPU pourra être cadencé à une fréquence moindre, ce qui veut dire tension moindre et consommation relative en nette baisse. Cette approche a un coût important, rappelons que la surface d'une puce est un des paramètres principaux qui définissent son coût de fabrication. Le GK110, est passé à 7.1 milliard de transistors (569 mm²) par rapport aux 3.5 milliards du GK104 (294 mm²), différence qui inclut cependant l'ajout de fonctions dédiées au marché professionnel (double précision, ECC...). La voie prise par Nvidia est d'autant plus coûteuse qu'elle revient à laisser de côté une partie des performances dont est capable le GPU.  Hawaii et ses 16 puces GDDR5 : 6.2 milliards de transistors et bus 512-bit. AMD a également élargi l'architecture de son GPU en passant de Tahiti à Hawaii, mais dans une moindre mesure, le compromis ayant été fait plus en faveur des coûts de fabrication. Presque mécaniquement, cela signifie qu'AMD doit soit se contenter de performances inférieures à celle de la concurrence, soit d'une consommation en hausse. C'est ce second choix pour lequel AMD a opté mais en travaillant l'unité de gestion Powertune du GPU pour contenir quelque peu sa gourmandise et les nuisances liées. Pour rappel, le précédent GPU Radeon haut de gamme, Tahiti, a inauguré le procédé de fabrication 28 nanomètres et par conséquent en a essuyé les plâtres, ce qui donne à AMD une petite marge de manuvre supplémentaire pour son évolution sur le 28nm. Nous avons des raisons de penser que Tahiti est le seul GPU qui a été fabriqué en 28nm HP alors que tous les autres GPU GCN, dont Hawaii, l'ont été sur une autre variante que nous supposons être le 28nm HPL. Entre Tahiti et les autres GPU, AMD a par ailleurs exploité une implémentation différente de ses interfaces mémoire GDDR5 (PHY). Nettement plus compactes, ces interfaces sont potentiellement moins bien adaptées aux très hautes fréquences de bus mais permettent un gain de densité tel que l'avantage est évident. C'est ce qui a permis à AMD de placer un bus mémoire de 512-bit sur Hawaii. Même avec une fréquence limitée, il permet une progression de la bande passante, mais occupe en pratique sur le GPU une surface inférieure de 20% à celle du bus 384-bit du GPU Tahiti. De quoi permettre à AMD d'augmenter la densité moyenne de transistors dans son nouveau GPU qui passe à 6.2 milliards de transistors et 438 mm² par rapport aux 4.3 milliards de transistors et 352 mm² de Tahiti. Un monstre plus raisonnable que le GK110, mais un monstre tout de même qui voit sa puissance de calcul progresser de 37% et ses débits de pixels et de triangles doubler. Page 2 - Hawaii : l'architecture du GPU Hawaii : l'architecture du GPUComme tous les GPU AMD depuis Tahiti et la Radeon HD 7900, Hawaii est basé sur l'architecture GCN qui a la particularité d'exploiter ses unités vectorielles de façon à ce qu'elles présentent un comportement scalaire plus efficace du point de vue des shaders, ces programmes qui sont exécutés sur la géométrie ou les pixels. Nous avions détaillé cette évolution de l'architecture graphique d'AMD vers GCN lors de sa sortie. A sa base, cette architecture repose sur des blocs fondamentaux appelés Compute Units (CU) qui intègrent chacun 64 unités de calcul (les "cores" en langage marketing), 4 unités de texturing, des caches et toute la logique de contrôle nécessaire au bon fonctionnement de l'ensemble. Voici résumées les spécifications des 6 GPU GCN actuels : Oland : 6 CU, 1 triangle par cycle, 8 ROP, L2 256 Ko, 128 bits Cape Verde : 10 CU, 1 triangle par cycle, 16 ROP, L2 512 Ko, 128 bits Bonaire : 14 CU, 2 triangles par cycle, 16 ROP, L2 512 Ko, 128 bits Pitcairn : 20 CU, 2 triangles par cycle, 32 ROP, L2 512 Ko, 256 bits Tahiti : 32 CU, 2 triangles par cycle, 32 ROP, L2 768 Ko, 384 bits Hawaii : 44 CU, 4 triangles par cycle, 64 ROP, L2 1024 Ko, 512 bits Plus en détail, voici les représentations de l'architecture des 4 derniers GPU listés, retravaillées sur base des dernières informations qui vont nous permettre de reparcourir l'architecture GCN avec quelques détails supplémentaires :  [ Bonaire ] [ Pitcairn ] [ Tahiti ] [ Hawaii ] Pour les versions plus grandes de ces diagrammes : Lors de la présentation du GPU Hawaii, nous avons pu en savoir plus sur l'organisation interne des GPU GCN, détails qu'AMD n'avait pas communiqués jusqu'ici et qui rendent les précédents diagrammes d'architecture légèrement incorrects. AMD introduit le concept de Shader Engine, une structure qui comprend une unité de traitement géométrique ainsi que les blocs d'unités de calcul et de ROP (ou RB, Render Back-ends) qu'elle alimente. Pour certains GPU GCN, vient s'ajouter le concept de Shader Array, des sous-ensembles d'unités de calcul et de ROP présents à l'intérieur d'un Shader Engine. Ces concepts sont bien entendu comme toujours une représentation imaginée et simplifiée de l'architecture, l'implémentation physique étant plus complexe et souvent différente. La raison de cette subdivision en Shader Engines et en Shader Arrays est liée d'une part à des contraintes physiques (consommation, répartition des points chauds sur la puce etc.) et d'autre part à la volonté de faciliter la distribution équilibrée des différentes tâches, principalement des pixels. Chaque groupe de ROP se voit assigner statiquement un ensemble de petites zones (tiles) de l'image qui est ainsi virtuellement quadrillée. Lorsqu'un triangle est pris en charge par un moteur géométrique, celui-ci doit donc être répliqué dans tous les rasterizers qui correspondent aux zones de l'écran qu'il affecte, ce qui est par exemple le cas de tous les triangles de plus de quelques pixels, raison pour laquelle un bus de communication relie tous les moteurs géométriques entre eux sur ces diagrammes. En d'autres termes, n'importe quel rasterizer ne peut pas générer des pixels qui correspondent à n'importe quelle zone de l'écran. Et n'importe quel Shader Engine / Shader Array ne peut pas calculer et écrire en mémoire n'importe quel pixel. Cette approche relativement rigide permet de répartir d'une manière équilibrée les pixels entre les différentes unités de calcul et ROP. Elle impacte directement la possibilité des proposer des versions castrées de ces GPU. Pour conserver cet équilibre, AMD doit ainsi désactiver un nombre de CU proportionnel au nombre de SE/SA. Par exemple il n'est pas possible de créer un GPU Pitcairn avec 18 CU, la version castrée du GPU doit obligatoirement passer à 16 ou 12. Il en va de même pour Tahiti et Hawaii (le nombre de CU passe de 44 à 40 pour la Radeon R9 290). Par contre les CU de Bonaire et Cape Verde peuvent être désactivés par paires alors qu'un seul CU à la fois peut-être désactivé sur Oland, ce qu'AMD a fait pour la Radeon R7 240.  A l'intérieur d'un Shader Engine, peuvent se retrouver un ou deux Shader Arrays, concept qui s'efface dans le premier cas par souci de simplification. A l'intérieur du Shader Array nous retrouvons un certain nombre de Compute Units, de 5 à 11 suivant les designs proposés par AMD, mais nul doute que l'architecture est prévue pour aller au-delà. À côté des CU, prennent place les mémoires qu'ils se partagent par groupe de 4 maximum (les barres verticales violettes sur les diagrammes) : cache L1 pour les unités scalaires/constantes (K$ 16 Ko) et cache L1 pour les instructions (I$ 32 Ko). Dans le cas de Tahiti illustré ici, avec 8 CU par Shader Array, ceux-ci se regroupent par 4 au niveau de ces petits caches. Dans le cas de Hawaii, avec 11 CU par Shader Engine, le dernier groupe n'est composé que de 3 CU. Pitcairn est le moins efficace au niveau de l'implémentation puisqu'il faut deux ensembles de caches pour seulement 5 CU. Enfin, tout à gauche, nous retrouvons les partitions de ROP (RB), jusqu'à 4 par Shader Engine. Chaque partition représente 4 ROP capables de prendre en charge et écrire en mémoire jusqu'à 4 couleurs ainsi que 16 valeurs Z, et englobe les différents caches nécessaires à leur fonctionnement optimal. Avec GCN 1.1, soit Bonaire et Hawaii, les performances des ROP ont été revues à la hausse, notamment en HDR FP16, grâce à un regroupement plus intelligent des pixels qui permet de les stocker et de les réordonner jusqu'à 2x plus efficacement. Par ailleurs les ROP sont capables de détecter plus efficacement quand les écritures sont inutiles lors du mélange de pixels de manière à pouvoir les éviter et économiser de la bande passante mémoire. AMD nous indique par ailleurs que ces deux optimisations permettent également d'économiser de l'énergie au niveau des ROP, ce qui a probablement participé à permettre de doubler leur nombre entre Tahiti et Hawaii. Alors que les ROP sont connectés directement aux contrôleurs mémoire puisqu'ils intègrent déjà un cache hyper spécialisé, les CU, via toutes leurs voies de lectures/écritures, sont connectés au cache L2 qui passe à 1 Mo sur Hawaii. C'est 33% de plus que pour Tahiti, au niveau de sa taille mais également au niveau de la bande passante interne qui y est proportionnelle. Entre les différents L1 et le cache L2 de Hawaii, la bande passante combinée peut ainsi atteindre 1 To/s. Le tout alimente ensuite le bus mémoire de 512-bit.  Au cur de chaque CU, nous retrouvons les 4 unités vectorielles 16D (SIMD) qui forment les 64 "cores" mis en avant par le marketing. Chaque SIMD dispose d'un fichier registres dédié de 64 Ko et chacune de ses lignes d'exécution est capable d'effectuer une opération de type FMA 32-bit par cycle (2 flops). Les instructions complexes sont traitées en plusieurs cycles par les SIMD, contrairement à l'architecture Nvidia qui dispose d'unités dédiées. Ces SIMD sont capables de traiter les opérations en double précision (64-bit) en 16 cycles soit à 1/16ème de leur débit classique. AMD a cependant la possibilité d'augmenter ce débit en complexifiant ses unités de calcul. Tahiti est ainsi passé à un débit de 1/4 alors que Hawaii dans sa version R9 290X se contente de 1/8ème sans que nous ne sachions avec certitude s'il s'agit du maximum dont est capable le GPU ou s'il a été bridé pour donner un avantage sur ce point à sa version FirePro. Toute la logique de contrôle est intégrée au niveau du CU ainsi que 64 Ko de mémoire partagée (LDS, Local Data Share) et un ensemble de 4 unités de texturing et 16 unités de lectures/écritures qui leur sont liées. Celles-ci accèdent à la mémoire externe via un cache L1 de 16 Ko. Pour les GPU GCN 1.1, les CU ont été mis à jour pour intégrer la mémoire partagée dans un espace mémoire unifié (flat addressing), évolution nécessaire pour la HSA qui facilitera notamment le travail des compilateurs dans le cadre du GPU Computing. Seconde petite évolution : AMD a amélioré la précision des instructions natives LOG et EXP, ce qui devrait permettre de les privilégier dans plus de cas par rapport aux macros moins performantes (pour le détail, la précision passe à 1 ULP).  Si nous revenons à un niveau plus élevé de l'architecture, Hawaii est le premier GPU AMD à disposer de 4 processeurs géométriques, ce qui veut dire qu'il peut prendre en charge jusqu'à 4 primitives (triangles, lignes, points) par cycle. L'unité de tessellation étant présente à ce niveau (elle est distribuée dans les ensembles d'unités de calcul chez Nvidia), la capacité de Hawaii à générer des triangles est également doublée par rapport à Bonaire/Pitcairn/Tahiti. Pour rappel, lorsque la quantité de triangles et données associées qui sont générés est élevée, ils doivent être dirigés vers la mémoire vidéo, ce qui est moins efficace que de tout garder à l'intérieur du GPU mais permet d'éviter d'engorger celui-ci à un point tel qu'il serait totalement paralysé. Pour gagner en efficacité dans certains cas, AMD indique avoir apporté quelques optimisations au niveau du buffer utilisé pour le transfert en mémoire vidéo du flux de données généré par la tessellation. Par ailleurs, pour éviter d'y avoir recours autant que possible, la mémoire partagée peut être exploitée d'une manière plus flexible en tant que cache pour les données géométriques. Compte tenu du gain que nous avons observé sur tous les GPU GCN avec les pilotes récents, nous supposons que ce dernier point est une évolution logicielle qui n'est pas spécifique à Hawaii.  Bien qu'AMD ne mette que très peu en avant ce point, ou tout du moins évite d'en parler, Bonaire et Hawaii introduisent une légère évolution de l'architecture GCN que nous qualifions de 1.1. En plus de petits détails décrits ci-dessus, ces évolutions concernent principalement le processeur de commande du GPU et sont destinées au GPU Computing et à la HSA (Heterogeneous System Architecture). Parmi ces évolutions, notons le support de 8 files d'attente par compute pipeline (ACE, Asynchronous Compute Engine), ce qui va dans le sens de la technologie Hyper Q de Nvidia réservée aux Tesla K20 et permet de mieux alimenter le GPU en évitant que lors de dépendances entre kernels (programmes à exécuter), le GPU ne se retrouver bloqué en attendant le résultat de l'un d'eux. Ainsi, les 2 ACE de Bonaire permettent de supporter jusqu'à 16 files d'attente alors que Hawaii passe, comme les GPU intégrés aux APU des PS4 et Xbox One, à 8 ACE et donc à 64 files d'attente. De quoi autoriser un gain d'efficacité significatif du GPU Computing où de nombreuses petites tâches doivent être traitées, ce qui revient à rendre son utilisation envisageable en pratique dans plus de cas. Un adressage mémoire unifié est également au programme et de nouvelles instructions font leur apparition dont certaines dédiées au débogage du code. Vous pourrez retrouver un extrait du document qui détaille l'évolution du jeu d'instruction (mais qui a été retiré par AMD le temps d'en corriger certaines notations qui étaient peu claires au niveau du nom des différentes architectures) dans le dossier que nous avions consacré à Bonaire il y a 6 mois de cela.  La dernière nouveauté se situe au niveau du support complet (Tier2) d'une fonctionnalité optionnelle de DirectX 11.2 : les Tiled Resources, sujet que nous avons déjà évoqué. Rappelons que DirectX 11.2, ou plutôt Direct3D 11.2, n'introduit que de petites nouveautés optionnelles pour les niveaux matériels 11_0 et 11_1 et qu'aucun niveau matériel 11_2 n'existe au grand dam des fabricants de GPU qui ont l'habitude d'essayer de mettre en avant ce point. Parler de GPU de génération DirectX 11.2 est donc un non-sens dont ne manqueront cependant pas d'abuser certains acteurs de l'industrie. Support complet des tiled resources ou pas, Bonaire et Hawaii ne sont en réalité pas plus DirectX 11.2 qu'une Radeon R9 280X, qu'une Radeon HD 7000, qu'une GeForce GTX 700 ou qu'une Radeon HD 3000 ! Page 3 - TrueAudio TrueAudioAvec Windows Vista, Microsoft a en quelque sorte mis à la retraite tous les accélérateurs audio. Par souci de simplifier et rendre plus fiable sa pile audio, celle-ci a été implémentée d'une manière logicielle alors qu'elle l'était auparavant au niveau de pilotes ce qui donnait pas mal de flexibilité aux développeurs d'accélérateurs audio. Certes, si DirectX à travers DirectSound ou EAX a fermé des portes, OpenAL a permis de continuer à utiliser des accélérateurs audio mais avec une portée nettement plus limitée.  À travers TrueAudio, AMD entend contribuer à changer cela. Dans bien des cas, les développeurs de jeux vidéo sont limités en terme de budget CPU attribué à la partie audio de leur moteur ce qui les force à se contenter d'effets simples et/ou prérendus en évitant en positionnement en 3D et en temps-réel des sons. AMD est convaincu que les gros studios vont vouloir aller plus loin sur le plan audio et que l'arrivée de consoles dont les processeurs intègrent des capacités de traitement audio évoluées vont rapidement les convaincre de faire le pas. En concevant ces processeurs, AMD est, il est vrai, dans une position idéale pour avoir une idée du bon timing pour ce genre de chose. A la question de savoir si TrueAudio est identique à ce qui va se faire sur l'une des consoles à venir, AMD ne répond pas et se contente de dire que, peu importe, si les gros studios veulent aller plus loin au niveau audio et que les développeurs des moteurs de jeux sautent le pas, il suffira de les convaincre d'ajouter un module TrueAudio. Parmi les effets visés par l'accélération matérielle, AMD met principalement en avant le son 3D en général mais également les réverbérations ou le placement précis des voix.  TrueAudio est un accélérateur de traitement audio intégré aux GPU Hawaii et Bonaire. Exactement de la même manière, AMD aurait pu exécuter ce traitement à travers OpenCL, des démos ont d'ailleurs était faites précédemment dans ce sens. Le problème est que cela aurait représenté une utilisation inefficace de ses unités de calcul alors que quelques petits circuits spécialisés peuvent fournir le même résultat à coût réduit, voire négligeable pour un gros GPU, et ce à une fraction de la consommation.  AMD a donc opté pour un petit DSP (Digital Signal Processor). Celui est basé sur un ensemble de cores HiFi EP de Tensilica , société spécialisée dans le traitement audio. AMD ne précise pas quel nombre de cores ont été intégrés mais nous a indiqué que ce nombre était identique pour Hawaii et Bonaire, les deux GPU équipés de TrueAudio. Chacun de ces cores, programmables en C, dispose d'un DSP spécialisé dans le traitement audio 24-bit et dont la ou les unités de calcul vectoriel sont de type VLIW, de 32 Ko de L1D, de 32 Ko de L1I et de 8 Ko de mémoire scratch.  Intégrer ces cores n'est cependant pas suffisant et AMD a dû les encadrer d'une structure qui permet de les piloter et de les alimenter. Elle inclut notamment 384 Ko de cache commun, un accès au bus mémoire pour piloter jusqu'à 64 Mo de mémoire vidéo et bien entendu un moteur DMA pour s'assurer d'un transfert rapide de toutes les données nécessaires au bon fonctionnement de TrueAudio.  Attention, il ne s'agit pas d'une carte son ! TrueAudio est un accélérateur de traitement audio auquel accède uniquement l'application qui lui envoie un signal, le reçoit une fois traité et renvoie ce signal vers la pile Windows standard. Même dans le cas où la sortie HDMI de la carte graphique est exploitée pour transporter le son, celui-ci doit faire un aller-retour vers l'application et la pile Windows.  Du point de vue des développeurs, il sera possible d'accéder aux capacités de traitement de TrueAudio via l'API AMD TrueAudio qui est en cours de finalisation. Pour que cela soit réellement utile en pratique, AMD devra convaincre un maximum de fournisseurs de middlewares de supporter sa solution. Dans l'immédiat deux développeurs ont annoncé le support de TrueAudio. Le développeur indépendant Xaviant qui travaille sur le jeu Lichdom. Il était en démonstration avec une version fonctionnelle de TrueAudio lors de la présentation à la presse du GPU Hawaii et force est de constater que la démonstration était plutôt très convaincante sur le plan du positionnement audio. AMD a également convaincu les développeurs d'Eidos/Square Enix, avec lesquels ils ont déjà travaillé sur plusieurs jeux, d'intégrer le support de TrueAudio dans le nouveau Thief, prévu pour fin février 2014. Est-ce que cette initiative ira au-delà du support dans une poignée de jeux ou finira aux oubliettes ? Affaire à suivre... Page 4 - Powertune évolue PowertunePowerTune est depuis quelques années la technologie de contrôle de la consommation des GPU AMD. A l'origine, elle consistait à utiliser de nombreux capteurs de charge internes pour estimer aussi précisément que possible la consommation du GPU de manière à l'empêcher de dépasser le TDP. Une approche totalement déterministe qui permet à chaque exemplaire d'afficher des performances identiques dans des conditions identiques, comme c'est le cas sur les CPU et contrairement à la technologie GPU Boost de Nvidia qui se base sur une mesure directe de l'intensité du courant. Par ailleurs, PowerTune est une unité de contrôle intégrée directement dans le GPU alors que GPU Boost est un monitoring principalement logiciel. PowerTune peut donc réagir beaucoup plus vite et surtout travailler à une fréquence plus élevée.  Sur les Radeon HD 7000 originales, 3 P-states étaient exploités par PowerTune avec un High State dans lequel pouvait évoluer les fréquences/tensions. Les Radeon HD 7970 GHz Edition et HD 7950 v2 ont introduit un 4ème P-state. Ce Boost State permet de faire évoluer la fréquence avec une tension plus élevée. À partir de Bonaire, AMD a remis à plat sa gestion des P-sates :  Pour la Radeon 7790, 8 P-States qui représentent des couples fréquence/tension différents sont cette fois exploités. Suivant l'activité du GPU, l'estimation de sa consommation et de son échauffement, PowerTune va faire passer le GPU d'un P-Sate à l'autre avec une granularité de 10 ms. AMD précise cependant que dans les outils d'overclocking, la fréquence reportée sera lissée, sans donner plus de précisions à ce sujet. Avec Hawaii, PowerTune poursuit son évolution et ce sont cette fois pas moins de 64 P-states qui sont disponibles. Pour gérer tout cela avec un délai de réaction très court, AMD a développé une nouvelle interface, nettement plus rapide, pour le contrôleur de l'étage d'alimentation : SVI2 ( Serial VID 2).  Celle-ci autorise des changements de tension/fréquence tous les 10 µs, avec une granularité de 6.25 mV. AMD n'a pas pu nous indiquer la variation minimale de fréquence à laquelle cela correspond mais nous l'estimons à +/- 10 MHz dans le cas des Radeon R9 290. Il est difficile de l'estimer précisément puisque la valeur reportée par exemple dans GPU-Z n'est jamais la valeur réelle mais une valeur lissée (qui varie alors par +/- 0.8 MHz). Notez que cette interface est capable de supporter jusqu'à 255 P-states mais AMD n'en a pas besoin d'autant pour le moment. Cette interface est capable de transmettre au GPU des tensions/intensités à 40 kHz, ce qui exige une bande passante significative de l'ordre de 20 Mbps. Si le GPU reçoit dorénavant toutes ces données c'est parce qu'AMD a revu complètement le fonctionnement de PowerTune :  En effet, PowerTune sur Radeon R9 290X est dorénavant non-déterministe, exactement comme GPU Boost. Il se base sur la température réelle du GPU ainsi que sur sa consommation réelle, deux paramètres qui vont varier d'un échantillon à l'autre du GPU. Nous n'avons cependant pas ici à faire à la double variation que l'on retrouve du côté de Nvidia du fait que la fréquence turbo varie aussi d'un échantillon à l'autre, ce qui est un autre sujet. La fréquence maximale du GPU de la Radeon R9 290X reste bien fixe et identique pour tous. L'algorithme utilisé par PowerTune peut être très complexe, la technologie étant flexible et les capteurs internes étant toujours présents. PowerTune peut par exemple exploiter les données des capteurs internes et/ou de la consommation instantanée pour en déduire une future élévation de la température GPU et l'anticiper avec une légère hausse de la vitesse du ventilateur alors que sans celle-ci une hausse plus importante aurait été nécessaire. Depuis très longtemps, la courbe de vitesse du ventilateur des cartes graphiques est on ne peut plus simple : T° X = Y %. Ce n'est plus le cas avec la Radeon R9 290X. PowerTune tout comme GPU Boost ne définissent cependant pas le comportement des produits qu'ils pilotent, cette tâche revient à Nvidia et AMD qui choisissent quelles limites imposer pour chaque produit. Avec la Radeon HD 7970, AMD fixait une consommation maximale et une table de correspondance du taux d'activité de chaque bloc du GPU avec la consommation liée. Cette table de correspondance représentait le pire des cas et vu que PowerTune se basait exclusivement sur cette estimation, de nombreuses cartes étaient en pratique à une consommation inférieure et auraient peut-être pu tourner à une fréquence supérieure. C'était le prix à payer pour garantir les mêmes performances pour tous. Avec GPU Boost, Nvidia ne s'est jamais embarrassé de ce détail et étant donné que son approche a été acceptée par la majorité, AMD a estimé qu'il n'y avait plus de raison d'imposer cette limite à ses cartes graphiques. Pour les GeForce GTX 700, Nvidia a opté pour une limite de température basse de 80 °C qui permet de limiter la vitesse du ventilateur puisqu'il s'agit d'une simple courbe comme expliqué plus haut. Son système de contrôle logiciel du GPU se charge de faire en sorte de respecter cette température. Pour la Radeon R9 290X, AMD a dû faire des compromis, en privilégiant les performances. La température visée est ainsi élevée : 95 °C. AMD indique que tous les composants sont prévus pour cette température, bien entendu principalement le GPU et son packaging. Avant d'avoir du recul sur les taux de retour nous ne pouvons que laisser le bénéfice du doute à AMD. Notez que la comparaison avec les 80 °C de Nvidia n'est pas spécialement valide puisque les choix ont été différents et peuvent faire que 95 °C est un problème pour l'un et pas pour l'autre. Ensuite, le lien température vitesse ventilateur n'étant plus rigide, AMD peut imposer une vitesse de ventilateur maximale, ce qui est une meilleure approche au final pour limiter les nuisances sonores que celle de Nvidia. Le problème bien entendu c'est qu'au vu de la consommation élevée du GPU Hawaii, AMD doit accepter une vitesse de ventilateur suffisante. C'est la raison pour laquelle deux modes sont proposés pour la Radeon R9 290X : Quiet avec 40% max (2120 RPM) et Uber avec 55% max (3120 RPM). PowerTune doit s'assurer de ne pas dépasser 94 °C, 40% ou 55% (47% pour la Radeon R9 290) ainsi qu'une consommation GPU de 208W. Il s'agit ici de la consommation du GPU seul, en sortie de l'étage d'alimentation. Ajoutez la perte à son niveau (elle est visible dans GPU-Z en comparant les courants d'entrée et de sortie), la consommation de la mémoire et du reste de la carte graphique et vous obtenez un TDP de +/- 300W. Typiquement voici comment PowerTune se comporte sur la Radeon R9 290X lors du démarrage d'une tâche 3D telle qu'un jeu : 1. Le GPU monte à 1000 MHz 2. Il y reste si sa consommation ne dépasse pas 208W, sinon tension et fréquence sont réduites 3. Le ventilateur accélère lentement jusqu'à 94 °C 4. Si cela est nécessaire, il accélère rapidement jusqu'à sa vitesse maximale pour ne pas atteindre 95 °C 5. Si le GPU atteint 95 °C, tension et fréquence sont réduites jusqu'à revenir à 94 °C 6. Si le GPU est descendu à 727 MHz, le ventilateur peut accélérer au-delà de la vitesse maximale 7. Si la température atteint 100°C pendant 2 secondes, la carte se coupe brutalement Dans le cas de la Radeon R9 290, c'est à partir de 662 MHz que le ventilateur peut accélérer au-delà de la vitesse maximale qui a été définie. Page 5 - CrossFire et Eyefinity aussi CrossFire X via PCI ExpressDepuis les Radeon HD 2900, et après un bref passage via un Compositing Engine externe avec les Radeon X1900, AMD intègre le support de CrossFire dans ses GPU. Il s'agit d'une part d'un Compositing Engine, chargé d'associer le travail des deux GPU et d'autre part d'une interface de communication entre les GPU. Ce sont les fameux connecteurs CrossFire qui prennent place sur le dessus des Radeon. Depuis quelque temps cependant, cette interface n'est plus utilisée dans toutes les situations, notamment en multi-écran avec une résolution Eyefinity. La bande passante offert par le lien CrossFire est limitée à 0.9 Go/s, ce qui ne lui permet pas de prendre en charge les très hautes résolutions. Les transferts entre GPU se font alors directement via le bus PCI Express.  En travaillant sur l'optimisation de ce mode de transfert, AMD s'est aperçu qu'il pouvait être plus flexible et au moins aussi performant que l'interface dédiée, à condition d'intégrer un moteur DMA dans le bloc CrossFire X. Hawaii est le premier GPU à le faire. AMD assure qu'il n'y a aucun impact sur les performances et que cela permet d'activer le Frame Pacing, pour lisser la cadence d'affichage et réduire les micro-saccades, sur toutes les résolutions. Se pose bien entendu la question de l'efficacité suivant le type de PCI Express exploité (3.0 16x, 3.0 8x, 2.0 8x ), la présence de switchs PCI Express éventuels etc. Ne disposant actuellement que d'une seule Radeon R9 290X, nous n'avons pas encore pu nous pencher sur le sujet plus en détail. Eyefinity plus flexibleAvec les Catalyst 13.11 beta fournis pour ce test et celui des autres Radeon R200, la partie affichage a droit à du neuf. Tout d'abord, tout comme Nvidia, AMD supporte le nouveau standard VESA Display ID v1.3 qui permet de configurer automatiquement l'affichage sur les écrans 4K de type tiled display. Nous avons pu le vérifier, c'est fonctionnel.  Plus important, LA limitation d'Eyefinity disparaît enfin : si les 3 écrans utilisent un même ensemble résolution/timings, il est dorénavant possible d'utiliser simultanément les 2 sorties DVI et la sortie HDMI. Plus besoin de passer obligatoirement par un connecteur DisplayPort et un adaptateur actif pour les écrans qui ne supportent pas cette connectique nativement. Cette fonctionnalité étant logicielle, il est incompréhensible pour nous qu'AMD ne l'ait pas implémentée plus tôt. C'est la raison pour laquelle la connectique des Radeon R9 200 de référence revient vers 2 DVI + HDMI + DP au lieu de DVI + HDMI + 2 mini-DP. Cette possibilité pourrait également être activée pour les anciennes cartes, si leur connectique le permet, ce qui est le cas de certaines cartes partenaires. Il est possible qu'une mise à jour du bios soit alors nécessaire, mais AMD n'a pas confirmé ce point. Page 6 - Performances théoriques : pixels Notez que par rapport à nos précédentes mesures théoriques, nous avons allongé la durée de nos tests de manière à ce que la fréquence GPU puisse se stabiliser en terme de consommation. Ils restent cependant suffisamment brefs pour ne pas être influencés par la température de manière à représenter les débits bruts des différents GPU. Nous avons repris leurs versions les plus performantes, excepté pour Tahiti pour lequel nous avons opté pour la Radeon R9 280X de manière à ce que tous les GPU AMD soient représentés à 1 GHz. Performances texturingNous avons mesuré les performances lors de l'accès aux textures en filtrage bilinéaire activé et ce, pour différents formats : en 32 bits classique (8x INT8), en 64 bits "HDR" (4x FP16), en 128 bits (4x FP32), en profondeur de 32 bits (D32F) et en FP10, un format HDR introduit par DirectX 10 qui permet de stocker des textures HDR en 32 bits avec quelques compromis.  Les GeForce GTX sont capables de filtrer les textures FP16 à pleine vitesse contrairement aux Radeon, ce qui leur donne un avantage considérable sur ce point d'autant plus que leur architecture reposer sur une proportion plus importante d'unités de texturing par unités de calcul. Notez que dans ce test, les GeForce à base de GK104/106/107 ont du mal à atteindre leur débit maximal dans ce test. Les Radeon peuvent également s'éloigner plus ou moins de leur maximum théorique, cette fois parce que PowerTune les en empêche en réduisant la fréquence GPU, estimant ou mesurant que le niveau de consommation est trop élevé lorsque leurs unités de texturing sont saturées. Ce n'est pas le cas pour les Radeon HD 7900 ni pour les Radeon HD 7800 (depuis la mise à jour de PowerTune en automne 2012), ni pour la Radeon HD 7790. La Radeon HD 7770 et la Radeon R9 290X sont par contre quelque peu limitées. FillrateNous avons mesuré le fillrate sans et puis avec blending, et ce avec différents formats de données :  [ Standard ] [ Avec blending ] Le fillrate est l'un des points forts du GPU Hawaii qui intègre pas moins de 64 ROP chargés d'écrire les pixels en mémoire. Tout comme pour Bonaire, ces ROP profitent qui plus est d'une efficacité supérieure avec blending. De quoi permettre un gain massif dans un exemple aussi simple que notre test qui tombe pour ces GPU dans le cas idéal. À l'inverse, le fillrate peut être vu comme le point faible du GK110. Ainsi, il n'augmente que très peu par rapport au GK104, un peu plus de 10% en théorie pour la GTX Titan et un petit peu moins en pratique. Pour rappel, les 14 SMX de la GeForce GTX Titan sont capables de transférer 56 pixels par cycle vers les ROP et ceux-ci sont capables d'en écrire 48 en mémoire par cycle, contre 32 et 32 pour une GeForce GTX 680. La limitation se situe en fait au niveau des rasterizers : le GK110 en dispose de 5 contre 4 pour le GK104. Chacun de ceux-ci étant capable de générer 8 pixels, le GK110 est en réalité limité à 40 pixels par cycle contre 32 pour le GK104. La différence de fréquence réduit encore cet écart. Suivant sa configuration, la GeForce GTX 780 peut être limitée au niveau des rasterizers soit à 32, soit à 36, soit à 40 pixels par cycle. Notre échantillon de test était dans le premier cas et se retrouve donc avec un fillrate légèrement inférieur à celui d'une GeForce GTX 680. Au niveau du fillrate, les GeForce GTX Kepler sont enfin capables de transférer les formats FP10/11 et RGB9E5 à pleine vitesse vers les ROP, bien que le blending de ces formats se fasse toujours à demi vitesse. Si les GeForce et les Radeon sont capables de traiter le FP32 simple canal à pleine vitesse sans blending, seules ces dernières conservent ce débit avec blending. Elles sont par ailleurs nettement plus rapides en FP32 quadruple canal (HDR 128 bits). Bien que les Radeon 7800 disposent du même nombre de ROP que les Radeon HD 7900, leur bande passante mémoire inférieure ne leur permet pas de maximiser leur utilisation avec blending ainsi qu'en FP16 et FP32 sans blending. Page 7 - Performances théoriques : géométrie Notez que par rapport à nos précédentes mesures théoriques, nous avons allongé la durée de nos tests de manière à ce que la fréquence GPU puisse se stabiliser en terme de consommation. Ils restent cependant suffisamment brefs pour ne pas être influencés par la température de manière à représenter les débits bruts des différents GPU. Nous avons repris leurs versions les plus performantes, excepté pour Tahiti pour lequel nous avons opté pour la Radeon R9 280X de manière à ce que tous les GPU AMD soient représentés à 1 GHz. Débit de trianglesÉtant donné les différences architecturales des GPU récents au niveau du traitement de la géométrie, nous nous sommes évidemment penchés de plus près sur le sujet. Tout d'abord nous avons observé les débits de triangles dans deux cas de figure : quand tous les triangles sont affichés et quand ils sont tous rejetés (parce qu'ils tournent le dos à la caméra) :  Quand les triangles peuvent être éjectés du rendu, les GeForce GTX Titan, GTX 770 et GTX 660 profitent pleinement de leur capacité de prise en charge de 7, 4 ou 2.5 triangles par cycle pour se démarquer des Radeon. Bonaire se comporte ici exactement comme Tahiti et Pitcairn alors que Hawaii passe à la vitesse supérieure mais sans pouvoir égaler le GK104. Une fois que les triangles doivent être rendus, le débit maximal théorique des GeForce chute sur certains modèles alors que leur efficacité est plus généralement en baisse, peut-être parce que ces GPU sont engorgés à un endroit ou à un autre, ou encore parce que leurs performances ont été réduites artificiellement pour différencier les Quadro des GeForce. La Radeon R9 290X prend ainsi la tête sur ce point. Ensuite nous avons effectué un test similaire mais en utilisant la tessellation :  Avec les GeForce GTX Kepler, Nvidia réaffirme sa supériorité lorsqu'il s'agit de traiter un nombre important de petits triangles générés par un niveau de tessellation élevé. Les Radeon HD 7900/ R9 280X ne se démarquent pas des Radeon HD 7800 et de la Radeon HD 7790 qui disposent du même nombre d'unités fixes dédiées à cette tâche. L'architecture des Radeon fait qu'elles peuvent être engorgées plus facilement par la quantité de données générées, ce qui réduit drastiquement leur débit dans ce cas. AMD fait évoluer progressivement les différents buffers liés à la tessellation, et la manière de les utiliser, pour éviter autant que possible de se trouver dans ce cas. Les derniers pilotes apportent d'ailleurs des gains significatifs à ce niveau pour l'ensemble des GPU GCN. Hawaii affiche un gain important au niveau du débit brut, soit lorsque les triangles générés ne doivent pas être rendus. Lorsque c'est le cas, il se contente par contre dans notre test d'une progression de +/- 10% par rapport à Tahiti. Notre test étant relativement lourd en termes de données générées par triangles, nous supposons que le GPU souffre d'un embouteillage à un endroit ou à un autre, peut-être au niveau du canal de transfert de ces données vers les contrôleurs mémoire (mais pas directement au niveau de la bande passante globale qui est loin d'être saturée). Page 8 - Spécifications, la Radeon R9 290X de référence Spécifications  Depuis quelque temps nous hésitons sur la manière de qualifier la ou les fréquences des Radeon. Peut-on réellement parler de fréquence turbo lorsqu'il n'y a pas réellement de fréquence de base atteinte en pratique et à partir de laquelle le comportement du GPU change ? Quand il n'y a pas de fréquence minimale ? Dans le cas des GeForce GTX 600 et 700, le qualificatif de fréquence turbo semble logique alors que dans le cas d'une Radeon R9 280X, il l'est beaucoup moins. Nous avons donc décidé de faire le compromis de combiner fréquence turbo et fréquence maximale sur une même ligne et d'ajouter une fréquence de base à titre de référence lorsque cela fait sens. Le calcul des débits théoriques se fait cependant uniquement sur base des fréquences turbo/max (variable dans le cas des GeForce). Dans le cas de la Radeon R9 290X, AMD indique que 727 MHz n'est pas une fréquence de base et qu'en réalité il n'y en a pas. Néanmoins, il s'agit de la fréquence à partir de laquelle il y a une rupture dans le comportement de la carte. Il en va de même pour la Radeon R9 290 quand elle atteint 662 MHz. Par rapport à une GTX Titan, la R9 290X est devant en terme de puissance de calcul et de débit de pixel, mais derrière au niveau des débits de triangles et de filtrage des textures. La Radeon R9 290X profite cependant d'une bande passante mémoire 11% plus élevée que celle des cartes auxquelles elle est comparée ici. De quoi annoncer un match relativement serré. La Radeon R9 290 conserve la même bande passante mémoire que sa grande sur, mais se contente de 95% de ses débits de triangles/pixels et de 86% de sa puissance de calcul. Radeon R9 290X de référencePour ce test, AMD nous a fourni une Radeon R9 290X de référence :     Pour sa Radeon R9 290X de référence, AMD reprend son design habituel. Comme d'habitude, une nouvelle famille de cartes graphiques a droit à un style de coque différent. Sobre mat pour les HD 5000, mat pas très beau pour les HD 6000, sobre brillant pour les HD 7000 et finalement mat assez agressif pour les Radeon R200. Visuellement c'est plutôt réussi même si nous aurions tendance à préférer le style plus sobre des Radeon HD 7000 d'autant plus que leur coque résonne moins au contact. Si rien d'indique que cela impacte en pratique les nuisances sonores, le sentiment de robustesse s'en ressent. Dans tous les cas, la coque en plastique reste de conception assez simple, AMD ayant clairement décidé de ne pas tenter de concurrencer Nvidia sur le niveau de finition des GTX 780 et Titan de référence. Au niveau du ventirad en lui-même, nous retrouvons la même turbine que sur les Radeon HD 7970 ainsi qu'une très large chambre à vapeur surmontée d'un radiateur en aluminium similaire mais pas tout à fait identique. Il a notamment été biseauté au niveau de la sortie d'air pour diriger plus efficacement l'air vers la grille d'extraction.  Le PCB de référence s'inspire largement lui aussi de celui de la Radeon HD 7970. La connectique a cependant été revue avec deux sorties DVI, une sortie HDMI et une sortie DisplayPort alors que les connecteurs CrossFire X disparaissent bien que leurs traces soient toujours présentes sur le PCB (voir sur la photo arrière). Attention, aucune sortie analogique n'est supportée et il ne sera pas possible de connecter un écran VGA via un adaptateur DVI->VGA. AMD reste sur un étage d'alimentation de 5 phases pour le GPU mais certains composants auraient été quelque peu musclés. Il faut dire qu'avec un TDP de +/- 300W et une limite de consommation de 208W pour le GPU, qui peut être relevée de 50% via le panneau de contrôle, le stress à leur niveau peut être relativement important. Par défaut ils sont cependant très bien refroidis. A noter qu'AMD se contente toujours de connecteurs d'alimentation 8+6 broches, ce qui signifie qu'en pratique la consommation va légèrement au-delà des normes lors de charges très lourdes. En pratique ce n'est en aucun cas un problème puisque l'alimentation via le bus PCI Express, plus sensible, n'est que très peu mise à contribution, un très bon point. AMD a conservé le double bios et le petit switch qui permet de passer de l'un à l'autre. Ces 2 bios prennent ici plus d'importance, l'un étant configuré en mode Quiet et l'autre en mode Uber. La seule différence entre ces deux modes concerne la vitesse maximale du ventilateur, de 40% pour le premier et de 55% pour le second, à partir de laquelle la fréquence GPU va être réduite progressivement. Notez qu'il faut restaurer les paramètres par défaut du CCC pour que le changement de bios soit pris en compte. En mode Uber notre échantillon a maintenu presque en permanence sa fréquence maximale de 1 GHz à l'exception de Anno 2070 et Crysis 3 pour lesquels la baisse était légère (+/- 990 MHz). En mode Quiet par contre la fréquence maximale n'a été maintenue dans aucun jeu et variait entre 840 et 950 MHz suivant la charge qu'ils représentent. Bonne nouvelle si vous n'appréciez guère les petits grésillements électriques, notre échantillon de Radeon R9 290X de référence ne souffre pas du tout de coil whine contrairement aux GeForce GTX 700 qui en présentent un petit peu et aux Radeon HD 7900 tristement célèbre pour ce problème. Plusieurs confrères nous ont confirmé que leurs samples ne souffraient d'aucun coil whine également, ce qui nous laisse penser qu'AMD s'est soit enfin penché sur le problème, soit a mieux trié que d'habitude les cartes envoyées à la presse. Afin d'éviter de démonter la carte alors que nos tests ne sont pas encore terminés, nous avons repris la photo du PCB fournie par AMD, qui a été étrangement retouchée pour en effacer les vestiges des connecteurs CrossFire. Les performances de la Radeon R9 290X étant fortement liées à son refroidissement, tout démontage/remontage peut avoir un impact, ce que nous avons cherché à éviter. Page 9 - La Radeon R9 290 de référence Radeon R9 290 de référencePour la mise à jour de ce test, AMD nous a fourni deux Radeon R9 290 de référence. Celle-ci reprend exactement le même design que la Radeon R9 290X :    Le ventirad est parfaitement identique, tout comme le PCB. Seule la version du GPU Hawaii qui est embarquée diffère. Nous retrouvons deux sorties DVI, une sortie HDMI et une sortie DisplayPort. Attention, aucune sortie analogique n'est supportée et il ne sera pas possible de connecter un écran VGA via un adaptateur DVI->VGA. L'alimentation reste sur des connecteurs 8+6 broches pour alimenter un étage d'alimentation de 5 phases dédié à la consommation du GPU qui peut atteindre 208W, ce qui à l'échelle de la carte représente un TDP de +/- 300W. AMD a conservé le double bios et le petit switch qui permet de passer de l'un à l'autre mais contrairement à la Radeon R9 290X, il n'y a ici pas deux versions du bios. Le second est une copie du premier et la vitesse de ventilateur est identique. Au départ, AMD l'avait prévue à 40% et c'est dans cette configuration que nous avions débuté nos tests. Rapidement, les résultats se sont cependant avérés être très décevants, voire franchement mauvais. Si AMD contenait quelque peu les nuisances sonores sur le papier, en pratique lors de nos tests en boîtier, notre échantillon atteignait rapidement ses limites et par sécurité la vitesse du ventilateur montait de 40 à 46%, puis redescendant, remontait De quoi rendre la carte insupportable en plus d'offrir des performances décevantes. Nous avons bien entendu fait part de nos premières impressions à AMD, en ne mâchant pas nos mots : en l'état nous devrons conseiller à nos lecteurs de fuir ce modèle ! Face à des remarques similaires de quelques confrères et à la baisse de prix opérée par Nvidia, AMD a pris une décision radicale : reporter le lancement et tenter de rectifier le tir. Une bonne chose selon nous. Pour éviter de devoir modifier les cartes déjà en stock chez les revendeurs, c'est à travers le premier pilote officiel que cette rectification se fait. AMD a reprogrammé PowerTune pour modifier la limite du ventilateur et la passer à 47%. D'autres paramètres ont également pu être modifiés, mais leur influence est marginale par rapport à celle de la vitesse du ventilateur. Au final, les nuisances sonores certes augmentent significativement sur le papier, mais en ce qui nous concerne, il n'y a pas de réelle différence : elles passent d'une oscillation permanente entre 43.2 et 46.7 dBA à 47.0 dBA fixe. Quitte à ne pas proposer du silence, AMD propose cependant enfin des performances. Un moindre mal qui représente probablement le meilleur compromis auquel pouvait arriver AMD pour cette Radeon R9 290. Notre échantillon a maintenu de justesse sa fréquence maximale dans quelque jeu mais était en général en-dessous, descendant jusque 790 MHz dans les cas les plus lourds, ce qui est nettement mieux que les 662 MHz rencontré au départ ! Compte tenu de la consommation relativement plus élevée à fréquence égale que sur la Radeon R9 290X, nous avons supposé que notre échantillon de Radeon R9 290 était "moins bon" puisqu'une variabilité existe à ce niveau. AMD nous a alors fourni un second échantillon effectivement meilleur, ce qui nous laisse penser que la première Radeon R9 290 envoyée n'était pas issue d'un tri sélectif spécial presse. Vous pouvez consulter la page "PowerTune en pratique, variabilité" pour plus de détails. Bonne nouvelle si vous n'appréciez guère les petits grésillements électriques, nos échantillon de Radeon R9 290 de référence ne souffrent pas du tout de coil whine. Par contre la turbine du premier échantillon présente un petit bruit mécanique à faible vitesse de rotation. Page 10 - Consommation ConsommationNous avons utilisé le protocole de test qui nous permet de mesurer la consommation de la carte graphique seule. Nous avons effectué ces mesures au repos sur le bureau Windows 7 ainsi qu'en veille écran de manière à observer l'intérêt de ZeroCore Power d'AMD. Pour la charge, nous avons opté pour des mesures dans Anno 2070, en 1080p avec tous les détails poussés à leur maximum, ainsi que dans Battlefield 3, en 1080p dans le mode High.  Au repos les Radeon R9 290 affichent une consommation en hausse par rapport à ce que nous avions l'habitude d'observer sur les Radeon HD 7970, ce qui peut être lié à la taille du GPU Hawaii ou à la télémétrie complexe mise en place par AMD. Comme toujours, c'est en charge que cela se complique. En mode Quiet, la consommation totale de la Radeon R9 290X s'approche de 220W. Dans ces conditions, le GPU est cependant limité en fréquence dans les deux jeux testés (~940 MHz pour Battlefield 3 et ~870 MHz pour Anno 2070), sa température maximale et sa vitesse de ventilateur maximale étant rapidement atteintes. C'est la raison pour laquelle la consommation est identique dans ces deux jeux alors qu'Anno est nettement plus gourmand. Fortement limitées par leur température cible de 80 °C, les GeForce GTX 780 et Titan se contentent de fréquences réduites ce qui limite ici leur consommation. Une GeForce GTX 780 capable de toujours maintenir sa fréquence maximale, telle que celle de MSI, va afficher une consommation similaire à celle de la nouvelle Radeon dans Anno, mais nettement moindre dans Battlefield. Une fois passée en mode Uber, la Radeon R9 290X libère son GPU qui maintient 1 GHz dans Battlefield 3 et oscille entre cette même fréquence et 990 MHz dans Anno 2070. La consommation augmente cette fois assez nettement pour atteindre un nouveau record pour une carte de référence mono-GPU. Si nous mesurons 278W, cela se fait après quelques minutes de charge. Au début du test de charge, quand le GPU atteint 94 °C mais que le ventilateur n'est pas encore à sa limite, la consommation du GPU est légèrement plus élevée. Par ailleurs le nouveau PowerTune fait varier tension et fréquence tellement vite que notre équipement n'est pas adapté à mesurer les pics de consommation. Mieux vaut donc prévoir une alimentation adaptée à une consommation de 300W, voire un petit peu plus, pour éviter tout problème. La Radeon R9 290 se place logiquement entre les 2 modes de la Radeon R9 290X avec une consommation maximale dans nos conditions de test (système ouvert, température de la pièce à 26 °C) de près de 250W, liée la vitesse intermédiaire de son ventilateur. Notez que nous avons fait l'impasse sur le rapport performances/watts qui n'a pas réellement de sens pour comparer les GPU lorsqu'il n'y a pas de différence technologique significative. Nous avons en effet constaté que la variation que nous pouvons observer d'un échantillon à l'autre pouvait rendre trompeuse ces données. Malgré sa consommation qui explose, le rendement énergétique de la Radeon R9 290X semble cependant en légère hausse sur base de notre échantillon. Page 11 - Bruit et températures Nuisances sonoresNous plaçons les cartes dans un boîtier Cooler Master RC-690 II Advanced et mesurons le bruit d'une part au repos et d'autre part en charge sous le test1 de 3DMark11. Un SSD est utilisé et tous les ventilateurs du boîtier ainsi que celui du CPU sont coupés pour la mesure. Le sonomètre est placé à 60cm du boîtier fermé et le niveau de bruit ambiant se situe à moins de 20 dBA, ce qui est la limite de sensibilité pour laquelle il est certifié et calibré.  Si la Radeon R9 290X est relativement discrète au repos, bien que les GeForce fassent mieux, c'est loin d'être le cas en charge contrairement à ce que le nom de ses 2 modes peut laisser penser. Non, le mode Quiet n'est pas silencieux (ventilateur à 40% - 2120 RPM). Il correspond à un niveau de bruit élevé, qui était jugé acceptable il y a encore quelques années. Depuis, les mentalités ont évolué, de nombreux fabricants de cartes graphiques ont suivi la tendance et Nvidia est passé par là avec des designs de référence moins bruyants. En mode Uber, la Radeon R9 290X fait exploser le compteur. A moins de disposer d'un boîtier extrêmement bien isolé, d'être sourd ou d'utiliser en casque, ce mode sera tout simplement insupportable. A noter que dans ce mode le ventilateur radial ne tourne qu'à 55% (3120 RPM) et qu'il dispose donc encore de pas mal de marge. A 100% (5310 RPM) il atteint 65.7 dBA. La Radeon HD 7970 GHz n'est certes pas beaucoup plus supportable, mais il s'agit ici du modèle de référence alors que des fabricants ont sorti des modèles qui à défaut d'être silencieux sont nettement moins bruyants. La Radeon R9 290 se comporte comme sa grande sur au repos et à mi-chemin en charge, ce qui est logique puisque dans sa version finale le ventilateur tourne à 47% (2525 RPM). Elle fait alors sans aucun doute partie des cartes bruyantes voire très bruyantes. A noter qu'un bruit mécanique affectait le ventilateur de notre premier échantillon de test, ce qui explique les nuisances sonores supérieures au repos pour la R9 290. Notre second échantillon n'était pas affecté. Pour atteindre une pression sonore similaire à celle de la GeForce GTX 780 (36.5 dBA), il faut réduire la vitesse du ventilateur des Radeon R9 290X/290 à 32%. Les Radeon ne sont cependant pas capables de maintenir cette vitesse ventilateur puisqu'elles arrivent alors dans leurs limites de sécurités qui imposent une augmentation de la vitesse ventilateur au-delà de la limite fixée. Lors de ces tests de charge lourde en boîtier, notre Radeon R9 290X tournait entre 740 et 840 MHz en mode Quiet et restait +/- à 990 MHz en Uber. Notre premier échantillon de Radeon R9 290 tournait entre 660 et 840 MHz alors que le second restait majoritairement proche de 840 MHz. TempératuresToujours placées dans le même boîtier, nous avons relevé la température du GPU rapportée par la sonde interne :  Force est de constater qu'AMD n'a pas choisi de sacrifier les nuisances sonores pour favoriser la température GPU qui correspond bien à la limite annoncée de 95 °C. En pratique Powertune s'efforce de ne pas dépasser 94 °C mais laisse facilement le GPU atteindre cette valeur. A noter une température relativement élevée au repos. Voici ce que tout cela donne à travers l'imagerie thermique :