| |

| AMD Radeon RX 480 8 Go : 14nm et Polaris en test Cartes Graphiques Publié le Mercredi 29 Juin 2016 par Damien Triolet URL: /articles/951-1/amd-radeon-rx-480-8-go-14nm-polaris-test.html Page 1 - Introduction  Efficacité énergétique en hausse, rapport performances / prix agressif et de nouvelles fonctionnalités font partie des bénéfices mis en avant par AMD grâce à un nouveau procédé de fabrication qui permet d'équiper les puces de transistors plus petits et moins gourmands. Depuis la Radeon HD 7970 et l'inauguration du process 28nm de TSMC, près de 5 années se sont écoulées, du jamais vu dans le petit monde du GPU. Il était tant que cela bouge enfin et c'est avec enthousiasme que nous accueillons les nouvelles puces fabriquées en 16nm chez TSMC ou en 14nm chez Samsung / GlobalFoundries. Nvidia a opté pour TSMC, son partenaire traditionnel alors qu'AMD a opté pour GlobalFoundries qui exploite un process qui a été développé par Samsung. Des choix stratégico-commerciaux qui peuvent évidemment avoir un impact important sur les produits finaux si l'un ou l'autre process est plus performant, même s'il est difficile d'extraire la part qui lui revient de la prestation d'une carte graphique.  AMD a développé deux petites puces en 14nm : Polaris 10 et Polaris 11 avec pour stratégie de séduire un maximum de joueurs grâce à des tarifs agressifs sur les segments milieu et bas de gamme. La première carte graphique à en profiter est la Radeon RX 480, bâtie autour du Polaris 10 et lancée à 260 en version 8 Go et à 220-230 en version 4 Go. En termes de performances c'est la Radeon R9 390 ou encore la GeForce GTX 970 qui sont visées et comme c'est souvent le cas seule une carte de référence est actuellement proposée. Est-elle convaincante ? C'est ce que nous allons vérifier dans ce dossier en ne manquant pas de nous pencher sur des échantillons commerciaux de Sapphire et XFX. Ce n'est pas par le haut de gamme qu'AMD a décidé de débuter l'utilisation du process 14nm, mais bien par le milieu de gamme avec une puce relativement petite. Pour plus de clarté, AMD lui a attribué un nom commercial, Polaris 10, qui fait clairement référence à sa génération. Un nom de code traditionnel existe également et est notamment utilisé en interne par ses partenaires. Il s'agit d'Ellesmere, en référence à une île comme pour les précédents GPU AMD. A noter que s'attaquer à un nouveau process avec une puce milieu de gamme n'est pas inédit dans le chef d'AMD. Il y a un précédent avec la Radeon HD 4770 et le GPU RV740 qui a inauguré le 40nm avant que la génération HD 5000 ne le généralise. Les GPU Polaris 10, et son petit frère le Polaris 11, sont fabriqués par GlobalFoundries dans sa nouvelle usine américaine sur base d'un process 14nm LPP développé par Samsung. Tout comme le 16nm FF+ exploité par Nvidia pour les GeForce GTX 10, ce process fait appel à des transistors de type FinFET ("transistors 3D") qui permettent de réduire les courants de fuite et la tension. Lors d'une présentation à laquelle nous avons assisté, un représentant de GlobalFoundries a expliqué que ce process 14nm LPP avait un avantage de 8% sur la concurrence au niveau de la densité.  Polaris P10 est interfacé en 256-bit.

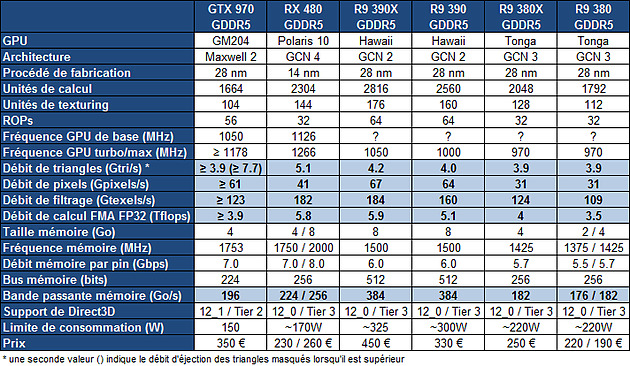

Polaris P10 est interfacé en 256-bit.Avant de rentrer dans les détails de son architecture, un petit rappel s'impose pour situer le Polaris 10 parmi les GPU récents :

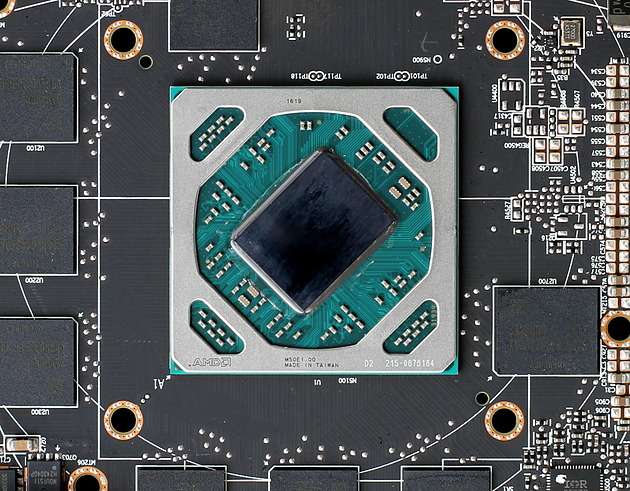

Avec 232 mm², Polaris 10 est clairement un GPU milieu de gamme, qui s'inscrit dans la lignée de Pitcairn, qui était lui-même le milieu de gamme lors de l'introduction du 28nm (HD 7800). Entre temps AMD a sorti Tonga sur ce segment, un GPU un peu plus gros que Polaris P10 va venir remplacer avantageusement en étant à la fois plus petit et un peu plus complexe. Le passage au 14 nm permet évidemment de faire exploser la densité de transistors par rapport au 28 nm. Il ne faut cependant pas se fier à ces chiffres qui sont plus des noms commerciaux des procédés de fabrication que des mesures de la géométrie qui définissent leur densité. Ainsi, contrairement à ce qui a pu être vrai par le passé, le 14 nm ne permet pas de quadrupler le nombre de transistors par mm² par rapport au 28 nm. Ces technologies sont très complexes et la densité réelle est déterminée par de nombreux paramètres qui dépassent le cadre de cet article. Voici les densités relevées sur quelques GPU :

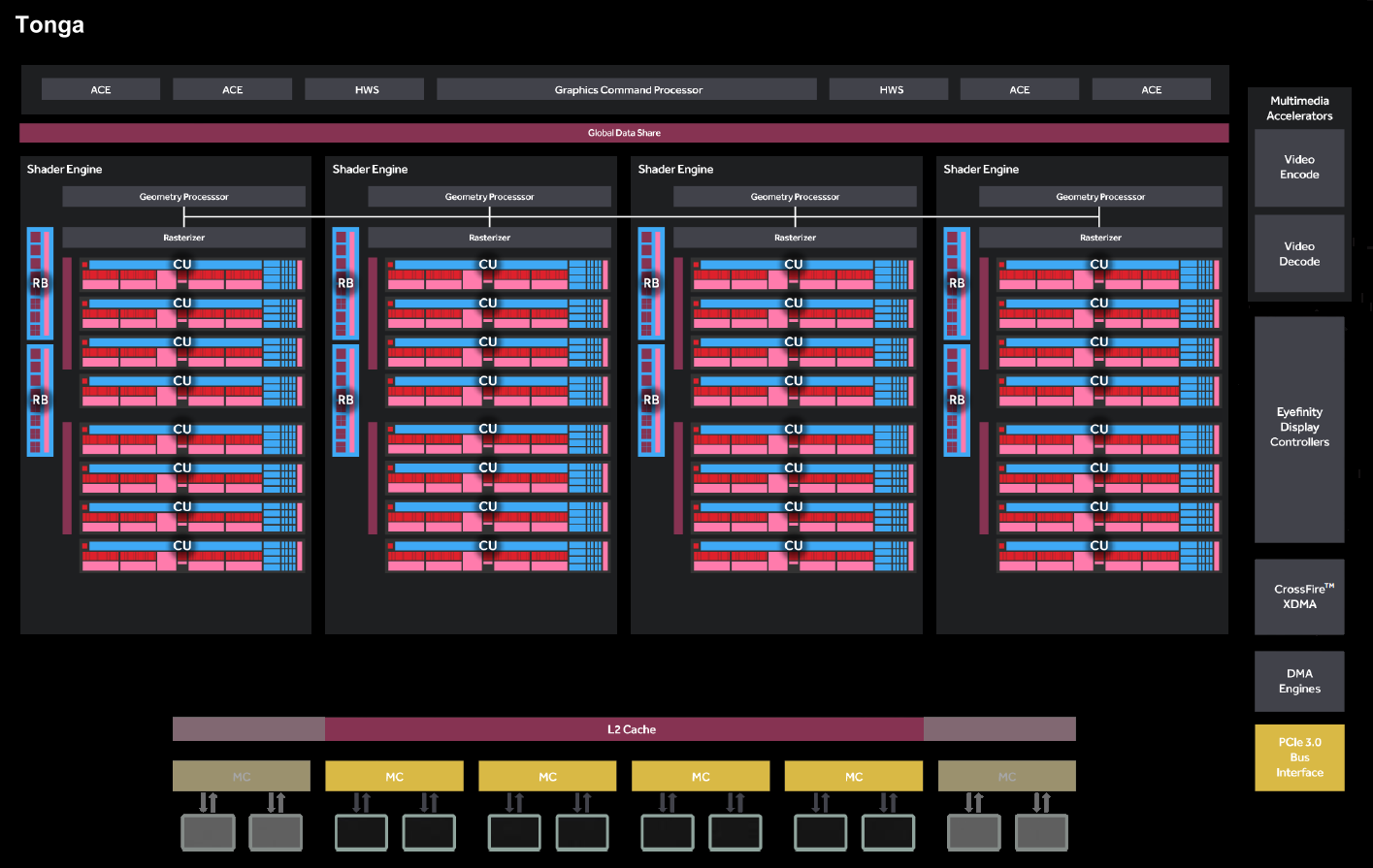

La densité est un petit peu plus élevée sur les plus gros GPU, probablement parce qu'une partie des E/S (entrées/sorties, I/O) à faible densité est identique et représente moins d'espace en proportion alors qu'à l'inverse ils intègrent en général plus de mémoire qui représente des structures plus denses, nous n'avons donc pas inclus les énormes GP100 et Fiji dans cette comparaison. Entre le GP104 et le GM204, la densité progresse de 75%. Du côté d'AMD, entre le Polaris 10 et Tonga elle progresse de 81%, des chiffres qui semblent confirmer le petit avantage au niveau de la densité entre le 14nm LPP et le 16nm FF+, même s'il y a de nombreux autres paramètres à prendre en compte. Polaris 10 : 36 CU et bus 256-bitPassons maintenant à la configuration retenue par AMD pour ses GPU Polaris qui restent basés sur l'architecture GCN (Graphics Core Next) introduite fin 2011. Nous avons pour cela repris le schéma traditionnel fournis par AMD, corrigé d'une petite erreur et que nous avons modifié pour vous proposer une comparaison avec Tonga et Polaris 11 :  [ Tonga ] [ Polaris 10 ] [ Polaris 11 ] Tout comme pour Tonga, Hawaii et Fiji, AMD a opté pour 4 Shader Engines pour Polaris 10. La différence entre ces puces concerne le nombre de Compute Units (CU) par Shader Engine : 16 pour Fiji, 11 pour Hawaii, 9 pour Polaris 10 et 8 pour Tonga. Rappelons que chaque CU embarque 64 unités de calcul ainsi que 4 unités de texturing. Par rapport à Tonga, la progression à ce niveau est ainsi de 12.5% à fréquence égale. En passant de Tonga à Polaris 10, AMD a par contre réduit le bus mémoire de 384 à 256-bit mais cette possibilité n'a été exploitée sur aucune carte graphique : les R9 285, 380 et 380X se contentent toutes d'un bus de 256-bit. En pratique la configuration mémoire est ainsi similaire mais l'interface GDDR5 a été prévue pour monter plus haut en fréquence et le cache L2 par contrôleur mémoire de 64-bit a été multiplié par 4 pour atteindre 2 Mo. De son côté Polaris 11 est un demi Polaris 10 avec un CU de moins par Shader Engine. Il se contente d'un petit bus de 128-bit mais là aussi capable de monter plus haut en fréquence et associé à un cache L2 de 1 Mo. Voici pour comparaisons les spécificités des GPU GCN :

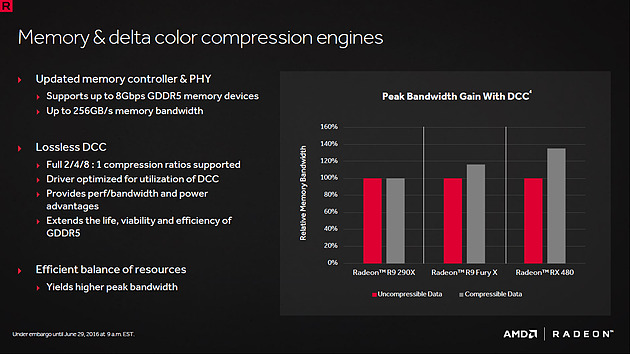

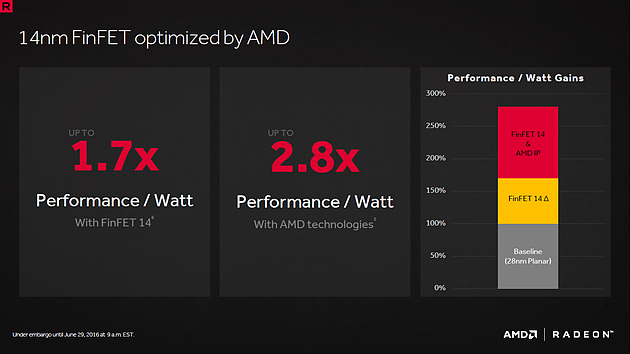

Pour accompagner un bus mémoire qui reste à 256-bit, comme Tonga, mais qui est divisé par 2 par rapport aux 512-bit de Hawaii et à la Radeon R9 290 à laquelle AMD aime comparer la Radeon RX 480, il était important pour AMD de pouvoir tirer plus de bande passante effective par bit. Pour cela, en plus des interfaces mémoire retravaillées pour monter plus haut en fréquence (support de la GDDR5 jusque 8 Gbps) et du cache L2 quadruplé par contrôleur 64-bit, les techniques de compression du framebuffer ont été améliorées.  Pour être précis, il s'agit d'un codage différentiel des couleurs (delta color compression, DCC) qui représente une compression sans perte. Cette technique permet de réduire les besoins en bande passante mémoire en augmentant légèrement l'espace mémoire nécessaire. Alors que la DCC des GPU Fiji et Tonga permettait de gagner près de 20%, cela monte à près de 40% pour les GPU Polaris 10 et 11 qui supportent les compressions de type 2:1, 4:1 et 8:1, comme le fait Nvidia avec les GPU Pascal même si nous ne savons pas si les implémentations des deux spécialistes du GPU sont aussi efficaces l'une que l'autre. D'après les chiffres communiqués par AMD, une Radeon R9 290X, qui ne dispose pas de DCC, atteint une bande passante maximale en pratique de 263 Go/s alors que la RX 480 monte à 251 Go/s grâce à la DCC, à la fréquence en hausse et au cache L2 plus important. Toujours selon les chiffres communiqués par AMD, l'interface mémoire de Polaris 10 ne consommerait que 42% de l'énergie nécessaire à celle de Hawaii, ce qui est également lié au passage au 14nm FinFET. A largeur de bus identique, la consommation est ainsi légèrement inférieure pour Polaris alors que la GDDR5 exploitée monte fortement en fréquence. Attention, AMD n'a probablement pas choisi la comparaison avec la R9 290X par hasard, celle-ci utilisant de la mémoire faiblement cadencée (5 Gbps) au vu de sa tension de 1.5V. En pratique il existe de la GDDR5 jusqu'à 6 Gbps à 1.35V alors que la RX 480 8 Go utilise de la GDDR5 8 Gbps à 1.5V. FinFET, fréquence et réduction de la tensionUn changement majeur de procédé de fabrication apporte en général plusieurs bénéfices, parmi lesquels une montée de la fréquence et donc des performances qui sur de nombreux aspects en dépendent directement. C'est bien entendu le cas ici pour la 14nm LPP de GlobalFoundries :  Il faut cependant rappeler que l'on ne peut pas tout avoir. Il est possible d'exploiter le process pour réduire la consommation à fréquence égale (le 14nm LPP est annoncé 65% plus efficace), pour augmenter la fréquence à consommation égale (il est alors question d'une fréquence 55% supérieure) ou pour trouver un compromis plus intéressant entre fréquence et consommation. Alors qu'en passant au 16nm FF+ Nvidia a pu faire profiter ses GPU Pascal d'un bond de 40% au niveau de leur fréquence (de 1200 à 1700 MHz), du côté d'AMD les GPU Polaris se contentent d'une évolution de 20% en passant au 14nm LPP (de 1050 à 1250 MHz). En conclure que l'un ou l'autre process est plus performant sur base de ces chiffres serait cependant un raccourci trop rapide. L'architecture est différente et peut avoir été plus ou moins optimisée pour favoriser la montée en fréquence. Nvidia explique d'ailleurs avoir fortement travaillé cet aspect. Ceci étant dit il n'est probablement pas délirant de penser que si le 14nm LPP autorise une densité un peu supérieure, il est un petit peu moins performant que le 16nm FF+.  AMD explique ensuite que la 14nm LPP permet d'augmenter l'efficacité énergétique de 70% d'après des mesures internes spécifiques. Mais couplé aux améliorations de l'architecture, la progression monterait à 180%. Un bond énorme qu'il convient de relativiser. Il s'agit en effet d'une comparaison très favorable entre la future RX 470 limitée à 110W et la R9 270X qui monte à 180W, sur base de mesures de performances dans 3DMark Fire Strike, Ashe of the SIngularity, Hitman et Overwatch avec des paramètres qui évitent des options gourmandes en bande passante telles que le MSAA. Entre une RX 480 et une R9 290, AMD revoit ce chiffre à la baisse et annonce une progression moitié moindre avec 90% de mieux, ce qui reste une évolution importante. Pour accompagner les transistors FinFET et atteindre ces chiffres, AMD exploite plusieurs techniques, dont certaines sont également en action sur ses APU :

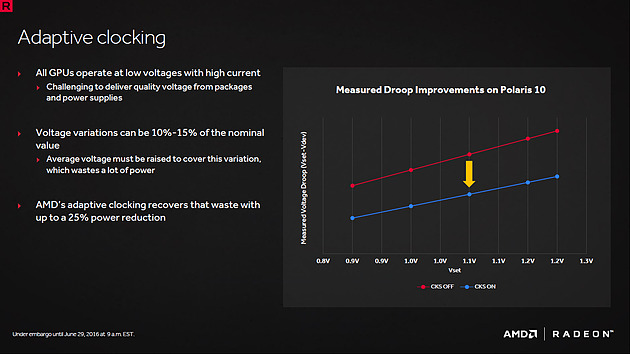

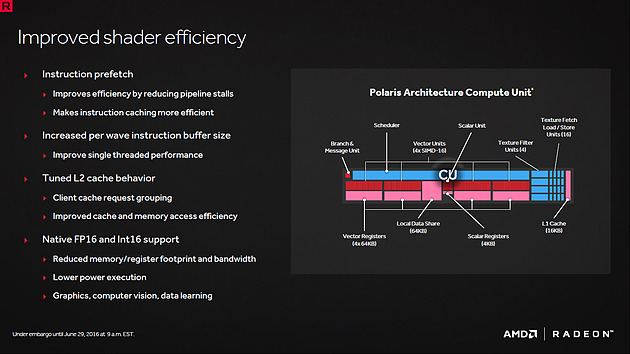

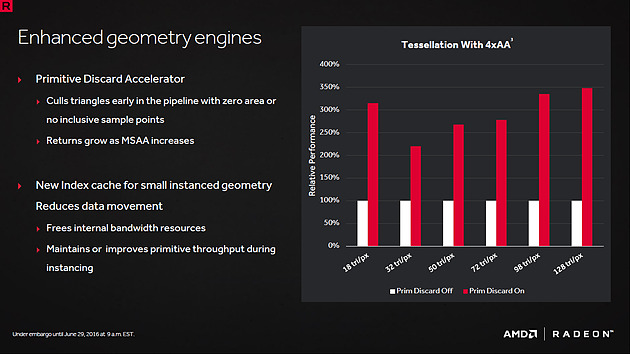

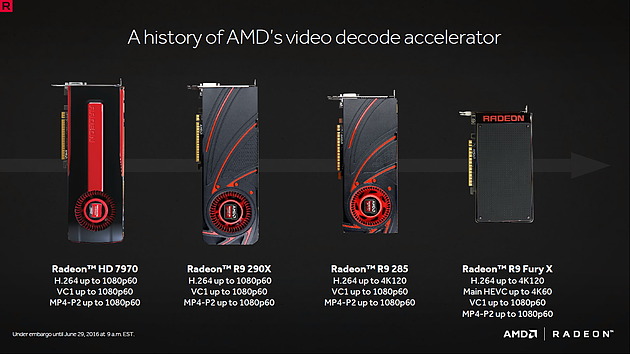

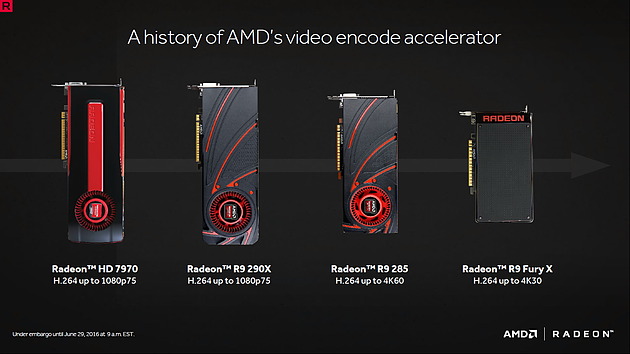

Que se cache derrière tout cela ? L'adaptative clocking tout d'abord est une technique qui permet de gérer les petites baisses de tension sans devoir prendre en compte de marge de sécurité importante. Comme vous le savez, les étages d'alimentation délivrent rarement une tension stable, ce qui est rendu difficile par l'intensité élevée délivrée aux GPU. Cette tension varie constamment avec de petites baisses qui peuvent atteindre 10 à 15% selon AMD. Grâce à des capteurs de tension internes, le GPU peut réduire brièvement sa fréquence avec un délai d'une nanoseconde dès qu'il détecte une petite baisse de la tension. De quoi pouvoir réduire la marge de sécurité et la tension de 5 à 10% avec une économie d'énergie conséquente à la clé. L'adaptive voltage and frenquency scaling (AVFS) permet pour sa part de tirer le meilleur de chaque puce produite en leur donnant la capacité d'autodéterminer la tension idéale pour chaque p-state. Cela se fait via l'ajoute de capteurs de fréquence aux capteurs de consommation et de température. Au lieu d'appliquer une tension identique à toutes les puces, ou un nombre limité de variations, la tension peut être adaptée plus finement et se rapprocher de la tension minimale à laquelle chaque puce peut fonctionner. Le boot time power supply calibration (BTC) est également une technique d'auto-calibration mais cette fois plutôt de la carte dans son ensemble que de la puce. Lorsqu'un GPU demande une tension particulière au contrôleur de son étage d'alimentation, il reçoit rarement exactement la valeur demandée. Pour éviter de prendre une marge de sécurité trop importante à ce niveau, à chaque boot, le GPU va vérifier la tension exacte sur quelques points de repère et compenser la différence. Là aussi il s'agit de se rapprocher de la tension minimale de fonctionnement en fournissant une information de plus à l'AVFS. L'adaptive aging compensation reste dans la même optique. Cette fois il s'agit d'éviter de prendre une marge de sécurité par rapport au vieillissement des transistors ou des composants de l'étage d'alimentation qui peuvent se détériorer légèrement. A la place le GPU va se tester et s'auto-calibrer en apportant une information de plus à l'AVFS. Après quelques années, la tension moyenne pourrait par exemple être très légèrement supérieure. Enfin, le multi-bit flip-flop est une implémentation plus efficaces des flip-flops, ou bascules en français, qui sont de petits circuits utilisés pour mémoriser un état le temps d'un cycle d'horloge. Ils sont présents en masse, AMD parle de 21 millions de bascules pour Polaris 10 qui représentent 15% de la consommation du GPU. Polaris exploite des structures plus complexes qui combinent plusieurs bascules avec une seule source de distribution du signal d'horloge pour un gain qui peut atteindre 4 à 5% au niveau de la consommation du GPU.  Le 14nm LPP combiné à toutes ces techniques de réduction de la consommation laisse augurer d'une excellente efficacité énergétique pour Polaris. Et pourtant, comme nous allons le voir, la Radeon RX 480 est décevante sur ce point. Pourquoi ? Entre la prestation réelle du process, de l'architecture GCN et de ces optimisations, il est difficile de dégager un coupable. Par ailleurs, chaque dérivé de Polaris, comme de tout autre GPU est configuré de manière à atteindre certains objectifs. Il est possible que la Radeon RX 480 ait été configurée pour pousser Polaris 10 le plus haut possible en terme de fréquence, quitte à sacrifier la consommation. AMD nous a d'ailleurs indiqué que tous les leviers n'ont pas été activés sur la RX 480, sans préciser si c'est par choix stratégique ou par manque de temps. Par exemple, le boot time power supply calibration et l'anti aging compensation ne sont pas actifs sur cette carte graphique. Ils pourraient par contre l'être sur d'autres ou sur des déclinaisons mobiles. Les GPU Polaris sont basés sur l'architecture GCN introduite par le GPU Tahiti et la Radeon HD 7970 fin 2011. AMD n'a pas opéré de changement majeur d'architecture depuis, contrairement à Nvidia qui est passé de Fermi à Kepler puis à Maxwell à laquelle Pascal est similaire. Par contre de petites améliorations ont progressivement été apportées. Au départ, AMD ne proposait aucune nomenclature simple pour faire référence à ces améliorations de l'architecture. Nous avions donc pris l'initiative de parler de GCN 1.0, 1.1 et 1.2. Depuis quelques temps, AMD a réalisé que c'était devenu un problème et parler dorénavant de GCN de 1ère génération, de 2ème génération, de 3ème génération etc. Nous allons donc reprendre cette manière de présentation les choses et parler de GCN 1, GCN 2, GCN 3 et GCN 4 pour les nouveaux GPU Polaris.  Les GPU GCN 2 (Hawaii et Bonaire) ont apporté entre autre le support du niveau 12_0 de DirectX 12, de TrueAudio, de FreeSync ou encore de la HSA. De leur côté, les GPU GCN 3 (Fiji et Tonga) ont intégré le codage différentiel, amélioré les processeurs de commandes pour le calcul asynchrone et intégré le support d'opérations en démi précision (FP16/INT16). Et bien entendu les GPU GCN 4 apportent également plusieurs petites nouveautés donc certaines présentes sur cette liste sont cependant des mises à jour logicielles qui seront répercutées sur d'autres GPU.  Quelques petites optimisations ont tout d'abord été apportées aux Compute Units (CU), ces blocs de base de l'architecture à peu près équivalents aux SM de Nvidia. Ils restent composés de 4 SIMD 16-way (64 unités de calcul) associés à un fichier registre de 256 Ko et à une mémoire partagée de 64 Ko. Ils englobent également 4 unités de texturing avec leur cache L1 de 16 Ko. Une structure qui n'a pas bougé depuis le premier GPU GCN. Pour augmenter le rendement des CU, AMD a mis en place un prefetch plus efficaces pour les instructions et élargi le buffer qui leur est dédié. Les accès au cache L2 ont également été optimisés, notamment avec plus d'opportunités de regroupement de ces accès. AMD mentionne également le support natif de la demi précision tant sur les flottants (FP16) que sur les entiers (INT16). Ce support est cependant déjà présent depuis GCN 3 (pas uniquement les APU comme le laisse penser le tableau) et nous ne savons pas pourquoi il est mentionné ici comme nouveauté. Questionné à ce sujet, AMD nous a répondu qu'il n'y avait en fait "probablement" pas de différence à ce niveau avec GCN 4. Ce support natif ne se traduit pas par une puissance de calcul doublée comme le fait Nvidia avec le GP100 ou comme le font certains GPU mobiles. Les opérations FP16 seront par exemple traitées par les unités FP32 à la même vitesse que les opérations FP32, mais elles auront l'avantage d'économiser de l'espace dans le fichier registre et de réduire les déplacements de données, coûteux en énergie. Au final, AMD annonce un gain de performances par CU, à fréquence égale, qui peut monter jusqu'à 15% entre GCN 4 et GCN 2. Le support de cette demi-précision est exposé dans DirectX depuis quelques temps déjà mais à notre connaissance aucun jeu n'y fait appel. Il y a donc probablement des possibilités d'optimisation encore inexploitées à ce niveau, mais qui sont également valides pour certains anciens GPU. A noter à ce sujet qu'AMD propose depuis peu le support de fonctions intrinsèques dans DirectX 11, DirectX 12 et Vulkan. Il s'agit de morceaux de code ASM hyper optimisé qui peuvent se substituer à l'appel d'une fonction équivalente mais qui ne pourrait pas être aussi efficace. Par exemple, si un développeur a optimisé à la main un shader important sur console, il pourra également l'exploiter sur PC. Nous suspectons Nvidia d'en faire même pour certains effets GameWorks par exemple, dont le code universel est probablement remplacé par les pilotes par une version plus finement optimisée.  AMD a ensuite améliore les processeurs géométriques des GPU GCN 4. Au départ nous pensions qu'AMD cherchait à augmenter le débit d'éjection des triangles hors champs de vision (frustum culling) ou qui tournent le dos à la caméra (backface culling) mais il n'en est rien. Le Primitive Discard Accelerator (PDA) qui fait son apparition n'est pas destiné à augmenter le débit maximal mais plutôt à permettre de s'en rapprocher dans certains cas difficiles. Il est dédié à éjecter les triangles qui représentent moins d'un pixel à l'écran (ou sample dans le cas du MSAA). Cela peut se présenter avec un niveau extrême de tessellation qui va revenir à générer bien plus de primitives (triangles en général) que la résolution ne permet d'en afficher. Le problème est que ces primitives sont accompagnées de toute une série de paramètres qui peuvent prendre beaucoup de place dans les buffers. De quoi les saturer et mettre le GPU à genoux. Le rôle du PDA est d'éjecter ces primitives directement après toutes les opérations sur les vertices (vertex shader, hull shader, domaine shader, geometry shader) pour éviter d'embouteiller les buffers avant la rastérisation. Avec MSAA et un niveau de tessellation extrême les performances peuvent être triplées. Reste qu'en principe les développeurs essayent d'éviter de se retrouver dans cette situation. Il s'agit probablement d'une "protection anti-GameWorks" pour éviter que les performances ne soient massacrées sur les Radeon si Nvidia décidait de forcer un peu trop sur le niveau de tessellation de certains de ses effets. Nous n'avons noté aucun gain dans nos tests théoriques qui ne se placent pas dans ce cas de figure.  Enfin, il y a du neuf au niveau de l'exécution asynchrone et concomitante des tâches. En plus de l'exécution concomitante (2 tâches traitées en même temps) et de la préemption (une tâche est mise en pause pour en traitre une plus urgente), AMD a mise en place un troisième mode appelé Quick Response Queue ou file de réaction rapide. Il s'agit cette fois de donner une priorité supérieure à certains tâches de type compute pour qu'elles soient exécutées en parallèles des autres tâches mais en se voyant attribuer plus de ressources. C'est l'approche qui est utilisée pour le time warping par le SDK LiquidVR et qui sera dorénavant exposée dans les API telles que DirectX 12 et Vulkan. A noter que cette possibilité sera également rendue disponible sur les GPU GCN 3. Les processeurs de commandes flexibles de l'architecture des GPU GCN offrent de nombreuses possibilités de ce type et leurs fonctionnalités en pratique dépendent en grande partie de l'implémentation logicielle. Polaris et affichageComme nous vous l'avons déjà expliqué, tout cela a été annoncé par AMD en janvier, les GPU Polaris profitent d'un moteur d'affichage qui a été mis à jour pour supporter le HDMI 2.0b et les futurs DisplayPort 1.3 et 1.4.  Les GPU Polaris apportent enfin le support du HDM 2.0b nécessaire pour pouvoir jouer sur une TV en 4K 60 Hz. Un support qui inclus le HDCP 2.2 requis pour afficher les Blu-Ray UHD et certaines vidéos 4K diffusées en streaming. Bien que ce support ne soit pas encore fonctionnel, il en va de même pour les GPU Pascal, les GPU Polaris sont prêts pour le DisplayPort 1.3 ainsi que pour le DisplayPort 1.4. Le premier apporte le mode HBR3 qui pousse la bande passante à 32.4 Gbps, 80% de plus que pour le HDMI 2.0b. De quoi pouvoir supporter des écrans 4K 120 Hz ou 5K 60 Hz avec un seul câble. Le DP 1.4 autorise l'utilisation des formats HDR, jusqu'à 96 Hz pour le 10-bit en 4K ou encore jusqu'à 200 Hz pour le 10-bit en 1440p. Un format qui pourrait avoir du succès chez les joueurs quand les écrans débarqueront. Les Radeon R300 et probablement toutes les cartes GCN, supporteront également la HDR via une mise à jour des pilotes mais seront limitées à au 1440p 60 Hz ou à la 4K 30 Hz.  Rappelons que le HDR ou High Dynamic Range permet d'afficher des images plus lumineuses, avec des couleurs plus fidèles. Comme vous le savez probablement, les jeux récents sont en général rendus en HDR avant qu'un algorithme de tone mapping transforme le tout en une image SDR affichable par nos écrans classiques. Ce n'est bien entendu pas idéal mais faute de mieux cela permettait de bénéficier en partie des avantages du HDR. Cela va changer avec l'arrivée progressive de TV et de moniteurs capables d'afficher directement des images HDR, plus fidèles et plus vives. Pour cela ces écrans devront proposer une luminosité supérieure (de 1000 à 2000 cd/m² pour les LCD et de 500 à 1000 cd/m² pour les OLED) et supporter un espace de couleurs étendu (BT.2020) avec un encodage 10-bit ou 12-bit adapté à ces nouvelles capacités (ST 2084 PQ). Les Radeon Polaris supportent autant le 10-bit que le 12-bit, mais dans un premier temps nous ne devrions voir débarquer que des écrans 10-bit. AMD propose dès à présent le Photon SDK aux développeurs. Il est dédié à faciliter l'intégration par les moteurs de jeu d'un algorithme de tone mapping adapté avec un mécanisme capable d'en déterminer la bonne configuration sur base des paramètres spécifiques de chaque écran. Un pilote HDR pour DirectX 11 est actuellement fourni à ces mêmes développeurs et la version DirectX 12 suivra d'ici quelques temps. Le support de la lecture des vidéo HDR est également actif dans ces pilotes destinés aux développeurs. AMD précise que la collaboration de Microsoft sera également nécessaire pour profiter pleinement du HDR, Windows 10 n'étant actuellement pas compatible. Il est possible de passer outre la gestion des couleurs de Windows en mode plein écran exclusif, mais une mise à jour de son sous-système graphique sera nécessaire pour pouvoir combiner correctement des contenus HDR et SDR. Polaris et moteurs vidéoAMD a mis à jour ses moteurs vidéo tant au niveau du décodage (UVD) que de l'encodage (VCE).  En plus des formats H.264 1080p60, VC1 1080p60 et MP4-P2 1080p60 supportés depuis les premiers GPU GCN, les GPU Polaris supportent le H.264 jusqu'en 4K120, comme les GPU GCN 3, et HEVC Main Profile 4K60 comme le GPU Fiji. Ils y ajoutent le HEVC Main 10 4K60, le MJPEG 4K30 ainsi que le VP9 en 4K à un niveau encore indéterminé, son support dans les pilotes n'ayant pas encore été implémenté.  Au niveau de l'encodage en H.264, les GPU Polaris sont similaires au GPU Fiji et supportent du 1080p120, du 1440p60 et de la 4K30. Etrangement ils ne supportent pas la 4K60 pourtant bien fonctionnelle sur le GPU Tonga. Les GPU Polaris apportent par contre le support de l'encodage HEVC jusqu'au 1080p240, 1440p120 et 4K60. Autre nouveauté pour les GPU Polaris, un nouvel algorithme sera proposé pour l'encodage destiné au streaming. Il permet d'améliorer la qualité avec un gain Y-PSNR de 1 dB en ayant recours à 2 passes, que ce soit en H.264 ou en HEVC.

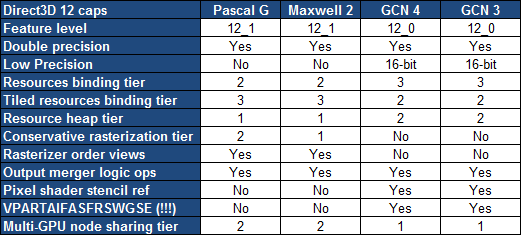

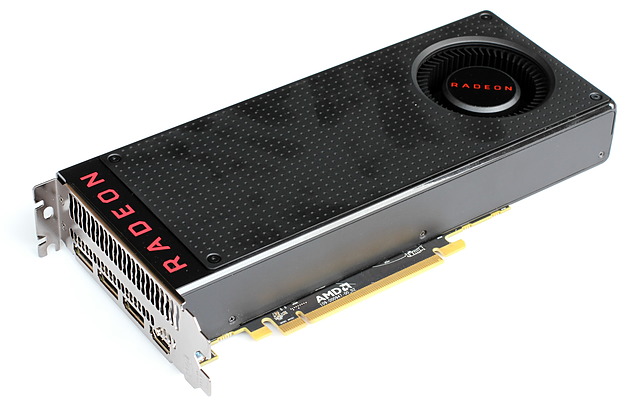

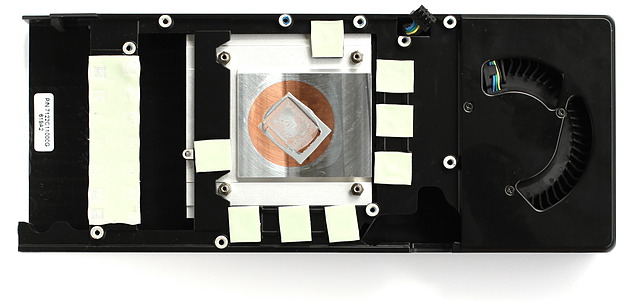

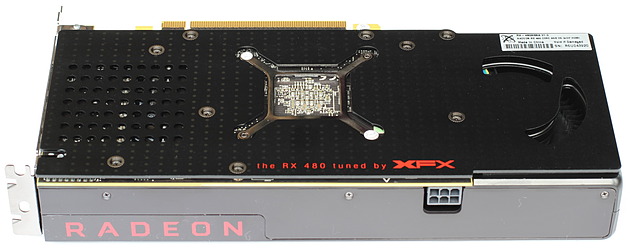

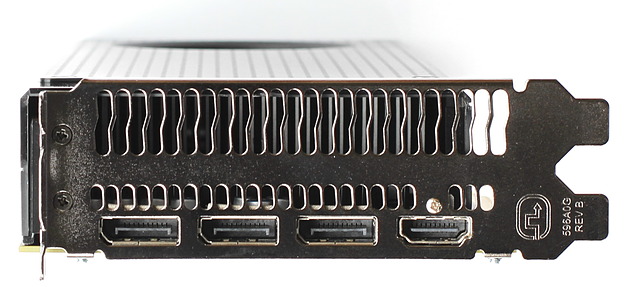

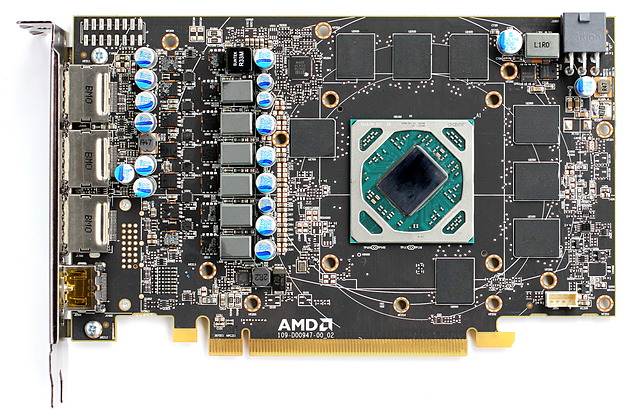

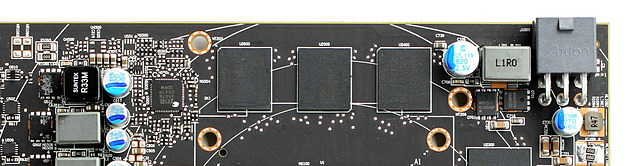

La Radeon RX 480 embarque un GPU Polaris 10 complet, une puce également appelée Ellesmere. Avec quelques unités de calcul de plus et une fréquence en hausse par rapport à la R9 380X, la RX 480 devance la R9 390 sur certains points tels que la puissance de calcul, le débit de filtrage des textures ou encore le débit de triangles. Avec seulement 32 ROP, elle est par contre en retrait au niveau du fillrate. La RX 480 doit par ailleurs se contenter d'une bande passante mémoire inférieure du fait de son bus de 256-bit, mais elle profite d'évolutions au niveau de la compression sans perte du framebuffer ainsi que d'une fréquence mémoire en nette hausse pour compenser. A noter à ce sujet que la version 4 Go de la RX 480 exploite de la mémoire plus lente que la version 8 Go, ce qui réduit sa bande passante de 12.5%. Par rapport à la GeForce GTX 970, à laquelle la Radeon RX 480 va tâcher de s'attaquer le temps que ses stocks s'épuisent, la nouvelle venue est également en retrait au niveau du fillrate mais affiche une puissance de calcul nettement supérieure, tout du moins sur le papier. Il faut en effet rappeler que ces chiffres bruts ne veulent pas tout dire. A puissance de calcul théorique similaire, les GeForce sont plus efficaces, notamment parce qu'elles disposent de 25% d'unités de calcul supplémentaires dédiées aux fonctions spéciales et qui ne sont par conséquent pas intégrées dans ces chiffres. Alors qu'AMD met en avant une consommation de 150W et a communiqué à ses partenaires un TDP de 110W qui correspond à la limite de consommation du packaging GPU et non de la carte dans son entièreté (d'où les rumeurs aussi opportunistes qu'erronées à ce sujet), nos mesures font état d'une limite de consommation qui est en pratique de +/- 170W. Pourquoi cette différence avec le chiffre communiqué par AMD ? Nous avons posé la question au fabricant qui nous a indiqué se baser sur une moyenne mobile de 5s qui lisse la consommation maximale. Dans ces conditions ses propres mesures placent la consommation entre 150 et 156W. Ce chiffre d'AMD n'est cependant pas comparable aux valeurs communiquées par Nvidia qui représentent bien la limite de consommation de la carte, tout comme les 170W que nous reportons ici. Un chiffre particulièrement important puisque comme nous allons le voir la RX 480 est fortement limitée par son enveloppe thermique. Nous avons ensuite rassemblé les fonctionnalités exposées à travers Direct3D 12 :  Cette nouvelle déclinaison de l'architecture GCN n'apporte le support d'aucune nouvelle fonctionnalité de DirectX alors que nous espérions que les Radeon rattrapent les GeForce sur le niveau 12_1. Les GPU AMD conservent globalement un avantage avec plus de flexibilité au niveau de la gestion des ressources mais les GeForce Maxwell et Pascal sont les seules à supporter les Volume tiled resources. L'accès aux données entre GPU (en dehors des copies) est également plus flexible en SLI qu'en CrossFire. Dans un premier temps, la Radeon RX 480 de référence sera la seule carte disponible et tous les exemplaires sortent de la même usine. Un design qui pourra éventuellement être agrémenté de stickers, d'une backplate ou encore d'un petit overclocking par les partenaires d'AMD. Pour ce lancement c'est avant la version 8 Go qui sera proposée avec seulement quelques lots en version 4 Go mais à priori pas pour le marché français. Un choix plus que curieux d'autant que lors du Computex AMD a mis en avant le tarif de cette version 4 Go !  AMD nous a fournis une carte de référence en version 8 Go et nous avons de notre côté récupéré des échantillons commerciaux de marques Sapphire et XFX, également en 8 Go. AMD a opté pour un design traditionnel à base de turbine ou de ventilateur radial qui a l'avantage d'expulser l'air chaud en dehors du boîtier :  Au niveau de l'esthétique, AMD a essayé de se rapprocher de la Radeon R9 Fury X mais en réduisant les coûts de fabrication autant que possible. Au lieu d'aluminium plutôt bien travaillé, nous retrouvons une coque faite d'une pièce de plastique dont les différentes textures permettent cependant un résultat global plutôt correct. Le logo Radeon illuminé passe évidemment à la trappe.  Pour le refroidissement à proprement parler, AMD a là aussi essayé de compresser les coûts avec un bloc de refroidissement d'aluminium extrudé plutôt simple avec ses grosses ailettes et son petit insert en cuivre. Face à une limite de consommation de 170W, il semble un petit peu léger. Nous sommes en effet très loin du bloc exploité par Nvidia par exemple sur la GTX 1070 alors même que celle-ci se contente d'une limite de consommation inférieure. Une plaque métallique massive recouvre le PCB et ses composants sensibles et est prolongée pour faire office de support pour le ventilateur. Un support qui est par conséquent très stable et qui n'a rien avoir avec celui en plastique des GTX 670 ou 660 dont nous apprécions peu le design de référence. Le ventilateur exploité par AMD n'est cependant pas ce qui se fait de mieux sur le marché et il a tendance à produire de petits bruits mécaniques au repos.  AMD n'a pas prévu de backplate mais ses partenaires sont libres d'en ajouter une, c'est ce qu'a fait XFX pour améliorer le look de sa carte (la backplate n'est en contact avec aucun composant). Des petits coussinets sont placés au niveau du ventilateur, pour assurer la robustesse là où il n'est pas possible de la visser.  La connectique vidéo est similaire à celle des précédents designs de référence : une HDMI et 3 DisplayPort qui peuvent toutes être utilisées simultanément et avec un hub DisplayPort pour monter à 6 sorties. Le PCB prévoit cependant la possibilité d'ajouter une sortie DVI.  Le PCB de la RX 480 de référence est très court. Nous y retrouvons les 8 puces de mémoire GDDR5 Samsung ainsi qu'un étage d'alimentation avec 6 phases dédiées au GPU. De quoi en arriver à l'un des plus gros problèmes de ce design de référence. AMD n'a prévu qu'un connecteur 6 broches, ce qui d'après les spécifications PCI Express limite la carte à 150W dont 141W en 12v. En pratique la RX 480 va bien au-delà (170W) et le problème est qu'elle n'hésite pas à le faire via le bus PCI Express. A ce niveau, en principe, la limite maximale est de 5.5A en 12V. Par défaut et dans un jeu moyennement gourmand tel que Battlefield 4, la RX 480 monte déjà à 7A. Avec overclocking et augmentation de la limite de consommation, nous avons mesuré de 9 à 10A ! Un dépassement inquiétant sur une carte de référence en partie dédiée aux intégrateurs et qui pourra poser des problèmes sur certaines cartes-mères que ce soit en termes de fiabilité que d'interférence audio sur des modèles d'entrée de gamme ou un peu anciens qui n'ont pas été prévus pour un tel niveau de surconsommation. Ce design n'est selon nous pas adapté à la consommation de la RX 480 et nous ne comprenons pas comment AMD a pu se contenter d'un connecteur 6 broches alors que de toute évidence un 8 broches était requis. Est-ce qu'AMD a voulu travailler l'image basse consommation à travers ce petit connecteur ? Est-ce qu'AMD a dû pousser la limite de consommation de son GPU en dernière minute ? Difficile à dire. AMD se contente de nous expliquer estimer que la spécification PCI Express laisse un peu de latitude et que selon ses propres observations, cette consommation excessive via le bus ne devrait pas poser de problème dans la majorité des cas. Il serait préférable qu'AMD corrige rapidement ce design pour lui associer un connecteur 8 broches ou à minima modifie légèrement ses circuits d'alimentation pour faire en sorte que le surplus de consommation soit puisé exclusivement à travers le connecteur 6 broches et non à travers le bus. Cela reviendrait cependant à admettre un problème sur les cartes actuellement en vente, ce qu'AMD n'est probablement pas prêt à faire. Pour ce dossier, nous avons repris le protocole introduit avec le test de la GeForce GTX 1080, mais en mettant bien entendu à jour l'ensemble des jeux. Tous les derniers patchs au 28/06/2016 ont été installés, la plupart des jeux étant maintenus à jour via Steam/Origin/Uplay. **Lors du test de la GeForce GTX 1080, nous nous étions plains de la politique d'EA / Origin qui ont décidé depuis quelques mois de bloquer les clés de Battlefield 4 et de Star Wars Battlefront après plusieurs changements de cartes graphiques dans une période de 12h, prétextant qu'il s'agit de systèmes différents. Face à un support désarmé et qui n'a pas été mis au courant, nous n'avions eu d'autre choix que d'acheter de multiples clés. Un passage à la caisse qui a permis de multiplier les Battlefield 4 dans un même compte Origin mais qui se contente d'avaler les nouvelles clés de Star Wars Battlefront sans rien débloquer et sans aucun avertissement ! Et avec les dernières mises à jour, c'est pire ! Face à de nouveaux blocages légèrement différents pour Battlefield 4, dès qu'une clé d'un même compte est bloquée, les autres le sont aussi, nous avons créé un second compte et sommes à nouveau passés à la caisse. Sauf que EA détecte que ce compte provient de la même machine et le bloque d'emblée. En d'autres termes, si vous n'avez pas suivi, EA bloque une clé au départ sous prétexte qu'elle est utilisée sous trop de machines et bloque ensuite toutes les autres clés utilisées sur la même machine sous prétexte qu'il s'agit de la même machine. EA préfère de toute évidence s'essuyer les pieds sur ses clients plutôt que de prendre le risque qu'une limitation débile de son DRM ne soit contournée.** Nous avons utilisé les pilotes 368.39 WHQL du côté de Nvidia et les Crimson Edition 16.6.2 RC1 pour les Radeon. AMD nous avait fournis une première mouture des 16.6.2 mais celle-ci présentait un bug qui limitait le débit de l'interface PCI Express. Tous nos tests ont été effectués avec la RC1 qui nous est parvenue ce lundi. Nous avons opté tout d'abord pour la résolution de 1080p avec un niveau de détail très élevé, qui correspond au niveau de performances de la RX 480. Comme d'habitude, nous avons évité d'activer l'antialiasing de type SSAA, que nous jugeons beaucoup trop gourmand par rapport à ce qu'il apporte. Nous avons également ajouté des mesures en 1440p sur base du niveau de détail adapté à la GTX 1070 que nous testions en parallèle. Toutes les cartes ont été testées avec une température ambiante contrôlée à 26 °C et, pour chaque jeu, nous avons pris le temps nécessaire pour que la température et la fréquence GPU se stabilise. Ce n'était pas simple dans le cas de la RX 480 pour laquelle la plupart des outils ne reportent pas encore la température GPU. Nous avons donc dû jouer de la caméra infrarouge. Rappelons que nous avons mis à jour notre plate-forme de test qui est passée au X99 et au Core i7-5960X, poussé à 4 GHz. Au niveau de l'affichage, pour les tests en 1440p nous avons opté pour l'Asus ROG Swift PG278Q mais limité à 120 Hz, certains Radeon étant capricieuses en 144 Hz avec certains câbles sur ce moniteur. G-Sync était désactivé. Configuration de test

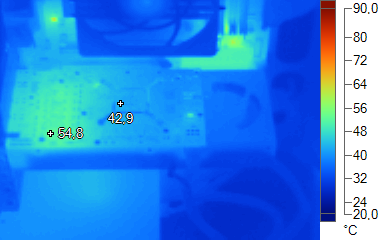

Nous avons mesuré les performances lors de l'accès aux textures avec filtrage bilinéaire activé et ce, pour différents formats : en 32 bits classique (8x INT8), en 64 bits "HDR" (4x FP16), en 128 bits (4x FP32), en profondeur de 32 bits (D32F) et en FP10, un format HDR introduit par DirectX 10 qui permet de stocker des textures HDR en 32 bits avec quelques compromis. Les GeForce GTX sont capables de filtrer les textures FP16 à pleine vitesse contrairement aux Radeon, ce qui leur donne un avantage considérable sur ce point. FillrateNous avons mesuré le fillrate sans et puis avec blending, et ce avec différents formats de données : [ Standard ] [ Avec Blending ] Avec ses derniers GPU, qu'il s'agisse de Fiji ou de Polaris P10, AMD n'a pas fait évoluer le nombre de ROP ce qui les place en net retrait par rapport à la concurrence. Il n'y a qu'en HDR 64-bit qu'ils restent équivalents aux GeForce au niveau du fillrate. A noter que les GeForce depuis Kepler sont capables de transférer les formats FP10/11 et RGB9E5 à pleine vitesse vers les ROP, comme les Radeon, mais le blending de ces formats se fait toujours à demi vitesse. Par ailleurs, si tous les GPU sont capables de traiter le FP32 simple canal à pleine vitesse sans blending, seules les Radeon conservent ce débit avec blending. Étant donné les différences architecturales des GPU récents au niveau du traitement de la géométrie, nous nous sommes évidemment penchés de plus près sur le sujet. Tout d'abord nous avons observé les débits de triangles dans deux cas de figure : quand tous les triangles sont affichés et quand ils sont tous rejetés (parce qu'ils tournent le dos à la caméra) : Contrairement à ce que nous attendions avec Polaris, AMD n'a pas fait progresser le débit de triangles lorsqu'ils peuvent être éjectés du rendu. Les petites améliorations apportées à ce niveau permettent de se rapprocher plus du débit maximal dans certaines conditions difficiles qui sortent du cadre de ce test qui est un cas idéal. La fréquence en hausse de la RX 480 permet cependant une petite progression de ses performances au niveau géométrique. Ensuite nous avons effectué un test similaire mais en utilisant la tessellation. A noter que nous avons quelque peu revu notre test de manière à l'adapter à la puissance en hausse des GPU : Les GeForce réaffirment ici leur avantage face aux Radeon qui peuvent se retrouver plus rapidement submergées en cas de génération massive de données ou de hull shaders lourds. Les GeForce profitent d'une architecture qui distribue le traitement géométrique au niveau des SM ainsi que de groupes de threads plus petits (32 vs 64) qui facilitent le maintien d'un taux d'occupation élevé. La RX 480 profite ici aussi d'une fréquence en hausse de 20% pour faire progresser ses débits. Nous avons utilisé le protocole de test qui nous permet de mesurer la consommation de la carte graphique seule. Nous avons effectué ces mesures au repos sur le bureau Windows 10 et en veille écran. Pour la charge, nous testons d'une part Battlefield 4 en mode Ultra qui représente un jeu moyennement lourd et d'autre part The Witcher 3 qui remplace Anno 2070 pour représenter un jeu très lourd. Si ce dernier est à peu près aussi lourd qu'Anno 2070 pour les GeForce, il l'est par contre un peu moins pour les Radeon. Nous réévaluerons éventuellement la possible utilisation d'un autre jeu dans le futur. Nous avons testé les GeForce GTX de référence en mode 'Uber', ce qui consiste à relever leurs limites de consommation et de température au maximum pour voir ce qu'elles ont dans le ventre sans ces dernières. Aucun overclocking n'est par contre appliqué mais le turbo par défaut se maintient à une fréquence plus élevée. Avec 16W, la consommation de la Radeon RX 480 est relativement élevée au repos pour un GPU en 14nm. AMD nous indique qu'un bug dans ses pilotes empêche actuellement la carte de passer dans un état plus économe, et que la consommation devrait plutôt être de 11W, ce que nous vérifierons dès que le problème aura été corrigé. En charge sa consommation tourne entre 165 et 170W dans la majorité des jeux, la RX 480 étant limitée par son enveloppe thermique en permanence. Rappelons qu'AMD mesure et contrôle la consommation directe du GPU mais pas des autres éléments. C'est pour cette raison qu'un jeu moins lourd mais qui fait plus appel à la mémoire tel que Battlefield 4 avec MSAA 4x pousse la carte dans son ensemble à consomme un petit peu plus que The Witcher 3, alors que la consommation du GPU est similaire. C'est la première fois qu'une carte graphique affiche aussi clairement ce comportement, mais c'est au final assez logique. Il aurait pu en être de même avec la R9 Nano sauf que la consommation de la mémoire est inclue dans celle du GPU, ce qui masque le phénomène. Par contre, en mode Uber, soit quand nous relevons les limites de consommation et de ventilation, le GPU monte à sa fréquence maximale dans tous les jeux et ce sont alors les plus lourds qui consomment le plus. Pour maintenir 1266 MHz dans The Witcher 3, la RX 480 a besoin de 192W. Rappelons, comme expliqué dans le descriptif de la carte de référence, que la RX 480 n'est équipée que d'un seul connecteur d'alimentation 6 broches, ce qui fait qu'il tire une grosse partie de sa consommation, à peu près la moitié, parfois un peu plus, du bus PCI Express. Elle va à ce niveau bien au-delà de la spécification qui est de 5.5A. Dans Battlefield 4, nous mesurons 6.92A par défaut et 7.10A en 'Uber'. Une valeur qui monte à 7.79A dans The Witcher 3 et qui impose un stress pour lequel toutes les cartes-mères ne sont pas prévues. La RX 480 de Sapphire, un échantillon commercial sélectionné au hasard, affiche une consommation similaire mais se stabilise à un ensemble température et fréquence légèrement moins favorable. A l'inverse, l'échantillon commercial de marque XFX se comporte un petit peu mieux que la carte fournie par AMD. Bien que ces données soient approximatives, compte tenu de la variation entre échantillons d'un même modèle, nous avons mis en relation ces mesures de consommation avec les performances, en retenant des fps par 100W pour que les données soient plus lisibles, de quoi donner une idée globale sur le rendement énergétique de toutes ces cartes : [ Battlefield 4 ] [ The Witcher 3 ] Si le rendement progresse entre la RX 480 et la R9 290X, il reste inférieur à celui des R9 Fury X et Nano dans Battlefield 4 et est similaire dans The Witcher 3. De quoi nous laisser penser que le sous-système mémoire de Polaris 10 a nettement moins progressé sur le plan de l'efficacité et que les gains proviennent plus de ses unités de calcul. Quoi qu'il en soit, AMD ne fait ici que se rapprocher de Maxwell, sans l'égaler. La comparaison avec Pascal, plus de 2x plus efficace dans le cas de la GTX 1080 FE, fait mal alors qu'AMD a communiqué énormément sur ce point. Entre Pascal et Maxwell, Nvidia est parvenu à faire progresser le rendement de 72 et 79% sur ces deux jeux, alors qu'il ne progresse que de 28 et 51% du côté d'AMD. Nous plaçons les cartes dans un boîtier Cooler Master RC-690 II Advanced et mesurons le bruit d'une part au repos et d'autre part en charge sous le test1 de 3DMark11. Un SSD est utilisé et tous les ventilateurs du boîtier ainsi que celui du CPU sont coupés pour la mesure. Le sonomètre est placé à 60cm du boîtier fermé et le niveau de bruit ambiant se situe à moins de 20 dBA, ce qui est la limite de sensibilité pour laquelle il est certifié et calibré. Au repos, la RX 480 fait aussi bien que les GeForce GTX, tout du moins en apparence. En pratique, à basse vitesse (780 RPM), le ventilateur produit un bruit mécanique qui peut être agaçant même s'il est ignoré par notre sonomètre. Notons cependant que ce bruit est beaucoup plus faible sur la RX 480 Sapphire, ce qui nous laisse penser que cela dépend d'une carte à l'autre. En charge avec 40 dBA, la Radeon RX 480 manque clairement de discrétion d'autant plus qu'il ne s'agit pas d'un souffle étouffé à la tonalité peu dérangeante comme c'est le cas sur les GeForce GTX de référence haut de gamme. Et laisser le ventilateur monter dans les tours pour maintenir une fréquence maximale n'est pas une option vu le niveau sonore de près de 50 dBA. TempératuresToujours placées dans le même boîtier, nous avons relevé la température du GPU rapportée par la sonde interne : Ce graphique est intéressant puisqu'il met en avant une des variables d'ajustement principales en ce qui concerne la variabilité naturelle entre échantillons de RX 480 : la température GPU. AMD fait en sorte que les nuisances sonores soient similaires entre échantillons et de limiter autant que possible l'impact en termes de performances. Durant ce test de charge lourde il n'y avait ainsi que 20 MHz d'écart au niveau de la fréquence moyenne entre les 3 RX 480 alors que si la température avait été fixée à un niveau identique comme le fait Nvidia, cet écart serait facilement monté à 100 MHz par exemple. Thermographie infrarougeVoici les photos thermiques obtenues avec à chaque fois 45 minutes de mise en situation : Center>  [ Radeon RX 480 - Repos ] [ Charge ] [ Charge 'Uber' ] Pas de problème particulier à noter au niveau du refroidissement des VRM qui, à 95 °C, sont à une température qui ne pose pas de soucis pour de tels composants. A noter qu'en mode 'Uber' leur température n'augmente que très peu alors que la charge moyenne au niveau de l'ASIC passe de 109.7W à 138.4W. Leur refroidissement semble donc plutôt bien pris en compte par AMD puisqu'il reste proportionnel à celui du GPU lorsque la vitesse de ventilation augmente, ce qui n'est pas le cas sur toutes les cartes.  Nous lançons le test Fire Strike avec les presets standard, extrême et ultra proposés par Futuremark. [ Fire Strike ] [ Fire Strike Extreme ] [ Fire Strike Ultra ] La Radeon RX 480 s'en tire plutôt bien dans 3DMark Fire Strike et se place devant la GTX 970 Gaming de MSI et pas trop loin de la R9 290X Tri-X OC de Sapphire.  Après plusieurs années de bons et loyaux services, notamment en matière de mesure de l consommation, nous avons mis Anno 2070 à la retraite. Il est remplacé par Anno 2205, un peu plus lourd graphiquement mais moins gourmand énergétiquement. Nous utilisons le mode de qualité maximale du jeu mais en MSAA 2x et effectuons un déplacement sur une carte en mesurant les performances avec Fraps. Le jeu est maintenu à jour via Uplay. Dans ce premier jeu testé, la RX 480 se place entre les R9 390 et GTX 970, mais l'écart entre toutes ces solutions est relativement faible. En 1440p, la RX 480 reste tout juste derrière la GTX 970.  Ashes of the Singularity est un des premiers jeux DirectX 12 disponible. Il a la particularité d'être conçu en terme de gameplay pour ces nouvelles API avec des scènes très lourdes qui ont besoin d'un surcoût réduit des commandes de rendu ainsi que d'une bonne exploitation des CPU multicoeurs. Par ailleurs, AotS intègre un support du multi engine destiné à booster les performances GPU, ce qu'AMD appelle Async Compute. Cette option apporte des gains sur les Radeon mais est contreproductive ou n'a pas d'effet sur les GeForce, y compris sur la GTX 10x0. Nous avons utilisé la configuration par défaut du jeu qui active Async Compute sur Radeon et le désactive sur GeForce. Nous utilisons une partie du benchmark intégré avec un niveau de qualité High et en mode DirectX 12. Le jeu est maintenu à jour via Steam. Comme prévu, les Radeon se comportent plutôt très bien sur ce jeu avec une R9 390 qui égale la GTX 980 alors que la RX 480 est très proche.. En 1440p, la RX 480 reste devant la GTX 970 et dépasse cette fois la GTX 980 de référence.  Battlefield 4 repose sur le moteur Frostbite 3, une évolution de la version 2 présente dans Battlefield 3. La base du rendu reste très proche (rendu différé, calcul de l'éclairage via compute shaders) et les évolutions visibles sont mineures, DICE ayant principalement optimisé son moteur pour les consoles de nouvelle génération. Parmi les petites nouveautés, citons un support plus avancé de la tessellation et une amélioration du module "destruction" du moteur. Sur PC, un mode Mantle spécifique aux Radeon et qui permet de réduire le coût CPU du rendu est proposé mais nous ne l'avons pas utilisé pour ce test. Pour rappel, il s'agit d'une API propriétaire de plus bas niveau dédiée aux Radeon HD 7000 et supérieures, qui a été développée par AMD et DICE. Depuis l'arrivée d'autres API de bas niveau, AMD a cependant cessé les développements autour de Mantle et n'a pas optimisé son utilisation dans les pilotes pour ses derniers GPU. Nous testons le mode Ultra avec MSAA 4x et nous relevons les performances avec Fraps, sur un parcours bien défini. Le jeu est maintenu à jour via Origin. Les GeForce sont plus efficaces que les Radeon sous le Frosbite Engine avec MSAA et la RX 480 reste 13% derrière la GTX 970. Nous avons conservé exactement la même qualité graphique en 1440p et les GeForce conservent leur avance.  Crysis 3 reprend le même moteur que Crysis 2 : le CryEngine 3. Ce dernier profite cependant de quelques petites évolutions telles qu'un support plus avancé de l'antialiasing : FXAA, MSAA et TXAA sont au programme, tout comme un nouveau mode appelé SMAA. Il s'agit d'une évolution du MLAA qui permet, optionnellement, de prendre en compte des données de type sous-pixels soit à travers la combinaison avec du MSAA 2x, soit avec une composante temporelle calculée à partir de l'image précédente. Le SMAA 1x est la simple évolution du MLAA, le SMAA 2tx utilise une composante temporelle relativement complexe et le SMAA 4x y ajoute le MSAA 2x. Notez qu'il ne faut pas confondre le SMAA 2tx proposé en mono-GPU avec le SMAA 2x proposé en multi-GPU, ce dernier utilisant du MSAA 2x sans composante temporelle. Nous mesurons les performances avec Fraps en très haute qualité avec SMAA 2tx. Le jeu est maintenu à jour via Origin. Crysis 3 reste un jeu très gourmand et la RX 480 y égale la GTX 970. Il apprécie cependant de disposer d'un peu plus de bande passante mémoire et la R9 390 est un peu plus performante. C'est similaire en 1440p.  Après une longue période en version beta, DiRT Rally est finalement sorti en version finale fin 2015. Il vient logiquement remplacer GRID 2 dans notre panel de test. Nous mesurons les performances avec Fraps sur une scène de test personnalisée qui inclut l'éclairage de nuit ainsi qu'une forte pluie. L'advanced blending qui pose soucis aux Radeon n'est pas activé. Le jeu est maintenu à jour via Steam. Avec un bon niveau de MSAA, la bande passante permet de faire la différence dans ce jeu et la RX 480 est assez nettement derrière la R9 390. C'est similaire en 1440p si ce n'est que les Radeon montent d'un cran par rapport aux GeForce ce qui permet à la RX 480 d'égaler la GTX 970.  La nouvelle mouture de DOOM conserve la tradition d'un moteur graphique OpenGL, une API qui fait donc un retour dans notre suite de test. Le jeu n'est pas extrêmement gourmand, mais il est plutôt bien optimisé et atteint facilement 150 à 200 fps sur notre Core i7-5960X poussé à 4 GHz. Une version Vulkan est attendue sous peu et permettra de pousser encore plus haut les fps dans ce jeu au rythme plus que nerveux. Nous mesurons les performances avec Fraps sur un parcours bien défini. Le jeu est maintenu à jour via Steam. A noter que le jeu tourne en OpenGL 4.5 sur GeForce et en OpenGL 4.3 sur Radeon, AMD ayant un peu de retard au niveau de ses pilotes. La RX 480 est proche de la GTX 970 et de la R9 390. Le classement des cartes est similaire en 1440p et la RX 480 est capable d'y maintenir les 60 fps.  Dying Light est un jeu de type survival horror animé par le Chrome Engine 6 de Techland et dans lequel le monde est plutôt vaste et ouvert. Nvidia a travaillé avec Techland pour y inclure certains effets issus de ses librairies Gameworks tels que le HBAO+ et le Depth of Field. Nous avons mesuré les performances avec Fraps sur un parcours bien défini en qualité maximale à l'exception du PCSS, un effet GameWorks, qui a été désactivé. Le jeu est maintenu à jour à travers Steam. Dying Light souffrait de micro-saccades régulières qui impactaient fortement la fluidité sous Windows 7 et avec toutes les cartes, mais elles ont disparu lors du passage à Windows 10. Les GeForce sont plus à l'aise que les Radeon dans ce jeu. En 1440p, la RX 480 revient au niveau de la GTX 970.  Evolve, développé par Turtle Rock Studios, est basé sur le Cry Engine 3. Contrairement à ce dernier, les modes d'antialiasing à base de MSAA, extrêmement gourmands avec ce moteur, ne sont pas proposés. Un nouveau mode de SMAA a par contre été développé par Crytek et intégré dans les branches plus récentes de son moteur : le 1tx. Il s'agit d'une version quelque peu simplifiée du SMAA 2tx, antialiasing à base de composante temporelle, qui a la particularité d'être compatible avec le multi-GPU. Nous mesurons les performances à l'aide de Fraps sur un parcours bien défini et le jeu est maintenu à jour avec Steam. Les Radeon apprécient particulièrement ce titre et la RX 480 devance la GTX 970. En 1440p, la RX 480 souffre cette fois un peu plus.  Fallout 4 repose sur une version améliorée du Creation Engine introduit avec Skyrim et développé en interne par Bethesda. Un moteur qui permet de pousser la qualité graphique vers le haut par rapport au Gamebryo exploité pour les jeux de la génération précédente dont faisait partie Fallout 3. Dans la version qui équipe Fallout 4, l'éclairage gagne en réalisme notamment avec le passage au physically-based deferred renderer et l'ajout d'une composante volumétrique pour représenter l'atmosphère. La version la plus évoluée de cet effet a été développée en collaboration avec Nvidia et fait appel à la tessellation. Au niveau de l'antialiasing les options proposées sont par contre assez pauvres avec au mieux un Temporal AA qui fonctionne plutôt bien mais uniquement en mouvement constant. A l'arrêt ce type d'antialiasing est évidemment limité dans son action. Nous testons Fallout 4 avec Fraps sur un parcours bien défini en poussant les options au niveau Ultra avec en plus le HBAO+. Le jeu est maintenu à jour via Steam. La GTX 970 profite ici d'un petit avantage sur la RX 480. Un avantage que nous retrouvons également en 1440p.  Dernier opus de la série, Far Cry Primal nous envoie chasser le mammouth dans la préhistoire. Il est graphiquement similaire à Far Cry 4 même si son moteur graphique a reçu quelques petites améliorations. Nous activons le niveau de qualité Very High du jeu avec du SMAA 1x. Nous utilisons Fraps sur un parcours bien défini et le jeu est maintenu à jour via Uplay. Les Radeon s'en tirent plutôt bien en 1080p. Mais reculent légèrement en 1440p, ce qui n'empêche pas la RX 480 de rester au niveau de la GTX 970.  Enfin, après de nombreuses demandes, nous avons ajouté GTA V à notre protocole de test. Plutôt gourmand du côté des GPU, il propose de nombreuses options graphiques. Nous testons le jeu avec Fraps en qualité maximale à l'exception du MSAA qui reste en 2x (mais le MSAA est désactivé sur les réflexions). Le jeu est maintenu à jour via Steam. La RX 480 est très proche de la GTX 970 en 1080p. Et l'égale en 1440p.  Cette dernière mouture d'Hitman, proposée sous la forme d'épisodes, a la particularité de supporter DirectX 12, mode qui est devenu légèrement plus performant avec les derniers patchs et pilotes, autant pour les Radeon que pour les GeForce. Nous l'avons donc préféré au mode DirectX 11. Pour mesurer les performances, nous poussons les options graphiques au niveau Ultra et utilisons Fraps dans le jeu maintenu à jour via Steam. C'est le jeu dans lequel les Radeon sont le plus en forme avec une RX 480 qui devance nettement la GTX 980. Les Radeon préservent leur avance en 1440p et la RX 480 en profite pour se frotter à la GTX 980 Ti.  Project Cars est un jeu de course automobile développé depuis 2011 sur base d'un système de beta participative qui permettait d'accéder aux nouvelles builds régulières et d'interagir avec les développeurs de Slightlymad Studios (à l'origine des Need For Speed Shift). Son moteur au rendu différé supporte DirectX 11 et c'est ce mode que nous avons testé en poussant toutes les options au niveau maximal à l'exception de l'antialiasing. Nous avons testé le jeu via Fraps sur un parcours bien défini et avec de la pluie au niveau des conditions météo. Un détail important à préciser puisqu'il réduit significativement les performances. Nous avons opté pour 7 concurrents qui restent devant nous pendant la mesure des performances. Les Radeon ont beaucoup de mal dans ce jeu très attendu et ce n'est pas nouveau. Critiqué pour avoir favorisé Nvidia, le développeur s'est justifié en expliquant que ce n'était pas du tout le cas, mais qu'AMD n'avait pas voulu collaborer en amont de la sortie du jeu pour s'assurer d'optimiser les performances. Difficile de savoir ce qu'il s'est réellement passé, mais depuis AMD a commencé à progressivement introduire quelques optimisations spécifiques dans ses pilotes, sans grand succès comme vous allez le voir. Les Radeon sont très nettement derrière les GeForce mais la RX 480 fait un peu mieux que la R9 390. C'est similaire en 1440p.  Le précédent Tomb Raider était déjà plutôt réussi graphiquement, et le nouveau titre va encore plus loin. Une vraie réussite qui se traduit par une gourmandise qui peut être élevée. Les développeurs ont cette fois travaillé avec Nvidia et proposent la première implémentation du VXAO, une technique de calcul de l'occultation ambiante dérivée du VXGI spécifique aux GPU Maxwell et Pascal. Nous poussons la qualité en mode Very High et mesurons les performances sur un parcours bien défini avec Fraps. Le jeu est maintenu à jour via Steam. Les Radeon s'en tirent plutôt bien et la RX 480 égale la GTX 970 de MSI. C'est identique en 1440p.  Développé par EA DICE, Star Wars Battlefront exploite comme vous vous en doutez le moteur maison Frostbite 3 qui a été introduit avec Battlefield 4. Il s'en distingue cependant par quelques petites améliorations graphiques au niveau de la tessellation pour ajouter des détails aux terrains et de l'éclairage qui gagne en réalisme et profite d'un effet d'occultation ambiante à base de compute shaders plus évolués. Star Wars Battlefront fait par contre totalement l'impasse sur le support du MSAA et se contente du FXAA ou du TAA, qui, une fois encore, se comporte plutôt bien mais uniquement lorsque les mouvements sont suffisants. Nous testons le jeu avec Fraps sur un parcours bien défini et il est maintenu à jour via Origin. Les Radeon se positionnement plutôt bien dans ce jeu. En 1440p, la RX 480 est proche de la GTX 980 de référence qui ne se comporte pas très bien.  Nous testons le jeu en qualité Ultra à l'exception des ombres qui restent en niveau élevé. Etant donné le cycle jour / nuit qui impacte les performances, nous devons utiliser le bench intégré. Nous n'utilisons cependant pas le score qu'il produit mais activons Fraps sur la partie du parcours qui correspond aux scènes de jeu, le benchmark ayant tendance à surévaluer les performances via des passages plus légers. Le jeu est maintenu à jour via Uplay. La RX 480 est ici plus efficace que la R9 390 et se place au niveau de la GTX 970 de MSI. La RX 480 reste plus rapide que la GTX 970 en 1440p.  Très attendu, le dernier opus de The Witcher ne déçoit pas. Développé par CD Projekt RED, il repose sur le REDengine 3, un moteur conçu pour gérer de vastes mondes ouverts, raison pour laquelle il tourne exclusivement en 64-bit. CD Projekt RED s'est associé à Nvidia pour intégrer deux effets gaphique de la suite Gameworks : le HBAO+ et surtout HairWorks. Réponse au TressFX d'AMD, HairWorks améliore la chevelure des personnages, la crinière des chevaux et la fourrure de plusieurs animaux ou créatures rencontrés dans le jeu en faisant appel à un niveau de tessellation très élevé pour chaque brindille. HairWorks est donc très gourmand et Nvidia aurait fait en sorte que son implémentation complique le travail d'optimisation d'AMD, ce qui n'a pas manqué de créer la polémique, même si en pratique désactiver cet effet ne dénature pas vraiment le jeu. Nous l'avons testé sans et avec HairWorks mais ce dernier mode ne fera pas partie de l'indice. A noter qu'avec HairWorks nous avons désactivé l'optimisation d'AMD spécifique à The Witcher 3 et qui force un niveau de tessellation inférieur à celui demandé par le jeu. Tous les autres paramètres sont poussés au niveau maximal. Nous effectuons un parcours bien défini avec Fraps. [ Sans HairWorks ] [ Avec HairWorks ] Sans HairWorks, le positionnement des Radeon et des GeForce est assez proche de la moyenne mais avec un petit avantage à la RX 480. Avec cet effet les performances des premières subissent un contrecoup plus important que les GeForce qui ne perdent que 20%. Il est cependant intéressant d'observer que l'impact se réduit au fur et à mesure qu'AMD améliore son architecture : -44% pour la R9 390 (GCN 2), -36% pour la R9 Nano (GCN 3) et -31% pour la RX 480 (GCN 4). En 1440p avec un niveau de qualité maximal à l'exception de HairWorks, la RX 480 est juste devant la GTX 970 Bien que les résultats de chaque jeu aient tous un intérêt, nous avons calculé un indice de performances en nous basant sur l'ensemble de résultats et en attachant une importance particulière à donner le même poids à chacun des jeux. The Witcher 3 avec HairWorks activé n'est pas pris en compte dans l'indice. Nous avons attribué un indice de 100 à la GeForce GTX 970 de référence : En moyenne, la Radeon RX 480 affiche des performances similaires à celles d'une GTX 970 ou d'une R9 390. Sa prestation varie cependant fortement d'un jeu à l'autre avec par exemple -20% sur la R9 390 dans Dirt Rally mais +12.5 dans The Division. Et par rapport à la GTX 970 nous notons -13% dans Battlefield 4 mais +38% dans Hitman. Nous pouvons également observer que le GPU Polaris 10 de la RX 480 profite d'un boost de performances de 37% par rapport au GPU Tonga de la R9 380X. Le classement est à peu près similaire en 1440p et avec un niveau de qualité qui fait en général tourner la RX 480 entre 30 et 40 fps : Page 30 - Overclocking : quelle marge pour la RX 480 ? # Powertune Avant de passer à l'overclocking, un petit rappel s'impose sur Powertune et la manière dont AMD maintient son GPU dans les clous par rapport à son enveloppe thermique. Une limite de consommation est fixée pour l'ASIC, soit pour le packaging du GPU. Elle est de 110W pour la Radeon RX 480 et Powertune adapte la fréquence GPU pour que celle valeur soit respectée en moyenne. Il peut donc y avoir de brefs pics plus élevés. La consommation totale de la carte est bien entendu supérieure à ces 110W puisqu'il faut y ajouter la consommation liée à la mémoire, le rendement de l'étage d'alimentation etc. Suivant les conditions cela correspond à 165-170W. Ensuite, sur la carte de référence, et potentiellement sur certaines cartes personnalisées mais pas sur toutes, une gestion avancée de la ventilation est exploitée. Il ne s'agit pas d'une courbe classique qui associe une vitesse de ventilation à chaque niveau de température GPU, mais d'un contrôle plus évolué qui fonctionne de la sorte dès qu'une charge 3D est lancée :

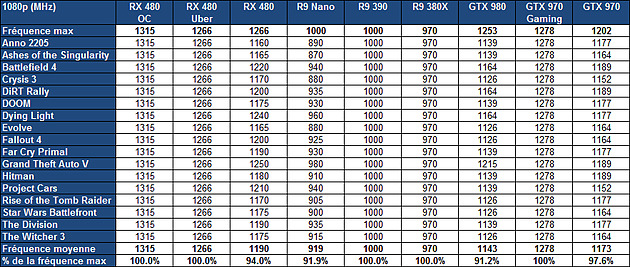

Cette approche permet à AMD de normaliser les nuisances sonores qui seront les mêmes sur toutes les cartes. Il pourra y avoir d'une part une petite différence de fréquence stabilisée suite à la limite de consommation et d'autre part une différence au niveau de la température GPU suite à la limite de ventilation. WattManPour accompagner la sortie de la Radeon RX 480, AMD a intégré un nouvel utilitaire d'overclocking dans les Radeon Settings. Dénommé WattMan, il est des plus complets !  WattMan est composé de 4 volets. Le premier est un système de monitoring de l'activité GPU, de la fréquence GPU, de la fréquence mémoire, de la température GPU et de la vitesse du ventilateur. Le second s'attaque à l'overclocking du GPU qui peut se faire via plusieurs techniques. La plus simple proposée par défaut consiste à appliquer un offset en % sur tous les p-states, la fréquence étant arrondie par pas de 5 MHz. La seconde possibilité est de paramétrer manuellement la fréquence liée à chaque p-state. Par exemple, appliquer +50 MHz à tous les p-states revient au même que l'overclocking sur les Radeon précédentes. Il faut cependant noter que si une limite de consommation est atteinte, la fréquence GPU pourra varier finement entre les fréquences définies par 2 p-states. Il est également possible de n'appliquer l'overclocking qu'au dernier p-state pour faciliter sa validation ou d'essayer de déterminer la fréquence maximale pour chacun. Ce second panneau, propose par ailleurs de modifier la tension GPU de chaque p-state. Il n'est cependant pas possible de l'augmenter au-delà des 1.15V du dernier p-state. Le troisième panneau passe cette fois à l'overclocking de la mémoire ainsi qu'à la modification de sa tension, une option qui n'était cependant pas fonctionnelle lors de nos essais. Enfin, le dernier panneau permet de prendre le contrôle sur Powertune et l'algorithme de gestion de la fréquence GPU par rapport à différent paramètres. Le premier est la limite de consommation qui peut être relevée de 50 %. Il est également possible de modifier les paramètres qui régissent la vitesse de ventilation avec une vitesse minimale (qui n'est jamais appliquée telle quelle d'après nos observations mais est utilisée dans le formule qui régit la vitesse d'accélération) et maximale. En pratique, pour overclocker à partir de la carte de référence nous vous conseillons de pousser la limite de consommation et d'augmenter la vitesse minimale de ventilation de 1040 à 1500 ou 2000 RPM et la vitesse maximale aussi haut que possible. De cette manière le GPU ne sera pas limité. Une fois l'overclocking validé vous pourrez baisser la vitesse de ventilation pour trouver un compromis adapté au niveau des nuisances. Nous vous conseillons de ne pas toucher aux limites de températures, cela n'a pas de réel impact bénéfique. A noter que si vous voulez appliquer un overclocking personnalisé par p-state, après avoir relevé la limite de consommation, nous vous conseillons d'utiliser la modification de la tension pour simuler chaque p-state à partir du dernier. Notez les résultats obtenus et paramétrez ensuite tous les p-states. L'overclocking de notre RX 480De base, notre RX 480 fournie par AMD voit sa fréquence GPU moyenne osciller entre 1160 et 1250 MHz suivant les jeux et la charge qu'ils représentent au niveau du GPU. En terme de fréquence, la RX 480 de référence est purement limitée par la consommation du GPU, sa température n'a pas d'influence par exemple dans des conditions normales d'utilisation. Si nous la passons en mode 'Uber', soit en poussant sa limite de consommation au maximum (elle monte alors à 172W dans Battlefield 4 et 192W dans The Witcher 3 par exemple), elle se maintient en permanence à sa fréquence maximale de 1266 MHz, au prix de nuisances sonores qui peuvent être très élevées. Par-dessus ce mode 'Uber', nous avons pu appliquer un maigre overclocking GPU de 4% via Wattman, ce qui pousse la fréquence à 1315 MHz. Dès 1330 MHz certains jeux plantent. Nous avons eu plus de chance avec la mémoire qui a accepté de passer à 2200 MHz, un gain de 10%. Nous avons également joué de l'overclocking sur les deux cartes du commerce en notre possession. La carte de marque Sapphire, cadencée de base aux fréquences de référence, a accepté un overclocking GPU de +5%, soit 1330 MHz. La carte XFX, qui reçoit un overclocking d'usine anecdotique avec un GPU poussé de 1266 à 1288 MHz, a de son côté accepté un overclocking GPU de +3%, soit 1325 MHz. Nous avons également pu pousser la mémoire à 2200 MHz sur ces deux cartes. Voici ce que cela donne en termes de performances sur la carte fournie par AMD, tout d'abord dans Fire Strike : [ OC - Fire Strike ] [ OC - Fire Strike Extreme ] [ OC - Fire Strike Ultra ] Ensuite sur l'ensemble de notre protocole : [ Performances (%) ] [ Performances (fps) ] Une fois sa limite de consommation relevée, la RX 480 gagne en moyenne 4.5% auxquelles s'ajoutent 6% après overclocking. Fréquences en pratiqueComme à notre habitude, nous avons relevé les fréquences moyennes approximatives maintenues en pratique dans les différents jeux testés :  Tout comme la Radeon R9 Nano, la Raxeon RX 480 est limitée en fréquence par son enveloppe thermique ASIC de 110W dans tous les jeux testés. Sur notre panel de test elle affiche une fréquence moyenne équivalente à 94% de sa fréquence maximale. C'est similaire au comportement des GeForce GTX mais différent des Radeon R9 300 qui disposaient d'une large enveloppe thermique très large de manière à pouvoir maintenir leur fréquence maximale dans la plupart des cas. Entre les promesses d'AMD pour ses Radeon de la génération Polaris, l'envie de revoir les GPU Nvidia bousculés dans tous les domaines et nos résultats et autres observations, il est difficile de ne pas pousser un soupir de dépit à l'heure d'écrire cette conclusion, même si heureusement tout n'est pas négatif. Le fait est que nous attendions plus et mieux de la part d'AMD. Point d'orgue de la campagne de communication lancée depuis janvier, l'efficacité énergétique n'est pas au niveau attendu et de toute évidence le 14nm de Samsung et GlobalFoundries n'a pas fait de miracle. Certes elle progresse par rapport à d'anciennes Radeon très peu performantes sur ce point, mais une carte telle que la Radeon Nano reste supérieure. Si cela permet à la RX 480 de se rapprocher des GeForce Maxwell dans certains jeux, dans d'autres elle reste nettement en retrait, probablement pénalisée par une interface mémoire gourmande. Et que dire de la comparaison face à la nouvelle architecture Pascal de Nvidia qui se montre plus de deux fois plus efficace ? Alors bien entendu, l'efficacité énergétique n'est pas le point le plus important pour la majorité des joueurs, c'est surtout AMD lui-même qui l'a placée au centre du débat. Au fond cela ne nous pose pas réellement de problème qu'AMD ait décidé de pousser le plus loin possible son GPU Polaris 10 et sa consommation. Mais dans ce cas il faut l'assumer jusqu'au bout et prévoir le design de la carte graphique en conséquence. Ce n'est pas le cas du modèle de référence qui essaye tant bien que mal de trouver un difficile compromis entre consommation et performances.  Il pèche sur le plan des nuisances sonores un peu trop élevées à notre goût mais surtout sur le plan de sa source d'alimentation sous-dimensionnée du côté du connecteur externe qui soulève quelques inquiétudes face aux problèmes que cela pourrait poser sur certaines cartes-mères, que ce soit en termes de fiabilité à court ou long terme ou d'interférences sur les circuits audio. Il est sidérant qu'AMD ait décidé d'ignorer à ce point les spécifications PCI Express sur un produit qui vise un très large public ainsi que des intégrateurs. Le tableau que nous vous peignons est loin d'être idyllique, mais tout n'est bien entendu pas négatif et ce nouveau GPU Polaris 10 est sans aucun doute une mise à jour technologique aussi utile que nécessaire pour AMD. Toute la connectique a pu être mise à jour pour proposer le support du HDMI 2.0b avec HDCP 2.2 ainsi que les futurs DisplayPort 1.3 / 1.4, et même si son efficacité énergétique ne fait pas le bond attendu, elle progresse suffisamment pour autoriser des designs compacts et/ou qui vont réduire les nuisances par rapport à la génération précédente. Il n'y a pas de révolution en termes de performances, mais c'était attendu, AMD n'a jamais voulu viser le haut de gamme. La fréquence ne progresse que légèrement (l'écart à ce niveau avec Nvidia devient une source d'inquiétude légitime) mais le tout mis ensemble avec les petites améliorations de l'architecture et les quelques unités de plus permet d'obtenir un gain de près de 40% sur le GPU Tonga de la R9 380X que ce Polaris 10 vient remplacer avantageusement en se frottant aux GPU supérieurs. De quoi afficher des performances du même ordre qu'une GTX 970 ou qu'une R9 290 avec un tarif de lancement relativement agressif de 260, même si AMD a la malchance de tomber en période de soldes avec à des tarifs similaires des cartes en fin de vie comme des GTX 970 avec "seulement" 4 Go de mémoire (dont 3.5 rapides) ou des R9 380 8 Go à la consommation nettement plus importante. Un positionnement tarifaire utile pour faciliter la démocratisation des systèmes VR Ready même si à ce niveau cela intéressera avant tout les intégrateurs à la recherche de cette certification. En pratique ces cartes correspondent au niveau de performances minimal recommandé par HTC et Oculus, or si la VR vous intéresse réellement un niveau de performances plus élevé est plus réaliste pour le contenu à venir.  Comme vous l'aurez compris, à moins d'être pressés et d'avoir totalement confiance dans votre carte-mère, nous ne pouvons pas vous conseiller de sauter sur les premières Radeon RX 480 de référence. C'est d'autant plus regrettable qu'AMD a fait en sorte de disposer de stocks conséquents au lancement. Mais la raison impose de patienter quelques semaines de plus. Les cartes personnalisées des partenaires d'AMD devraient proposer une meilleure prestation sur le plan thermique tout en évitant, nous l'espérons, de sortir autant du cadre des spécifications PCI Express de manière à garantir une fiabilité sans faille sur tous les systèmes, même avec overclocking. Aucun d'entre eux n'a cependant pu nous confirmer à l'heure actuelle que ses designs personnalisés passeraient bien à ce nécessaire connecteur d'alimentation 8 broches. Nous ne pouvons qu'insister une fois de plus pour que vous soyez attentifs à ce point. Des modèles 4 Go au tarif encore plus intéressants devraient également profiter d'une réelle disponibilité d'ici quelques semaines, une stratégie étrange puisque c'est bien cette version 4 Go et surtout son prix qui ont été mis en avant il y a peu lors du Computex. En termes d'overclocking, la marge est faible au niveau du GPU mais des designs plus musclés pourront éviter les limites de l'enveloppe thermique de la carte de référence qui tirent les performances vers le bas. Notons au sujet de l'overclocking l'intégration par AMD d'un excellent outil dans ses pilotes, Wattman, très complet mais actuellement spécifique à la RX 480. Face à des pilotes aussi austères que lents et désagréables à l'usage, il est grand temps que Nvidia réagisse et, une fois n'est pas coutume, rattrape le très bon travail fait par AMD à ce niveau. Par ailleurs, Nvidia n'a pas manqué l'opportunité de nous informer juste avant ce lancement de l'arrivée prochaine de la GeForce GTX 1060. C'est de bonne guerre et c'est une seconde raison de patienter même s'il est probable qu'elle vise un cran au-dessus tant en termes de performances que de tarification. Enfin terminons par un petit mot sur les autres Radeon attendues. Très rapidement, la Radeon RX 470 devrait être lancée avec une configuration quelque peu différente du GPU qui pourrait pousser l'efficacité énergétique vers le haut notamment parce que toutes les techniques de réduction de la tension supportées par Polaris n'ont pas été activées sur la RX 480. Il est d'ailleurs dommage que des impératifs en terme de calendrier aient empêchés AMD de présenter directement Polaris sous un meilleur jour avec cette RX 470 et des RX 480 personnalisées. Plus tard, c'est évidemment la génération Vega qui est très attendue. Et pour rassurer les fans de la marque face au niveau de performances visé par Polaris 10, qui pourrait en décevoir certains, AMD vient d'ailleurs de communiquer de manière inédite en indiquant avoir célébré la finalisation de Vega 10. Une puce cette fois haut de gamme qui serait donc sur la bonne voie ! Copyright © 1997-2026 HardWare.fr. Tous droits réservés. |