| |

| Nvidia Tegra K1 et son GPU Kepler : les details Smartphones / Tablettes Publié le Lundi 6 Janvier 2014 par Damien Triolet URL: /focus/94/.html Enfin, après plusieurs générations de SoC basés sur un GPU à l'architecture vieillissante, Nvidia intègre un GPU digne de ce nom. Exit le GeForce ULP et place à Kepler pour le futur Tegra K1 ! Le Tegra K1 v1 Il a souvent été fait référence au nouveau SoC de Nvidia, nom de code Logan, en tant que Tegra 5, succession logique au Tegra 4. Nvidia a cependant décidé que la rupture d'architecture qui l'accompagne devait se refléter dans le nom du produit qui sera ainsi officiellement connu en tant que Tegra K1, en référence à l'architecture de son GPU Kepler, l'élément central de ce SoC.

Le Tegra K1 v2 Un second Tegra K1 est également en préparation, identique à l'exception des cores CPU. Il s'agit cette fois de 2 cores Denver en lieu et place de la configuration 4+1 en Cortex-A15.  Pour rappel, Denver est le premier core ARMv8 64-bit développé en interne par Nvidia, qui promet pour celui-ci des performances de premier plan tant en single thread qu'en multi thread. Pour y parvenir, Nvidia a conçu un core relativement large, capable d'alimenter les unités d'exécutions jusqu'à hauteur de 7 opérations par cycle contre 3 pour un Cortex-A15. Chaque core profite également de caches L1 revus à la hausse, 128 Ko pour le L1D et 64 Ko pour le L1I contre 32 et 32 Ko le Cortex-A15 tel qu'il est configuré dans Tegra 4. Pour ces "gros" cores ARM 64-bit, Nvidia n'a pas négligé la fréquence puisqu'il est prévu qu'elle atteigne 2.5 GHz. Il semble évident que ces 2 cores Denver seront préférables aux 4 cores Cortex-A15 sur le plan des performances. Restera à voir s'il en est de même sur le plan de la consommation.

Cortex-A15 r3 et 28nm HPM Pour le Tegra K1 v1, Nvidia reprend les cores Cortex-A15 de Tegra 4, mais ils passent de la version r2p1 à la révision r3p3, plus récente. Il n'y a pas de réelle différence en termes de performances, principalement des corrections de bugs mineures. Le changement le plus notable est l'introduction de plus de flexibilité au niveau du clock gating, l'une des techniques qui permettent d'économiser de l'énergie, dans ce cas en stoppant la distribution de signal d'horloge. Cette flexibilité supplémentaire permet par exemple d'appliquer le clock gating par petites zones, de quoi pouvoir en profiter dans plus de cas.

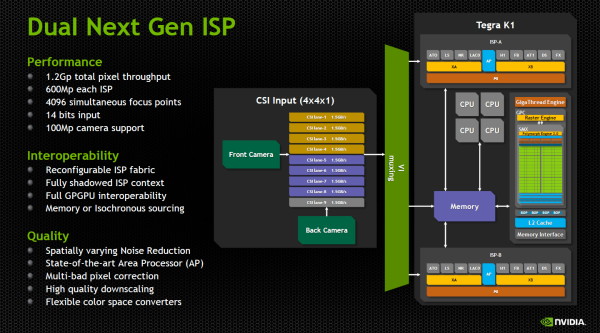

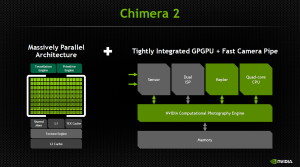

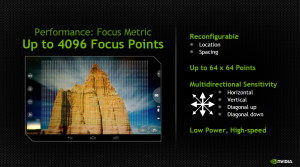

Double processeur d'image boosté Le processeur d'images de Tegra K1 a été mis à jour lui aussi. Il supporte toujours la Chimera Computational Photography Architecture, un ensemble d'API qui permet d'exploiter le GPU, le CPU et l'ISP (Image Signal Processor) main dans la main pour améliorer l'aspect prise de vue, que ce soit pour des photos ou des vidéos. Le GPU plus évolué et plus puissant lui ouvre de nouvelles possibilités.

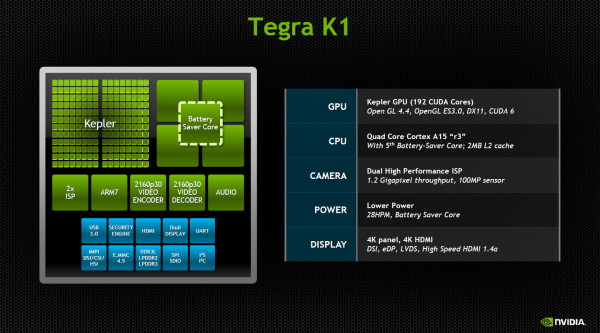

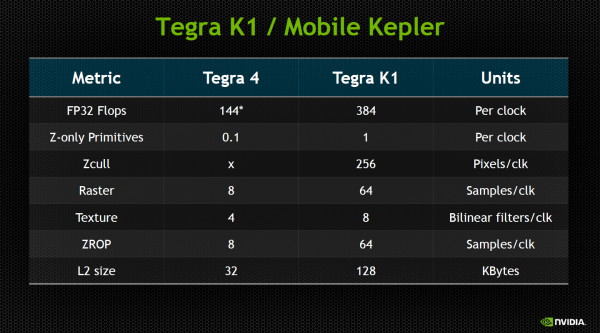

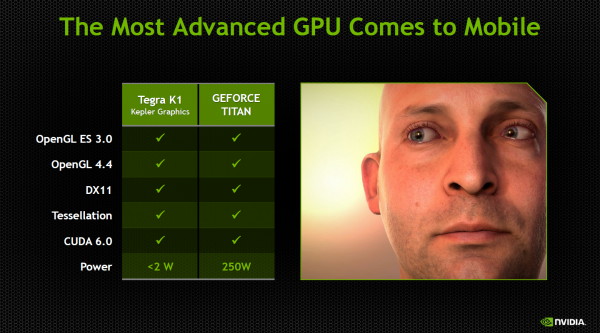

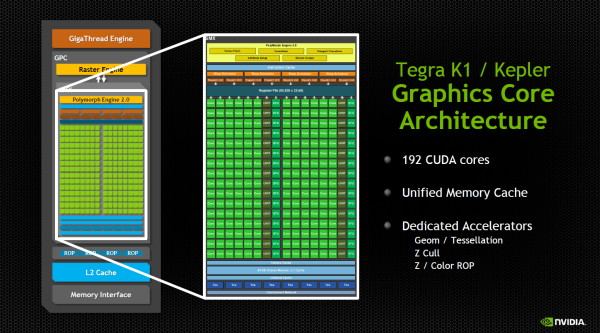

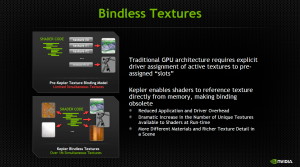

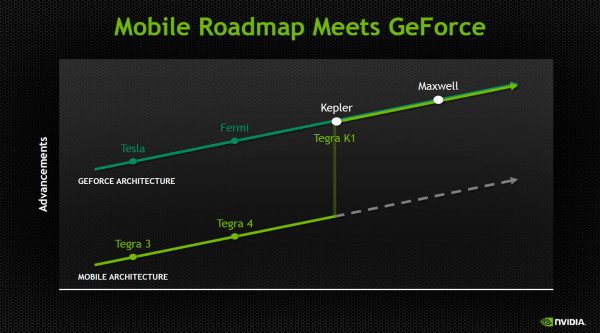

Un GPU Kepler, un vrai ! Par rapport aux GPU des précédents SoC Tegra, nous avons toujours eu l'impression que Nvidia se contentait du strict minimum, tablant d'une part sur l'image positive de la marque GeForce pour faire illusion d'une suprématie technique dans le monde des GPU ultra mobiles, et d'autre part sur son expertise sur le plan logiciel pour rester compétitif en termes de performances.  Nvidia a probablement essayé de tirer sur la corde aussi longtemps que possible pour pouvoir se contenter de cette architecture GPU en attendant qu'exploiter sa technologie GPU classique devienne réaliste dans le monde ultra mobile. Enfin, à mi-chemin durant le développement de l'architecture Kepler, soit il y a +/- 3 ans, Nvidia a décidé que le moment était venu d'opérer cette transition. D'après les estimations de ses ingénieurs et de différentes simulations, porter Kepler dans l'ultra mobile était possible. Notez que Nvidia parle de Kepler "discrete" (GPU classique) et de Kepler "mobile" (SoC). Nvidia a alors tout misé sur Kepler et stoppé le développement des GeForce ULP. Un risque, mais qui était calculé. Mais s'agit-il vraiment du vrai Kepler ou d'une version au rabais ? Avec le GPU GK208 (GeForce GT 630, GT 740M), Nvidia a revu à la baisse les spécifications des blocs fondamentaux de Kepler, les SMX. Ainsi les 2 SMX du GK208 se contentent de 8 unités de texturing chacun, contre 16 pour les autres GPU Kepler. Nous estimions alors probable que Nvidia passe à 4 unités de texturing pour Kepler mobile, car celles-ci peuvent être très gourmandes, et simplifie d'autres aspects de l'architecture.  Lorsque nous avons eu l'opportunité de rencontrer les architectes de Logan, et donc du GPU Kepler mobile (GK20A), nous avons déroulés bon nombre de questions qui partaient du principe qu'il y aurait des différences. A notre grande surprise, il s'est cependant avéré que Kepler mobile dans Tegra K1 est composé d'un SMX identique à l'un de ceux du GK208. Nvidia n'a revu à la baisse aucune de ses capacités, que ce soit sur le plan du texturing ou du calcul. Le Tegra K1 intègre ainsi un SMX qui est capable, par cycle, de : 192 opérations FMA 32-bit 8 opérations FMA 64-bit 32 opérations spéciales 32-bit 8 filtrages bilinéaires FP16 32 loads/stores Ce SMX est accompagné de 4 ROP pour l'écriture des pixels en mémoire, dont les capacités sont également identiques à celles des autres GPU Kepler. Un nombre de ROP qui correspond au nombre de pixels qu'est capable de débiter le SMX à chaque cycle. Ce dernier a par ailleurs un débit de 0.5 triangle par cycle (1 par cycle en Z only). Point important à noter, étant donné que le GPU Kepler n'est constitué que d'un seul SMX, Nvidia n'a pas la possibilité d'en proposer une version lowcost comme c'est le cas pour le GeForce ULP du Tegra 4i puisque l'architecture est déjà à son niveau minimum.

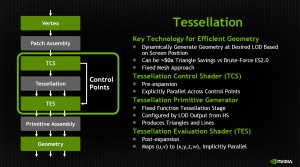

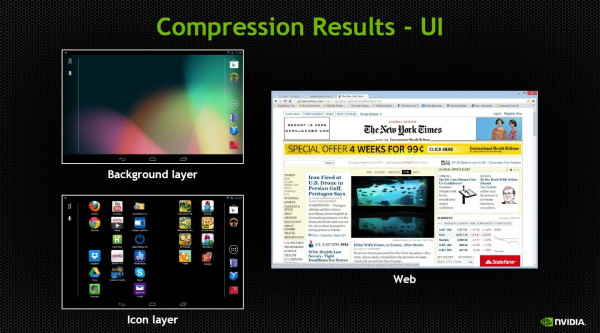

Mais comment cela peut-il passer en moins de 2W ? Nvidia annonce une consommation inférieure à 2W pour Kepler mobile. Comment cela est-il possible ? Jonah Alben, SVP GPU Engineering, nous explique qu'il est en fait "presque" très simple d'y parvenir, en partant de l'exemple du GPU GK208 de la GeForce GT 740M :  Si faire passer Kepler sous la barre des 2W est plutôt remarquable, cela reste malgré tout un niveau de consommation élevé pour un SoC destiné au monde ultra mobile. Il est donc important de faire en sorte de rester autant que possible à une consommation inférieure. Nvidia compte pour cela sur plusieurs choses, à commencer par sa longue expérience qui lui permet d'atteindre un niveau d'efficacité très élevé et donc de ne gaspiller que très peu de ressources. Les pilotes jouent pour cela un rôle important, mais quelques subtilités architecturelles sont également importantes. C'est le cas de tous les systèmes d'éjections des pixels masqués ou encore du mode 3DPFM qui permet de passer outre les unités de calcul principales quand aucune opération n'est nécessaire. Nvidia insiste ensuite sur toute la partie compression de données. C'est le cas tout d'abord de la tessellation, qui peut être exploitée dans ce sens en utilisant une géométrie de base simplifiée pour réduire les transferts de données, gourmands en énergie. Ensuite, Nvidia a intégré le support du format de textures compressées ASTC. Celui-ci est a été finalisé trop tard pour être intégré aux GPU Kepler classiques, mais a pu prendre part à Kepler mobile.  [ Sans compression ] [ Avec compression ]

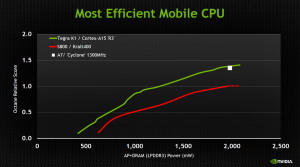

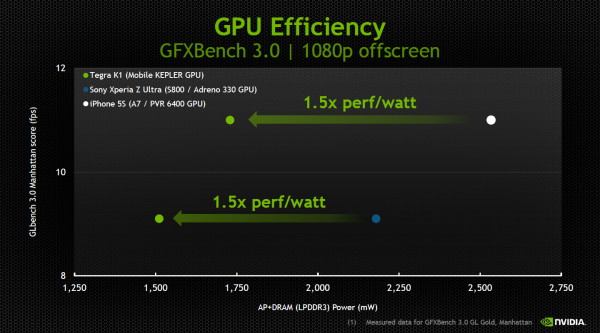

Tout cela permet selon Nvidia d'afficher des performances par watt 50% supérieures à celles des SoC A7 et S800 d'Apple et Qualcomm. Attention cependant, Nvidia limite ici fréquence et tension pour s'aligner sur les performances de ces derniers. A pleine vitesse, cet avantage sera en toute logique moindre.

192 cores pour surpasser les consoles "old gen" ? S'il y a bien un point litigieux dans le monde des GPU, c'est l'utilisation du mot cœur ou core. Depuis les GeForce 8800, Nvidia a décidé de compter comme "core" chaque ligne d'une unité vectorielle. De quoi sortir de gros chiffres pour s'opposer au CPU et insuffler un sentiment de puissance aux néophytes. Cette notion de core a fini par prendre des proportions ridicules dans certains cas et le Tegra K1 n'échappe pas à cette règle. 365 GFlops pour Tegra K1 sur base de la prévision d'un GPU cadencé à 950 MHz.

Le support développeur Tout comme pour ses GPU classiques, l'un des points forts de Nvidia est son support logiciel que ce soit à travers les pilotes ou les outils proposés aux développeurs. Kepler oblige, les pilotes sont déjà optimisés et beaucoup de développeurs de jeux vidéo sont déjà habitués à cette architecture. Qu'il s'agisse d'un portage de jeu PC d'il y a quelques années ou d'un jeu récent adapté au monde ultra mobile, Nvidia compte en tirer un avantage compétitif.  Epic, généralement proche de Nvidia, propose déjà une version fonctionnelle de l'UE4 pour Tegra K1 et le résultat est plutôt réussi même si nous avons l'impression que certaines démos font appel à beaucoup de précalcul au niveau de l'éclairage, ce qui n'est pas spécialement adapté à des environnements de jeux plus dynamiques. Reste que pour que Tegra K1 soit exploité au niveau de son plein potentiel par un maximum de jeux, il faudra qu'il représente des parts de marché significatives. Et pour cela Nvidia va devoir convaincre un maximum de partenaires de lui faire confiance. Si Nvidia semble sur le papier, enfin disposer d'un SoC à la hauteur des attentes que l'on peut avoir d'un spécialiste du GPU, il lui reste à confirmer dans la pratique cette impression positive, à démontrer que la consommation est réellement bien maîtrisée et à éviter tout retard. La concurrence n'est pas très loin et Qualcomm, avec le Snapdragon S805 par exemple, dispose également d'une solution intéressante sur le papier.  A noter qu'en attendant l'arrivée de plus de produits en Tegra K1, il est probable que la tablette Tegra Note proposée par Nvidia ainsi que la console Shield soient mises à jour, peut-être cet hiver ou au début du printemps.

Une orientation nouvelle pour le développement des GPU Nvidia ? Kepler est la première architecture de Nvidia pensée autant pour les GPU classiques qu'ultra mobiles. Développer une seule architecture unifiée permet à Nvidia d'utiliser ses ressources plus efficacement tant au niveau hardware que software. Comme nous l'avons dit plus haut, le choix de passer à Kepler pour un futur SoC Tegra a été fait en plein milieu du développement de cette architecture.  Est-ce que cette unification des architectures ne va pas limiter les GPU plus haut de gamme ? Il y aura des compromis à faire, ou plutôt il y a eu des compromis de faits, ce que ne nie pas Emmett Kilgariff, l'ancien responsable de l'architecture de 3dfx qui est actuellement l'un des architectes principaux des GPU Nvidia et qui était en charge de Kepler mobile. Il ajoute cependant que la 3D temps réel a toujours été une histoire de compromis et que la plupart des décisions faites en faveur d'une meilleure efficacité énergétique profitent également au final aux plus gros GPU qui sont limités par leur consommation. Copyright © 1997-2026 HardWare.fr. Tous droits réservés. |