| |

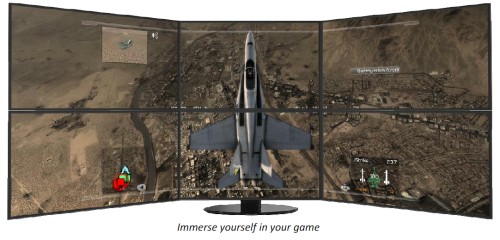

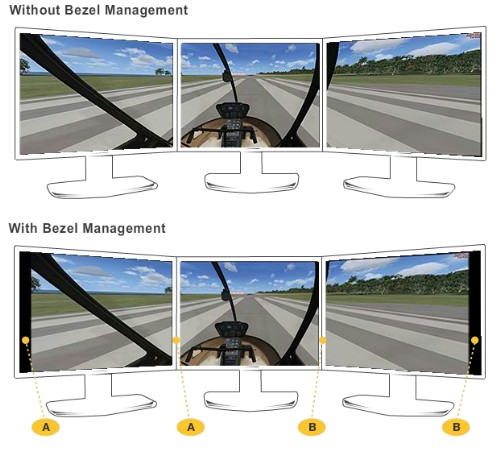

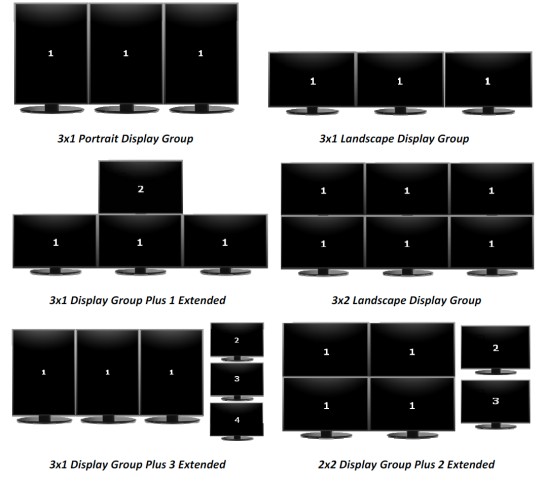

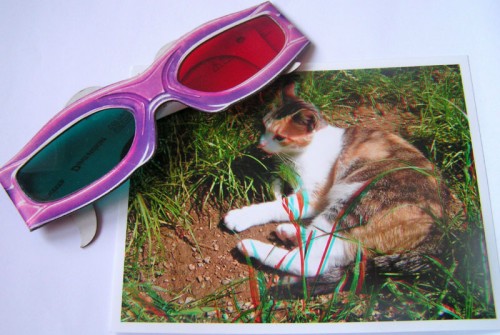

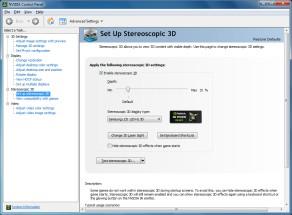

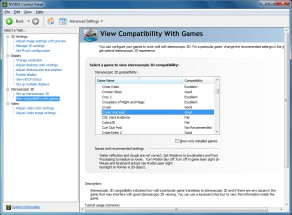

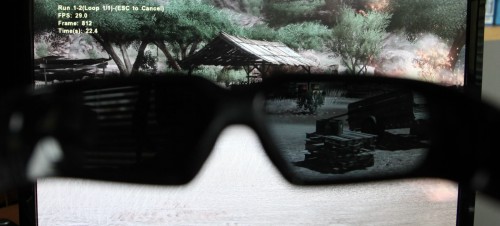

| L'immersion dans les jeux avec 3D Vision et Eyefinity Cartes Graphiques Publié le Mardi 1er Décembre 2009 par Damien Triolet URL: /articles/776-1/immersion-jeux-avec-3d-vision-eyefinity.html Page 1 - Introduction Avec Eyefinity et 3D Vision, AMD et Nvidia essayent d'améliorer l'expérience de jeu, d'un côté en augmentant le champ de vision et de l'autre en renforçant la sensation de 3D. Après de nombreuses heures de jeu, nous vous donnons notre avis sur ces technologies qui demandent l'investissement dans un équipement spécifique. Surround gaming  La technique du surround gaming n'est pas nouvelle : placer plusieurs écrans côte à côte, horizontalement, permet d'augmenter le champ de vision de manière à se rapprocher de notre vision naturelle. Elle est cependant restée difficile à mettre en place pour les joueurs puisque les cartes graphiques grand public étaient jusqu'il y a peu limitées à 2 sorties indépendante. Jouer avec 2 écrans, en dehors de quelques cas très particuliers, n'est pas réellement agréable puisque la séparation entre les moniteurs va se retrouver en plein milieu du champ de vision, soit là où notre regard se pose la plupart du temps. Un nombre impair d'écrans est donc conseillé. L'arrivée chez AMD d'Eyefinity avec les Radeon HD 5000 qui supportent jusqu'à 6 sorties indépendantes fait disparaître ce problème. Stéréoscopie  Là aussi il ne s'agit pas d'une technique nouvelle et nombreux sont ceux qui se sont essayés à apporter la stéréoscopie dans les jeux vidéos. Cette technique est destinée à apporter à notre cerveau une meilleure information sur l'espace tridimensionnel des jeux ou des vidéos en simulant la disparité binoculaire. Autrement dit, il s'agit d'apporter à chaque il une image dédiée, qui corresponde à leur angle de vue légèrement différent sur la scène, le cerveau se chargeant de les combiner pour nous donner une information plus complète sur ce que nous voyons. Bien entendu permettre à chaque il de voir une image différente est complexe à mettre en place. Cela demande un système d'affichage adapté en général associé à des lunettes, la complexité du système pouvant être intégrée plutôt dans l'écran ou le système de projection ou plutôt dans les lunettes suivant le marché visé. Nvidia supporte depuis quelques années déjà la stéréoscopie, via un pilote spécifique, suite à l'intégration d'une équipe d'ingénieurs russes spécialisés dans le domaine. Les implémentations faites par certains partenaires étaient basées sur des lunettes à obturation, une technique qui consiste à afficher successivement les images de l'il gauche et droit sur l'écran en masquant la vue de l'autre il. Elle est cependant quelque peu passée dans l'oubli avec l'arrivée des écrans LCD limités à 60 Hz, soit à l'affichage de 60 images par seconde ou seulement 30 par il, ce qui est insuffisant. Avec l'arrivée de moniteurs et de projecteurs capables d'afficher jusqu'à 120 images par seconde, Nvidia a décidé de la remettre au goût du jour en la rebaptisant 3D Vision. Page 2 - Surround gaming Surround gaming  Le multi-écran est avant tout réservé à une utilisation bureautique pour laquelle il apporte une surface de travail étendue qui s'avère vite très pratique voire indispensable. Une utilisation vidéo ludique en a été faite dans une poignée de jeux qui permettaient de gérer explicitement ce type de configuration soit en utilisant le ou les moniteurs supplémentaire pour afficher une vue différente sur la scène soit pour y placer certains éléments de contrôle. C'est Matrox, en 2002, qui a commencé à essayer d'introduire plus de multi-moniteur pour les joueurs avec le lancement du GPU Parhelia. Un flop total qui a anéanti toute possibilité pour le fabricant canadien de revenir dans la course avec ATI et Nvidia, mais l'idée de base est restée. Le GPU Parhelia a introduit le surround gaming avec sa fonction TripleHead qui permettait de piloter 3 écrans, mais d'une manière spécifique : ceux-ci étaient utilisés conjointement pour former une seule et unique grande surface d'affichage et non plus des zones indépendantes. L'intérêt était alors de simplifier la gestion de plus de 2 écrans et de résoudre le problème de l'absence de support du multi-écran dans les jeux. Ce rendu qui élargit le champ de vision permet également, via une image continue, d'amener une vision périphérique qui se rapproche de ce que nous voyons dans la réalité. Le positionnement et la nature de nos yeux font que notre champ de vision horizontal est très large, de 180 à 220° selon les individus. Bien entendu, notre capacité de discernement (caractères, relief, couleurs, mouvements ) est variable dans ce champ de vision et se réduit aux extrémités. Aussi limitée qu'elle soit, cette vision périphérique nous permet de mieux apprécier notre environnement. Dans un jeu c'est exactement le même principe, cela facilite l'immersion et renforce la sensation de mouvement.  Conscient de l'échec du Parhelia, Matrox a dérivé le TripleHead en périphérique externe compatible avec d'autres cartes graphiques, ATI et Nvidia : le TripleHead2Go. Le principe est simple : simuler un écran très large à votre carte graphique et servir d'interface entre celle-ci et les moniteurs. Etant donné que le système se connecte à une seule sortie de votre carte graphique il sera bien entendu limité en résolution totale : 3x 1280x1024 ou 3x 1680x1050 suivant les modèles. Le problème, surtout à l'époque de sortie de ce produit, était le support dans les jeux qui commençaient tout juste à s'adapter aux écrans 16/10 et 16/9 et à utiliser des champs de vision (FoV, Field of View) adaptés au format d'affichage. En surround gaming, nous sommes en 4/1 (avec 3 moniteurs 4/3) ou en 24/5 (avec 3 moniteurs 16/10), des FoV pas toujours prévus par les développeurs ou disponibles seulement via des manipulations dans les fichiers de configuration des jeux. Cela a donc demandé un effort logiciel important à Matrox qui a dû mettre au point un outil chargé d'aider les joueurs à profiter du surround gaming dans un maximum de titres.  Le fabricant a également corrigé un problème courant de ce genre de configuration d'affichage : le décalage qui apparait au niveau de la séparation entre les différents moniteurs. La carte graphique calcule une seule image continue, hors elle est coupée en 3 morceaux chacun affichés sur un écran, avec leurs bordures qui s'intercalent. Le Bezel Management permet de corriger ce problème en coupant les morceaux de l'image qui seraient affichés à la place du cadre de l'écran, soit en calculant une image dans une résolution légèrement supérieure, soit en ajoutant des bandes noires aux extrémités, solution retenue par Matrox. Page 3 - Eyefinity EyefinityAvec Eyefinity, AMD a simplement intégré le concept du TripleHead2Go dans ses GPUs Radeon HD 5000 avec l'apparition d'un mode Single Large Surface. Comme son nom l'indique, il permet de combiner entre eux plusieurs écrans pour former une seule et unique large surface.  Cypress et Juniper, les deux GPUs qui équipent actuellement les nouvelles Radeon, sont capables de piloter jusqu'à 6 écrans qui peuvent donc être associés tous ensemble ou en un sous-groupe. Cependant, les cartes actuelles sont limitées à 3 moniteurs pour la raison principale qui est que seuls 2 des 6 pipelines d'affichage peuvent utiliser la connectique DVI ou HDMI, les autres devant utiliser exclusivement le DisplayPort malheureusement toujours peu répandu.  Du coup, les Radeon HD 5000 disponibles à ce jour proposent toutes 2 sorties DVI Dual-Link, une sortie HDMI et une sortie DisplayPort. Parmi les sorties DVI et HDMI, seules 2 peuvent donc être utilisées simultanément et pour utiliser un troisième moniteur, celui-ci devra impérativement gérer nativement le DisplayPort, sans quoi il faudra passer par un adaptateur actif hors de prix. Notez que la Radeon HD 5970 affiche une connectique légèrement différente avec 2 sorties DVI Dual-Link et une sortie mini-DisplayPort. AMD prévoit également la sortie, plus tard, d'une Radeon HD 5800 équipée de 6 sorties DisplayPort. Le système s'est comporté comme prévu au niveau de la connectique, à l'exception de la Radeon HD 5870 que nous a fourni AMD à son lancement et qui refuse toute connexion en HDMI, peu importe qu'un seul ou plusieurs moniteurs soient connectés. Nous avons cependant pu utiliser les 2 sorties DVI en combinaison avec la sortie DisplayPort. AMD a soigné son pilote qui propose une interface très claire pour configurer un mode SLS. Il n'est pas utile de connecter les écrans dans un ordre précis, le logiciel permet de les placer correctement très facilement. Ce mode SLS n'est actuellement pas compatible avec les solutions CrossFire mais devrait l'être sous peu puisqu'un support beta a déjà fait son apparition pour la Radeon HD 5970.  Par contre, contrairement à Matrox, AMD ne propose pas d'utilitaire de configuration des jeux, ni de correction de l'image pour compenser le décalage dû au cadre des moniteurs. Pour le premier point, AMD nous a indiqué envisager de fournir un guide de configuration pour aider les joueurs quant au second, c'est prévu et cela arrivera avec les Catalyst de janvier ou février. Toujours par rapport à la solution de Matrox, AMD profite de la gestion native du SLS pour ne plus être limité par une seule sortie vidéo et peut donc supporter sur les produits actuels, par exemple, 3 écrans en 2560x1600 pour une résolution totale de 7680x1600 ! Malheureusement, AMD ne propose pas de résolutions surround gaming inférieures à la résolution native de l'ensemble et avec le bon ratio. Ainsi, par exemple, avec 3 écrans en 1920x1200, la seule résolution correcte proposée est le 5760x1200. Les 2 autres résolutions, 3840x1024 et 2400x600 correspondent en effet plutôt à des écrans 5/4 et 4/3. Bien entendu il est possible de corriger la déformation en modifiant le FoV manuellement, mais tous les jeux ne le permettent pas. Il serait utile qu'AMD corrige ce problème en proposant par exemple du 5040x1050 et du 3840x800. Ces résolutions extrêmes se confrontent aux limitations de Direct3D. Ainsi, par exemple, Direct3D 9 demande le support des surfaces de 4096x4096, Direct3D 10 des surfaces de 8192x8192 et Direct3D 11 de 16384x16384. Direct3D 9, grâce aux caps, permet aux GPUs d'exposer une résolution supérieure, ce qu'AMD fait avec les Radeon HD 5000 qui exposent du 16384x16384. Il est donc possible d'atteindre une telle résolution dans les jeux Direct3D 9 si les développeurs font leur travail correctement, ce qui n'est pas toujours le cas.  Direct3D 10 et 10.1, par contre, n'ont visiblement pas prévu d'exposer une résolution supérieure à 8192x8192 pour les surfaces, du coup il n'est pas possible de monter plus haut à moins d'utiliser un tweak. Jusqu'à 3 écrans en 2560x1600 ce n'est pas un souci. Par contre avec la Radeon HD 5800 équipée de 6 sorties, cela pourrait l'être avec 4 de ces écrans ou avec 5 modèles 1920x1200 ! Notez que Direct3D 11 de son côté réintroduit une caps à ce niveau qui permettra d'aller au-delà du 16384 en largeur ou en hauteur. Enfin pour être précis, ajoutons que les D3D_FEATURE_LEVEL_10_0 et 10_1 exposés via Direct3D 11 permettent également de préciser une résolution pour les surfaces. A l'heure actuelle AMD se contente cependant d'exposer 8192 comme limite. Page 4 - Stéréoscopie StéréoscopieNous sommes capables de voir en relief grâce à plusieurs facteurs : l'accommodation, la parallaxe, la perspective géométrique, la convergence et la disparité binoculaire. Les trois premiers facteurs nous permettent de voir en relief avec un seul il alors que les deux derniers profitent de nos deux yeux. Dans les jeux vidéo, la perspective géométrique est à la base du rendu 3D et nous permet d'évaluer la distance à laquelle se situent les objets de la scène. L'accommodation, soit l'adaptation de la profondeur de champ sur laquelle la vision est nette est, elle, plutôt utilisée dans les films. Elle se retrouve également dans les jeux vidéo depuis quelques temps sous forme d'un filtre de post processing. Son utilisation est cependant fixe et ne dépend pas de là où le joueur veut focaliser sa vision ce qui la rend avant tout utile dans les situations où le joueur est passif plutôt que dans celles où il est actif auquel cas elle peut même devenir un élément inconfortable dans le rendu.  La disparité binoculaire est le facteur auquel nous nous référons lorsque nous parlons de vision stéréoscopique ou vision 3D d'une manière simplifiée. Il est question de reproduire la vue distincte de chaque il pour permettre à notre cerveau de mieux apprécier le relief. La technique est applicable autant dans les situations où l'utilisateur est passif qu'actif. Dans ce dernier cas cependant elle demande un temps d'adaptation plus important, probablement parce que nous avons alors des réflexes au niveau de la convergence et de l'accommodation, lorsque notre regard se pose sur une partie de l'image, qui sont incompatibles avec la stéréoscopie sur un écran. Ce temps d'adaptation est différent selon les personnes et les méthodes employées, mais il est relativement court avec les technologies modernes. Reste selon nous un côté très frustrant de la vision en 3D : l'absence de parallaxe. Ce phénomène nous permet d'analyser la scène en prenant en compte les différences dans ce que nous voyons en bougeant les yeux ou la tête. Dans un jeu vidéo ou dans un film l'image ne changera pas, quelle que soit votre position. Nous ne pouvons pas pencher la tête pour regarder derrière un mur (au mieux nous apercevrons le câblage de l'écran) or plus nous sommes plongés dans une vision 3D plus nous avons naturellement envie de le faire. La solution ultime à ce problème est de placer les écrans directement devant les yeux. De telles solutions existent mais il manque encore un support logiciel abouti, des petits écrans en haute résolution etc. pour que nous puissions réellement nous plonger dans une réalité virtuelle. A l'heure actuelle il faut donc se contenter de l'apport de la disparité binoculaire par la stéréoscopie. De nombreuses solutions existent et reposent toutes sur une même base : la production d'une image pour l'il gauche et d'une image pour l'il droit. Elles différent au niveau de la transmission de ces images vers nos yeux. La méthode la plus simple consiste à loucher pour que notre cerveau interprète les 2 images comme étant la même vue. Certains y arrivent rapidement, d'autres finissent hypnotisés par leur PC sans avoir aperçu le moindre relief.  Toujours sans lunettes, l'alioscopie consiste à diffuser sur un même écran plusieurs points de vue d'une même image avec un jeu de lentilles pour donner une direction légèrement diffèrente à chacune. Cela permet à chaque il d'en capter une différente et donc de voir en 3D. Le problème est la résolution fortement réduite (par le nombre de points de vue différents, il en faut 4, 8 voire plus) mais également le fait que seules certaines combinaisons angle/distance affichent un résultat optimal. Une solution qui aujourd'hui est donc de très basse qualité et n'a de réel intérêt que pour attirer l'il dans un supermarché ou sur un panneau publicitaire. Restent donc les solutions à base de lunettes. Les plus connues sont les lunettes à anaglyphes rouges et cyans. Les 2 points de vue de l'image se voient appliqué un filtre de couleur et sont ensuite mélangés. Les lunettes rouge/cyan permettent de reconstituer les 2 vues. La qualité est relativement faible puisque les couleurs sont appauvries par les filtres et que les composantes rouges et bleues sont clairement visibles par endroits. En contrepartie la technique permet d'imprimer des images stéréo.  Heureusement des techniques plus évoluées existent. C'est le cas de la polarisation. Les images destinées à l'il gauche et à l'il droit sont affichées avec une polarisation différente et des lunettes équipées de filtres polarisants adaptés permettent que seule la bonne image soit visible pour chaque il. Une solution très efficace et qui a l'avantage de reposer sur des lunettes relativement simples. Par contre afficher 2 images polarisées sur un même écran est plus compliqué. Deux solutions existent actuellement. L'une, utilisée par les écrans 3D Zalman, consiste à changer la polarisation une ligne sur deux. Un entrelacement qui divise la résolution effective de moitié. L'autre solution, proposée sur les écrans iZ3D est plus complexe. Elle repose sur une double matrice LCD. En mode 3D, la matrice du fond va afficher l'addition des images gauches et droites avec une polarisation fixe. La seconde matrice va appliquer une modification de la polarisation pour contrôler la quantité de la lumière qui va arriver à chaque il. L'avantage est de ne pas réduire la résolution. Par contre la seconde matrice travaille sur des pixels complets et non sur des sous-pixels, ce qui veut dire qu'il est possible qu'un pixel pour l'il gauche soit plus clair/foncé que le même pixel pour l'il droit, mais pas d'une couleur différente. Les couleurs vont donc baver quelque peu autour des objets. Nous n'avons pas pu essayer cette technologie et donc observer à quel point ce phénomène est gênant ou pas. Les lunettes polarisées, relativement bon marché, représentent également une solution très bien adaptée au cinéma puisqu'il « suffit » alors d'utiliser un projecteur très rapide avec une alternance dans la polarisation. Par rapport au large public, le coût doublé du matériel de projection est facilement amorti. La dernière technique à base de lunette est l'obturation. Chaque verre des lunettes est en réalité une petite matrice LCD dont les éléments peuvent s'ouvrir ou se fermer pour laisser passer la lumière ou pas. L'écran va afficher successivement les images destinées à l'il gauche et à l'il droit, les lunettes se chargeant de masquer les images que chaque il ne doit pas voir. Si la succession des images gauche/droite se fait suffisamment rapidement et que l'obturation des lunettes est parfaitement synchronisée avec l'écran, nous n'y voyons que du feu et avons l'impression d'un affichage continu différent pour chaque il. La technique n'est pas nouvelle et est utilisée depuis de nombreuses années, sans jamais avoir décollé. Il faut dire également qu'au départ les lunettes à obturation étaient proposées avec un fil pour les alimenter et les synchroniser à l'écran. Une petite batterie et une synchronisation sans fil a permis de les rendre plus sympathiques. Cependant la solution a alors un coût important, incompatible avec le cinéma. Par contre elle n'a pas besoin d'une technique d'affichage spéciale, il suffit que l'écran puisse afficher un nombre élevé d'images par seconde. C'était le cas avec les écrans à tube, mais plus avec les LCD limités à 60 Hz qui ont donc poussé cette technique au repos forcé. Page 5 - 3D Vision 3D VisionAlors que les écrans LCD 120 Hz commençaient à pointer le bout de leur nez, Nvidia a décidé de sortir de l'hibernation la 3D stéréoscopique à base de lunettes à obturation et de lancer une marque pour mettre en avant cette technologie : 3D Vision. Pour cela Nvidia a mis au point et commercialisé directement sous sa propre marque un kit qui comprend des lunettes à obturation sans fil et un émetteur infrarouge qui leur permet de se synchroniser avec l'affichage.     Les lunettes proposent une autonomie de 40h selon Nvidia et se rechargent via un connecteur mini-USB. Elles sont plus volumineuses que des lunettes polarisées mais Nvidia a malgré tout fait un effort à ce niveau pour que la technologie embarquée ne soit pas trop encombrante. 3 supports différents pour le nez sont livrés dans le kit pour adapter les lunettes à un maximum de morphologies. Au niveau de l'affichage, Nvidia demande 100 Hz au minimum de manière à éviter que le clignotement des lunettes ne soit perceptible ce qui est très désagréable. Si de nombreux CRTs sont ainsi compatibles, seuls deux écrans LCD existent à l'heure actuelle, le Samsung SyncMaster 2233RZ et le Viewsonic FuHzion VX2265wm. Tous deux sont des 22'' d'une résolution de 1680x1050 qui acceptent jusqu'à 120 Hz en entrée. Différents projecteurs, avec une résolution malheureusement limitée, ainsi que des TV DLP Mitsubichi sont également compatibles. Notez que pour ces dernières un câble spécifique est nécessaire entre l'émetteur infrarouge et la TV. Malheureusement, Nvidia ne le fourni que dans les kits 3D Vision vendus aux Etats-Unis. Nous n'avons pas encore pu essayer un TV DLP, mais en pratique il faut savoir qu'elles réduisent la résolution par deux. Elles demandent en entrée une image gauche et droite combinée en damier, la moitié des pixels sont donc perdus. Elles affichent ensuite à 120 Hz, en alternance, une partie et puis l'autre du damier. Au niveau de la carte graphique, Nvidia demande une puissance au moins équivalente à celle de la GeForce 9600 GT pour les jeux vidéo mais n'importe quelle GeForce 8 et supérieures peuvent être utilisées pour regarder des photos et films en 3D. Bien entendu, 3D Vision ne s'arrête pas à la création de lunettes et à la sélection des périphériques d'affichage compatibles. La plus grosse partie du travail concerne les pilotes qui permettent de configurer le tout, mais également de rendre la solution utilisable dans les jeux. Les moteurs de rendu étant devenus plus complexes, Nvidia doit avoir recourt à plusieurs astuces pour que 3D Vision fonctionne correctement. Bien entendu à la base il s'agit de calculer 2x la même image avec un point de vue légèrement différent. Mais en pratique certains éléments de la scène 3D, qui est une accumulation de trompe-l'il, ne s'y prêtent pas. Nvidia a donc mis en place des profils 3D Vision pour un maximum de jeux, pour apporter quelques optimisations et corrections. Qui plus est, Nvidia donne pour chacun d'entre eux des conseils sur les options graphiques qui posent problème et qu'il faudra donc désactiver dans les jeux. Ils sont affichés dans le panneau de contrôlé ou un surimpression lors de leur démarrage.     Nvidia a également corrigé un défaut majeur de nombreux jeux : le positionnement du pointeur. Dans les FPS le pointeur fait en général partie du HUD et n'est donc pas réellement positionné en 3D. L'activation de 3D Vision met à jour cette supercherie et il est difficile de viser correctement. Pour régler ce problème, les pilotes permettent d'afficher un autre viseur qui sera cette fois bien positionné. Il faudra par contre désactiver le viseur normal du jeu si c'est possible. Une fois que vous disposez d'un système d'affichage adapté, l'utilisation de 3D Vision est très simple et les pilotes vous guideront dans la configuration des différents jeux. Notez que l'écran Zalman qui repose sur la polarisation fonctionne lui aussi grâce à un pilote Nvidia. Il repose sur une même technologie, mais sans la marque 3D Vision et a donc un driver dédié. Enfin, Nvidia a mis en place un mode 3D Vision Discover qui consiste à faire de la 3D stéréoscopique à base d'anaglyphes rouge/cyan. Dans ce cas le pilote applique un filtre de couleur sur chaque image avant de les combiner. Si la qualité est clairement inférieure, Discover permet, comme son nom l'indique, d'avoir un aperçu de 3D Vision sur n'importe quel écran et avec des lunettes en carton très bon marché.  Page 6 - Protocole de test Protocole de testPour ce test, AMD nous a fourni 3 écrans Dell 2408WFP, ce qui nous a permis de mettre en place un système équipé de 3 écrans 24'' en 1920x1200 pour une résolution totale de 5760x1200 ! Nous avons utilisé les pilotes 8.66.6 beta2, une Radeon HD 5870 et une Radeon HD 5850. Du côté de Nvidia, le fabricant nous a fourni un kit 3D Vision ainsi qu'un moniteur Samsung 2233RZ. D'une dimension de 22'', celui-ci est limité au 1680x1050, mais supporte les modes 100, 110 et 120 Hz en entrée. Nous avons utilisé les pilotes betas 195.39 avec une GeForce GTX 285. Nous avons également testé le mode Discover de 3D Vision. Nous avons sélectionné 10 jeux pour tester Eyefinity et 3D Vision : Crysis Warhead, Far Cry 2, ArmA 2, Batman Arkham Asylum, Resident Evil 5, Anno 1404, Flight Simulator X, H.A.W.X., Need for Speed Shift et Race Driver GRID. Vous remarquerez qu'ils ne correspondent pas exactement à notre dernier protocole de test des cartes graphiques qui a été établi dans l'optique d'une comparaison des performances alors qu'il s'agit ici de tester l'intérêt pratique en terme de gameplay d'Eyefinity et de 3D Vision, d'où les choix quelque peu différents. Au niveau des résolutions, du côté d'Eyefinity les tests ont été exécutés en 1920x1200 et en 5760x1200 alors que du côté de 3D Vision, c'est bien entendu le 1680x1050 sur lequel nous nous sommes concentrés. Nous avons à chaque fois mesuré les performances sans antialiasing et avec antialiasing 4x. Le tout avec un niveau de qualité très élevé sauf quand cela était impossible, principalement avec 3D Vision qui demande de désactiver certaines options graphiques. Configuration de testIntel Core i7 975 (HT et Turbo désactivés) Gigabyte GA-EX58-Extreme 6 Go DDR3 1333 Corsair Windows 7 64 bits Forceware 195.39 Catalyst beta 8.66.6 beta2 Page 7 - Crysis Warhead Crysis WarheadCrysis Warhead reprend le moteur graphique très gourmand à tous les niveaux de Crysis premier du nom. Nous le testons dans sa version 1.1 hotfix et en mode 64 bits puisque c'est la principale nouveauté apportée. Crytek a renommé les différents modes de qualité graphique, probablement pour ne pas heurter les joueurs déçus de ne pas pouvoir activer le mode très haute qualité pour cause de gourmandise excessive. Le mode haute qualité est ainsi renommé « Gamer » et le mode très haut qualité « Enthousiast ». Nous avons testé le premier. EyefinityIl n'y a pas d'opération particulière à effectuer dans Crysis Warhead pour profiter du surround gaming, il suffit de sélectionner une résolution adaptée.  Le surround gaming est quelque fois déconcertant dans ce jeu puisque nous avons été régulièrement tentés d'observer directement ce qu'il se passe sur les écrans latéraux. La déformation des objets sur ceux-ci ainsi, bien entendu, que l'impossibilité d'y « viser » peut faire perdre le fil de l'action. Cela dépend bien entendu des scènes et se produit plutôt sur les grand plateaux que dans les chemins étroits.  La chute des performances est conséquente, dans ce jeu qui à la base est déjà très gourmand. Il faudra donc passer par un système multi-GPU quand les pilotes seront prêts ou réduire la résolution, abaisser les détails graphiques en-dessous du mode « gamer » n'étant pas une option sur un système haut de gamme. 3D VisionPour utiliser 3D Vision dans Crysis Warhead, il faudra faire de nombreuses concessions graphiques : ombres de basse qualité, éclairage et post processing de qualité moyenne ou basse et désactiver le motion blur. Le résultat ne sera cependant toujours pas parfait et Nvidia précise que les réflexions sur l'eau ainsi que les nuages ne sont pas rendus correctement.  Les performances très faibles, divisées par 3 lors de l'activation des 2 modes de 3D Vision, ne font qu'accentuer l'expérience relativement moyenne procurée par 3D Vision dans ce jeu. Page 8 - Far Cry 2 Far Cry 2La suite de Far Cry n'en est pas réellement une puisque Crytek était à l'origine du premier épisode. La licence appartenant à Ubisoft c'est ce dernier qui s'est chargé de son développement, Crytek optant alors pour Crysis. Pas facile de reprendre l'héritage de révolution graphique qui accompagne Far Cry, mais les équipes d'Ubisoft s'en sont bien tirées même si l'aspect graphique n'est pas aussi abouti que celui de Crysis. Le jeu est aussi moins gourmand ce qui n'est pas plus mal. Il supporte DirectX 10.1 pour améliorer les performances du côté des Radeon. Nous avons installé le patch 1.02 et utilisé le mode de qualité graphique « très élevé ». EyefinityFar Cry 2 semble avoir un comportement aléatoire avec le surround gaming. Un coup le champ de vision était correct, un coup il était réduit verticalement. Un passage par le fichier de configuration pour forcer le champ de vision large a réglé le problème.  Le surround gaming est ici moins déroutant que dans Crysis.  La chute des performances est conséquente, mais nous restons à un niveau qui permet de jouer sans antialiasing avec la Radeon HD 5870, à condition de se contenter d'une fluidité imparfaite. 3D VisionDans Far Cry 2, Nvidia conseille de désactiver le bloom, de réduire les effets de post processing au niveau de qualité le plus bas et d'activer la qualité moyenne pour les ombres. L'expérience de jeu est cette fois nettement meilleure que dans Crysis Warhead.  La chute de performances est importante, bien que légèrement inférieure à un facteur 2. Vous noterez que 3D Vision Discover est légèrement plus gourmand. Page 9 - ArmA 2 ArmA 2Pour tester ArmA 2, nous effectuons un déplacement bien défini après avoir chargé une sauvegarde. Nous utilisons le niveau de détails « très élevé » du jeu en plus duquel nous poussons toutes les options avancées au niveau élevé. Le patch 1.3 est installé. ArmA 2 est particulier au niveau de la résolution puisqu'il permet de paramétrer différemment la résolution de l'interface de celle du rendu 3D qui est ramenée à hauteur de la première via un filtre. De notre côté nous utilisons une résolution de rendu identique à celle de l'affichage. EyefinityArmA 2 supporte le surround gaming nativement, mais d'une manière limitée puisqu'il ne propose qu'un FoV adapté à 3 écrans 4/3. Il est cependant possible de corriger cela pour les écrans 5/4, 16/9 et 16/10 manuellement via le fichier de configuration, ce que nous avons fait. Un autre problème se pose au lancement du jeu qui signale une erreur Direct3D 9 avec une résolution de 5760x1200 pour l'interface. Nous supposons que le jeu fait une vérification au lancement par rapport aux spécifications de base de Direct3D 9 qui se limitent à une résolution de 4096x4096 bien que le pilote graphique puisse en exposer une plus élevée, ce qui est le cas ici. Une fois dans le jeu, activer le 5760x1200 ne pose pas de problème, encore une fois probablement parce que le moteur ne fait plus cette vérification, mais il faudra à chaque fois repasser par une plus petite résolution avant de pouvoir le lancer.  Le surround gaming permet de profiter d'une vue imparable sur le champ de bataille.  Malheureusement, la gourmandise de ce jeu rend impossible de jouer dans ces conditions avec des performances presque divisées par 3. Il faudra abaisser significativement la résolution, ce qui est ici facilité par la capacité du moteur et dissocier résolution d'affichage et résolution de rendu. 3D VisionDans Arma 2, Nvidia conseille de désactiver les ombres et de réduire les effets de post processing en basse qualité. Nous avons cependant dû les désactiver complètement sans quoi un effet de bloom entraîne une gêne importante. Avec antialiasing, 3D Vision ne fonctionne pas et une seule vue est affichée. Le résultat est ici globalement plutôt mauvais.  Les performances sont divisées par 2, ce qui rend le jeu injouable dans ces conditions. Il faudra réduire la qualité graphique et/ou la résolution. Page 10 - Batman Arkham Asylum Batman Arkham AsylumDifficile d'ignorer Batman Arkham Asylum malgré le côté partisan des technologies qu'il exploite. Nous parlons ici bien entendu de GPU PhysX, une bibliothèque propriétaire au niveau de son accélération par le GPU qui ne supporte que les GeForce. Nous avons installé le patch 1.1 et utilisé le benchmark intégré avec toutes les options poussées au maximum, à l'exception des effets PhysX dans un premier temps. Notez qu'il s'agit également d'un jeu 3D Vision Ready. EyefinityBatman Arkham Asylum s'adapte automatiquement au surround gaming et donc aux résolutions proposées par Eyefinity. Tout du moins pendant le jeu. Les cinématiques rendues en temps réel utilisent un FoV différent qui n'est pas adapté automatiquement. C'est le cas de la scène de benchmark. Nous avons manuellement ajouté une commande via les fichiers de configuration pour changer le FoV depuis le jeu et pouvoir mesurer les performances.  Le surround gaming permet ici d'améliorer l'immersion, principalement lors des scènes de combats qui sont accompagnées de larges déplacements ou rotations de la caméra.  Batman étant relativement peu gourmand, il est jouable dans cette résolution extrême. Par contre nous n'avons pas pu activer l'antialiasing 4x, 1 Go de mémoire vidéo étant ici trop peu. 3D VisionNvidia conseille dans ce jeu de désactiver le motion blur. Pour un jeu 3D Vision Ready, il est étrange que cela ne soit pas fait ou conseillé directement dans le panneau de contrôle du jeu. L'expérience de jeu est ici très réussie et apporte un plus significatif. Couplé aux effets GPU PhysX, l'immersion est réellement excellente.  L'impact sur les performances est très élevé avec 3D Vision sans GPU PhysX, ce qui est logique puisque nous partons d'un niveau de fps très élevé et que 3D Vision est limité à 60 fps à cause de la synchronisation verticale. 3D Vision Discovery n'est par contre pas tenu par cette limitation, ce qui le rend plus performant. Ce mode est cependant légèrement plus gourmand comme vous pouvez le constater quand le vsync n'entre plus en jeu, comme c'est le cas quand les effets GPU PhysX sont activés. Globalement, sans les effets GPU PhysX, 3D Vision est utilisable sans aucun problème sur la GeForce GTX 285 alors qu'une fois ces effets activés, le niveau de performances devient un peu juste, même sans FSAA. Page 11 - Resident Evil 5 Resident Evil 5Second jeu certifié 3D Vision Ready, Resident Evil 5 est annoncé par Nvidia comme le meilleur titre 3D Vision du moment. Nous avons utilisé son benchmark intégré pour mesurer les performances et poussé la qualité au maximum. EyefinitySi la partie 3D du jeu s'adapte correctement au surround gaming, ce n'est pas le cas de la partie 2D et donc de certains menus et du HUD dans le jeu.  Le surround gaming semble très intéressant dans ce jeu puisque la vision périphérique permet de voir les ennemis arriver et d'avoir une bonne appréciation de la scène, même lorsque seul l'écran central est fixé attentivement. Malheureusement, naviguer dans les menus est plutôt sportif et quand bien même vous y arriverez, le HUD inutilisable est un frein important qui empêchera de profiter d'Eyefinity.  Le 5760x1200 est très gourmand et les performances sont ici réduites d'un facteur supérieur à 2. Sans que la fluidité ne soit parfaite, ce jeu est malgré tout utilisable dans cette résolution. Vous noterez par ailleurs que l'antialiasing a un coût négligeable. 3D VisionNvidia conseille dans ce jeu également de désactiver le motion blur. Pour un jeu 3D Vision Ready, il est étrange que cela ne soit pas fait ou conseillé directement dans le panneau de contrôle du jeu. Comme dans Batman Arkham Asylum, l'expérience de jeu est ici très réussie et la palette de couleurs utilisée a l'avantage de ne pas souffrir de l'activation de 3D Vision qui apporte donc un plus réellement significatif.  L'impact sur les performances est énorme et les performances sont presque divisées par 3 ! Sans antialiasing, cela passe tout juste sur la GeForce GTX 285, avec une fluidité acceptable mais pas parfaite, comme c'était également le cas avec Eyefinity. L'antialiasing a cependant un coût plus élevé ici et il faudra donc plutôt l'éviter. Page 12 - Anno 1404 Anno 1404Pour tester Anno 1404, nous effectuons un trajet bien défini sur une carte relativement lourde. Toutes les options sont poussées à leur maximum. Nous avons installé le patch 1.1. EyefinityAnno 1404 adapte correctement le FoV et support donc nativement les résolutions du surround gaming.  Au premier abord le surround gaming semble très intéressant dans un jeu de stratégie grâce à la vue élargie qu'il offre sur la scène. Malheureusement l'intérêt est très limité puisque ce mode de rendu n'est pas fait pour profiter d'une surface plus large en jeu mais pour apporter une vision périphérique. Celle-ci est inutile dans un jeu de stratégie et si la large surface peut être utilisée pour avoir une meilleure visibilité sur la scène, ce n'est pas toujours très pratique compte tenu des déformations qui apparaissent sur les côté en vraie 3D. Il en aurait bien entendu été autrement en 3D isométrique.  Le 5760x1200 est très gourmand et les performances chutent à tel point que les déplacements ne sont plus assez fluides. Avec antialiasing, la baisse est encore plus importante et entraînée par de très grosses saccades, 1 Go de mémoire étant insuffisant. 3D VisionDans Anno 1404, le plus gros problème vient de l'eau qui n'est pas rendue correctement avec 3D Vision. Par exemple les reflets ne sont pas positionnés à une profondeur correcte, ce qui donne une sensation étrange. Nvidia conseille donc de réduire la qualité de l'eau au minimum et de désactiver les réflexions. C'est mieux. Cependant 3D Vision n'est pas idéal pour ce type de jeu, d'autant plus que les joueurs y passent en général de nombreuses heures d'affilée ce qui risque de fatiguer la vue.  L'impact sur les performances est ici beaucoup plus léger que dans la majorité des autres jeux. Page 13 - Flight Simulator X Flight Simulator XDifficile de parler de surround gaming sans tester Flight Simulator X, nous l'avons donc intégré à notre suite de test pour ce dossier. Les performances sont mesurées durant une scène de vol. EyefinityFlight Simulator X permet d'utiliser le multi-écran via 2 approches différentes. La première est sa gestion native de plusieurs moniteurs. Dans ce cas, le jeu va piloter 3 écrans indépendants sur chacun desquels vous pouvez afficher la vue que vous voulez. Il ne s'agit donc pas d'une seule grande surface mais bien de 3 rendus distincts. Cela évite d'avoir une déformation très prononcée sur les côtés mais en contrepartie la charge CPU et GPU augmente. Notez qu'il faut désactiver la grande surface dans les Catalyst et activer les 3 écrans via le gestionnaire d'affichage de Windows pour que le jeu puisse les utiliser. Par défaut, Flight Simulator X ne supporte pas le surround gaming via une seule grande surface. Par contre il est possible de modifier très simplement le fichier de configuration pour l'activer.   En haut le rendu avec une surface unique de 5760x1200, en bas avec 3 rendus distincts en 1920x1200 pour lesquels nous avons utilisé des angles de vues qui nous donnent un résultat proche du premier rendu. Le surround gaming permet un rendu continu alors que les 3 écrans distincts sont plus adaptés pour tourner la tête et observer le paysage sans déformation. Dans les deux cas, l'utilisation d'un système multi moniteur permet également d'afficher plus d'informations à l'écran, le jeu permettant de configurer le HUD comme bon vous semble.  Flight Simulator X se contente d'un nombre de FPS assez faible. Avec presque 30 fps, le 5760x1200 est donc utilisable. Par contre l'affichage est trop lent avec 3 rendus en 1920x1200. Vous noterez qur pour tester cette configuration avec antliasing, nous avons dû activer cet effet via le Catalyst Control Center, le jeu ne l'activant que sur l'écran principal, même lorsqu'il était forcé via le fichier de configuration sur tous les écrans. 3D VisionMalgré de nombreux essais, nous ne sommes pas parvenus à activer 3D Vision dans ce jeu. Tant le mode complet que le mode Discovery n'affichaient qu'une seule image, avec couleurs déformées dans le second cas. Le pilote essayait donc bien d'enclencher 3D Vision, mais il y a visiblement un bug. Page 14 - H.A.W.X. H.A.W.X.Signé Tom Clancy, H.A.W.X. est un jeu d'action qui se passe dans les airs. Il utilise un moteur qui prend en charge DirectX 10.1 pour optimiser le rendu. Parmi les effets graphiques supportés, notons la présence de l'occlusion ambiante qui est poussée à son maximum tout comme les autres options. Nous utilisons le benchmark intégré et le patch 1.2 est installé. EyefinityH.A.W.X. prend en charge le surround gaming sans broncher.  Plus dynamique que Flight Simulator X, H.A.W.X. profite pleinement des écrans supplmentaires en tant que « simple » vision périphérique.  Le 5760x1200 reste gourmand mais au vu de la résolution triplée, la chute est ici plus que raisonnable. Par contre avec FSAA 4x, les Radeon sont à court de mémoire et il est impossible d'utiliser le jeu. 3D VisionDans H.A.W.X., Nvidia conseille de désactiver le HDR et le Depth of Field, mais le problème principal, selon nous, est le soleil qui n'est pas positionné correctement en profondeur et pour cela, il n'y a rien à faire. En dehors de ce soleil, 3D Vision reste sympathique dans ce jeu et l'effet est saisissant lorsque vous croisez un autre avion ou un missile, mais également lorsque vous frôlez les immeubles.  Les performances sont divisées par deux avec l'activation de 3D Vision, du coup la GeForce GTX 285 est un petit peu juste si vous voulez obtenir une fluidité parfaite. Page 15 - Need for Speed Shift Need for Speed ShiftPour tester le dernier né de la série des Need for Speed, nous poussons toutes les options à leur maximum et effectuons un déplacement bien défini. Le patch 1.1 est installé. EyefinityLes résolutions ultra larges ne posent aucun problème dans le dernier des Need for Speed.  Dans Shift, la vision périphérique apporte un plus énorme au niveau de l'immersion, mais également au niveau de la sensation de vitesse qui profite des décors qui défile sur les côtés.  La baisse de performances est importante, mais avec une petite concession sur la fluidité, le jeu est utilisable sur la Radeon HD 5870 sans antialiasing. Un système multi-GPU sera cependant nécessaire pour un résultat optimal. Avec antialiasing activé, le jeu refuse de démarrer, 1 Go de mémoire vidéo est une fois de plus insuffisant. 3D VisionMalheureusement, les pilotes 195.39 que nous avons utilisés pour ces tests ont apporté un bug dans Shift qui divise les performances par 3 ou 4 et donne donc des résultats ridiculement faibles. Nous avons pu vérifier que ce problème de performances était corrigé à partir des 195.55, mais ne disposions alors plus du kit 3D Vision. A 10 fps en mode 3D Vision il était difficile d'apprécier l'intérêt de la technologie dans ce jeu, nous avons donc réintégré Race Driver GRID à notre série de tests pour pouvoir tester un jeu de course sur les deux solutions. Page 16 - Race Driver GRID Race Driver GRIDPour tester ce jeu, nous réalisons un déplacement bien défini et nous poussons tous les détails au maximum. Il est basé sur une évolution du moteur de Colin McRae DIRT qui fait disparaître le côté usine à gaz et est donc bien plus performant. Le patch 1.2 est appliqué. EyefinityRace Driver GRID supporte nativement les résolution du surround gaming.  Tout comme dans Need for Speed Shift, bien que totalement accessoire, la vision périphérique apporte énormément en terme d'immersion et de sensation de vitesse.  Le 5760x1200 divise les performances par 2 par rapport au 1920x1200, ce qui est plutôt pas mal. Dans ce jeu un petit plus ancien, la Radeon HD 5850 suffit à jouer dans de bonnes conditions dans la résolution extrême qu'est le 5760x1200. Encore une fois, il n'est pas possible de profiter de l'antialiasing. 3D VisionNvidia conseille ici de désactiver le motion blur et les ombres qui ne sont pas bien positionnées. La sensation de 3D est plutôt bien rendu avec 3D Vision et profite à ce titre bien que l'absence d'ombres soit problématique.  Les performances chutent fortement et vous noterez cependant que ce n'est pas la synchronisation verticale qui en est la cause puisqu'elles sont similaires en 3D Vision classique et Discover. Malgré tout elles restent à un niveau suffisant pour que le jeu soit utilisé sans antialiasing voire même avec ce filtre activé si vous n'êtes pas exigeants sur la fluidité. Page 17 - Performances PerformancesAutant Eyefinity que 3D Vision entraînent une chute conséquente des performances, en général de plus de 50% et dans certains cas elle sont divisées par 3. Si tout cela est relativement logique dans le cas d'Eyefinity puisque 3x plus de pixels sont calculés et que c'est là que se trouve le plus gros de la charge graphique, dans le cas de 3D Vision, les performances sont inférieures à ce à quoi nous nous attendions. La raison est multiple. Dans certains cas la synchronisation verticale est un facteur important dans la chute de performances, mais pas toujours, en témoignent les résultats obtenus avec 3D Vision Discover. Une consommation mémoire plus importante peut également expliquer une chute plus importante que prévue. Nous estimons cependant que Nvidia a encore beaucoup de marge pour améliorer l'efficacité de son pilote, la priorité ayant probablement été d'assurer le fonctionnement de la technologie dans un maximum de titres. Dans un cas comme dans l'autre une carte graphique haut de gamme est donc obligatoire. Certes il est possible de baisser les détails graphiques et la résolution, mais dans le cas de 3D Vision, les premiers sont en général déjà réduits et la seconde en 1680x1050 n'est déjà pas très folichonne pour une technologie qui se veut avant-gardiste. A moins de ne vouloir jouer en 3D qu'avec quelques anciens jeux, il faudra donc au minimum une GeForce GTX 260 et encore certains jeux seront inaccessibles avec un niveau de qualité suffisant et préféreront une GeForce GTX 295, nous sommes loin de la GeForce 9600 GT qui fait partie de la configuration minimale demandée par Nvidia. Les GeForce basées sur Fermi seront les bienvenues à ce niveau ! Quant à Eyefinity, dans l'état actuel des choses il n'est en général pas possible d'utiliser une résolution inférieure à la résolution native très élevée. Il n'y a pas de secret, pour jouer en 5760x1200 et calculer près de 7 millions de pixels, il faut une carte graphique très puissante, de la trempe des Radeon HD 5800 et 5900 et il serait d'ailleurs bien qu'AMD propose un support complet des solutions CrossFire avec le mode SLS. Des versions 2 Go de ces cartes apporteraient également un gain important avec antialiasing. Compte tenu de la forte consommation mémoire liée à ce filtre, les performances plongent très souvent et dans de nombreux cas le jeu plante suite à manque d'espace mémoire vidéo. Bien entendu inutile de rêver profiter du surround gaming avec une Radeon HD 5700 qui devra se contenter de sa gestion du multi-écran dans un cadre bureautique. Page 18 - Impressions ImpressionsS'il est maintenant clair que ces technologies sont gourmandes, voici nos commentaires sur ce qu'elles apportent en pratique. La vision périphérique d'Eyefinity, quand le jeu s'y prête, apporte un plus indéniable au niveau de l'immersion et plus précisément de la sensation de vitesse dans les jeux de voiture par exemple. Par contre, dans d'autres elle peut ajouter de la confusion voire de la frustration puisque les affichages latéraux ne sont pas faits pour être utilisés directement or il est tentant de tourner la tête et de vouloir profiter de ces moniteurs supplémentaires. Qui plus est, dans certains cas, le décalage entre les écrans est gênant. C'est par exemple le cas lorsqu'une partie de l'arme dans un FPS ou du HUD dans tout type de jeux est à cheval entre deux d'entre eux. Lorsque ce problème pourra être corrigé avec un futur pilote, se posera un autre : quid des morceaux de texte coupés au niveau de la séparation de deux écrans ? Une fois les moniteurs connectés, il reste à les positionner. En ligne, ce n'est pas génial : il faut se déplacer latéralement pour les exploiter en bureautique et l'immersion est réduite dans les jeux. Avec un angle moyen, c'est beaucoup mieux sur les deux plans. Avec un angle très élevé, l'immersion reste bonne, mais c'est inutilisable en bureautique.    Au sujet de 3D Vision, nous exclurons directement le mode Discover. Comme son nom l'indique, il est fait pour avoir un aperçu de ce qu'est la 3D stéréoscopique avant l'achat du « vrai » kit 3D Vision, si vous n'avez pas pu essayer celui-ci. Ce n'est pas une solution réellement utilisable à moins que vous ne recherchiez les maux de tête. Les couleurs sont appauvries et la dominante rouge est évidente. Qui plus est, après 1h de jeu, il nous a fallu plusieurs heures pour retrouver une vue normale, les yeux s'accommodant et compensant visiblement les filtres rouge/cyan, ce qui fait que lorsque nous avons retiré les lunettes, chaque il proposait une colorimétrie déformée différemment. Plus besoin de dépenser des fortunes en drogues et autres champignons, de simples lunettes en carton vous apporterons les mêmes effets.   Heureusement, le kit 3D Vision ne souffre d'aucun de ces problèmes. Nous n'avons rencontré aucuns maux de tête, mais c'est bien entendu ici un point qui peut varier suivant les individus puisque la stéréoscopie force notre système visuel à une gymnastique particulière qui peut être fatigante, principalement si vous luttez inconsciemment « contre » l'effet 3D et une fois que vous l'avez accepté, il reste à ne pas vouloir chercher à aller plus loin que la technologie. Ainsi avec cette information supplémentaire qui nous arrive, il est tentant de vouloir déplacer la tête sur le côté pour mieux voir derrière un objet par exemple. La scène sera alors simplement déformée mais restera figée. Cela paraît bête, mais c'est un réflexe courant au début. Tout comme avec Eyefinity il faut donc regarder devant soi en mode minerve pour obtenir le meilleur effet. Nous avons passé de nombreuses heures à jouer dans différentes conditions. En journée, en soirée, avec lunettes correctrices par-dessous les lunettes 3D Vision, avec des lentilles En journée, la lumière ne nous a pas posé de problème particulier, bien entendu nous évitions d'avoir des reflets dans l'écran comme nous le faisons également sans 3D Vision. Nous soupçonnons cependant qu'il puisse y avoir des différences entre les personnes habituées à porter des lunettes, et donc à oublier les reflets qui s'y forment, et les autres. Attention cependant aux autres écrans dans la pièce qui peuvent donner l'impression de clignoter. Quant aux lunettes correctrices, si elles sont fines, elles peuvent prendre place sous les lunettes 3D Vision, mais ce ne sera pas le cas de tous les modèles. Suivant le visage de chacun et le support choisi pour le nez, les lunettes seront plus ou moins proches des yeux. Dans certains cas quand elles sont trop proches et que vous êtes près de l'écran, l'obturation devient imparfaite aux extrémités des verres. Si la lumière arrive verticalement vers les verres, elle est bel et bien bloquée, par contre ce n'est que partiellement le cas quand l'angle devient plus grand. Il faudrait utiliser des verres arrondis et non plats pour corriger cela. Cette fuite de la lumière participe selon nous à renforcer l'effet de ghosting qui provient de l'écran LCD Samsung 120 Hz qui n'est pas assez réactif dans les tons clairs pour rafraîchir l'image 120 fois par seconde. La réactivité est ici un facteur très important puisque les images successives représentent une vue différente. Sous l'image de l'il gauche va donc se retrouver dans certains cas des restes de l'image de droite, ce qui est gênant. La solution pourrait provenir d'écrans encore plus réactifs ou de lunettes plus évoluées qui marqueraient une petite pause entre le passage de l'ouverture d'un il à l'autre, laissant à l'écran le temps de faire disparaître l'ancienne image. Cette seconde solution réduirait cependant encore plus la luminosité déjà réduite fortement avec le kit actuel, ce qui a d'ailleurs pour effet de faire passer le blanc vers le gris, un petit peu comme si vous mettiez des lunettes de soleil.  Une fois que vous vous y êtes fait et si le jeu est coopératif avec le principe, 3D Vision rempli parfaitement son rôle. Dans Batman Arkham Asylum et Resident Evil 5, le résultat est excellent et l'immersion en profite d'une manière évidente. La palette de couleurs utilisées ainsi que l'ambiance de ces jeux fait également que la perte au niveau des couleurs avec les lunettes n'a pas de réelle incidence. Terminons par préciser que le pilote Nvidia est très ergonomique et que le contrôle de parallaxe proposé directement sur le récepteur est très pratique puisqu'il permet d'ajuster très facilement le niveau de « 3D » dans chaque jeu par rapport à ce qui vous conviendra le mieux. Dans notre cas, le paramètre par défaut s'est très souvent avéré être la meilleure solution. Page 19 - Conclusion ConclusionFaut-il tous se ruer sur 3 écrans ou un kit 3D Vision ? Autant être clairs : non, ce sont des systèmes spécifiques accompagnés de nombreuses limitations, qui ne donnent le meilleur que dans certaines conditions et donc à réserver à des utilisations particulières, sans quoi vous risqueriez d'être déçus. Tout d'abord ils sont réservés aux joueurs qui n'ont pas de soucis avec leur banquier puisqu'ils exigent un investissement important tant au niveau de l'affichage que de la puissance graphique. Dans les deux cas, une carte vidéo équipée d'un voire de deux GPUs haut de gamme est nécessaire, de quoi justifier la débauche de puissance affichée par les dernièrs modèles. Pour 3D Vision il faudra acheter un écran spécifique ainsi que le kit qui comprend les lunettes et pour Eyefinity, il faudra acheter trois écrans ou deux écrans supplémentaires identiques à celui que vous utilisez actuellement.  Eyefinity et ses trois écrans ont l'avantage d'être également très utiles dans le contexte plus sérieux de la bureautique. Travailler avec un tel système d'affichage est réellement très confortable, vous y prendrez vite goût. Selon nous, pour être justifié, investir dans trois moniteurs doit se faire dans l'optique d'une utilisation de ce type en plus du jeu, à moins bien sûr d'être fan d'une simulation particulière et de ne plus répondre aux lois de la raison pour assouvir votre passion. Conclure sur 3D Vision est quelque peu plus complexe. La technologie proposée par Nvidia est ce qui se fait de mieux en 3D stéréoscopique pour les joueurs, et apporte réellement une dimension supplémentaire dans les jeux qui sont coopératifs. Son souci principal est en réalité externe à Nvidia. Ainsi, vous pouvez compter les moniteurs disponibles à ce jour avec vos mains et sans les doigts. Les deux modèles actuellement disponibles reposent sur la même dalle limitée au 1680x1050 et qui pourrait être plus réactive. Mais le problème principal c'est sa diagonale de 22'' qui est trop petite pour bon nombre de joueurs qui investissent dans une machine haut de gamme. Bien entendu il existe des TVs DLP plus grandes, mais elles sont peu disponibles en Europe et réduisent la résolution et la luminosité de moitié. Nvidia nous parle de l'arrivée prochaine d'écrans plus grands et en full HD, nous les attendons donc avec impatience. Nous espérons également que Nvidia s'empressera de supporter tous les systèmes d'affichage stéréoscopique qui vont débarquer l'an prochain chez les fabricants de TVs, sans vouloir favoriser la vente de son kit ou d'un logo 3D Vision.  Nous attendons par ailleurs la standardisation des protocoles de transmission des flux vidéo stéréoscopiques avec le HDMI 1.4 et le DisplayPort 1.2 étant donné que 3D Vision, ce n'est pas utile que pour les jeux, ça l'est également pour les films. Certes ils sont actuellement rares en 3D, mais ils devraient commencer à arriver en 2010. Seront-ils compatibles avec le matériel actuel ? Si sur le fond ce n'est pas un problème, Nvidia ayant fait tout le travail logiciel, en pratique la protection de ces vidéos risque d'en être un. Actuellement, par exemple, en 100 ou 120 Hz sur les écrans de Samsung et de Viewsonic, le support du HDCP est perdu. Nul doute que c'est également le cas en mode 3D Vision. En l'absence de standard, chaque solution de communication est propriétaire, ce qui est un problème pour apporter les protections nécessaires. Que va-t-il se passer quand les Bluray en 3D stéréoscopique vont arriver ? Nous sommes plutôt pessimistes sur cette question Investir dans 3D Vision aujourd'hui n'est donc pas un choix à faire pour l'avenir. C'est le meilleur système stéréoscopique actuel et l'achat doit donc être fait dans ce contexte si vous accepter de vous contenter d'un moniteur 22''. Notez qu'un autre système est disponible aujourd'hui. Il s'agit d'un ordinateur portable Asus, le G51J 3D, équipé d'une dalle compatible 120 Hz, en 1366x768. La GeForce GTX 260M qui l'anime, aura cependant un peu de mal en dehors des jeux simples puisqu'il s'agit en réalité d'une petite GeForce 8800GT/9800GT/GTS240 sous-cadencée contrairement à ce que son nom trompeur peut laisser penser. Or comme nous vous l'avons montré, jouer avec 3D Vision demande beaucoup de puissance graphique. Si l'aspect logiciel est au point, Nvidia manque cruellement d'une solution idéale pour l'exploiter. Copyright © 1997-2026 HardWare.fr. Tous droits réservés. |