| |

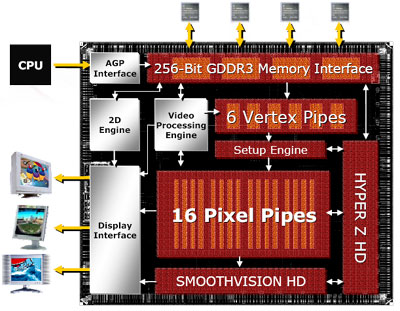

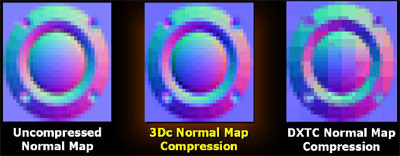

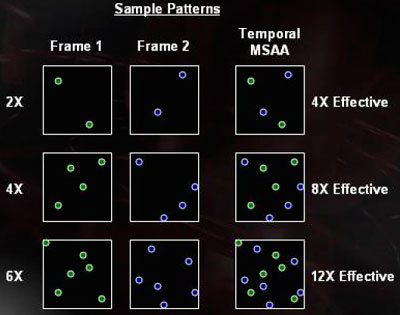

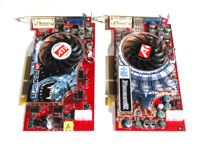

| ATI Radeon X800 XT et X800 Pro Cartes Graphiques Publié le Mardi 4 Mai 2004 par Damien Triolet et Marc Prieur URL: /articles/494-1/ati-radeon-x800-xt-x800-pro.html Page 1 - Introduction  Après le succès de son architecture R300 quil décline depuis près de deux ans, ATI se devait de lancer une nouvelle génération de puce graphique afin de contrer loffensive de NVIDIA et de son GeForce 6800 Ultra. Cest aujourdhui chose faite, puisque ATI lance officiellement ses Radeon X800, qui sont issus de larchitecture connue sous le nom de code de R420. Après le succès de son architecture R300 quil décline depuis près de deux ans, ATI se devait de lancer une nouvelle génération de puce graphique afin de contrer loffensive de NVIDIA et de son GeForce 6800 Ultra. Cest aujourdhui chose faite, puisque ATI lance officiellement ses Radeon X800, qui sont issus de larchitecture connue sous le nom de code de R420.Un peu dhistoire ...Fondé en 1985, ATI fait office de « vieux de la vieille » en comparaison de son concurrent NVIDIA qui na vu le jour que 8 ans plus tard. Cette société canadienne sest rapidement lancée sur le marché des accélérateurs graphiques, en 2D pour commencer. En dehors dun 3D Rage qui navait de 3D que le nom vu le peu de fonctions prises en charge, la première incursion dATI sur le marché des accélérateurs graphiques 3D date de la rentrée 1997 et du Rage Pro. Cette puce, qui était par ailleurs la première à tirer partie de lAGP Texturing, gérait à la fois la 2D et la 3D, comme le Riva 128 de NVIDIA et au contraire du Voodoo Graphics de 3dfx. Sans atteindre la qualité et la vitesse de cette dernière, la solution ATI de par son coût eut un grand succès à lépoque, notamment auprès des OEM.  Malheureusement pour ATI, le lancement en grande pompe du Rage 128 un an plus tard fut un désastre. Destiné à concurrencer le Riva TNT de NVIDIA, cette puce arriva avec près de 6 mois de retard dans le commerce. Dans un marché devenu hyper concurrentiel de part lagressivité de NVIDIA en terme de cycles produits, ce retard fut déterminant et ne pu être comblé malgré le Radeon à la rentrée 2000 et le Radeon 8500 un an plus tard. Malheureusement pour ATI, le lancement en grande pompe du Rage 128 un an plus tard fut un désastre. Destiné à concurrencer le Riva TNT de NVIDIA, cette puce arriva avec près de 6 mois de retard dans le commerce. Dans un marché devenu hyper concurrentiel de part lagressivité de NVIDIA en terme de cycles produits, ce retard fut déterminant et ne pu être comblé malgré le Radeon à la rentrée 2000 et le Radeon 8500 un an plus tard.On pouvait alors se demander si ATI pourrait un jour remonter la pente ... cétait sans compter sur leur dernier petit bijou, larchitecture R300, co-developpée par les ingénieurs dArtX, société rachetée par ATI en 2000 et qui était également en charge du développement de la puce graphique de la GameCube de Nintendo. Lancé à la rentrée 2002, le R300, plus connu sous le nom de Radeon 9700 Pro, fut le succès que lon connaît, permettant même à ATI de revenir puis de dépasser légèrement NVIDIA en terme de parts de marché. Un peu moins de deux ans et quelques déclinaisons plus tard, il était toutefois temps de passer à autre chose ... Page 2 - Nouveau GPU, vieille architecture Un nouveau GPU, une vieille architecture  Une nouvelle génération de GPU est habituellement accompagnée d´une nouvelle architecture ce qui permet au GPU de passer à un pallier supérieur et d´offrir de nouvelles possibilités. Avec les X800, ATI déroge à cette règle. Dès lors, pouvons-nous réellement qualifier les Radeon X800 de "nouvelle génération" ? Nous sommes tentés de répondre à cette question par la négative. Les Radeon X800 correspondent plutôt à une simple évolution des Radeon 9700/9800. Simple ... mais pas inintéressante et encore moins transparente ! Une nouvelle génération de GPU est habituellement accompagnée d´une nouvelle architecture ce qui permet au GPU de passer à un pallier supérieur et d´offrir de nouvelles possibilités. Avec les X800, ATI déroge à cette règle. Dès lors, pouvons-nous réellement qualifier les Radeon X800 de "nouvelle génération" ? Nous sommes tentés de répondre à cette question par la négative. Les Radeon X800 correspondent plutôt à une simple évolution des Radeon 9700/9800. Simple ... mais pas inintéressante et encore moins transparente !Cette évolution que nous qualifions de "simple" consiste principalement en un dédoublement du nombre de pixel pipelines. Ainsi, ATI ne leur a pas apporté de modification importante mais en a placé 16 dans les Radeon X800 au lieu de 8 dans les Radeon 9700/9800. Ensuite ATI a augmenté la puissance géométrique en ajoutant 2 unités de vertex shader, ce qui en porte le nombre à 6. Pour parfaire ce gain de puissance, ATI est passé à une gravure de fabrication en 0.13µ, ce qui permet de plus hautes fréquences. Au final, le X800 XT avec 160 millions de transistors à plus de 500 MHz ne consomme et ne chauffe pas beaucoup plus qu´un Radeon 9800 avec 117 millions de transistors à 412 MHz.  Il faut noter que seul le X800 XT est doté de 16 pixel pipeline : tout en utilisant la même puce, le X800 Pro, qui sera moins cher, ne dispose de 12 pixel pipeline actives. Autour de ces ajouts de blocs de calcul, ATI a optimisé légèrement le GPU pour les hautes résolutions en apportant quelques modifications mineures à l´Hyper Z qui du coup passe en version HD. Par exemple ATI a légèrement augmenté la taille des buffers utilisés par le Hierarchical Z (système d´éjection des blocs de pixels masqués) afin qu´il puisse fonctionner correctement en très haute résolution, ce qui n´était pas le cas avant selon le fabricant. Augmenter la qualité à moindre coût : 3DcATI profite du lancement du X800 pour introduire une nouveauté particulièrement intéressante bien qu´en partie d´ordre logiciel. Elle se nomme 3Dc et concerne la compression des textures, mais pas de n´importe quelles textures. Une texture est avant tout un tableau de données qui peut contenir des couleurs (un dessin comme c´est le cas habituellement) ou d´autres informations. La complexité d´un objet tel que nous la percevons dépend en grande partie de la manière dont il interagit avec la lumière. Plus un objet contient de polygones, plus la lumière renvoyée sera précise et plus l´objet semblera complexe. Malheureusement, il n´est pas possible d´afficher des objets extrêmement complexes car les performances en souffriraient trop et ils prendraient trop de place en mémoire. Une astuce est d´utiliser une texture (appelée "normal map") qui contient (ou peut être utilisée pour calculer) de fausses informations sur la manière dont l´objet va interagir avec la lumière. Il s´agit de bump mapping.  Ainsi, au lieu de calculer la manière dont la lumière doit être traitée par rapport au nombre réduit de polygones de l´objet, il suffit d´extraire la réponse précalculée dans la texture. L´illusion est souvent impressionnante car ces textures sont générées par les développeurs à partir d´objets de très haute complexité. Le problème est que ces textures peuvent prendre beaucoup de place en mémoire et ne peuvent pas être compressées par les méthodes habituelles sans produire d´artéfacts visuels. C´est ici qu´intervient le 3Dc.  Le 3Dc est une variante optimisée d´une technique similaire qu´ATI réalisait avec le format de compression standard DXT5 et quelques petites astuces. Grossièrement, le 3Dc permet de faire proprement ce qui était du bricolage avec le DXT5. Il permet de réduire par 4 la taille de ces textures sans entraîner une perte visible de qualité. Le 3Dc a un coût, léger mais présent, sur les performances. Une normal map contient des vecteurs qui appartiennent à un espace à 3 dimensions. Ils ont donc chacun 3 coordonnées : x, y et z. En 3Dc, la composante z n´est pas encodée dans la texture mais calculée dans le pixel shader. Cette opération nécessite 2 instructions qui peuvent profiter du co-issue (traitement en parallèle), ce qui signifie que le coût du 3Dc est de 1 cycle. Son influence dépend donc de la taille du pixel shader. Plus il sera complexe plus le coût du 3Dc tendra à disparaître. Page 3 - Shaders simples mais efficaces Shaders simples mais efficacesEn ne modifiant pas ses unités de calcul, ATI conserve cette redoutable efficacité qui a fait le succès des Radeon 9700 et 9800. L´efficacité est clairement au cur de l´architecture d´ATI. En face, NVIDIA a opté pour une approche très différente : complexifier l´architecture pour lui donner plus de possibilités. Le problème est que sans efficacité ces possibilités sont inutilisables. C´est le problème qu´a rencontré NVIDIA avec la gamme des GeForce FX. Avec le GeForce 6800, NVIDIA a choisi de conserver cette complexité mais de la modifier entièrement afin de la rendre plus efficace, le but étant d´allier les possibilités des GeForce FX (et même plus) à l´efficacité des Radeon. Bien entendu, NVIDIA n´a pas pu atteindre complètement cette efficacité. Les Radeon 9700/9800/X800 conservent donc un avantage à ce niveau comme vous pourrez le constater dans les divers résultats de cet article. Ceci dit, l´efficacité des GeForce 6800 est à cent lieues de celle des GeForce FX. Le nouveau GPU de NVIDIA offre clairement un compromis très intéressant entre efficacité et possibilités. La question reste bien entendu de savoir à quel point les développeurs vont pouvoir et/ou vouloir user de ses possibilités. Voici quelques résultats obtenus en Pixel Shader. Le premier tableau utilise des pixel shader 2.0 extraits d´applications courantes et exécutés sous une autre application (résultats en Mpixels /s). Nous avons ensuite utilisé deux shader de RightMark 3D (Specular Lighting et Procedural Texturing), en Full precision (FP32/FP24) ainsi quen partial precision sur GeForce (FP16).   Pixel Shader 2.1Avec les Radeon X800, ATI supporte une version plus avancée des Pixel Shader 2.0. Premièrement ATI peut maintenant gérer 512 passages dans les pixel pipelines au lieu de 64 auparavant. Ceci porte le nombre d´instructions gérées de 160 à 1536. Etant donné que ce nombre maximal dépend de l´utilisation de toutes les unités (vectorielle, scalaire et de texturing) et ne peut-être atteint que quand elles sont toutes utilisées, ATI ne peut pas exposer autant d´instructions dans DirectX. La limite en pratique passe donc de 96 instructions (64 mathématiques + 32 de texturing) à 512 instructions (peu importe le type). ATI expose également 32 registres au lieu de 12 avec les Radeon 9700/9800. Il ne s´agit cependant pas d´une nouveauté et les Radeon 9700/9800 peuvent également en gérer 32. Les Pixel Shader 2.0 ne permettant pas d´exposer plus de 12 registres, ATI a estimé (avec raison) qu´il était inutile de passer par des Pixel Shader 2.x pour si peu de différence.  Toutes les variantes des Pixel Shader situées entre les 2.0 et les 3.0 se nomment 2.x, tout du moins pour le runtime de DirectX. Les développeurs ont accès avec le HLSL à des profils de compilation différents qui correspondent grossièrement à chaque architecture. Le profil ps_2_0 correspond aux Radeon 9500 à 9800.Si des lettres sont utilisées pour les séparer c´est parce que du ps_2_b n´est pas nécessairement plus évolué que du ps_2_a. Ce n´est d´ailleurs pas le cas. S´il fallait donner un chiffre à ces versions, le profil ps_2_a correspondrait à du PS 2.8 alors que le profil ps_2_b représenterait, lui, du PS 2.1. Les capacités des nouvelles Radeon restent donc encore bien inférieures à celles des GeForce FX. Ceci n´a pas été un problème pour ATI jusqu´ici, mais qu´en sera-t-il dans quelques mois, dans 1 an ? Il est très difficile de répondre à cette question et nous ne pouvons pas, à l´heure actuelle y répondre. Où sont les 2 unités des GeForce 6800 ?Sur le papier le GeForce 6800 dispose de 2 unités de calcul des pixel shader par pipeline contre une chez ATI. Nous pourrions donc nous attendre a voir des performances bien plus élevées sur le GeForce 6800. Nous avons cherché une explication à ceci et avons constaté que le GeForce 6800 dispose bien de 2 unités par pipeline mais que celles-ci ne sont pas identiques. La première peut effectuer toutes les opérations complexes, les opérations de texturing et les multiplications, mais pas d´addition ni ce qui y est lié. C´est la seconde unité qui s´occupe des additions (ainsi que des MAD et DP3). Elle peut également exécuter une multiplication, mais aucune autre instruction. Cela signifie en pratique que le shader doit contenir un savant mélange d´instructions alternées dans un ordre bien précis pour utiliser complètement les 2 unités à chaque cycle. Le compilateur intégré aux drivers garde donc une importance non négligeable et au fur et à mesure de son évolution il devrait permettre de mieux ordonner les pixel shader afin qu´ils puissent tirer plus de profit des 2 unités de calcul. En l´état actuel des choses, force est de constater qu´ATI fait aussi bien avec une seule unité ! Vertex ShaderIl n´y a rien de bien du neuf du côté des Vertex Shader d´ATI. Il est néanmoins intéressant d´en comparer les performances à ceux de NVIDIA. Pour ce faire, nous avons utilisé un test géométrique de Rightmark 3D réalisé en fonction fixe (T&L), en VS1.1, en VS2.0, en VS2.x et en VS3.0. A chaque fois c´est la même chose qui est calculée.  Comme vous pouvez le constater, NVIDIA garde un avantage lorsqu´il s´agit d´opérations T&L. Les unités de Vertex Shader de NVIDIA semblent fortement optimisées pour ce mode. Une fois passé aux Vertex Shader, c´est ATI qui mène la danse. Les GPU NVIDIA chutent de façon inexpliquée avec le branchement statique. Ils se rattrapent avec le branchement dynamique. C´est d´ailleurs totalement anormal que le branchement dynamique soit exécuté plus rapidement que son équivalent statique. Probablement un bug dans les drivers NVIDIA ... qui y traînerait alors depuis la sortie des GeForce FX. Page 4 - Anti Aliasing Anti AliasingDu côté de lanti-crénelage comme du filtrage anisotrope, ATI na strictement rien changé entre larchitecture R3xx et larchitecture R4xx. Lanti-crénelage est donc de type multi sampling et utilise une grille basée sur 2, 4 ou 6 échantillons, là ou NVIDIA se limite à 4 échantillons dans le meilleurs des cas. Voici la configuration de ces derniers :  Et le résultat que lon atteint en pratique sous FSAA Tester :    Nous avons déjà comparé ces résultats à plusieurs reprises à ceux obtenus par NVIDIA (la dernière fois au sein du test de la 6800 Ultra) et ne le referons donc pas ici. Pour résumer : lanti-crénelage offert par les puces ATI est supérieur à celui des GeForce FX, alors que celui des GeForce 6800 est relativement proche. Voyons maintenant limpact sur les performances de lAA 4x, dans deux cas : Game Test 4 de 3DMark03 ainsi que Colin Mc Rae 4 :   Les résultats sont ici plus en faveur de NVIDIA, et les Radeon X800 ne démontre pas doptimisation particulière par rapport au Radeon 9800. On notera que la Radeon X800 XT souffre plus particulièrement de son manque de bande passante par rapport à son nombre de pipeline que la X800 Pro sous Colin Mc Rae lorsquon active lAA. Page 5 - Temporal Anti Aliasing Temporal Anti AliasingATI a introduit au sein de ces derniers drivers Catalyst une fonction danti-crénelage assez intéressante : le temporal anti aliasing. Cette fonction, qui fonctionne également sur les puces R3xx, part dun principe relativement simple : au-delà de 60 images par seconde, pour chaque image paire, ATI utilise une certaine grille des échantillons dédiés à lAA, et pour chaque image impaire une autre grille, le but étant de jouer sur la persistance rétinienne afin daméliorer le niveau dAA réel.  Dans le cas du AA 2x Temporal par exemple, vous pouvez voir que la grille en AA 4x (tout à gauche) et similaire à celle que lon obtient si lon superpose la grille en AA Temporal 2x pour les images paires (au milieu) à la grille pour les images impaires (à droite) :  En sus du fait dêtre au dessus de 60 fps, il faut être en mode V-Sync afin de faire fonctionner le temporal anti aliasing. Dans ce mode, lécran et la carte graphique son synchrones, c´est-à-dire que la carte rend une image pour chaque rafraîchissement de lécran (60 fois par secondes à 60 Hz). Sans V-Sync, ils ne sont pas synchronisés, ce qui a pour avantage davoir une meilleure réactivité dans les mouvements, au détriment dun léger décalage qui peut parfois arriver entre deux parties de limage.  En pratique, le temporal anti aliasing fonctionne plutôt bien, mais il faut que dautres conditions soient réunies. La première se situe au niveau du framerate, qui doit être élevé afin que leffet sur la persistance rétinienne soit effectif : sur un écran cathodique, cest au-delà de 85 Hz et 85 fps que les résultats commencent à êtres bons. Sur un écran LCD, même avec une rémanence assez faible comme sur un ProphetView 920, les résultats sont encore plus probants. Dans des conditions idéales, le temporal AA 2x est clairement de meilleure qualité que lAA 2x et on sapproche dun AA 4x « réel ». En terme de performances, limpact est, hors celui lié au V-Sync, mineur puisque sous Unreal Tournament 2003 à un endroit précis sur une carte nous obtenions 95.9 fps en 1600*1200 100 Hz en AA4x et V-Sync Off, 85.7 fps en activant le V-Sync et 83.2 fps en passant en AA4x Temporal. On notera juste un très léger ralentissement lorsque le temporal et activé ou désactivé (passage en dessous ou au delà des 60 fps). Il faut toutefois noter que si vous disposez dun framerate inférieur à votre taux de rafraîchissement mais supérieur à 60 fps, le temporal AA sera toujours activé et le changement de grille sera alors assez visible. Pour un résultat optimal, il faudra donc avoir un framerate qui ne descend pas au dessous du taux de rafraîchissement, ce dernier devant au moins être de 85 Hz sur un écran cathodique. Du coup, si cette fonction est intéressante, sa mise en pratique reste fastidieuse. De ce fait, en létat actuel des choses lanti aliasing standard à notre préférence. Page 6 - Filtrage Anisotrope Filtrage AnisotropeDu côté du filtrage des textures, les choses nont pas changées entre les R3xx et les R4xx. ATI utilise donc un algorithme optimisé selon les angles pour le filtrage anisotrope, comme le fait désormais NVIDIA sur son 6800 Ultra, les angles les plus lissés étant généralement ceux qui en ont le plus besoin dans les jeux. Il serait utile que ATI propose une option permettant dactiver un filtrage anisotrope offrant un résultat identique sous tous les angles.   Il faut noter que lorsque lon active le filtrage anisotrope via les drivers chez ATI, comme cest le cas dans la majeur partie des cas, la charge est moins importante puisque le trilinéaire entre les mip-map nest effectué que sur la texture de niveau 1 en Direct3D, les autres restant en bilinéaire. Limpact visuel est toutefois inexistant en pratique, à condition que les autres textures ne soient pas utilisé comme textures principales par les designers des jeux, comme cest malheureusement parfois le cas. Du coup nous avons mesuré limpact de lactivation du filtrage anisotrope sous 3DMark03 GT4 une fois en activant ce filtrage via lapplication et une autre en lactivant via les drivers :  Comme vous pouvez le voir, les Radeon X800 sen tirent encore mieux que le Radeon 9800 lorsquil sagit de faire appel à cette méthode de filtrage. Ces résultats sont confirmés par ceux obtenus sous Colin Mc Rae :  Il semble donc évident que ATI a optimisé les performances de cette fonction au sein de ses nouvelles puces. Mise à jour : ATI utilise en fait comme NVIDIA un filtrage qui se situe en bilinéaire et trilinéaire. Pour plus de détails, cf. cette news. Page 7 - Les cartes, Consommation Les cartesPour ce test, ATI nous a envoyé une ATI Radeon X800 XT Platinum Edition ainsi quune ATI Radeon X800 Pro. Les cartes sont strictement identiques et dotées dun PCB relativement simple, dune longueur similaire à celui dune Radeon 9800 XT par exemple. 256 Mo de mémoire GDDR3 équipent chacune des deux cartes, et cette mémoire nest pas en contact avec le système de refroidissement du VPU, alors que cétait le cas sur Radeon 9800 XT: il faut dire que la dissipation thermique réduite est lune des caractéristiques de la GDDR3.      Il faut noter que toutes les cartes ATI Radeon X800 du commerce seront identiques dans un premier temps. En effet, ATI a décidé de confier la fabrication des cartes X800 à un sous traitant et vends ensuite les cartes à ses divers partenaires. De plus, en sus de la version Platinum Edition de la X800 XT, il est possible quune version standard voit le jour. Ses fréquences devraient être très légèrement revues à la baisse, et elle devrait être confinée au marché OEM même si cela nest pas encore sûr à 100%.   ConsommationNous avons mesuré les chiffres de consommation sur notre configuration de test (P4C800/P4 3.2C / 2x512 Mo / 1 DVD / 1 DD) avec différentes cartes. Voici tout dabord la consommation du PC au repos, sous le bureau Windows :  On peut voir que ATI a fortement optimisé la consommation du Radeon X800 XT lorsquil est au repos, puisquil ne consomme pas beaucoup plus quun simple Radeon 9600 Pro alors que le Radeon 9800 XT gâche de la puissance inutilement au repos.  En charge, une configuration à base de Radeon X800 XT consomme logiquement plus de puissance. Lécart reste toutefois faible par rapport à ce que requiert un Radeon 9800 XT et lon est encore en dessous de la consommation de la dernière née des solutions NVIDIA. Page 8 - 6800 GT & UE, Le test, les résultats GeForce 6800 GT et Ultra Extreme  Preuve de la relative fébrilité dans laquelle se trouve ATI comme NVIDIA afin de savoir qui aura la plus grosse barre 3DMark dans sa présentation marketing sans que la solution adoptée ne coûte les yeux de la tête, lun et lautre des constructeurs ajuste jusquau dernier moment les fréquences de ces produits. Ainsi, la Radeon X800 XT envoyée par ATI était initialement un peu plus hautement cadencée que 520/560, et le constructeur canadien ensuite envoyé un bios à cette fréquence. Preuve de la relative fébrilité dans laquelle se trouve ATI comme NVIDIA afin de savoir qui aura la plus grosse barre 3DMark dans sa présentation marketing sans que la solution adoptée ne coûte les yeux de la tête, lun et lautre des constructeurs ajuste jusquau dernier moment les fréquences de ces produits. Ainsi, la Radeon X800 XT envoyée par ATI était initialement un peu plus hautement cadencée que 520/560, et le constructeur canadien ensuite envoyé un bios à cette fréquence.De son côté, NVIDIA a décidé de lancer deux produits GeForce 6800 supplémentaires, les GT et Ultra Extreme. Voici donc les caractéristiques des 4 produits GeForce 6800 : - GeForce 6800 : 375/350 MHz (12 pipelines) - GeForce 6800 GT : 350/500 MHz (16 pipelines) - GeForce 6800 Ultra : 400/550 MHz (16 pipelines) - GeForce 6800 Ultra Extreme : 450/550 MHz (16 pipelines)  La version Ultra Extreme, qui ne sera disponible que chez certains fabricants, est donc une version très haut de gamme alors que la version GT vient sintercaler entre 6800 et 6800 Ultra, afin de se mettre en face du X800 Pro en terme de prix. La GeForce 6800 "standard" pourrait ne jamais voir le jour dans le commerce. Il faut noter que la 6800 GT était dotée d´un design différent des 6800 Ultra puisque le ventilateur était moins imposant, moins bruyant et que la carte ne demandait qu´un connecteur d´alimentation. Le testPour ce test, nous avons utilisé la configuration suivante : - ASUSTeK P4C800-E Deluxe - Intel Pentium 4 3.2C GHz - 2x512 Mo DDR PC3200 en 2-3-3-8 - Windows XP SP1 Français - NVIDIA ForceWare 61.11 (6800) /60.72 (59xx) - ATI Catalyst 8.01.3   Le filtrage anisotrope était activé dans tous les cas via les drivers, ce qui implique quen Direct3D ATI neffectue pas de trilinéaire sur les textures autres que celle de niveau 1. De son côté, NVIDIA utilise un trilinéaire global moins poussé. Il faut noter quen OpenGL toutefois cette optimisation de ATI nest pas active. Pour cette raison, nous avons également désactivé loptimisation du trilinéaire chez NVIDIA pour le test sous IL-2 FB afin davoir des résultats plus comparables. Cette désactivation nétait toutefois pas prise en compte avec les 61.11 suite à ce qui serait un bug des drivers. Du coup, nous avons conservé les 60.72 pour ce jeu, mais il faut noter que les 61.11 ne modifient pas les performances des cartes NVIDIA sous IL-2 à réglages identiques. Les résultatsSi vous voulez de suite savoir ce que valent les Radeon X800 Pro et X800 XT dans les jeux, sans avoir à consulter chaque page de benchmarks « jeu », nous vous offrons ici un petit récapitulatif des performances de ces cartes. Pour évaluer les performances, nous avons utilisés 8 jeux : Unreal Tournament 2003, Far Cry, Tomb Raider : Angel of Darkness, Splinter Cell : Pandora Tomorrow, IL-2 Forgotten Battles, Warcraft III, Colin Mc Rae Rally 04 et Fifa 2004 (scène différente plus de larticle précédent pour ce dernier jeu). Pour chacun de ces jeux nous avons réglé les détails à leur maximum et effectué un test en 1600*1200 32 bits, et un autre dans la même résolution mais en activation un anti-crénelage 4x et un filtrage anisotrope 8x, sauf pour Splinter Cell dont le moteur ne supporte pas lanti-crénelage 4x. Il faut noter que pour Far Cry, nous navons effectué ce test quen 1280*1024, les cartes NVIDIA ne fonctionnant pas correctement sous ce jeu en 1600*1200 avec AA 4x. Pour rappel, depuis maintenant près dun an et afin de contourner certaines « optimisations », nous avons cessé dutiliser les démos intégrées de base aux jeux pour passer par nos propres replay, voir nos propres scènes de gameplay pour les jeux ne proposant pas une telle option. Voici maintenant les performances globales obtenues, le Radeon 9700 Pro étant pris comme référence :  En 1600*1200 32 bits, les cartes sont relativement proches mais cest le Radeon X800 XT qui prend légèrement lavantage sur le 6800 dans sa version Ultra Extreme. Le X800 Pro arrive pour sa part aux mêmes performances que le 6800 GT. Dans plusieurs jeux, les 6800 et X800 sont limitées par les performances du processeur central dans cette résolution qui est pourtant importante.  Lorsque lon active le filtrage anisotrope et lanti-crénelage (sauf sous Splinter Cell), les écarts se creusent. Cette fois, le Radeon X800 XT prend clairement la tête, alors que le X800 Pro arrive au niveau du GeForce 6800 Ultra. Les gains par rapport aux cartes de génération précédent sont très importants dans ces conditions. Mise à jour : ATI utilise en fait comme NVIDIA un filtrage qui se situe en bilinéaire et trilinéaire. ATI est donc légèrement avantagé dans ce test, cf. cette news. Page 9 - UT2003, Far Cry Unreal Tournament 2003  Sous Unreal Tournament 2003, en 1600*1200 32 bits nous sommes clairement limités par le processeur central, pourtant un Pentium 4 3.2 GHz. Les nouveaux modèles narrivent donc pas à se départager.  Une fois lanti aliasing et lanisotropic filtering activés, les choses vont un peu mieux. Les Radeon X800 offrent des gains important par rapport à la génération précédente et la version Ultra Extreme du 6800 soffre dune courte tête la première place. Far CryFar Cry est le premier jeu doté dun nouveau moteur spécialement conçu pour tirer partie des Pixel Shader. Il intègre des optimisations dédiées au GeForce et plus spécifiquement aux GeForce FX pour leur permettre de mieux sen tirer (passage en FP16 et remplacement de certains PS2.x par des PS1.x notamment, et donc parfois une qualité moindre).  En 1600*1200, GeForce 6800 et Radeon X800 se tiennent au coup à coude mais ce sont ces dernières qui prennent très légèrement lavantage.  Avec anti crénelage et filtrage anisotrope, les cartes ATI prennent un avantage net sur les solutions NVIDIA. Il faut noter quil est possible via 3D Analyze de faire reconnaître les GeForce comme des Radeon à Far Cry. Far Cry utilise alors le path R300 qui utilise moins de shader en précision partielle et de shader 1.x, et limpact se fait tout de suite sentir sur GeForce FX 5950 puisque les performances chutent de 24.7% en 1600*1200 32 bits. Sur GeForce 6800 Ultra, limpact est modéré (-7%). Un futur patch devrait dailleurs permettre au GeForce 6800 de ne plus passer par le path GeForce FX, ce dernier nétant plus nécessaire à la vue de son architecture. Page 10 - Tomb Raider, Splinter Cell Tomb Raider : Angel of DarknessTomb Raider est lun des premiers jeux à avoir utilisé les Pixel Shader 2.0.  Le moteur du jeu se limite de lui-même à 60 images / seconde, ce qui à tendance à fortement lisser les performances des cartes de dernière génération, si bien quil est difficile de dégager une tendance même si NVIDIA est très légèrement devant.  Avec AA 4x et Aniso 8x, les solutions ATI passent légèrement devant les cartes NVIDIA. Splinter Cell : Pandora Tomorrow   Sorti il ya peu, le deuxième Opus de Splinter Cell se caractérise comme son prédécesseur par son système de gestion des éclairages particulièrement réaliste. Les Radeon X800 sont devant les GeForce 6800, que ce soit avec ou sans filtrage anisotrope Splinter Cell ne permettant pas dactiver lanti aliasing. Page 11 - IL-2 FB, Warcraft III IL-2 Forgotten Battles  En 1600*1200, nous sommes limités dans IL-2 Forgotten Battles par le processeur central de notre configuration de test, ce qui fait que les cartes ne peuvent pas exprimer tout leur potentiel. On remarquera toutefois sur les cartes NVIDIA, cette limite se situe nettement plus haut que chez ATI, ce qui sexplique de part le driver OpenGL NVIDIA qui est plus optimisé.  Une fois lanti aliasing et lanisotropic filtering activés, ce sont les Radeon X800 qui reprennent le dessus. Warcraft III  Après Unreal Tournament et IL-2, Warcraft III est le 3è jeu sous lequel les cartes sont limitées par le processeur central en 1600*1200 32 bits. Comme sous IL-2 mais dans une moindre mesure, cette limite est plus élevée chez NVIDIA.  Avec anti crénelage et filtrage anisotrope, le Radeon X800 XT prend les commandes, suivi de près par les 6800 Ultra Extreme et Ultra. Le X800 Pro est pour sa part légèrement derrière le 6800 GT. Page 12 - Colin Mc Rae 04, Fifa 2004 Colin Mc Rae Rally 04  Nous abordons maintenant un autre type de jeu avec Colin Mc Rea Rally 04. Du fait de lutilisation massive de simple texturage, ce type de jeu met particulièrement à mal larchitecture GeForce FX. Le Radeon X800 XT est ici clairement à la fête, sa fréquence ny étant pas étrangère. En fait, même le Radeon X800 Pro sen tire très bien puisquil arrive légèrement devant le 6800 GT. Il faut dire qua 475 MHz ses 12 pipelines atteignent un fillrate de 5.7 Gpixels /s très comparable aux 5.6 Gpixels /s du 6800 GT (16 pipelines / 350 MHz).  Lactivation de lAA 4x et de laniso 8x ne fait que confirmer les résultats obtenus sans. Fifa 2004  Pour finir, voici quelques chiffres pris sous FIFA 2004, dont le moteur nest certes pas à la pointe de la technologie et cest peu de le dire. En fait, comme sous Colin Mc Rae, le simple texturage est ici à lhonneur. En 1600*1200 32 bits, les Radeon X800 sont en tête, mais on commence à être limité par le processeur central.  Une fois lanti aliasing et lanisotropic filtering activés, le Radeon X800 XT prend largement les devants alors que le X800 Pro se place juste devant le 6800 Ultra Extreme. Page 13 - Conclusion Conclusion  En ne dévoilant quà la dernière minute les spécifications réelles de ses dernières puces, ATI crée la surprise. Basés en (très) grande partie sur larchitecture R300 qui a déjà fait ses preuves, le X800 Pro comme le X800 XT Platinum Edition se montrent diablement efficaces dans les jeux actuels comme dans les opérations de pixel et vertex shading. Une fois les effets tels que lanti crénelage et le filtrage anisotrope activés, dans les jeux testés le X800 Pro peut même venir chatouiller le GeForce 6800 Ultra, alors que le X800 XT Platinum Edition va encore plus loin, ses 16 pipes à plus de 500 MHz aidant ! En ne dévoilant quà la dernière minute les spécifications réelles de ses dernières puces, ATI crée la surprise. Basés en (très) grande partie sur larchitecture R300 qui a déjà fait ses preuves, le X800 Pro comme le X800 XT Platinum Edition se montrent diablement efficaces dans les jeux actuels comme dans les opérations de pixel et vertex shading. Une fois les effets tels que lanti crénelage et le filtrage anisotrope activés, dans les jeux testés le X800 Pro peut même venir chatouiller le GeForce 6800 Ultra, alors que le X800 XT Platinum Edition va encore plus loin, ses 16 pipes à plus de 500 MHz aidant !NVIDIA est-il battu ? Il serait facile, et surtout hâtif, de tirer de telles conclusions. En effet, larchitecture introduite par NVIDIA avec le GeForce 6800 Ultra est beaucoup plus récente et dispose donc à priori de plus de potentiel pour de futurs gains de performances via les drivers. Le GeForce 6800 Ultra est également plus complexe au niveau du traitement des shaders, que ce soit au niveau de leur précision (FP32) ou de leur complexité (pixel et vertex shader 3.0), mais il faut voir en pratique quand et comment les développeurs de jeux en tireront partie. Ce discours vous fera peut-être penser au lancement des GeForce FX et à la déception qu´elles ont représenté tant leur inefficacité empêchait d´utiliser leur fonctions avancées mais les choses sont différentes avec le GeForce 6800 et ses fonctions avancées devraient être bien plus utilisables. Parmi ses autres avantages, il ne faut pas oublier son architecture particulièrement adaptée au moteur de Doom III du fait de sa gestion des ombrages ainsi que son moteur vidéo (ATI annonce pouvoir faire de même - encodage MPEG hardware - via les VideoShader), mais qui est intestable à lheure actuelle car non implémenté dans les drivers.  En attendant que tout ceci soit vérifié en pratique, il nen reste pas moins que cest ATI qui remporte aujourdhui la palme des performances et de lefficacité avec ses Radeon X800. Qui plus est alors qu´ATI annonce ses solutions après NVIDIA, les cartes proposées en test sont des cartes plus proches des versions finales et avec une disponibilité en France prévue pour la mi-mai en ce qui concerne les versions Pro (environ 450 €) et fin mai / début juin pour les versions XT Platinum Edition (environ 550 €). La guerre est toutefois loin dêtre terminée, et les choses seront cette fois bien plus serrées que sur la génération précédente ... En attendant que tout ceci soit vérifié en pratique, il nen reste pas moins que cest ATI qui remporte aujourdhui la palme des performances et de lefficacité avec ses Radeon X800. Qui plus est alors qu´ATI annonce ses solutions après NVIDIA, les cartes proposées en test sont des cartes plus proches des versions finales et avec une disponibilité en France prévue pour la mi-mai en ce qui concerne les versions Pro (environ 450 €) et fin mai / début juin pour les versions XT Platinum Edition (environ 550 €). La guerre est toutefois loin dêtre terminée, et les choses seront cette fois bien plus serrées que sur la génération précédente ...Copyright © 1997-2025 HardWare.fr. Tous droits réservés. |